-

Batch Normalization 可以

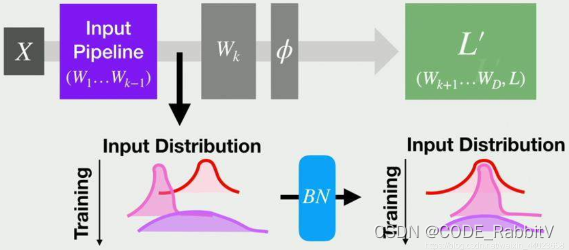

改善梯度消失/爆炸问题:前面层的梯度经过多次传递后会变得非常小(大),从而导致网络收敛速度慢(不收敛),应用 BN 可缓解加速网络收敛:BN 使得每个神经元的输入分布更加稳定减少过拟合:BN 可减少由于数据分布的变化导致的模型性能下降提高模型泛化能力:BN 使得模型对输入的微小变化更加稳定缓解超参敏感:对于 learning rate 等超参数敏感性降低- ...

-

Batch Normalization(BN):使 feature map 满足均值为 0,方差为 1 的分布规律

- 如果batch size为m,则在前向传播过程中,网络中每个节点都有m个输出,所谓的Batch Normalization,就是对该层每个节点的这m个输出进行归一化再输出

- 数学表达:每个 channel 下统计一个对应的均值和方差

x norm = x − E x V a r x + ϵ ∗ γ + β x_{\text{norm}} = \frac{x - \mathbb{E}x}{\sqrt{Varx+\epsilon}} * \gamma + \beta xnorm=Varx+ϵ x−Ex∗γ+β- 其中 γ , β \gamma, \beta γ,β 为可学习的参数

-

代码实践:

python3>>> import torch >>> import torch.nn as nn >>> >>> x = torch.rand(2,1,28,28) ## *0.创建输入 x >>> bn = nn.BatchNorm2d( ## *1. 创建 bn 层, 1, # -- 输入的 channel 数 training = False, # -- 是否为训练模式 affine = False) # -- 是否学习 γ β >>> out = bn(x) ## *2 获取输出 >>> # 查看相关数值 ------------------------------------------------ >>> bn.running_mean # 均值 tensor([0.0507]) >>> bn.running_var # 方差 tensor([0.9080]) >>> bn.weight # γ Parameter containing: tensor([1.], requires_grad=True) >>> bn.bias # β Parameter containing: tensor([0.], requires_grad=True)

PyTorch -- Batch Normalization(BN) 快速实践

CODE_RabbitV2024-06-16 5:05

相关推荐

jinxindeep几秒前

EgoLive:面向机器人操作学习的超大规模第一视角数据集Biomamba生信基地5 分钟前

AI虚拟细胞干扰工具大测评Kobebryant-Manba6 分钟前

记录正则化哈哈,柳暗花明7 分钟前

人工智能专业术语详解(I)Sirius Wu11 分钟前

MoE与Fengyu-Dense_架构对比及训练方案却道天凉_好个秋12 分钟前

HEVC(一):环路滤波MartinYeung518 分钟前

[论文学习]大型语言模型中个人可识别资讯(PII)的机器遗忘技术:UnlearnPII 基准与 PERMU 方法的分析Sirius Wu19 分钟前

Agent模型冷启动问题RSTJ_162528 分钟前

PYTHON+AI LLM DAY SIXTY-NINE喵叔哟29 分钟前

14【.NET10 实战--孢子记账--产品智能化】--智能生成预算