最近的工作 DeCo: Decoupling Token Compression from Semantic Abstraction in Multimodal Large Language Models 比较深入地分析了 Q-former 结构的问题。

论文链接:

https://arxiv.org/abs/2405.20985

先说观点:

\1. 训练资源足够的条件下,我们可以在多模态大语言模型中选择 Linear Projector/MLP,作为视觉-文本模态桥接器,即 LLaVA 的路线。Linear Projector 没有视觉信息损失、训练收敛快、表现也好。唯一的问题是会导致图片 token 序列很长,这在 GPU 等训练资源足够的情况下,是可以克服的。

\2. 我们想重点表达的是,训练资源有限的情况下(有限的 GPU、训练数据等),Q-former 也只是一个"低效"压缩器。如果想减少图片 token 数量来降低训练代价,简单的 AdaptiveAveragePooling 就够了。

我们的 DeCo 工作发现在减少图片 token 这个目标上,简单的 average pooling 表现就比 Q-former 更好、训练收敛也更快。同期的工作 PLLaVA 也在实验结果方面证明了 adaptive pooling 的优势。

这里,更重要的问题是"为什么简单的 average pooling 就比 Q-former 结构更好了?"。下面我会大概介绍一下 DeCo 的思路,希望能在一个新的角度给大家启发。

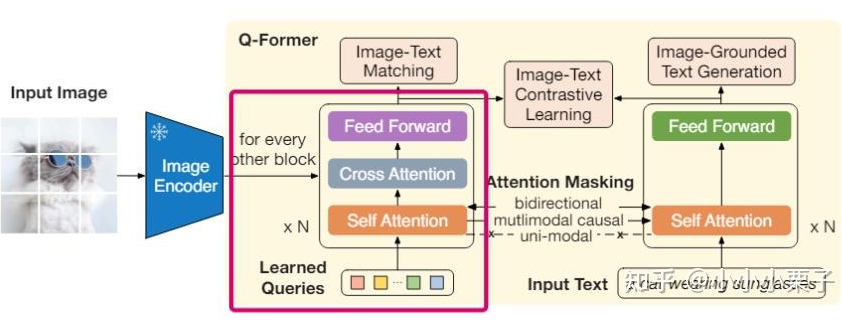

01 Q-former 结构的设计

我们要先从 Q-former 结构的设计说起。它的核心是拿一组预定义好的、可学的、固定数量(M 个)的 Query tokens,通过 cross attention 层去融合来自 image encoder 的 image token 信息。因为 Query tokens 的数量 M 是一个超参,所以我们可以灵活设一个比原始 image tokens number 小的数,就减少了 image tokens。

▲ Q-former 结构

▲ Q-former 结构

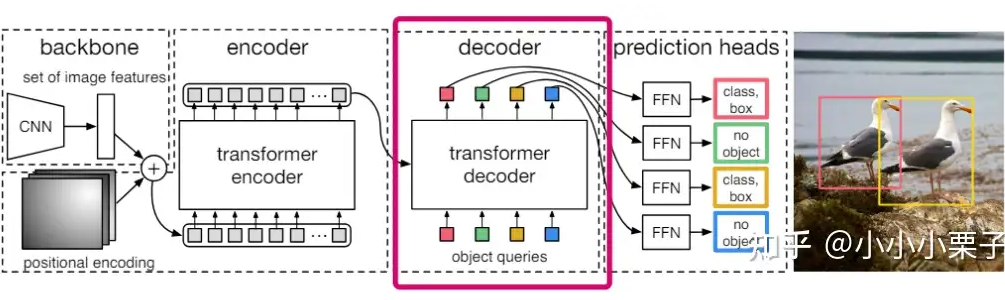

这个设计和 object detection 任务中一个非常经典的工作 DETR 很像。在 DETR 中,这一组 query tokens 是用来提取 object proposal 的,可以认为输入图片特征,query tokens 从中提取到了语义级别的 object concepts。

▲ DETR 结构

▲ DETR 结构

对 DETR 中学习到的 query tokens 的可视化(from GAE):

▲ 对 DETR 中不同 query 的可视化

▲ 对 DETR 中不同 query 的可视化

02 在MLLM中,Q-former学到了什么?

类似地,我们可以推断,MLLM 中的 Q-former 也是通过提取视觉 concepts 来减少图片 tokens 数量的,预期 Q-former 的输出 tokens 应该代表一组 visual concepts。

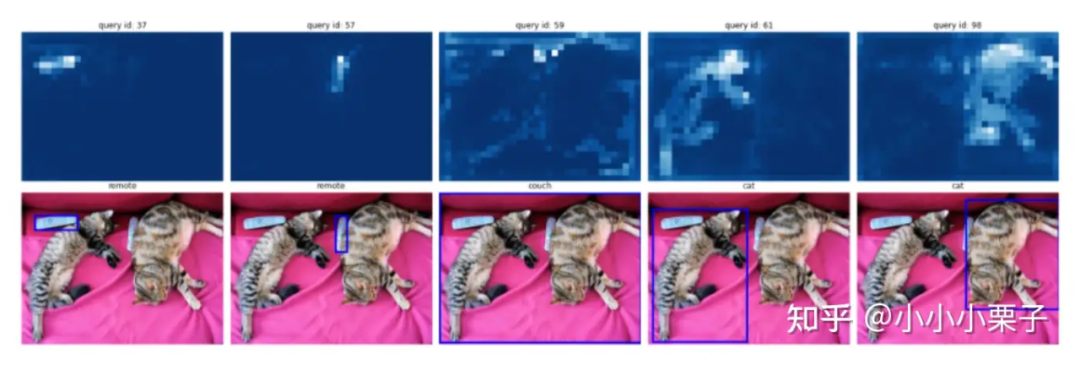

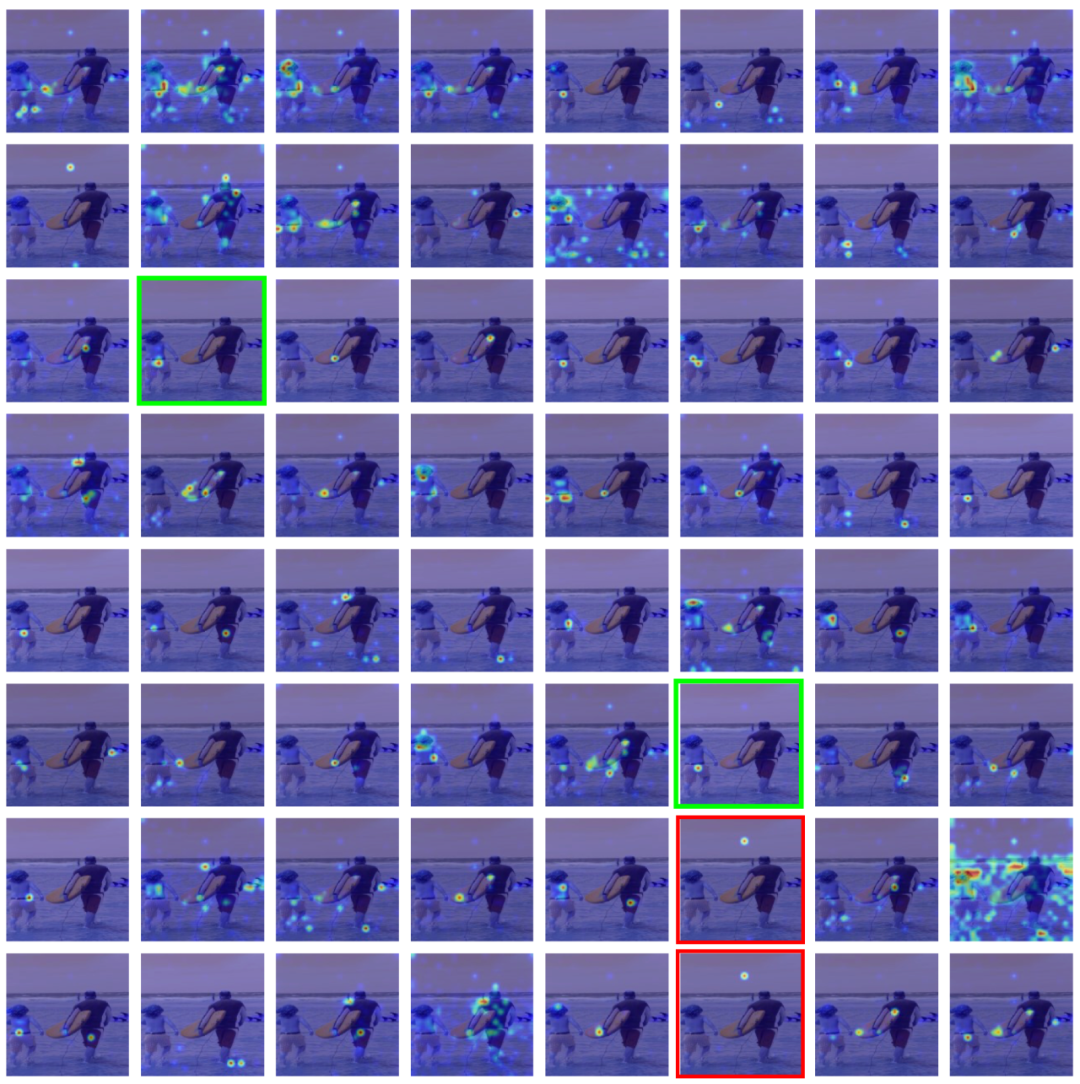

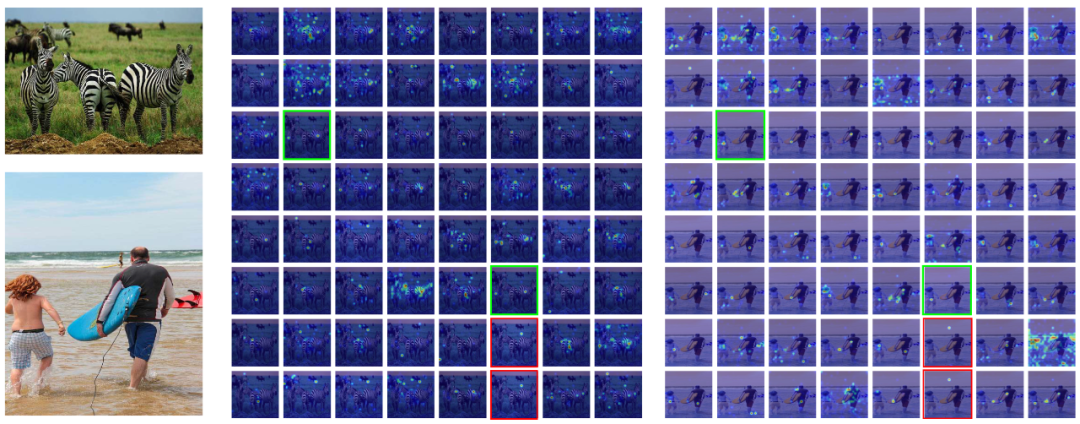

我们在 DeCo 中可视化了 MLLM 中 Q-former 训练后的输出,验证了 Q-former 确实是在视觉语义级别的压缩。下图可视化了 MLLM 中训练好的 Q-former 的输出,高亮了每个 query token 相对于原始图片 patch 的相关性矩阵。我们可以看到,将 576 image tokens 压缩成 64 query tokens,每个 query token 在负责不同的 visual concepts,包括不同的 objects、attributes 和 background 等等。

▲ 可视化 64 个 query tokens

▲ 可视化 64 个 query tokens

03 Q-former 的问题

问题1:作为一个视觉语义提取器,Q-former 是很难学好的。 和它的参数量没有直接的关系,比如只用 2 层的轻量 Q-former,也非常难学好。例如,我们的实验中把 LLaVA 那套框架,完全相同的模型、数据、训练配置,把 MLP 换成轻量的 2 层 Q-former(且用 BLIP-2 的参数初始化),实验结果依然下降非常夸张。

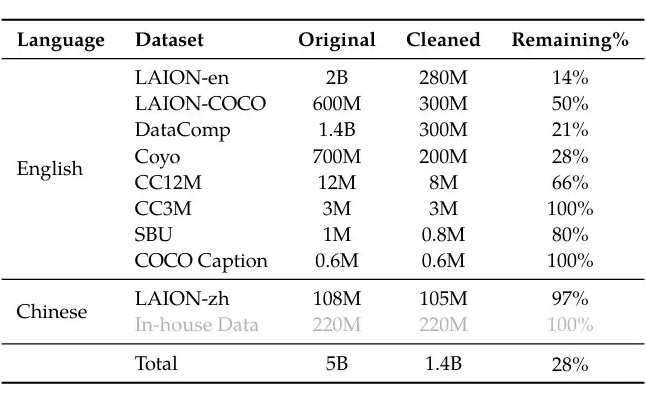

我们猜测是 LLaVA 使用的 558K+665K 量级的数据不足以把 Qformer 学好,但是简单地加入 CC12M 的数据或者其他数据进行尝试,也没有提升,这其中数据的调配、超参的调整等等流程大大增加了学好一个 MLLM 的难度,很复杂。考虑到 Qwen-VL-Chat 系列依然有很强的表现,我们不否认一个好的 Q-former 的上限,但是它确实在训练方面不简洁也不高效。放一张 Qwen-VL 论文中使用的数据感受下:

问题2:由于不好学,Q-former很容易成为MLLM中的一个bottleneck,丢失重要的视觉信息。

比如通过上面可视化的 64 个 query tokens,query tokens 学到的视觉 concepts 可能是:1)稀疏的 ,只包含了有限的视觉 concepts,2)重复的 ,不同的 query tokens 表达了重复的视觉 concepts,比如下面红色框和绿色框的 query tokens 是重复的。Honeybee 这篇工作还指出原始的 Q-former 结构会丢失图片的空间位置信息,等等。Q-former 中视觉信息的损失,会传递到 LLM,是不可逆的。

▲ 相同颜色框出的 query tokens 是重复的。这种重复的现象在不同的图片中都出现了。

▲ 相同颜色框出的 query tokens 是重复的。这种重复的现象在不同的图片中都出现了。

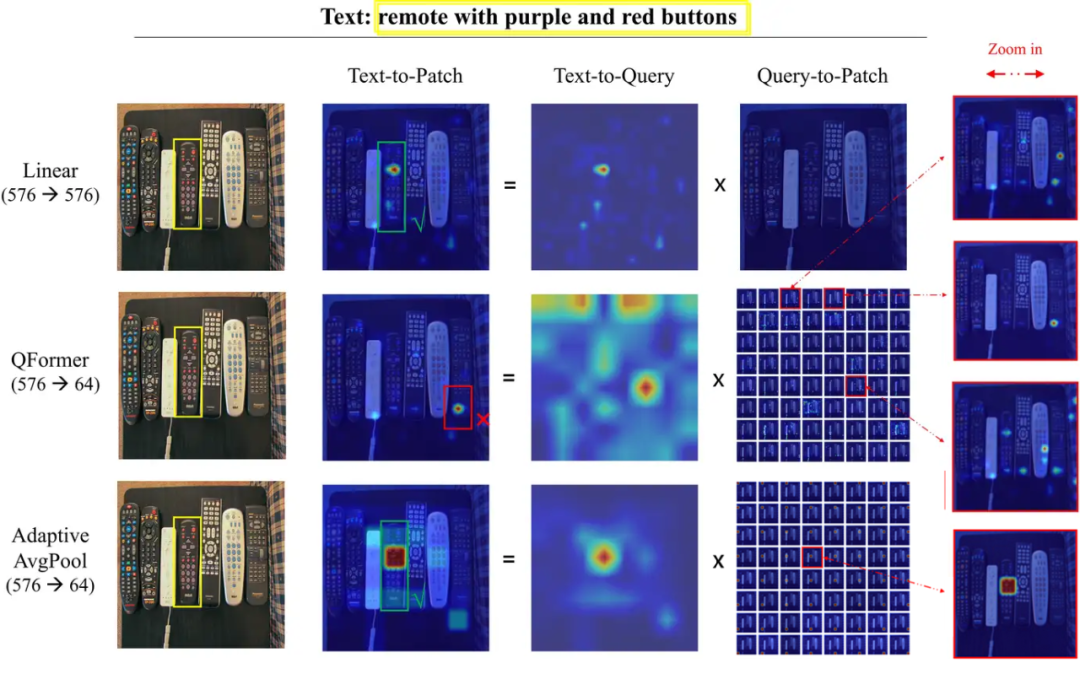

问题3:在 MLLM 中,Q-former 结构的视觉语义提取是多余的 。在 DeCo 工作中,我们解耦了 MLLM 中图文模态之间的语义对齐流,如下图。我们发现经过多模态对齐后,LLM 本身就是一个很好的视觉语义提取器。本质上,线性层或者 MLP 层映射后得到的还是 patch 级别的视觉特征、不是语义级别的,现在 LLaVA 路线强大的模型表现也证实了 LLM 能很好地提取视觉语义来生成文本回答。

那么,Q-former 对视觉语义的预提取其实就是多余的:让 Q-former 先进行一遍视觉语义提取得到视觉 concepts,然后让 LLM 基于这些视觉 concepts、根据输入的文本问题再进行一遍语义提取生成回答,就很"曲线救国"。本着"让专业的人做专业的事"的想法,在 MLLM 中,让强大的 LLM 来做语义级别的理解和提取是更合理的,没必要花很大精力和成本,再去学一个好的 Q-former。

▲ Q-former 中的视觉语义损失会传递给 LLM,导致最终的文到图(Text-to-Patch)语义对齐出现错误

▲ Q-former 中的视觉语义损失会传递给 LLM,导致最终的文到图(Text-to-Patch)语义对齐出现错误

所以,DeCo 的核心思想就是:为了减少图片 token 数,没必要用 Q-former 这种很难学习的视觉语义提取器,简单地在 patch-level 进行一个下采样就能减少 token 数,即 Decoupling Token Compression from Semantic Abstraction(DeCo)。那么最常见的一种下采样方式就是 2D adaptive pooling。

相比于 Q-former,Adaptive pooling 的好处是:1)pooling 操作是无参的,后接一个 MLP 映射一下视觉特征维度就可,训练收敛很快、简洁高效,不需要很多训练数据;2)2D 的基于 kernel 和 stride 的操作(类似 CNN 卷积核),能保留图片的空间信息。更多细节可以关注我们的论文。

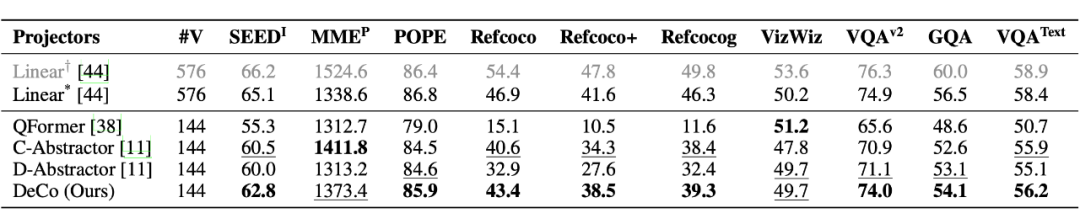

在对比实验中,我们使用了完全相同的实验设置、相同的压缩比(576 image tokens -> 144 query tokens),相比原始的 Q-former 和增强后的 locality-aware Q-former(即 Honeybee 中提出的 C-Abstractor 和 D-Abstractor),DeCo 的方法具有效率和表现上的优势。

其他值得讨论的:

DeCo 的核心是应该丢弃 Q-former 这种语义压缩器,简单在 Patch-level 或者更原始的 pixel-level 进行下采样来减少图片 token 数。它的思想不局限于 Average Pooling,我们只是通过分析和实验证明了 average pooling 是一种很好的下采样方式。

对于 image tokens,Q-former 是在视觉语义层面进行压缩、可能会丢失语义信息;而 adaptive pooling 本质上在 patch 级别进行一个稠密的下采样,可能会丢失原始的 patch 信息。

在不同的压缩比下,两者的信息损失也是一种 trade off。在常见的压缩需求上,比如用 144 tokens 来表示一张图片,adaptive pooling 的表现挺能打。同时,它在训练效率方面具有极大的优势,也不需要大量训练数据。实现上,可以直接调用 pytorch 的 torch.nn.AdaptiveAvgPool2d 函数,简洁方便。

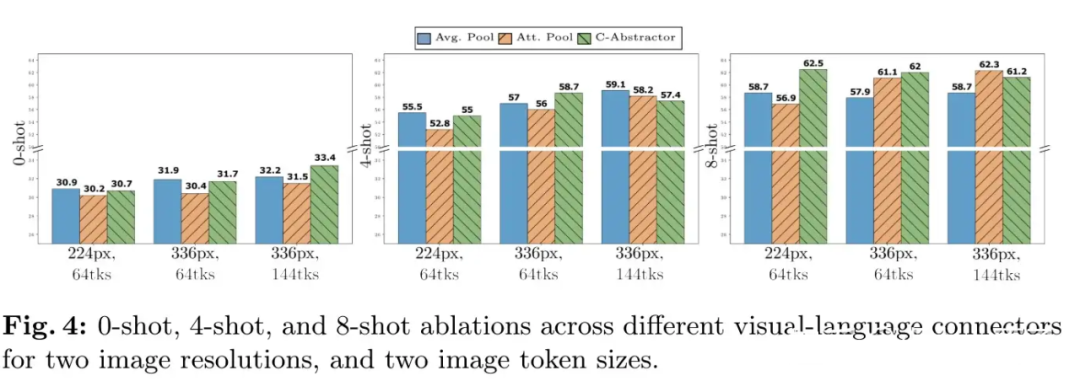

关于实验的设置,我们主要是在比较少的训练资源下训练的(LLaVA 的设置),average pooling 表现很好。在训练资源比较丰富的时候(更多数据、更多卡),参考 MM1 的结论,Q-former 相比于 average pooling 也没有优势。

▲ 图中的 Att Pool 就是 Q-former 结构

▲ 图中的 Att Pool 就是 Q-former 结构

视频理解任务(多图)或者高分辨率图片的场景下,视觉端的 token 序列会很长,这个时候用 average pooling 相比于 MLP 能大大减少 token 的数量。目前 DeCo 和 PLLaVA 主要是在 spatial 维度上验证了 average pooling 的简洁高效,但是在 temporal 维度上还没有充分的探索。

如何学习AI大模型?

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。