你是否曾经在复杂的数据仓库中迷失方向,不知道某个数据是从哪里来的,又会流向何方?或者在处理数据质量问题时,无法快速定位根源?如果是这样,那么数据血缘分析将会成为你的得力助手,帮助你在数据的海洋中找到明确的航向。

目录

引言:数据血缘分析的魔力

想象一下,如果你能够像追溯家族树一样,清晰地看到每一个数据元素的来源、变换过程和最终去向,那将会给你的数据管理带来怎样的变革?这就是数据血缘分析的魔力所在。本文将深入探讨数据血缘分析在数据仓库中的应用,为你揭示这一强大工具如何改变我们理解和管理数据的方式。

什么是数据血缘分析?

数据血缘分析(Data Lineage Analysis)是一种追踪、记录和可视化数据在整个生命周期中流动和转换过程的技术。它就像是为数据建立了一个详细的"族谱",记录了数据从产生、存储、处理到最终使用的每一个环节。

数据血缘的核心概念

- 数据源(Data Source):数据的原始来源,可能是业务系统、外部接口等。

- 数据转换(Data Transformation):数据在流动过程中经历的各种处理和变换。

- 数据目标(Data Target):数据最终存储或使用的位置。

- 数据流(Data Flow):数据从源到目标的整个流动路径。

- 元数据(Metadata):描述数据特征的数据,如数据类型、格式、业务含义等。

数据血缘分析在数据仓库中的应用

1. 数据质量管理

数据血缘分析可以帮助我们更有效地进行数据质量管理。当发现数据质量问题时,我们可以快速追溯数据的来源和处理过程,从而更容易定位和解决问题。

实际应用案例

假设我们在数据仓库的销售报表中发现了异常数据。通过数据血缘分析,我们可以迅速追踪这些数据的来源和处理过程:

原始交易数据 清洗转换 汇总计算 客户数据 产品信息 销售系统 ETL过程 数据仓库 销售报表 客户信息系统 产品目录

通过这个血缘图,我们可以看到:

- 销售数据来源于销售系统

- 在ETL过程中,销售数据与客户信息和产品信息进行了关联

- 数据经过清洗和转换后进入数据仓库

- 最后通过汇总计算生成销售报表

如果在销售报表中发现异常,我们可以沿着这个路径逐步排查:

- 检查销售系统的原始数据是否正确

- 验证ETL过程中的数据转换逻辑

- 确认客户信息和产品信息的准确性

- 检查数据仓库中的存储是否有问题

- 审核报表生成的汇总计算逻辑

这种有的放矢的排查方法大大提高了问题定位和解决的效率。

2. 影响分析

当需要对数据仓库进行变更时,数据血缘分析可以帮助我们评估变更的影响范围,避免意外破坏依赖于该数据的下游应用或报表。

实际应用案例

假设我们需要对客户表的结构进行修改,添加一个新的字段"客户等级"。通过数据血缘分析,我们可以清晰地看到这个变更会影响哪些downstream数据流和应用:

客户基础信息 客户画像 客户联系方式 销售业绩 目标客户群 服务记录 客户表 销售分析 营销活动 客户服务系统 管理层报表 精准营销 客户满意度分析

通过这个血缘图,我们可以看到:

- 客户表的变更将直接影响销售分析、营销活动和客户服务系统

- 间接影响管理层报表、精准营销和客户满意度分析

基于这个分析,我们可以制定详细的变更计划:

- 更新销售分析模块,确保它能正确处理新增的"客户等级"字段

- 修改营销活动系统,利用新的客户等级信息优化营销策略

- 升级客户服务系统,使客服人员能够看到客户等级信息

- 调整管理层报表,加入基于客户等级的新的业绩指标

- 重新设计精准营销策略,将客户等级作为一个关键的筛选条件

- 在客户满意度分析中加入客户等级维度,研究不同等级客户的满意度差异

通过这种全面的影响分析,我们可以确保数据仓库的变更能够平滑进行,最大化新字段带来的价值,同时最小化对现有系统的干扰。

3. 合规性和审计

在当今日益严格的数据保护法规下(如GDPR、CCPA等),数据血缘分析可以帮助企业追踪敏感数据的流动,确保合规性,并在需要时提供详细的审计线索。

实际应用案例

假设我们需要对用户的个人信息进行合规性审计,确保所有的个人数据都得到了适当的保护和使用。通过数据血缘分析,我们可以追踪个人数据在系统中的流动:

个人基本信息 匿名化处理 加密存储 聚合统计 访问控制 有限字段 用户注册系统 用户主数据库 分析数据库 备份系统 用户行为分析报告 客户服务系统 营销系统

通过这个血缘图,我们可以清晰地看到个人数据的流动路径:

- 用户的个人信息最初从用户注册系统收集

- 这些信息被存储在用户主数据库中

- 主数据库的数据经过匿名化处理后用于分析

- 原始数据在备份时进行了加密

- 客户服务系统可以访问用户数据,但有访问控制

- 营销系统只能访问有限的用户字段

基于这个血缘分析,我们可以进行以下合规性检查:

- 确认用户注册系统是否明确告知用户数据的收集目的和使用范围

- 验证用户主数据库的访问控制和加密措施是否足够强大

- 检查匿名化处理是否充分,确保无法从分析数据库中反推出个人身份

- 审核备份系统的加密方法是否符合最新的安全标准

- 检查客户服务系统的访问日志,确保只有授权人员在必要时访问用户数据

- 验证营销系统是否只包含用户明确同意用于营销目的的数据字段

通过这种详细的血缘分析和审计,企业可以:

- 向监管机构证明其数据处理流程的合规性

- 快速响应用户的数据访问或删除请求

- 在发生数据泄露时,准确评估影响范围并采取必要的补救措施

4. 数据治理

数据血缘分析是实现有效数据治理的关键工具。它可以帮助企业建立数据资产目录,明确数据所有权,并实施数据生命周期管理。

实际应用案例

假设我们要为企业建立一个全面的数据治理框架。数据血缘分析可以帮助我们梳理整个数据生态系统,识别关键数据资产,并建立相应的管理机制。

销售数据 客户数据 库存数据 集成数据 历史数据 汇总数据 预测模型输入 销售系统 数据集成层 CRM系统 库存系统 企业数据仓库 数据归档 BI报表 AI分析平台

基于这个数据血缘图,我们可以实施以下数据治理措施:

-

数据资产目录

- 为每个数据源(销售系统、CRM系统、库存系统)建立详细的数据字典

- 记录数据集成层的转换规则和数据质量标准

- 描述企业数据仓库中每个表和字段的业务含义和使用目的

-

数据所有权

- 指定销售部门为销售数据的所有者

- 指定客户服务部门为CRM数据的所有者

- 指定物流部门为库存数据的所有者

- 任命数据架构师为数据集成层和数据仓库的技术所有者

- 指定业务分析团队为BI报表的所有者

- 任命数据科学团队为AI分析平台的所有者

-

数据生命周期管理

- 制定源系统数据的保留策略,如销售数据在源系统保留3个月

- 建立数据仓库的数据更新和刷新机制,如每日增量更新,每周全量刷新

- 实施数据归档策略,如超过3年的历史数据移至归档系统

- 制定BI报表的更新频率和废弃机制

- 建立AI模型的定期重训练和验证流程

-

数据质量管理

- 在数据集成层实施数据质量检查,如检查数据完整性、一致性和准确性

- 建立数据质量评分机制,定期生成数据质量报告

- 制定数据质量问题的上报和解决流程

-

元数据管理

- 记录每个数据流转环节的元数据,包括数据格式、更新频率、责任人等

- 建立元数据更新机制,确保元数据与实际数据处理流程保持同步

-

数据安全和访问控制

- 基于数据血缘关系,实施细粒度的访问控制策略

- 对敏感数据(如客户个人信息)实施额外的安全措施,如加密存储、访问审计

- 建立数据脱敏机制,确保非生产环境不会暴露敏感信息

-

变更管理

- 建立数据模型变更的审批流程,评估变更对整个数据生态系统的影响

- 实施版本控制,记录数据模型、ETL流程、报表定义的所有变更历史

通过这种基于数据血缘的全面数据治理框架,企业可以:

- 提高数据质量和可靠性

- 增强数据的可用性和可理解性

- 确保数据使用的合规性和安全性

- 提高数据管理的效率和灵活性

- 为数据驱动的决策提供坚实的基础

5. 优化数据流程

数据血缘分析可以帮助我们识别数据流程中的瓶颈、冗余和非效率环节,从而优化整个数据处理流程,提高系统性能和资源利用率。

实际应用案例

假设我们的数据仓库每天凌晨进行数据刷新,但最近发现刷新时间越来越长,已经开始影响到早晨的报表生成。我们可以使用数据血缘分析来诊断和优化这个问题。

首先,让我们看一下当前的数据刷新流程:

```mermaid

graph TD

A[销售系统] -->|每小时增量| B[临时存储区]

C[库存系统] -->|每小时增量| B

D[CRM系统] -->|每日全量| B

B -->|数据抽取| E[原始数据层]

E -->|数据清洗| F[基础数据层]

F -->|数据转换| G[汇总数据层]

G -->|数据加载| H[数据集市]

H -->|报表生成| I[BI报表]通过这个数据血缘图,我们可以看到整个数据流程,从源系统到最终的BI报表。现在,让我们分析如何使用这个血缘图来优化数据流程:

-

识别瓶颈

- 我们注意到CRM系统是每日全量导入的,这可能是一个潜在的瓶颈。

- 数据清洗步骤可能涉及复杂的转换逻辑,也可能是一个耗时点。

-

发现冗余

- 临时存储区和原始数据层似乎在功能上有重叠,可能存在冗余。

- 汇总数据层和数据集市可能存在重复计算。

-

优化策略

a. 改进数据抽取方式

- 将CRM系统改为增量抽取,只导入新增或变更的数据。

sql-- 使用变更数据捕获(CDC)技术 INSERT INTO raw_crm_data SELECT * FROM crm_system.customers WHERE last_update_time > @last_extraction_timeb. 优化数据清洗流程

- 使用并行处理技术加速数据清洗。

- 将一些清洗逻辑下推到源系统,减少在ETL过程中的处理量。

pythonfrom pyspark.sql import SparkSession spark = SparkSession.builder.appName("DataCleansing").getOrCreate() def cleanse_data(df): return df.dropDuplicates().na.fill(0) raw_data = spark.read.parquet("raw_data_path") cleansed_data = cleanse_data(raw_data) cleansed_data.write.parquet("cleansed_data_path")c. 合并冗余步骤

- 将临时存储区直接合并到原始数据层,减少一次数据移动。

- 在加载到数据集市时直接进行汇总计算,避免中间汇总层。

sql-- 直接从原始数据创建汇总表 CREATE TABLE sales_summary AS SELECT date, product_id, SUM(quantity) as total_quantity, SUM(amount) as total_amount FROM raw_sales_data GROUP BY date, product_idd. 实施增量处理

- 对于汇总数据,实施增量更新而不是全量重计算。

sql-- 增量更新汇总表 MERGE INTO sales_summary t USING ( SELECT date, product_id, SUM(quantity) as total_quantity, SUM(amount) as total_amount FROM raw_sales_data WHERE date = CURRENT_DATE - 1 GROUP BY date, product_id ) s ON t.date = s.date AND t.product_id = s.product_id WHEN MATCHED THEN UPDATE SET t.total_quantity = t.total_quantity + s.total_quantity, t.total_amount = t.total_amount + s.total_amount WHEN NOT MATCHED THEN INSERT (date, product_id, total_quantity, total_amount) VALUES (s.date, s.product_id, s.total_quantity, s.total_amount)e. 优化数据存储

- 使用列式存储格式(如Parquet)来提高查询性能。

- 实施适当的分区策略,便于并行处理和快速查询。

python# 使用Spark将数据保存为分区的Parquet格式 (spark.read.format("jdbc") .option("url", jdbc_url) .option("dbtable", "sales_data") .load() .write .partitionBy("date") .parquet("s3://data-warehouse/sales_data"))

通过实施这些优化措施,我们可以显著提高数据处理的效率:

- 减少了数据传输量,特别是通过将CRM系统改为增量抽取

- 通过并行处理和优化存储格式,提高了数据清洗和转换的速度

- 消除了冗余步骤,简化了整体数据流程

- 通过增量更新策略,减少了每日全量重计算的需求

这个优化后的流程不仅可以缩短数据刷新的时间,还能提高整个数据仓库系统的灵活性和响应速度。更重要的是,通过数据血缘分析,我们能够清晰地看到每一个优化步骤对整体数据流的影响,确保在提高效率的同时不会破坏数据的完整性和一致性。

6. 数据溯源和问题诊断

在复杂的数据环境中,当出现数据异常或不一致时,快速定位问题源头是一个巨大的挑战。数据血缘分析提供了一个强大的工具,使我们能够迅速追溯数据的来源,理解数据的转换过程,从而更有效地进行问题诊断和解决。

实际应用案例

假设我们的月度销售报表中出现了异常数据,显示某个产品类别的销售额突然暴增。我们需要快速找出原因并核实数据的准确性。让我们看看如何使用数据血缘分析来解决这个问题:

原始交易数据 产品信息 货币转换 清洗和转换 数据聚合 销售系统 ETL处理 产品目录 汇率表 数据仓库 销售报表

基于这个数据血缘图,我们可以系统地进行问题诊断:

-

检查报表计算逻辑

首先,我们需要验证报表生成过程中的计算逻辑是否正确。

sql-- 验证报表计算逻辑 SELECT product_category, SUM(sales_amount) as total_sales, COUNT(DISTINCT order_id) as order_count FROM fact_sales WHERE date_key BETWEEN '2023-05-01' AND '2023-05-31' GROUP BY product_category HAVING product_category = 'Abnormal Category' -

追溯数据仓库中的原始数据

如果报表计算逻辑无误,我们需要检查数据仓库中的原始数据。

sql-- 检查数据仓库中的详细销售记录 SELECT * FROM fact_sales WHERE date_key BETWEEN '2023-05-01' AND '2023-05-31' AND product_category = 'Abnormal Category' ORDER BY sales_amount DESC -

验证ETL转换过程

如果数据仓库中的数据确实异常,我们需要检查ETL过程中的转换逻辑。

python# 伪代码:检查ETL转换逻辑 def transform_sales_data(raw_data): transformed_data = raw_data.copy() # 应用汇率转换 transformed_data['sales_amount'] = transformed_data.apply( lambda row: row['original_amount'] * get_exchange_rate(row['currency'], row['date']), axis=1 ) # 映射产品类别 transformed_data['product_category'] = transformed_data['product_id'].map(get_product_category) return transformed_data # 运行转换并检查结果 test_raw_data = get_sample_raw_data() test_transformed_data = transform_sales_data(test_raw_data) assert_data_quality(test_transformed_data) -

检查源系统数据

如果ETL过程无误,我们需要验证销售系统中的原始交易数据。

sql-- 在源系统中查询可疑交易 SELECT * FROM sales_transactions WHERE transaction_date BETWEEN '2023-05-01' AND '2023-05-31' AND product_id IN (SELECT product_id FROM products WHERE category = 'Abnormal Category') ORDER BY transaction_amount DESC -

核实辅助数据源

最后,我们还需要检查产品目录和汇率表,确保这些辅助数据源没有问题。

sql-- 检查产品目录 SELECT * FROM products WHERE category = 'Abnormal Category' -- 检查汇率表 SELECT * FROM exchange_rates WHERE date BETWEEN '2023-05-01' AND '2023-05-31'

通过这种系统的溯源过程,我们可能会发现问题的根源,例如:

- 报表计算逻辑中的一个错误,导致某些销售额被重复计算

- ETL过程中的一个bug,错误地将某些产品分类到了不正确的类别

- 源系统中录入了一笔特别大的交易,但没有经过适当的审核

- 产品目录更新时,某些产品被错误地分类

- 汇率表中某一天的汇率数据异常,导致外币销售额在转换时被大幅放大

无论是哪种情况,数据血缘分析都帮助我们快速定位了问题的可能源头,大大缩短了问题诊断和解决的时间。这不仅提高了数据分析的效率,还增强了数据用户对数据质量的信心。

7. 支持数据民主化

数据民主化是指让组织内的每个人都能便捷地访问和理解数据,从而做出数据驱动的决策。数据血缘分析在支持数据民主化方面发挥着关键作用,它可以帮助非技术用户理解数据的来源和流动,增强他们对数据的理解和信任。

实际应用案例

假设我们的公司正在推行一个数据民主化计划,目标是让各部门的业务用户能够自主访问和分析数据,而不需要总是依赖IT部门。让我们看看如何利用数据血缘分析来支持这个计划:

-

构建可视化的数据地图

使用数据血缘信息,我们可以创建一个直观的数据地图,展示关键业务指标的数据流动过程。

日常交易 客户信息 库存水平 数据转换 客户生命周期价值 销售业绩 库存周转率 销售系统 数据集成层 CRM系统 库存系统 企业数据仓库 客户分析数据集 销售分析数据集 供应链分析数据集 客户忠诚度仪表板 销售预测报告 库存优化建议

这个数据地图可以嵌入到公司的数据门户中,让业务用户能够直观地了解数据的流动过程。

-

提供数据字典和业务术语表

基于数据血缘信息,我们可以自动生成数据字典和业务术语表,帮助用户理解数据的含义。

sql-- 生成数据字典 SELECT table_name, column_name, data_type, column_description FROM data_catalog WHERE schema_name = 'sales_mart' ORDER BY table_name, column_namepython# 生成业务术语表 def generate_business_glossary(): glossary = {} for table in data_catalog: for column in table.columns: if column.business_term: glossary[column.business_term] = { 'definition': column.business_definition, 'calculation': column.calculation_logic, 'source': f"{table.name}.{column.name}" } return glossary business_glossary = generate_business_glossary() -

实施自助式数据探索工具

利用数据血缘信息,我们可以开发一个智能的自助式数据探索工具,帮助用户找到他们需要的数据。

pythonclass DataExplorer: def __init__(self, data_lineage_graph): self.graph = data_lineage_graph def search_data(self, keyword): results = [] for node in self.graph.nodes: if keyword in node.metadata: results.append({ 'name': node.name, 'type': node.type,'description': node.metadata['description'], 'lineage': self.get_lineage(node) }) return results def get_lineage(self, node): upstream = self.graph.get_upstream_nodes(node) downstream = self.graph.get_downstream_nodes(node) return { 'upstream': [n.name for n in upstream], 'downstream': [n.name for n in downstream] } # 使用示例 explorer = DataExplorer(data_lineage_graph) results = explorer.search_data("客户终身价值")这个工具可以让业务用户通过关键词搜索找到相关的数据资产,并了解这些数据的来源和去向。

-

数据影响分析

当数据结构或业务逻辑发生变化时,我们可以利用数据血缘信息来评估影响范围,并通知相关的数据用户。

pythondef analyze_impact(changed_node): impacted_nodes = data_lineage_graph.get_downstream_nodes(changed_node) impacted_reports = [] impacted_users = set() for node in impacted_nodes: if node.type == 'report': impacted_reports.append(node.name) impacted_users.update(node.users) return { 'impacted_reports': impacted_reports, 'impacted_users': list(impacted_users) } # 使用示例 changed_node = data_lineage_graph.get_node("customer_segmentation") impact = analyze_impact(changed_node) notify_users(impact['impacted_users'], impact['impacted_reports'])这种影响分析可以帮助维护数据质量,并确保数据变更不会对业务用户造成意外影响。

-

数据使用分析

通过分析数据血缘图,我们可以了解哪些数据资产被频繁使用,哪些很少使用,从而优化数据资源配置。

pythondef analyze_data_usage(): usage_stats = {} for node in data_lineage_graph.nodes: if node.type == 'table' or node.type == 'view': downstream = len(data_lineage_graph.get_downstream_nodes(node)) usage_stats[node.name] = { 'downstream_usage': downstream, 'last_access': node.last_access_time } return usage_stats # 使用示例 usage_stats = analyze_data_usage() for asset, stats in sorted(usage_stats.items(), key=lambda x: x[1]['downstream_usage'], reverse=True): print(f"{asset}: Used by {stats['downstream_usage']} downstream assets, last accessed on {stats['last_access']}")这种分析可以帮助我们识别核心数据资产,优化数据存储和计算资源分配。

-

数据沿袭可视化

为了帮助业务用户更好地理解复杂的数据转换过程,我们可以提供数据沿袭的可视化工具。

pythonimport networkx as nx import matplotlib.pyplot as plt def visualize_data_lineage(node_name): G = nx.DiGraph() node = data_lineage_graph.get_node(node_name) upstream = data_lineage_graph.get_upstream_nodes(node, levels=2) downstream = data_lineage_graph.get_downstream_nodes(node, levels=2) all_nodes = upstream + [node] + downstream for n in all_nodes: G.add_node(n.name) for n in all_nodes: for child in data_lineage_graph.get_direct_downstream_nodes(n): if child.name in G.nodes: G.add_edge(n.name, child.name) pos = nx.spring_layout(G) nx.draw(G, pos, with_labels=True, node_color='lightblue', node_size=2000, font_size=8, arrows=True) nx.draw_networkx_nodes(G, pos, nodelist=[node_name], node_color='red', node_size=2000) plt.title(f"Data Lineage for {node_name}") plt.axis('off') plt.show() # 使用示例 visualize_data_lineage("monthly_sales_report")这个可视化工具可以帮助业务用户直观地了解特定数据资产的上下游关系,便于他们理解数据的来源和影响。

通过这些应用,数据血缘分析极大地支持了数据民主化进程:

- 提高数据透明度:用户可以清晰地看到数据的来源和流动过程,增强了对数据的信任。

- 便利数据访问:自助式数据探索工具使得用户可以更容易地找到和理解他们需要的数据。

- 增强数据理解:数据字典、业务术语表和数据沿袭可视化帮助用户更好地理解数据的业务含义和计算逻辑。

- 支持协作决策:通过共享相同的数据视图和理解,不同部门的用户可以更好地协作和做出一致的决策。

- 提高数据素养:在使用这些工具的过程中,用户逐渐培养了数据思维,提高了数据素养。

8. 支持数据架构演进

在当今快速变化的业务环境中,数据架构需要不断演进以适应新的需求。数据血缘分析在支持数据架构演进方面发挥着重要作用,它可以帮助我们理解现有的数据关系,评估变更的影响,并指导架构的优化。

实际应用案例

假设我们的公司正在考虑将部分数据仓库迁移到云端,并引入实时数据处理能力。这是一个重大的架构变更,让我们看看如何利用数据血缘分析来支持这个过程:

-

现状评估

首先,我们需要对当前的数据架构有一个清晰的认识。利用数据血缘图,我们可以生成一个全面的数据架构视图。

批处理ETL 批处理ETL 批处理ETL 数据集市 数据集市 数据集市 销售系统 数据仓库 库存系统 CRM系统 财务报表 销售分析 库存管理

pythondef generate_architecture_overview(): systems = set() data_flows = [] for node in data_lineage_graph.nodes: if node.type == 'system': systems.add(node.name) elif node.type == 'data_flow': data_flows.append((node.source, node.target, node.frequency)) return { 'systems': list(systems), 'data_flows': data_flows } architecture = generate_architecture_overview() print("Current Systems:", architecture['systems']) print("Data Flows:") for flow in architecture['data_flows']: print(f" {flow[0]} -> {flow[1]} ({flow[2]})") -

识别迁移候选

基于数据血缘图,我们可以识别适合迁移到云端的数据集。

pythondef identify_migration_candidates(): candidates = [] for node in data_lineage_graph.nodes: if node.type == 'table' and node.size > LARGE_TABLE_THRESHOLD: upstream = data_lineage_graph.get_upstream_nodes(node) downstream = data_lineage_graph.get_downstream_nodes(node) if all(u.system != 'legacy_system' for u in upstream) and all(d.system != 'legacy_system' for d in downstream): candidates.append({ 'name': node.name, 'size': node.size, 'upstream': [u.name for u in upstream], 'downstream': [d.name for d in downstream] }) return candidates migration_candidates = identify_migration_candidates() for candidate in migration_candidates: print(f"Migration Candidate: {candidate['name']}") print(f" Size: {candidate['size']} GB") print(f" Upstream: {', '.join(candidate['upstream'])}") print(f" Downstream: {', '.join(candidate['downstream'])}") -

实时处理需求分析

通过分析数据血缘图,我们可以识别哪些数据流可能受益于实时处理。

pythondef identify_realtime_candidates(): candidates = [] for node in data_lineage_graph.nodes: if node.type == 'data_flow' and node.frequency == 'daily': if node.latency_sensitivity == 'high': candidates.append({ 'source': node.source, 'target': node.target, 'current_frequency': node.frequency, 'data_volume': node.daily_volume }) return candidates realtime_candidates = identify_realtime_candidates() for candidate in realtime_candidates: print(f"Realtime Processing Candidate:") print(f" {candidate['source']} -> {candidate['target']}") print(f" Current Frequency: {candidate['current_frequency']}") print(f" Daily Data Volume: {candidate['data_volume']} GB") -

影响分析

在进行架构变更时,我们需要评估这些变更对现有数据流和报表的影响。

pythondef analyze_migration_impact(migration_candidates): impacted_reports = set() impacted_systems = set() for candidate in migration_candidates: node = data_lineage_graph.get_node(candidate['name']) downstream = data_lineage_graph.get_downstream_nodes(node) for d in downstream: if d.type == 'report': impacted_reports.add(d.name) elif d.type == 'system': impacted_systems.add(d.name) return { 'impacted_reports': list(impacted_reports), 'impacted_systems': list(impacted_systems) } impact = analyze_migration_impact(migration_candidates) print("Impacted Reports:", impact['impacted_reports']) print("Impacted Systems:", impact['impacted_systems']) -

定义新的数据架构

基于上述分析,我们可以定义新的数据架构,包括云端组件和实时处理流程。

实时流处理 实时流处理 批处理ETL 流式ETL 数据集市 实时数据集市 数据集市 销售系统 流处理引擎 库存系统 CRM系统 云数据仓库 财务报表 实时销售仪表板 库存管理

pythondef define_new_architecture(migration_candidates, realtime_candidates): new_architecture = { 'cloud_components': [c['name'] for c in migration_candidates], 'realtime_flows': [(c['source'], c['target']) for c in realtime_candidates], 'batch_flows': [] } for flow in data_lineage_graph.get_all_flows(): if flow not in new_architecture['realtime_flows']: new_architecture['batch_flows'].append((flow.source, flow.target)) return new_architecture new_arch = define_new_architecture(migration_candidates, realtime_candidates) print("New Architecture:") print(" Cloud Components:", new_arch['cloud_components']) print(" Realtime Flows:", new_arch['realtime_flows']) print(" Remaining Batch Flows:", new_arch['batch_flows']) -

制定迁移计划

基于数据血缘分析,我们可以制定一个分阶段的迁移计划,确保平稳过渡。

pythondef create_migration_plan(migration_candidates, realtime_candidates): plan = [] # 第一阶段:迁移独立的数据集 independent_candidates = [c for c in migration_candidates if not c['upstream'] and not c['downstream']] plan.append({ 'phase': 1, 'description': '迁移独立数据集', 'tasks': [f"迁移 {c['name']} 到云端" for c in independent_candidates] }) # 第二阶段:实施实时处理 plan.append({ 'phase': 2, 'description': '实施实时处理流程', 'tasks': [f"为 {c['source']} -> {c['target']} 实施实时处理" for c in realtime_candidates] }) # 第三阶段:迁移剩余数据集 remaining_candidates = [c for c in migration_candidates if c not in independent_candidates] plan.append({ 'phase': 3, 'description': '迁移剩余数据集', 'tasks': [f"迁移 {c['name']} 到云端" for c in remaining_candidates] }) return plan migration_plan = create_migration_plan(migration_candidates, realtime_candidates) for phase in migration_plan: print(f"Phase {phase['phase']}: {phase['description']}") for task in phase['tasks']: print(f" - {task}")

通过这些应用,数据血缘分析在支持数据架构演进过程中发挥了关键作用:

-

全面了解现状 :- 全面了解现状:数据血缘分析提供了当前数据架构的全貌,包括数据流、系统间依赖关系等,为架构演进提供了坚实的基础。

-

精准识别迁移目标:通过分析数据血缘,我们可以准确识别适合迁移到云端的数据集,以及可以转为实时处理的数据流,从而制定有针对性的迁移策略。

-

评估变更影响:数据血缘分析使我们能够全面评估架构变更对现有系统和报表的影响,有助于制定合理的风险管理策略。

-

优化新架构设计:基于数据血缘的分析结果,我们可以设计出更加优化的新架构,确保数据流的连贯性和效率。

-

制定合理的迁移计划:数据血缘分析帮助我们理解数据之间的依赖关系,从而制定出分阶段、低风险的迁移计划。

-

支持持续优化:在新架构实施后,数据血缘分析可以持续提供洞察,帮助我们不断优化数据流程和架构设计。

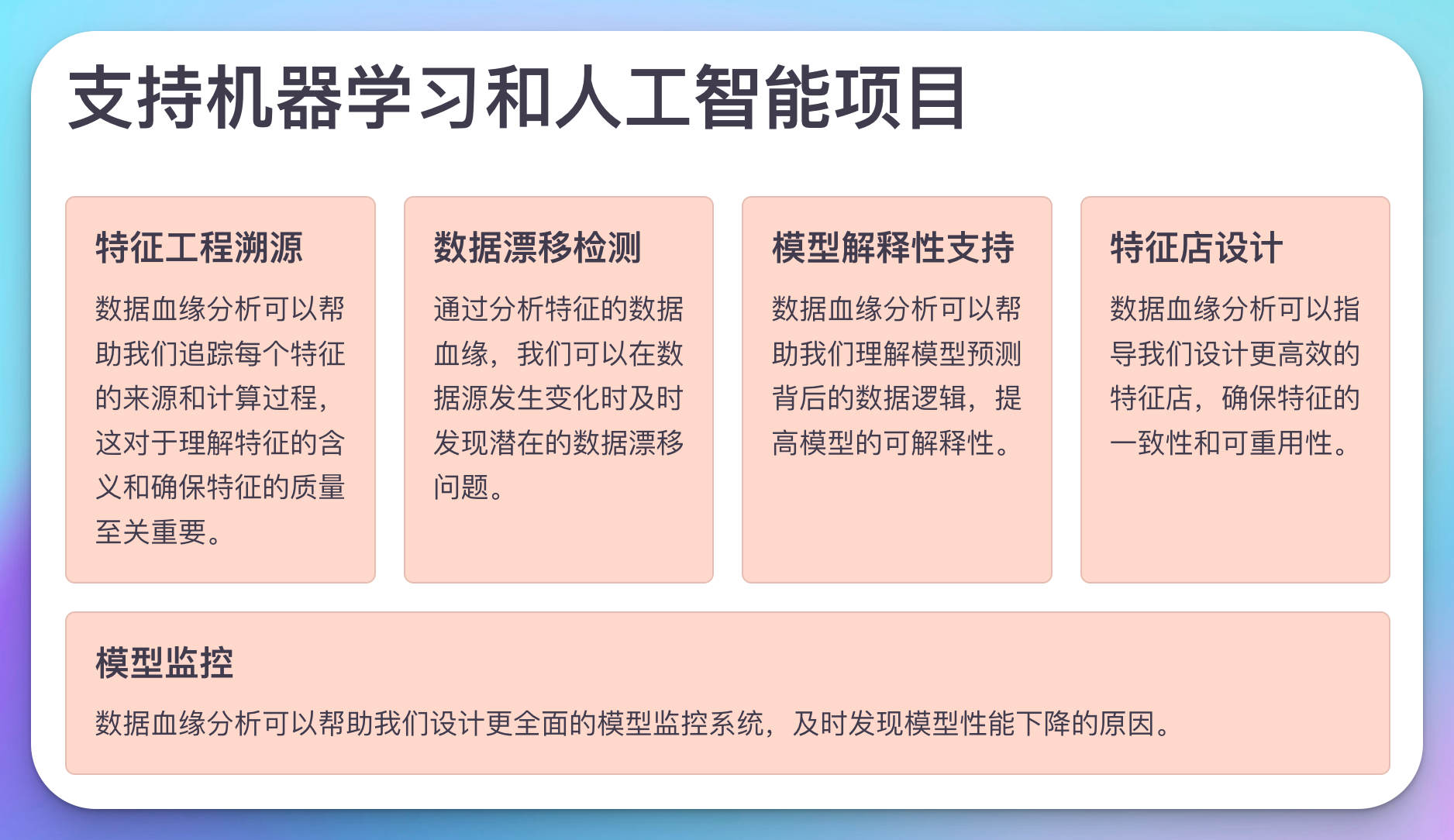

9. 支持机器学习和人工智能项目

在当今数据驱动的时代,机器学习和人工智能项目正在各个行业蓬勃发展。数据血缘分析在支持这些项目方面也发挥着重要作用,它可以帮助数据科学家更好地理解和管理他们的数据管道,从而提高模型的质量和可解释性。

实际应用案例

假设我们的公司正在开发一个客户流失预测模型。让我们看看如何利用数据血缘分析来支持这个机器学习项目:

-

特征工程溯源

数据血缘分析可以帮助我们追踪每个特征的来源和计算过程,这对于理解特征的含义和确保特征的质量至关重要。

pythondef trace_feature_lineage(feature_name): feature_node = data_lineage_graph.get_node(feature_name) lineage = [] def trace_upstream(node, depth=0): lineage.append({ 'name': node.name, 'type': node.type, 'depth': depth, 'transformation': node.transformation_logic if hasattr(node, 'transformation_logic') else None }) for parent in data_lineage_graph.get_direct_upstream_nodes(node): trace_upstream(parent, depth+1) trace_upstream(feature_node) return lineage # 使用示例 feature_lineage = trace_feature_lineage("customer_lifetime_value") for item in feature_lineage: print(" " * item['depth'] + f"{item['name']} ({item['type']})") if item['transformation']: print(" " * (item['depth']+1) + f"Transformation: {item['transformation']}")这个功能可以帮助数据科学家理解每个特征的计算过程,确保特征的正确性和合理性。

-

数据漂移检测

通过分析特征的数据血缘,我们可以在数据源发生变化时及时发现潜在的数据漂移问题。

pythondef detect_data_drift(feature_name): feature_node = data_lineage_graph.get_node(feature_name) upstream_nodes = data_lineage_graph.get_upstream_nodes(feature_node) potential_drift_sources = [] for node in upstream_nodes: if node.last_update_time > feature_node.last_update_time: potential_drift_sources.append({ 'name': node.name, 'last_update': node.last_update_time }) return potential_drift_sources # 使用示例 drift_sources = detect_data_drift("customer_lifetime_value") for source in drift_sources: print(f"Potential drift in {source['name']}, last updated on {source['last_update']}")这个功能可以帮助数据科学家及时发现可能导致模型性能下降的数据变化。

-

模型解释性支持

数据血缘分析可以帮助我们理解模型预测背后的数据逻辑,提高模型的可解释性。

pythondef explain_prediction(customer_id, prediction, top_features): explanation = [] for feature in top_features: feature_value = get_feature_value(customer_id, feature) feature_lineage = trace_feature_lineage(feature) explanation.append({ 'feature': feature, 'value': feature_value, 'importance': feature_importance(feature), 'lineage': feature_lineage }) return explanation # 使用示例 prediction_explanation = explain_prediction("CUST001", 0.75, ["customer_lifetime_value", "recent_purchase_amount"]) for item in prediction_explanation: print(f"Feature: {item['feature']}") print(f"Value: {item['value']}") print(f"Importance: {item['importance']}") print("Lineage:") for lineage_item in item['lineage']: print(" " * lineage_item['depth'] + lineage_item['name'])这个功能可以帮助业务用户理解模型为什么会做出特定的预测,增强对模型的信任。

-

特征店设计

数据血缘分析可以指导我们设计更高效的特征店,确保特征的一致性和可重用性。

pythondef design_feature_store(): features = [] for node in data_lineage_graph.nodes: if node.type == 'feature': features.append({ 'name': node.name, 'update_frequency': node.update_frequency, 'dependencies': [dep.name for dep in data_lineage_graph.get_direct_upstream_nodes(node)] }) # 根据依赖关系对特征进行分组 feature_groups = {} for feature in features: key = tuple(sorted(feature['dependencies'])) if key not in feature_groups: feature_groups[key] = [] feature_groups[key].append(feature) return feature_groups # 使用示例 feature_store_design = design_feature_store() for deps, features in feature_store_design.items(): print(f"Feature Group (Dependencies: {', '.join(deps)}):") for feature in features: print(f" - {feature['name']} (Update: {feature['update_frequency']})")这个功能可以帮助我们设计出更加高效和一致的特征店,提高特征管理的效率。

-

模型监控

数据血缘分析可以帮助我们设计更全面的模型监控系统,及时发现模型性能下降的原因。

pythondef setup_model_monitoring(model_name): model_node = data_lineage_graph.get_node(model_name) monitoring_points = [] # 监控输入特征 for feature in data_lineage_graph.get_direct_upstream_nodes(model_node): monitoring_points.append({ 'name': feature.name, 'type': 'feature', 'metrics': ['distribution_shift', 'missing_value_ratio'] }) # 监控原始数据源 raw_data_sources = get_raw_data_sources(model_node) for source in raw_data_sources: monitoring_points.append({ 'name': source.name, 'type': 'data_source', 'metrics': ['data_volume', 'schema_change'] }) # 监控模型输出 monitoring_points.append({ 'name': model_node.name, 'type': 'model', 'metrics': ['prediction_distribution', 'prediction_confidence'] }) return monitoring_points # 使用示例 monitoring_setup = setup_model_monitoring("customer_churn_model") for point in monitoring_setup: print(f"Monitoring Point: {point['name']} ({point['type']})") print(f" Metrics: {', '.join(point['metrics'])}")这个功能可以帮助我们建立一个全面的模型监控系统,覆盖从原始数据到模型输出的整个过程。

通过这些应用,数据血缘分析在支持机器学习和人工智能项目中发挥了重要作用:

- 提高特征质量:通过特征溯源,我们可以确保每个特征的计算过程是正确和合理的。

- 增强模型可解释性:数据血缘分析帮助我们解释模型的预测结果,提高模型的可信度。

- 支持数据漂移检测:及时发现可能导致模型性能下降的数据变化。

- 优化特征管理:指导特征店的设计,提高特征的一致性和可重用性。

- 改进模型监控 :帮助设计更全面的模型监控系统,覆盖从数据源到模型输出的全过程。

结论

数据血缘分析在数据仓库中的应用是多方面的,它不仅仅是一个技术工具,更是连接数据、技术和业务的桥梁。通过本文的探讨,我们可以看到数据血缘分析在以下方面发挥了关键作用:

- 数据质量管理:通过追溯数据源头,快速定位和解决数据质量问题。

- 影响分析:在进行数据架构或模型变更时,全面评估影响范围。

- 合规性和审计:追踪敏感数据的流动,确保数据使用合规。

- 数据治理:支持建立数据资产目录、明确数据所有权、实施数据生命周期管理。

- 优化数据流程:识别数据流程中的瓶颈和冗余,提高系统性能。

- 数据溯源和问题诊断:快速定位数据问题的根源,提高问题解决效率。

- 支持数据民主化:帮助非技术用户理解和使用数据,促进数据驱动的决策。

- 支持数据架构演进:指导数据架构的优化和升级,如云迁移和实时处理。

- 支持机器学习和AI项目:提高特征质量,增强模型可解释性,支持模型监控。

在实施数据血缘分析时,我们需要注意以下几点:

- 全面性:确保覆盖所有关键数据流和系统。

- 实时性:建立机制来及时捕获和更新数据血缘信息。

- 可视化:提供直观的数据血缘可视化工具,便于不同角色的用户理解和使用。

- 集成性:将数据血缘分析与其他数据管理工具和流程集成,如元数据管理、数据质量监控等。

- 安全性:在实施数据血缘分析时,要注意保护敏感信息。

展望未来,随着数据环境的日益复杂和数据驱动决策的普及,数据血缘分析将在数据管理和利用中扮演越来越重要的角色。它不仅是数据工程师和分析师的工具,也将成为业务用户理解和信任数据的重要手段。

通过持续投资和改进数据血缘分析能力,企业可以建立起更加透明、高效和可靠的数据生态系统,为数据驱动的创新和决策提供坚实的基础。