项目概述

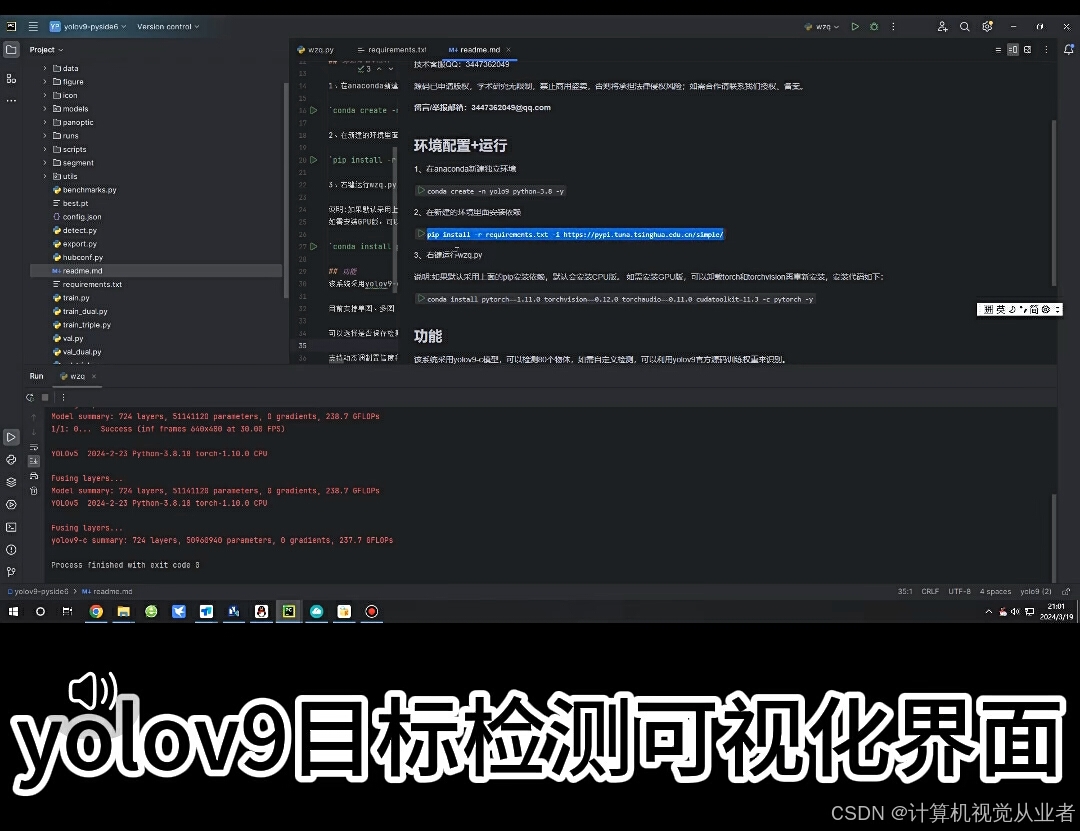

此项目旨在利用YOLOv9(You Only Look Once version 9)这一先进的目标检测模型,实现实时视频流中的物体识别与计数。通过集成PySide6库,我们能够构建一个直观且易于使用的图形用户界面(GUI),使得非专业人员也能轻松地操作和理解系统功能。

技术栈

- YOLOv9:一种快速而精确的目标检测算法,用于从摄像头视频流中识别特定类型的物体。

- PySide6:Python的一个跨平台GUI工具包,基于Qt框架,用于构建应用程序的用户界面。

- Python:主要的编程语言,用于编写整个应用程序的逻辑部分。

主要功能

- 实时目标检测:从摄像头获取视频帧,并使用YOLOv9模型实时检测其中的对象。

- 对象计数统计:对于检测到的每个类别的对象,系统将自动计数并在界面上显示数量。

- 可视化界面:PySide6创建了一个用户友好的界面,允许用户轻松启动/停止检测过程,调整参数,以及查看统计结果。

- 摄像头选择:支持多个摄像头输入,用户可以选择不同的视频源作为检测对象。

- 可配置性:用户可以根据需要调整检测阈值、类别选择等参数,以优化检测性能。

开发步骤

- 环境搭建:安装Python环境,以及必要的库如PyTorch、PySide6等。

- 模型准备:下载或训练YOLOv9模型,并将其加载到应用程序中。

- 界面设计:使用PySide6设计和实现GUI界面。

- 逻辑实现:编写处理视频流、目标检测、计数统计等功能的代码。

- 集成测试:确保各个模块正常工作,并进行整体测试。

- 部署与优化:根据实际使用情况调整性能,部署到目标设备上。

应用场景

此类项目适用于多种场合,例如工厂生产线上的质量控制、交通监控、安全防护等领域,能够帮助人们更高效地监控和管理特定环境下的动态变化。

展示如何集成YOLOv9模型进行目标检测,并使用PySide6来创建一个基本的用户界面。

首先,你需要确保安装了必要的库,包括torch(YOLOv9通常使用PyTorch)、PySide6以及其他可能需要的库。可以通过以下命令安装:

1pip install torch torchvision

2pip install PySide6接下来,我们创建一个简单的Python脚本来实现目标检测界面:

1import sys

2from PySide6.QtWidgets import QApplication, QMainWindow, QVBoxLayout, QWidget, QLabel, QPushButton

3from PySide6.QtGui import QImage, QPixmap

4from PySide6.QtCore import QTimer

5import cv2

6import torch

7

8# 加载YOLOv9模型

9model = torch.hub.load('ultralytics/yolov5', 'custom', path='path/to/your/yolov9.pt') # 请替换为你的模型路径

10

11class DetectionWindow(QMainWindow):

12 def __init__(self):

13 super().__init__()

14 self.setWindowTitle("YOLOv9 Object Detection")

15 self.setGeometry(100, 100, 800, 600)

16

17 self.central_widget = QWidget()

18 self.setCentralWidget(self.central_widget)

19

20 layout = QVBoxLayout()

21 self.label = QLabel()

22 self.label.setFixedSize(640, 480) # 根据实际情况调整大小

23 layout.addWidget(self.label)

24

25 self.button = QPushButton("Start Detection", self)

26 self.button.clicked.connect(self.start_detection)

27 layout.addWidget(self.button)

28

29 self.central_widget.setLayout(layout)

30

31 self.timer = QTimer()

32 self.timer.timeout.connect(self.update_frame)

33 self.cap = None

34

35 def start_detection(self):

36 if self.cap is None:

37 self.cap = cv2.VideoCapture(0) # 使用默认摄像头

38 self.timer.start(20) # 每50毫秒更新一次画面

39

40 def update_frame(self):

41 ret, frame = self.cap.read()

42 if ret:

43 results = model(frame)

44 frame = results.render()[0]

45 image = QImage(frame, frame.shape[1], frame.shape[0], QImage.Format_BGR888).rgbSwapped()

46 pixmap = QPixmap.fromImage(image)

47 self.label.setPixmap(pixmap)

48

49 def closeEvent(self, event):

50 if self.cap is not None:

51 self.cap.release()

52 self.timer.stop()

53 event.accept()

54

55if __name__ == '__main__':

56 app = QApplication(sys.argv)

57 win = DetectionWindow()

58 win.show()

59 sys.exit(app.exec())这段代码创建了一个简单的窗口,包含一个用于显示摄像头视图的标签和一个按钮。点击按钮后,程序会打开摄像头并开始检测视频帧中的物体。检测的结果会被渲染回视频帧,并在界面上显示出来。

请注意,在运行上述代码之前,你需要确保已经正确设置了YOLOv9模型的路径,并且你的环境中已经安装了所有必需的依赖项。此外,你还需要根据实际情况调整摄像头的参数和其他配置。这是一个基本的实现,实际应用中可能需要更多的优化和错误处理。