瑞典皇家科学院决定将 2024 年诺贝尔物理学奖授予约翰·霍普菲尔德 和杰弗里·辛顿,以表彰他们在人工智能和机器学习领域做出的贡献。

©Niklas Elmehed/瑞典皇家科学院

被誉为"人工智能之父"的 Geoffrey Hinton 教授在多伦多大学的研究工作中,开发出了人工神经网络,使机器能够以类似于人脑的方式进行学习。该技术构成了当今使用的人工智能系统的基础。

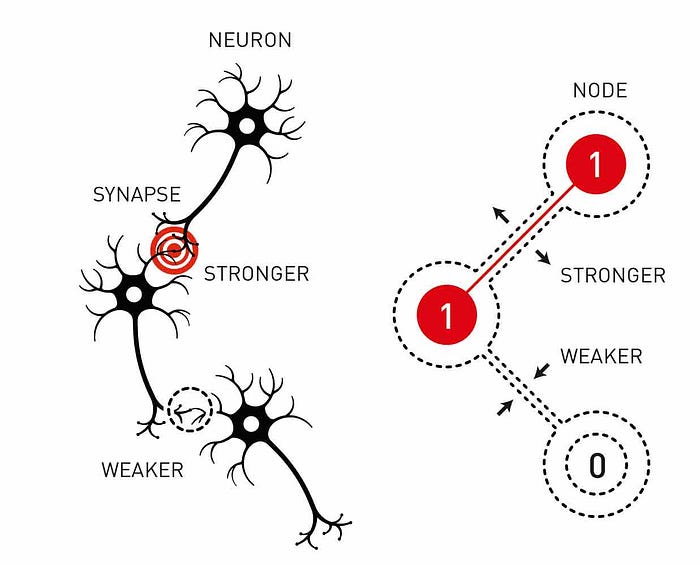

大脑是一个由神经元组成的神经网络,神经元通过突触相互发送信号(左)。当我们学习某些东西时,一些神经元之间的连接会加强,而另一些神经元之间的连接会减弱。人工神经网络(右)由用值编码的连接节点组成。当网络经过训练时,同时活跃的节点之间的连接会加强,否则会减弱。

自然神经网络与人工神经网络的比较。©Johan Jarnestad/瑞典皇家科学院

2012 年,辛顿和他的团队开发了一项使计算机能够识别视觉物体的技术,引起了谷歌等大公司的兴趣。然而,辛顿于 2023 年辞去了谷歌的职务,表示担心人工智能可能会变得危险。

而约翰·霍普菲尔德教授则于 1982 年发表了一篇论文,使人工神经网络能够模拟大脑的信息存储和记忆回忆过程。这项被称为"霍普菲尔德网络"的研究在机器学习的发展中发挥了重要作用。

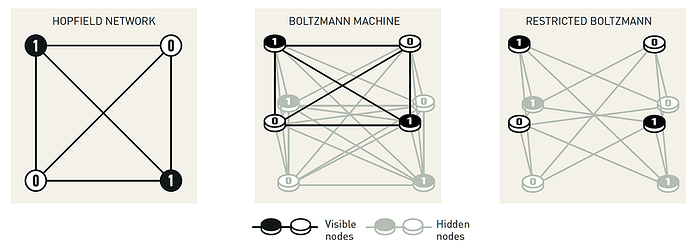

不同类型的网络:霍普菲尔德网络、玻尔兹曼机和受限玻尔兹曼机的示意图。©Johan Jarnestad/瑞典皇家科学院

20 世纪 80 年代初,霍普菲尔德开发了他的同名网络,该网络可用于存储模式,然后使用缺失的信息回忆它们。这被称为联想记忆,其在人类认知中的类似之处在于,当你只知道上下文和第一个或两个字母时,你就能记住一个单词。

Hopfield 网络是一层神经元(或节点)以这样的方式连接:每个节点的状态 0 或 1 受到其邻居状态的影响(我们可以在上图中看到这一点)。这类似于物理学家对磁性材料的建模方式,Hopfield 网络可以说是类似于自旋玻璃。

当图像被输入到网络中时,节点之间的链接强度会进行调整,图像会以低能量状态存储。这个最小化过程本质上是一种学习。当输入同一幅图像的不完美版本时,它会经过能量最小化过程,这个过程会改变一些节点的值,直到两幅图像相似。此外,Hopfield 网络可以存储多幅图像,通常可以区分所有图像。后来的网络使用可以采用两个以上值的节点,允许存储和检索更复杂的图像。随着网络的改进,可以检测到图像之间更细微的差异。

20 世纪 80 年代后期,Hinton 开始研究如何使用算法来像人脑一样处理模式。Hinton 和同事以简单的 Hopfield 网络为起点,利用统计物理学开发了玻尔兹曼机。它之所以如此命名,是因为它的工作原理类似于玻尔兹曼方程,该方程表明,某些状态比其他状态更有可能发生,这取决于系统的能量。

玻尔兹曼机通常有两层相互连接的节点:

-

可见层,即信息输入和输出的接口

-

隐藏层。

玻尔兹曼机具有生成性。例如,如果对一组相似的图像进行训练,它可以生成新的相似的原始图像。机器还可以学习对图像进行分类。人们已经意识到,可以通过消除某些节点之间的连接并创建"受限玻尔兹曼机 (RBM)"来提高玻尔兹曼机的性能。

霍普菲尔德网络和玻尔兹曼机为后来的机器学习和人工智能技术的发展奠定了基础,其中一些技术我们至今仍在使用。