钉钉报销【现货采购】集成到金蝶付款单【奥康/唐朝】的技术实现

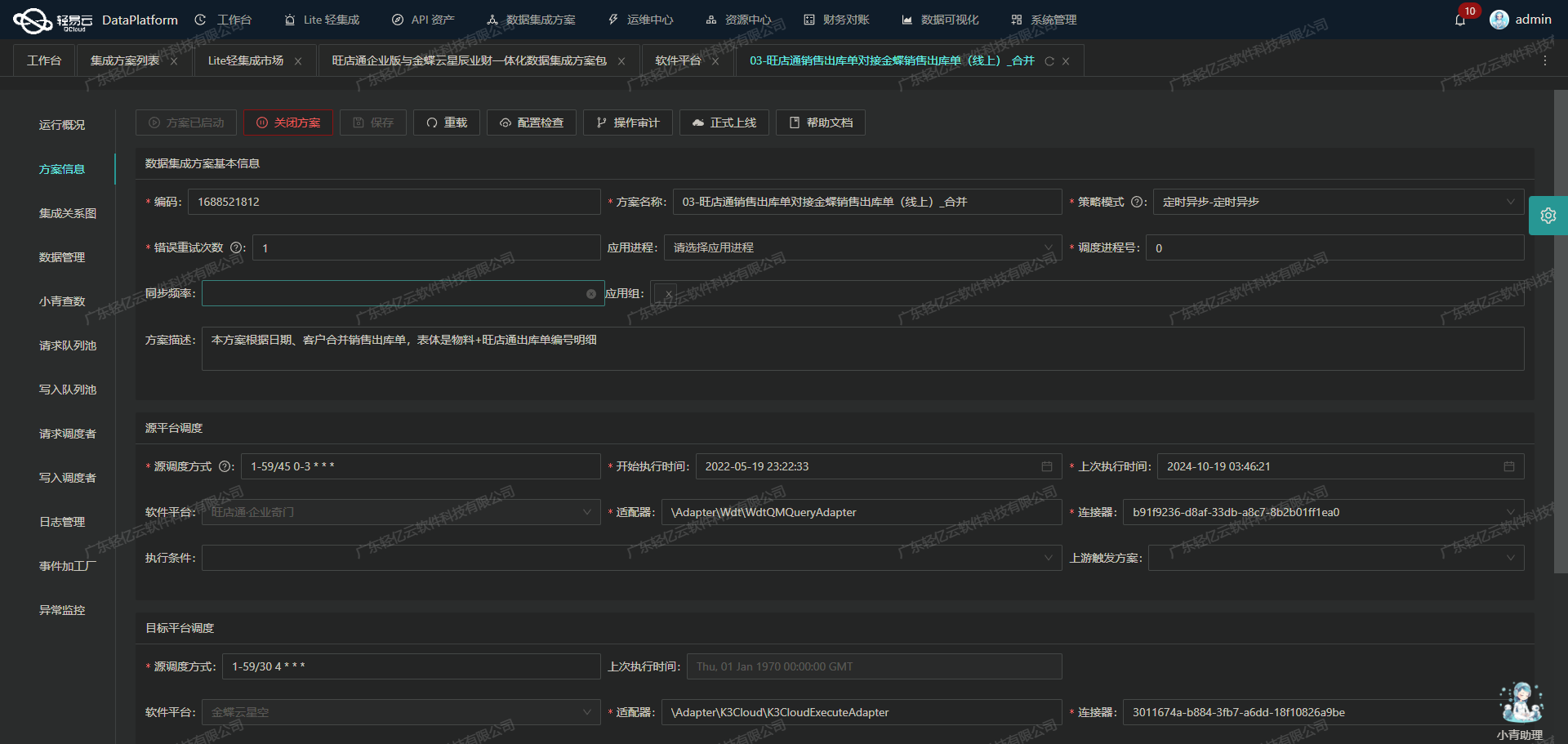

在企业日常运营中,数据的高效流转和准确对接是提升业务效率的关键。本文将分享一个实际案例:如何通过轻易云数据集成平台,将钉钉报销【现货采购】的数据无缝集成到金蝶云星空中的付款单【奥康/唐朝】。

数据获取与处理

首先,我们需要从钉钉系统中抓取报销数据。利用钉钉提供的API接口topapi/processinstance/get,我们能够定时、可靠地获取所需的报销信息。为了确保数据不漏单,我们设置了分页处理机制,并通过限流策略来应对API调用频率限制。

数据转换与映射

由于钉钉和金蝶云星空的数据格式存在差异,我们使用了自定义的数据转换逻辑,对获取的数据进行必要的格式化处理。这一步骤不仅保证了数据的一致性,还使得后续写入操作更加顺畅。

数据写入与监控

在完成数据转换后,下一步是将这些数据批量写入到金蝶云星空中。借助其提供的batchSave API接口,我们能够高效地将大量数据快速导入系统。同时,通过轻易云平台提供的集中监控和告警系统,我们可以实时跟踪每个数据集成任务的状态和性能,及时发现并解决潜在问题。

异常处理与重试机制

在实际操作过程中,不可避免会遇到各种异常情况。为此,我们设计了一套完善的异常处理与错误重试机制,确保即使在出现问题时,也能最大程度上保证数据传输的完整性和准确性。

通过以上步骤,实现了从钉钉报销【现货采购】到金蝶付款单【奥康/唐朝】的数据无缝对接,为企业内部流程优化提供了有力支持。在接下来的章节中,我们将详细探讨每个技术环节中的具体实现方法及注意事项。

调用钉钉接口topapi/processinstance/get获取并加工数据

在轻易云数据集成平台的生命周期中,调用源系统接口是至关重要的一步。本文将详细探讨如何通过调用钉钉接口topapi/processinstance/get来获取并加工处理数据,以实现从钉钉报销【现货采购】到金蝶付款单【奥康/唐朝】的集成方案。

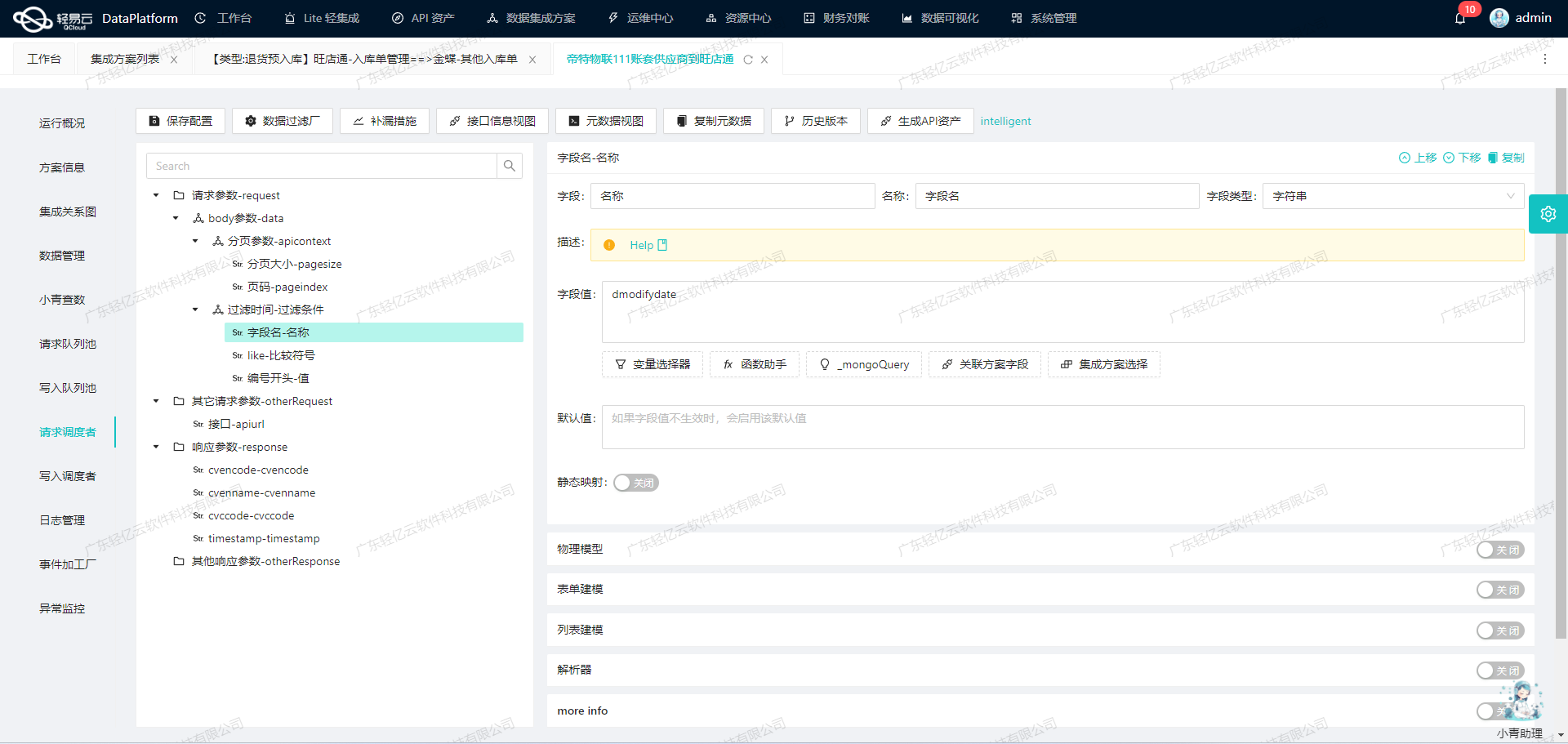

配置元数据

首先,我们需要配置元数据以便正确调用和处理钉钉API。以下是关键的元数据配置项:

- API :

topapi/processinstance/get - 请求方法 :

POST - ID检查 :

true - 响应格式化 :

- 将字段"付款方式"重命名为"付款方式_new"

- 数据类型为字符串

- 条件过滤 :

- 报销类别等于"现货采购"

这些配置确保了我们能够准确地筛选和处理所需的数据。

请求参数设置

为了成功调用API,我们需要设置一系列请求参数:

-

审批流的唯一码 (

process_code) :json"value": "PROC-12B1B605-2D28-43FE-80FB-13ECE6165313" -

审批实例开始时间 (

start_time) :json"value": "_function ( {LAST_SYNC_TIME} - ( 3600 * 96) ) * 1000" -

审批实例结束时间 (

end_time) :json"value": "{CURRENT_TIME}000" -

分页参数 (

size) :json"value": "20" -

分页查询游标 (

cursor) :json"field": "cursor",

这些参数确保了我们能够按需分页获取数据,并且可以根据上次同步时间动态调整查询范围。

数据请求与清洗

在发起API请求后,返回的数据可能包含大量不必要的信息。因此,需要对返回的数据进行清洗和格式化。例如,将字段"付款方式"重命名为"付款方式_new",并确保其数据类型为字符串。这一步骤可以通过预定义的格式化规则自动完成。

json

"formatResponse":[{"old":"付款方式","new":"付款方式_new","format":"string"}]这种自动化的数据清洗过程不仅提高了效率,还减少了人为错误的可能性。

条件过滤

为了确保只处理相关的报销记录,我们使用条件过滤功能。例如,只提取报销类别为"现货采购"的记录:

json

"condition":[[{"field":"报销类别","logic":"eq","value":"现货采购"}]]这种精确的条件过滤机制使得我们能够专注于特定业务场景,提高了数据处理的针对性和有效性。

分页与限流处理

由于API调用可能涉及大量数据,因此分页和限流是必须考虑的问题。通过设置分页参数(如每页大小、游标),我们可以逐步获取所有符合条件的数据。同时,通过监控API调用频率,可以避免触发限流机制,从而保证系统稳定运行。

json

"field":"size", "value":"20"实时监控与日志记录

在整个过程中,实时监控和日志记录是不可或缺的一部分。轻易云平台提供集中监控和告警系统,可以实时跟踪每个数据集成任务的状态和性能。一旦出现异常情况,如网络故障或API限流,系统会及时发出告警,并记录详细日志以便后续分析和处理。

总结

通过合理配置元数据、设置请求参数、进行条件过滤以及分页与限流处理,我们可以高效地调用钉钉接口topapi/processinstance/get获取并加工所需的数据。这不仅确保了集成过程的顺利进行,还大大提升了业务透明度和效率。在实际应用中,这种方法已经被证明是可靠且高效的,为企业实现不同系统间的数据无缝对接提供了坚实保障。

钉钉报销数据集成到金蝶云星空的ETL转换

在数据集成生命周期的第二步,我们需要将从钉钉获取的报销数据进行ETL(提取、转换和加载)处理,转化为金蝶云星空API接口所能接收的格式,并最终写入目标平台。本文将详细探讨这一过程中的关键技术点和配置细节。

数据提取与清洗

首先,从钉钉接口获取原始报销数据。我们使用topapi/processinstance/get接口来提取钉钉中报销流程实例的数据。这一步需特别注意分页和限流问题,以确保数据完整性和系统稳定性。

json

{

"process_instance_id": "xxxx",

"size": 20,

"cursor": 0

}数据转换

获取到原始数据后,需要将其转换为金蝶云星空API接口所能接收的格式。此过程主要包括字段映射、数据格式转换以及必要的数据清洗。

字段映射

根据元数据配置,将钉钉报销数据映射到金蝶付款单所需的字段。例如:

FBillNo对应钉钉的business_idFDATE对应finish_timeFPAYORGID和FSETTLEORGID需要根据费用归属项目进行匹配

json

{

"FBillNo": "{{extend.business_id}}",

"FDATE": "{{extend.finish_time}}",

"FPAYORGID": "_findCollection find Number from 723e2cb6-f80f-3823-8b4f-6e98b9713ba3 where Name={{费用归属项目}}"

}数据格式转换

在字段映射过程中,经常需要进行数据格式转换。例如,日期格式、金额单位等。轻易云平台提供了丰富的解析器(Parser),如 ConvertObjectParser,用于将不同系统的数据格式进行转换。

json

{

"parser": {

"name": "ConvertObjectParser",

"params": "FNumber"

}

}数据写入

完成数据转换后,将其写入到金蝶云星空系统中。我们使用金蝶云星空提供的批量保存API接口:batchSave。

API请求配置

根据元数据配置,构建API请求体,确保所有必要字段都已正确映射和转换。

json

{

"api": "batchSave",

"method": "POST",

...

}批量处理与高效写入

为了提升数据处理效率,采用批量处理方式,将多个报销单据一次性写入到金蝶云星空。这不仅减少了API调用次数,还提高了系统吞吐量和响应速度。

json

{

"operation": {

"method": "batchArraySave",

"rows": 1,

...

}

}异常处理与重试机制

在实际操作中,可能会遇到各种异常情况,如网络故障、API调用失败等。因此,需要实现异常处理与重试机制,以确保数据能够可靠地写入目标平台。

json

{

...

"IsAutoSubmitAndAudit": false,

...

}通过设置 IsAutoSubmitAndAudit 为 false,可以先提交再审核,确保每一步操作都可控且可追溯。

实时监控与日志记录

为了保障整个ETL过程的透明度和可监控性,需要实时监控每个任务的执行状态,并记录详细日志。一旦出现问题,可以快速定位并解决。

小结

通过以上步骤,我们实现了从钉钉到金蝶云星空的数据ETL转换,包括数据提取、清洗、字段映射、格式转换以及最终的数据写入。在这一过程中,充分利用轻易云平台提供的解析器、高效批量处理能力以及完善的异常处理机制,确保了数据集成过程的高效性和可靠性。