《博主简介》

小伙伴们好,我是阿旭。专注于人工智能、AIGC、python、计算机视觉相关分享研究。

👍感谢小伙伴们点赞、关注!

《------往期经典推荐------》

二、机器学习实战专栏【链接】 ,已更新31期,欢迎关注,持续更新中~~

三、深度学习【Pytorch】专栏【链接】

四、【Stable Diffusion绘画系列】专栏【链接】

五、YOLOv8改进专栏【链接】,持续更新中~~

六、YOLO性能对比专栏【链接】,持续更新中~

《------正文------》

目录

YOLOv11基本架构

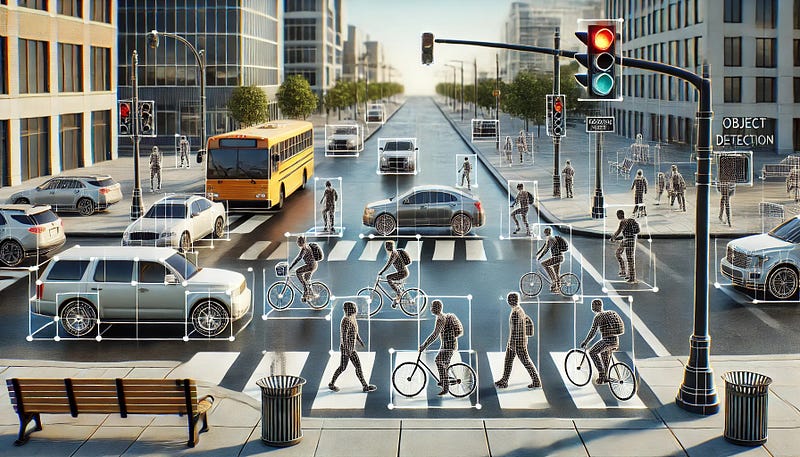

YOLOv11是YOLO系列的最新产品。YOLO是一种几乎无与伦比的算法,在物体检测领域取得了非常成功的结果。该算法系列在YOLOv5之后继续由Ultralytics开发,每一个新模型都继续产生更好的性能。

YOLOv11是Ultralytics开发的最新YOLO型号。该模型在执行实时对象检测的同时继续平衡准确性和效率。基于之前的YOLO版本,YOLO 11在架构和培训方面进行了重大改进。在保持速度的同时提高性能的最重要的架构变化是增加了C3K2块、SPFF模块和C2PSA块。

C3 K2块: 这是对之前版本中引入的CSP(跨阶段部分)块的增强。该模块使用不同的内核大小(例如3x3或5x5)和通道分离策略优化更复杂特征的提取。

SPFF(Spatial Pyramid Pooling Fusion)模块: 它是在YOLO版本中使用的SPP(Spatial Pyramid Pooling)模块的优化版本。该模块通过捕获不同尺度下的对象属性,使模型能够更好地执行。

C2 PSA块: 该块通过结合通道和空间信息提供更有效的特征提取。它还与多头注意机制一起工作,从而能够更准确地感知物体。它优化了前几层的特征图,并使用注意力机制来丰富它们,以提高模型的性能。这种结构可以实现更精确的检测,特别是在复杂场景中,并提高了YOLOv11的准确性。

除了这些架构上的变化,YOLOv11还具有与YOLOv8一样的多模型功能。由于其多模型功能,YOLOv11可以执行的任务如下:

- 目标检测: 识别和定位图像中的目标。

- 实例分割: 检测对象并确定其边界。

- 分类: 将图像分类到预定义的类别中。

- 姿态估计: 检测和跟踪人体上的地标。

- 定向对象检测(OBB): 检测旋转对象以获得更高的灵敏度。

在我们开始使用它之前,让我们来谈谈新版本的YOLO所带来的功能。

- 现有的主干结构已被C3K2块取代,以提高特征提取能力。

- 颈部结构已通过SPFF模块进行了改进,以捕获不同尺寸的物体,并更好地检测小物体。

- 增加了C2PSA块, 以聚焦较小或部分遮挡的物体中的重要区域。

- 任务的数量随着多模型功能的增加而增加。

- 更好地适应各种环境,包括边缘设备。

- 由于其优化的架构和高效的处理能力,它可以部署在边缘设备,云平台和支持NVIDIA GPU的系统上。

由于这些优化和创新,YOLOv11提供了性能提升,特别是在实时应用中。该模型运行速度更快,更准确,提高了目标检测,样本分割和姿态估计等任务的效率。此外,兼容性得到了改进,因此模型可以轻松地在不同的平台和硬件(例如云或边缘设备)上运行。

在Ultralyricts页面上,当他们评估YOLOv11与以前版本相比的性能时,他们说了以下内容。

随着模型设计的进步,YOLO11m在COCO数据集上实现了更高的平均精度(mAP),同时使用的参数比YOLOv8m少22%,使其在不影响精度的情况下提高了计算效率。

然而,尽管YOLOv 11模型的性能良好,并且提供了广泛的范围,但与YOLOv 10相比,它在目标检测方面并不十分成功。虽然YOLOv 10有更多的参数,但YOLOv 11的性能更好,只有很小的差异(+0.1-0.5)。在这种情况下,YOLOv 10可能仍然是我们的首选,因为过多的参数会导致速度和成本的损失。

YOLOv11目标检测使用指令

使用PyTorch构建YOLOv11模型及其与其他模式的使用简要如下。

步骤1: 首先,我们需要下载Ultralytics库。使用这个库,我们可以运行从YOLOv3到YOLOv11的所有模型。

pip install ultralytics步骤2: 如果你只想在训练好的模型中进行预测。下面的代码就足够了。否则你可以跳过它。

yolo predict model=yolo11n.pt source='https://ultralytics.com/images/bus.jpg'py步骤3: 如果你说不,我想训练我的模型,你可以选择你想要的模型并下载.pt文件。

from ultralytics import YOLO

# Load a COCO-pretrained YOLO11n model

model = YOLO("yolo11n.pt")步骤4: 然后您需要选择训练数据,epochs的数量,图像的大小和您的设备。

train_results = model.train(

data="coco8.yaml", # path to dataset YAML

epochs=100, # number of training epochs

imgsz=640, # training image size

device="cpu", # device to run on, i.e. device=0 or device=0,1,2,3 or device=cpu

)步骤5: 您需要使用验证数据评估和测试模型。它将验证数据与训练数据本身分离,对于测试,您只需提供所需图像的路径。

metrics = model.val()

results = model("path/to/image.jpg")

results[0].show()步骤6: 在最后一步中,我们可以导出您的模型,并在以后反复使用它。如果你想用自己的模型进行预测,只需使用步骤2。

path = model.export(format="onnx")YOLOv11其他命令

要使用您自己的数据以特定的学习率和epoch训练您的对象检测模型:

python

yolo train data=coco8.yaml model=yolo11n.pt epochs=10 lr0=0.01对于模型验证:

python

yolo val model=yolo11n.pt data=coco8.yaml batch=1 imgsz=640要在YouTube视频上测试模型的结果,图像大小为320:

python

yolo predict model=yolo11n.pt source='https://youtu.be/LNwODJXcvt4' imgsz=320要使用预训练的分割模型预测具有320个图像大小的YouTube视频:

python

yolo segment predict model=yolo11n-seg.pt source='https://youtu.be/LNwODJXcvt4' imgsz=320要将经过特殊训练的模型导出为.pt扩展名,请执行以下操作:

python

yolo export model=path/to/best.pt format=onnx

好了,这篇文章就介绍到这里,喜欢的小伙伴感谢给点个赞和关注,更多精彩内容持续更新~~

关于本篇文章大家有任何建议或意见,欢迎在评论区留言交流!