今天为大家介绍的是来自上海交通大学的王延峰与谢伟迪团队的一篇论文。开源的多语言医学语言模型的发展可以惠及来自不同地区、语言多样化的广泛受众。

来源丨 DrugAI、 机器人的脑电波

**论文:**https://www.nature.com/articles/s41467-024-52417-z

**MMedC:**https://huggingface.co/datasets/Henrychur/MMedC

**MMedBench:**https://huggingface.co/datasets/Henrychur/MMedBench

**代码:**https://github.com/MAGIC-AI4Med/MMedLM

在近期研究中,大型语言模型在医疗领域展现了巨大潜力。例如,GPT-4和MedPalm-2等闭源模型表现优异,通过了美国医学执照考试。同时,像Llama 2这样的开源模型也促进了医学专用语言模型的发展,如MEDITRON、PMC-LLaMA、MedAlpaca和ChatDoctors,逐步缩小了与闭源模型的性能差距。然而,这些模型主要面向英语应用,限制了其在更广泛语言环境中的使用。在开源的多语言LLM领域,尽管模型如BLOOM和InternLM已在多语言语料库上训练,但在非英语医学问题上的表现仍不理想,主要原因是医疗内容在通用数据集中占比不足。本文通过开发一个开源的多语言医疗语言模型,旨在填补这一空白。

该研究的贡献包括三方面:

-

构建了一个包含255亿tokens的多语言医学语料库MMedC,用于自回归训练;

-

提出了一个多语言医学多项选择问答基准MMedBench,用于评估模型在零样本和微调设置下的问答和推理能力;

-

测试了多种现有模型及在MMedC上进一步训练的模型。通过这些全面评估,作者希望更好地理解模型在多语言医学问题处理中的能力。

方 法

为了实现自回归训练,开发了一个大规模多语言医疗语料库(MMedC),汇集了超过255亿个涵盖主要六种语言的医疗相关标记:英语、中文、日语、法语、俄语和西班牙语。这一多样化的数据集由四个不同的来源编制而成:

(i) 设计了一个自动化管道从大众多语言语料库中过滤医疗相关内容,确保数据集的聚焦和相关性;

(ii) 策划并收集了多种语言的医学教科书,并通过精心设计的预处理如光学字符识别(OCR)、启发式数据过滤等转换为文本;

(iii) 为保证医疗知识的广泛涵盖,从一些开源医疗网站中加入文本,丰富了语料库的权威和综合性信息;

(iv) 整合了一些现有的小规模医疗语料数据集,进一步增强了广度和深度。

据了解,MMedC代表了第一个多语言医疗领域的专用语料库。

对于基准评估的设定,开始于汇聚现有的跨六种语言的医疗多选问答数据集,如同于MMedC。进一步通过使用GPT-4增强它们的推理内容,丰富数据集以支持正确答案的解释。因此,增强的数据集涵盖53,566对问答,其中每种语言都提供独特的多选问答及随附的推理推断。这个广泛的收集囊括了从内科、生物化学、药理学到精神病学等多个医学领域。

实 验

在评估阶段,我们对十一种现有支持多国语言的LLMs进行全面基准测试,包括GPT-3.5、GPT-4、Gemini-1.0、BLOOM、InternLM、InternLM 2, MedAlpaca、ChatDoctor、PMC-LLaMA、Mistral、BioMistral、MEDITRON、Llama 2 和 Llama 3,以及那些在MMedC上进一步训练的LLM。模型在三种不同设置下进行评估:零样本、参数高效微调(PEFT)和完整微调。考虑到评估推理质量的复杂性,在运用主流自动化指标之外,我们还结合了人类评级分数在我们的分析中。这种双重方法不仅提供了对每个模型性能的全面度量,还使我们能够深入探究自动化指标与人工评分之间的相关性,从而丰富了用于评估大型语言模型推理能力的方法。

在实验中,那些进一步在MMedC上进行自回归训练的模型一致展示出提升的性能,从而强调了我们编制的多语言语料库的重要性和有效性。最终模型MMed-Llama 3在多语言和仅英语基准上均表现最佳。我们将公开我们的数据集(除去有许可证限制的书籍,我们将提供一个书名列表)、代码库和训练模型,以促进未来的研究。此外,我们深知稳健评估指标准确性的重要性,尤其是在涉及复杂长句的医学文本生成时。为此,详细的人类评级结果也将针对个别案例公开发布。

数据统计

作者统计了两个数据集的详细情况,即目前最广泛的多语言医学语料库MMedC和新的多语言医学基准MMedBench。

如图2所示,MMedC是一个包含超过255亿tokens的多语言医学语料库,主要来自四个来源:从大型多语言语料库中过滤的医学内容、医学教科书、医学网站以及现有的小规模语料库。语料库涵盖六种语言,英语占比42%,俄语最少,仅占7%,但即使最小份额也相当于约20亿tokens。

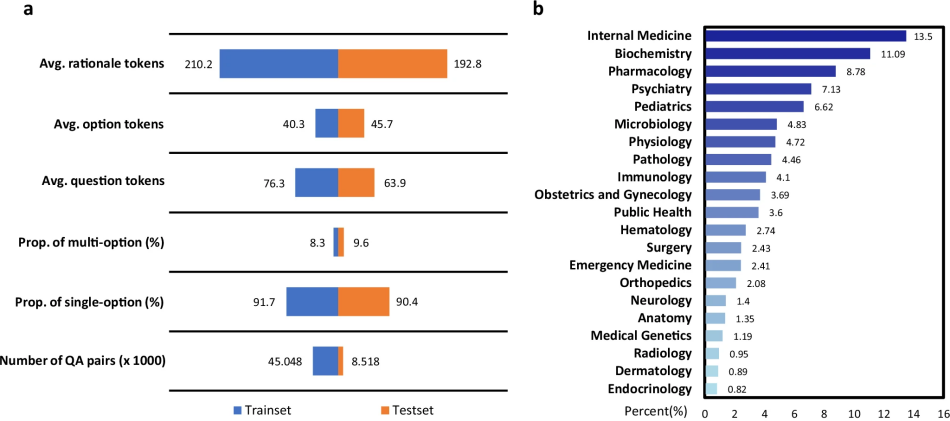

为了更好地评估多语言医学模型,作者还提出了MMedBench,一个多语言医学问答基准。该基准包含训练和测试用例的数量、答案选项分布,以及问答对的平均长度。如图3a所示,MMedBench包含许多带有多选答案的问题,答案部分平均有200个标记,用于训练模型生成和理解复杂的推理内容。

作者利用GPT-4将每个问题分类为21个医学主题,如内科、生物化学、药理学、精神病学、微生物学等,并由至少两位临床医生验证其准确性,确保涵盖医学领域的广度。图3b展示了MMedBench从基础临床医学到药理学和公共卫生等专业领域的医学问题,尤其侧重于内科和生物化学。这表明该基准在评估模型处理广泛医学问题的能力方面非常有效。

MMedBench评估

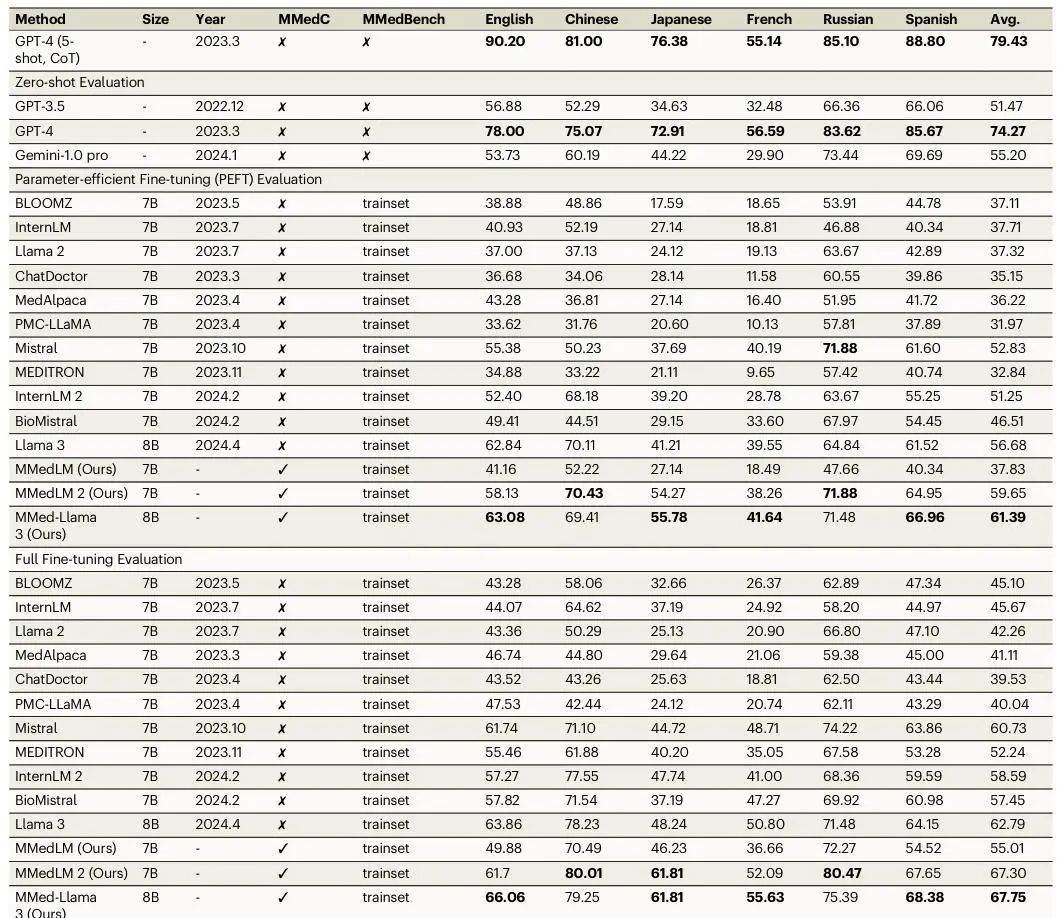

作者使用MMedBench对主要的LLMs进行了全面评估,包括零样本、参数高效微调(PEFT)和全量微调。评估侧重于多项选择题的准确性和生成推理的能力。模型分为四类:闭源LLMs、流行的开源LLMs、医学专用开源LLMs,以及在MMedC上进一步训练的模型。

首先,作者评估了GPT-3.5、GPT-4和Gemini-1.0 pro等闭源模型,它们仅在零样本设置下测试。由于训练数据不公开,难以判断其是否真正"零样本"。接着,作者评估了开源模型如Mistral、InternLM 2和Llama 3,发现它们在零样本设置下表现较差,故在微调设置下进行对比。最后,作者测试了在MMedC上进一步训练的模型,包括MMedLM、MMedLM 2和MMed-Llama 3,这些模型通过自回归训练,提升了医学领域的知识。

在多语言多项选择问答任务中,医学专用LLMs在英语中表现较好,但在其他语言中的表现显著下降。微调后的开源模型逐步缩小了与GPT系列的差距,如Mistral、InternLM 2和Llama 3在MMedBench上的平均准确率分别为60.73、58.59和62.79。进一步在MMedC上训练后,MMed-Llama 3表现出显著提升,如在全量微调中,MMed-Llama 3的准确率达到67.75,高于未训练版本的62.79。

除了多项选择问答任务,作者还评估了各模型的推理能力,使用BLEU、ROUGE等自动化指标以及BERT-score进行评价,并结合人工评分。作者随机选取测试集中的50个样本,由5位医学研究生对生成结果进行评分,评价标准包括准确性、推理能力和专业知识,同时使用GPT-4作为辅助评估者。图4a显示,MMed-Llama 3在人工评分(4.10)和GPT-4评分(4.73)中均得分最高。

作者还分析了自动化指标与人工评分的相关性,结果表明GPT-4的评分与人工评分的相关性最高,但不易推广到新模型评估。在自动化指标中,BERT-score表现最为可靠,因此建议在未来研究中使用BERT-score作为推理能力评估的基准。

英文基准评估

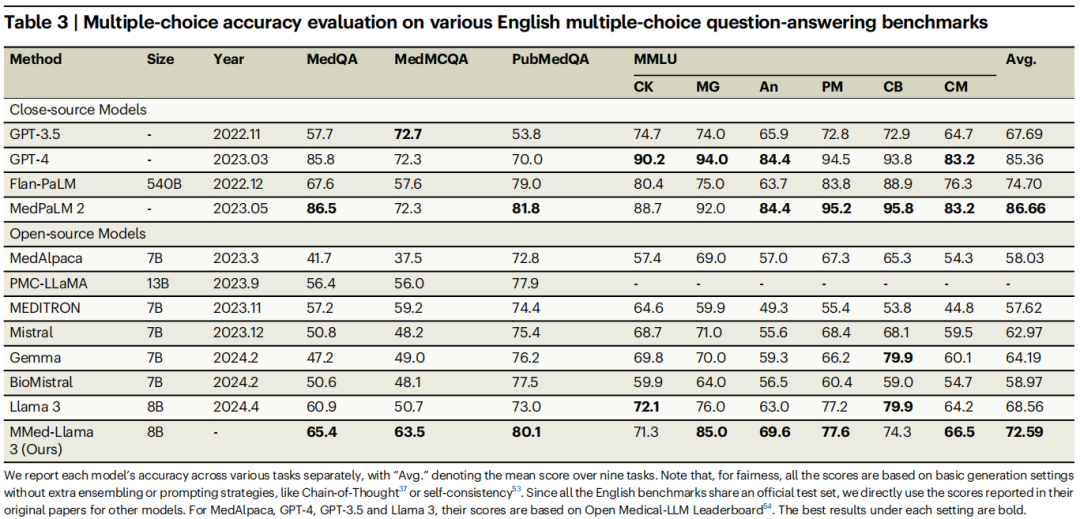

作者在MMed-Llama 3的微调中加入了额外的英文指令,并与其他LLMs在英文基准上进行了对比。评估基准包括MedQA、MedMCQA、PubMedQA和MMLU-Medical。MedQA和MedMCQA主要测试诊断和治疗能力,PubMedQA侧重于生物医学学术问答,MMLU-Medical则评估基本医学知识。

如表所示,MMed-Llama 3在这些基准上表现出色,在MedQA、MedMCQA和PubMedQA上分别提升了4.5%、4.3%和2.2%。在MMLU上,该模型的表现也优于大部分开源LLMs,显著超越GPT-3.5,得分72.59对比67.69。

数据组成的消融研究

作者对MMedLM、MMedLM 2和MMed-Llama 3在全量微调下的数据组成进行了分析,使用InternLM等模型作为基础。总体结果一致,以下讨论重点在MMed-Llama 3。

作者区分了高质量数据(HQ-Data)和未指定来源数据(US-Data)。HQ-Data来自经过人工验证的书籍和网站内容,US-Data则是从通用语料库中筛选的医学内容。结果表明,添加全面的推理数据使模型多选题的准确率平均提高了4.06个百分点,从58.72上升到62.79。然而,仅在英语数据上进行自回归训练没有显著提升,可能是因为英语过拟合,导致其他语言表现下降。扩展到整个多语言医学语料库后,模型表现显著改善,准确率提升到64.40,推理能力在BLEU-1和ROUGE-1上分别提高0.48和0.54。此外,加入自动收集的US-Data后,准确率进一步提升到67.75,推理能力也有所提升。

讨 论

作者的研究表明,基于MMedC的自回归训练能显著提升模型性能,尤其在多语言医学背景下。高质量、多样化的数据源能提高模型表现,而在MMedBench上结合推理数据微调也提高了问答准确率。此外,强大的LLM基础模型可提升最终结果,说明未来应更注重构建医学开源数据集。该研究推动了多语言医学LLM的发展,有助于实现更广泛的医学人工智能应用、提升跨语言检索生成能力,并在临床上缓解语言障碍、文化差异等问题。然而,数据偏见、解释性不足及语言覆盖有限仍是面临的挑战,未来需要进一步改进。

参考链接:

Qiu P, Wu C, Zhang X, et al. Towards building multilingual language model for medicine[J]. Nature Communications, 2024, 15(1): 8384.