1. RAG概念

RAG(Retrieval-Augmented Generation)即检索增强生成,是一种结合信息检索与大型语言模型(大模型)的技术。从外部知识库(如文档、数据库或网页)中实时检索相关信息,并将其作为输入提供给 大模型,从而增强模型生成答案的能力,具体是指在大模型生成回答之前,先从知识库中查找相关的知识内容,增强信息生成过程中的知识库中的内容,从而提升生成的质量和准确性,这一过程分为三个阶段:

检索 :使用向量数据库和近似最近邻(ANN)算法快速定位与查询相关的文本片段。

融合 :将检索到的信息处理后与原始查询结合,形成扩展的上下文。

生成:大模型 基于融合后的上下文生成最终答案,减少"幻觉"现象。

2. RAGFlow 部署

RAGFlow是一个基于深度文档理解的开源RAG引擎。它为任何规模的企业提供了一个简化的RAG工作流程,结合LLM(大型语言模型)提供真实的问答功能,并得到各种复杂格式数据的充分引用。

2.1 源码加载

bash

# 网盘地址: https://pan.baidu.com/s/1m0nUnq5po4zpnIWPvU_obw?pwd=zhen

git clone git@github.com:infiniflow/ragflow.git

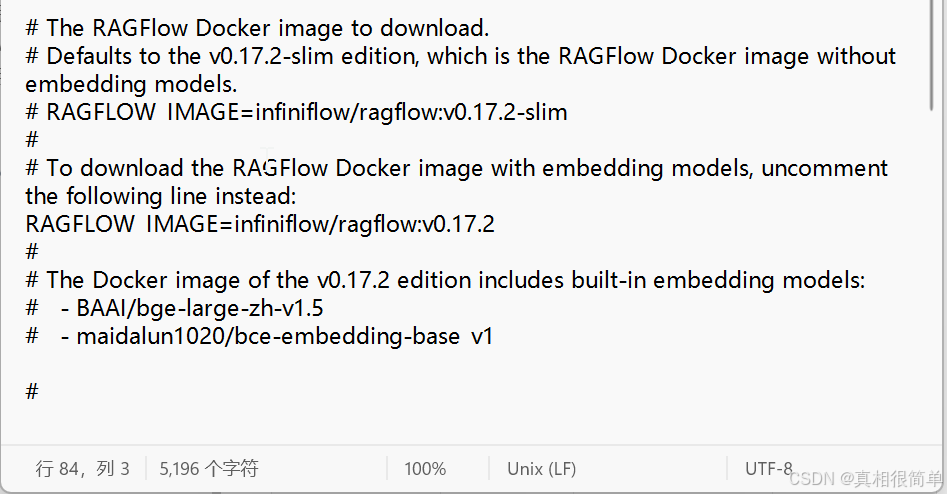

2.2 修改配置版本

bash

$ cd ragflow/docker

# 修改配置文件安装v0.17.2,默认是v0.17.2-slim

nano .env| RAGFlow 镜像标签 | 镜像大小 (GB) | 具备嵌入模型 | 是否稳定版 |

|---|---|---|---|

| v0.17.2 | ≈9 | ✔️ | 是 |

| v0.17.2-slim | ≈2 | ❌ | 是 |

| nightly | ≈9 | ✔️ | 否 |

| nightly-slim | ≈2 | ❌ | 否 |

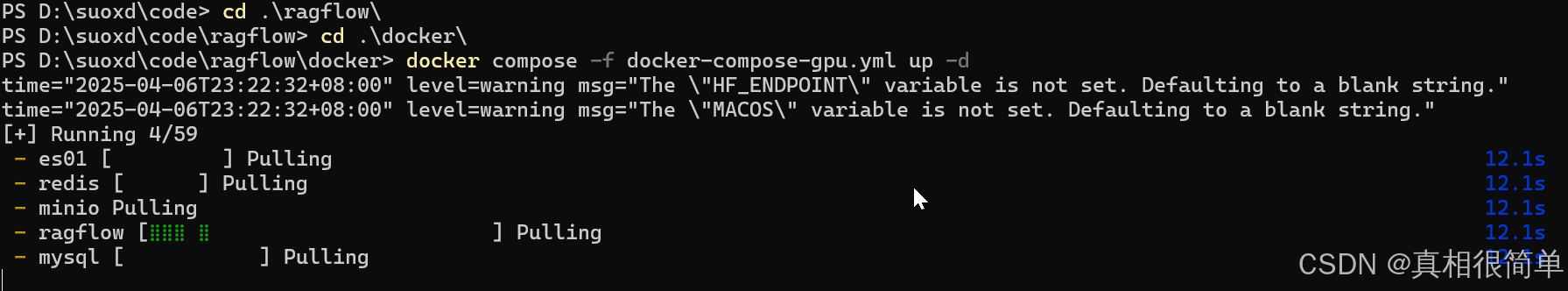

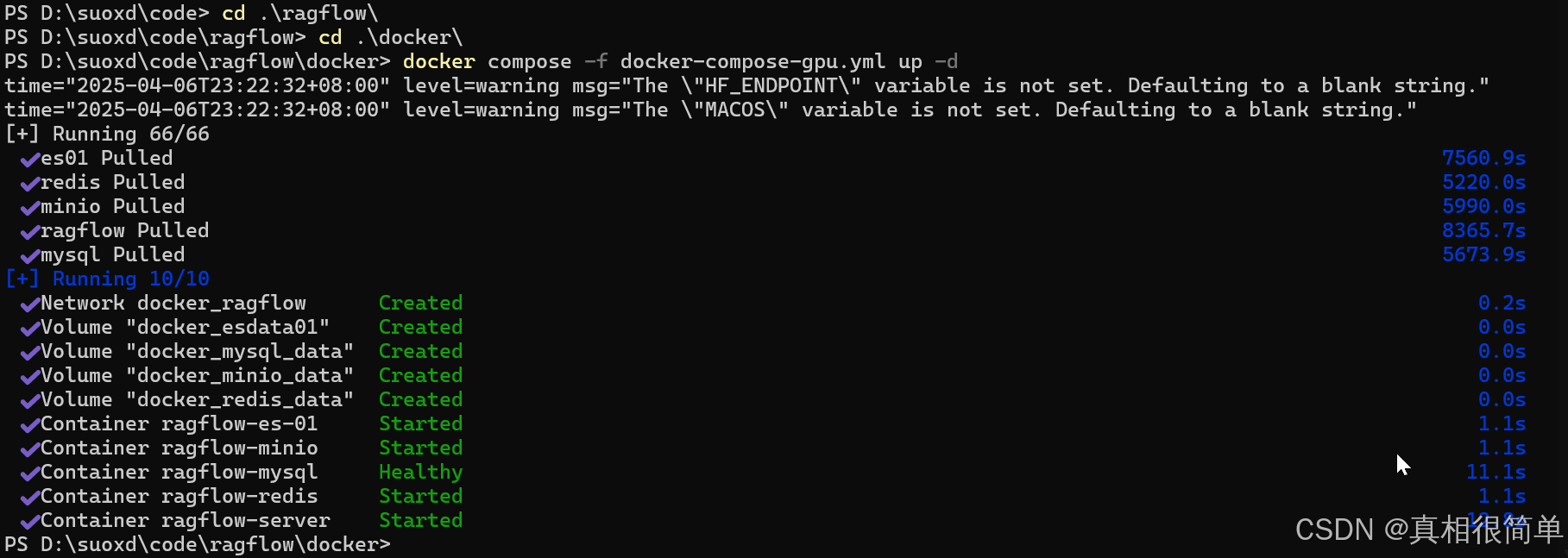

2.3 docker执行安装

bash

cd

# 仅使用CPU 执行任务:

# docker compose -f docker-compose.yml up -d

# 使用 GPU 加速:

docker compose -f docker-compose-gpu.yml up -d

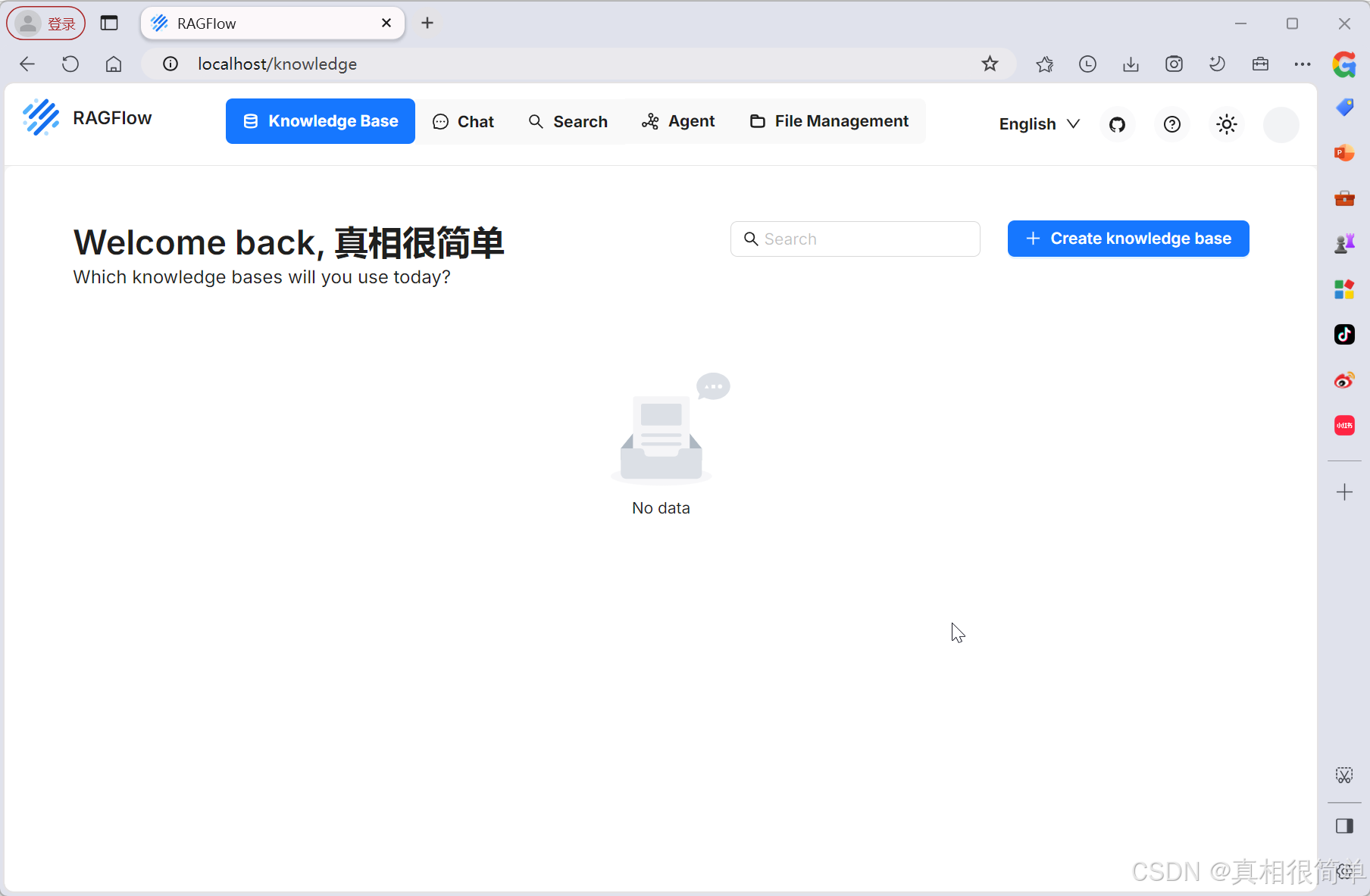

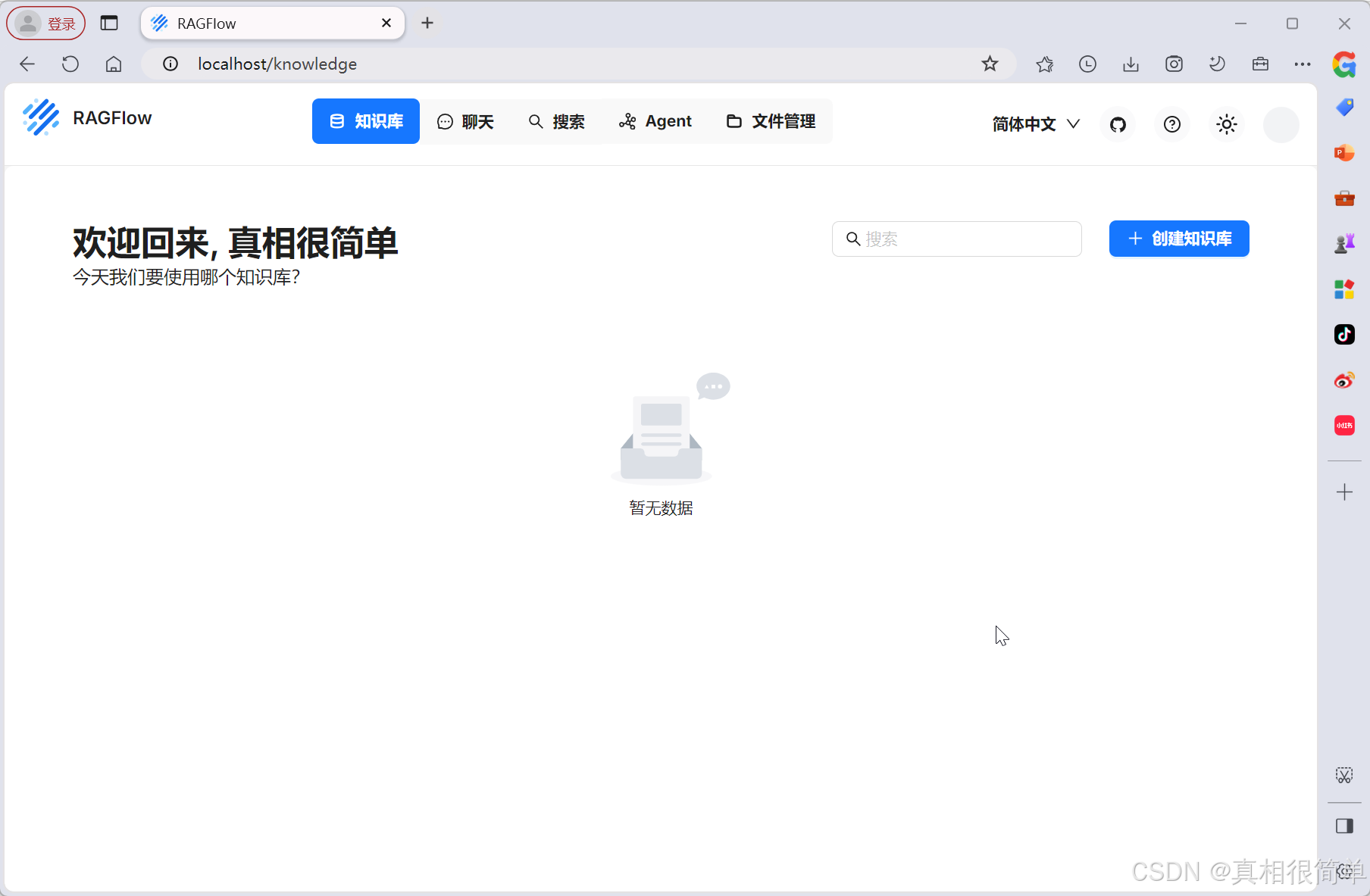

3. 运行效果

bash

http://localhost:80