- 黑马发布这套课程时间是6月,在其发布后不久,因互联网天然的快速更新属性,有一些地方发现了变化。

- 本文将总结黑马的这套课程的精华,同时指明发生变化后,要如何实现原效果。

- 课程我大致看了一下,讲的浅,但作为科普完全够了,想要揭开大模型神秘的面纱,对AI祛魅,那这套课,是必看不可了。

- 原本课程地址:LangChain4j从入门到实战项目全套视频课程,涵盖LangChain4j+ollama+RAG,Java传统项目AI智能化升级

有能力啃文档的可以看下面一手资料

官方文档:https://docs.langchain4j.dev

github : https://github.com/langchain4j/langchain4j

twitter : https://twitter.com/intent/follow?screen_name=langchain4j

- 课程学习前置要求

| 序号 | 阶段 | 需要掌握的技术栈 | 掌握程度 | 说明 |

|---|---|---|---|---|

| 1 | 必须掌握 | SpringBoot + MyBatis | 熟练 | 这是学习的基础,必须熟练掌握Spring Boot框架的使用和MyBatis的ORM映射 |

| 2 | 初步了解 | Docker + Redis + MySQL | 了解/熟悉 | 需要了解容器化部署、缓存技术和关系型数据库的基本使用 |

| 3 | 熟练使用 | IDEA + Maven | 熟练 | 需要熟练使用IntelliJ IDEA开发工具和Maven项目管理工具 |

博主粉丝群介绍: ① 群内初中生、高中生、本科生、研究生、博士生遍布,可互相学习,交流困惑。② 热榜top10的常客也在群里,也有数不清的万粉大佬,可以交流写作技巧,上榜经验,涨粉秘籍。③ 群内也有职场精英,大厂大佬,跨国企业主管,可交流技术、面试、找工作的经验。进群免费赠送写作秘籍一份,助你由写作小白晋升为创作大佬。进群赠送CSDN评论防封脚本,送真活跃粉丝,助你提升文章热度。群公告里还有全网大赛约稿汇总/博客提效工具集/CSDN自动化运营脚本 有兴趣的加文末联系方式,备注自己的CSDN昵称,拉你进群,互相学习共同进步。P1~P3要点

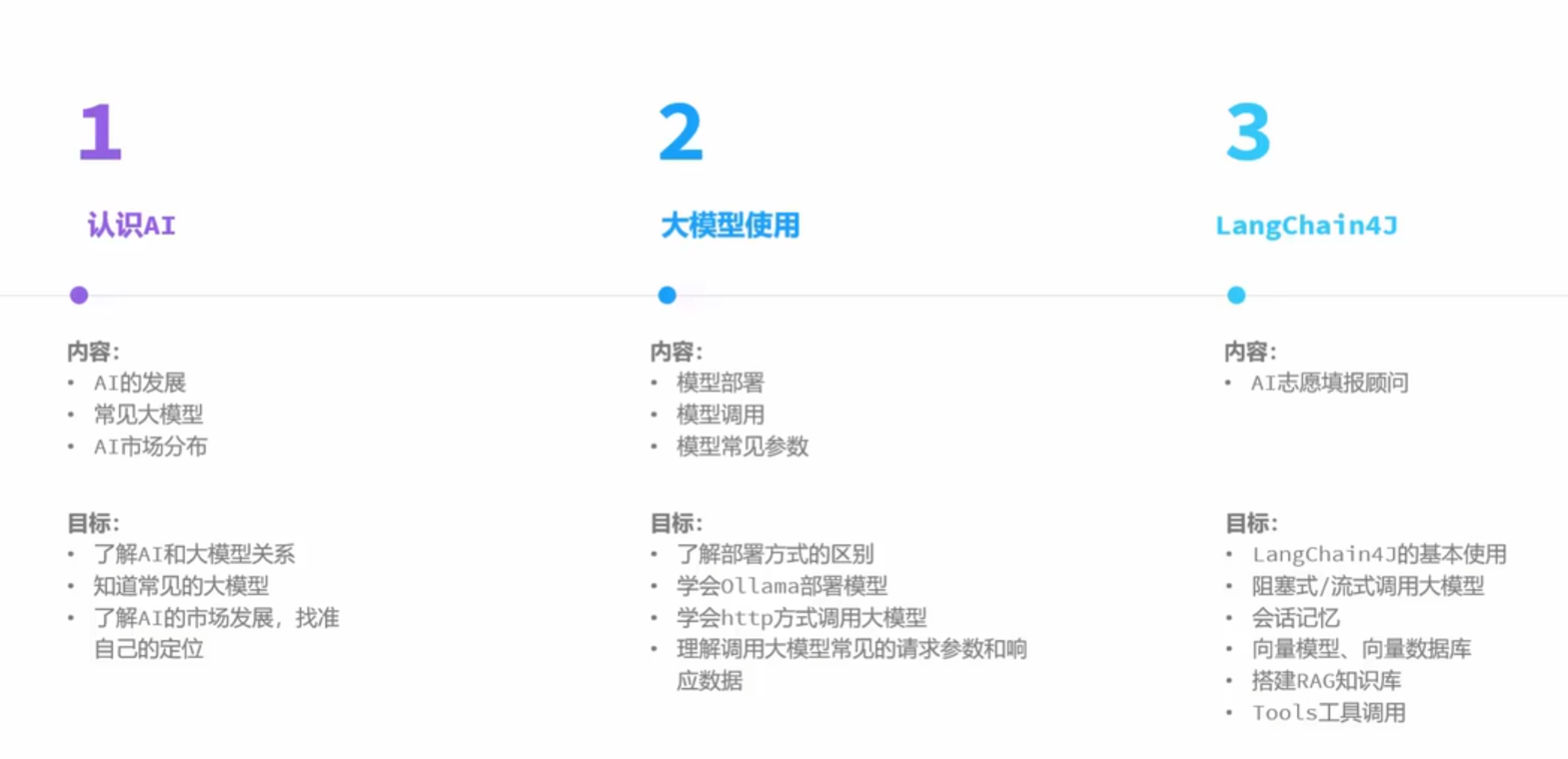

你能学到什么?

- AI发展史这块可以不看,直接看我的博客:一文读懂 AI

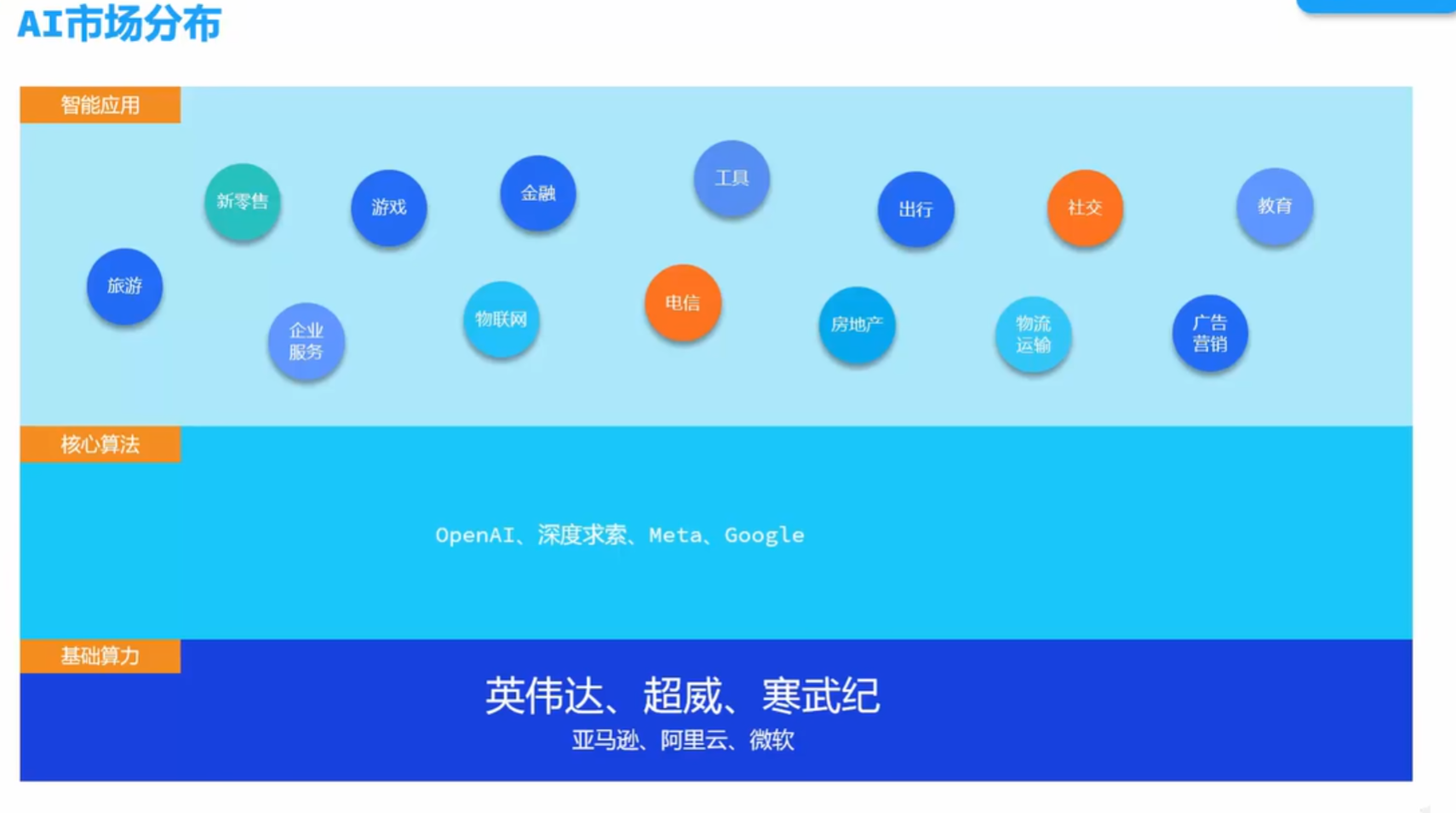

AI市场拆解

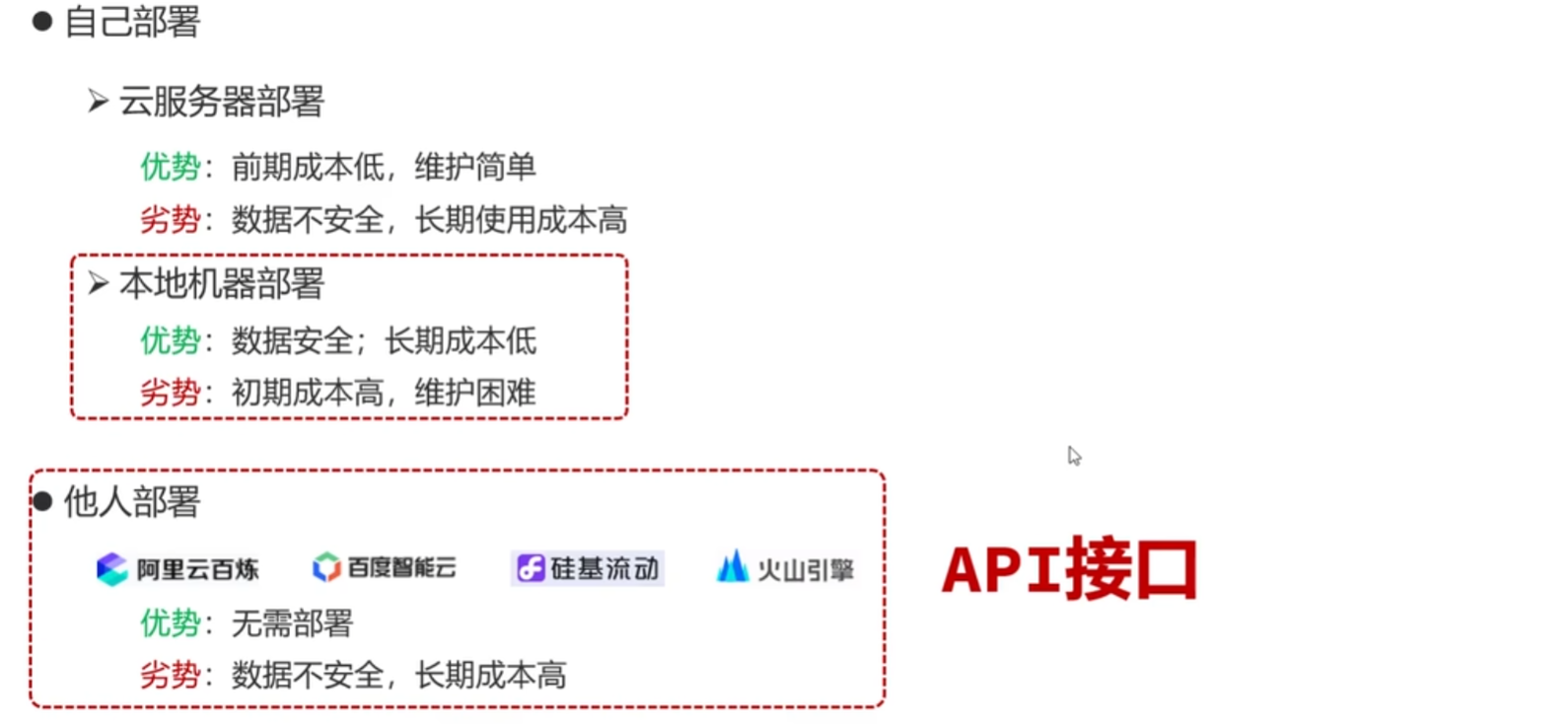

大语言模型实现方式

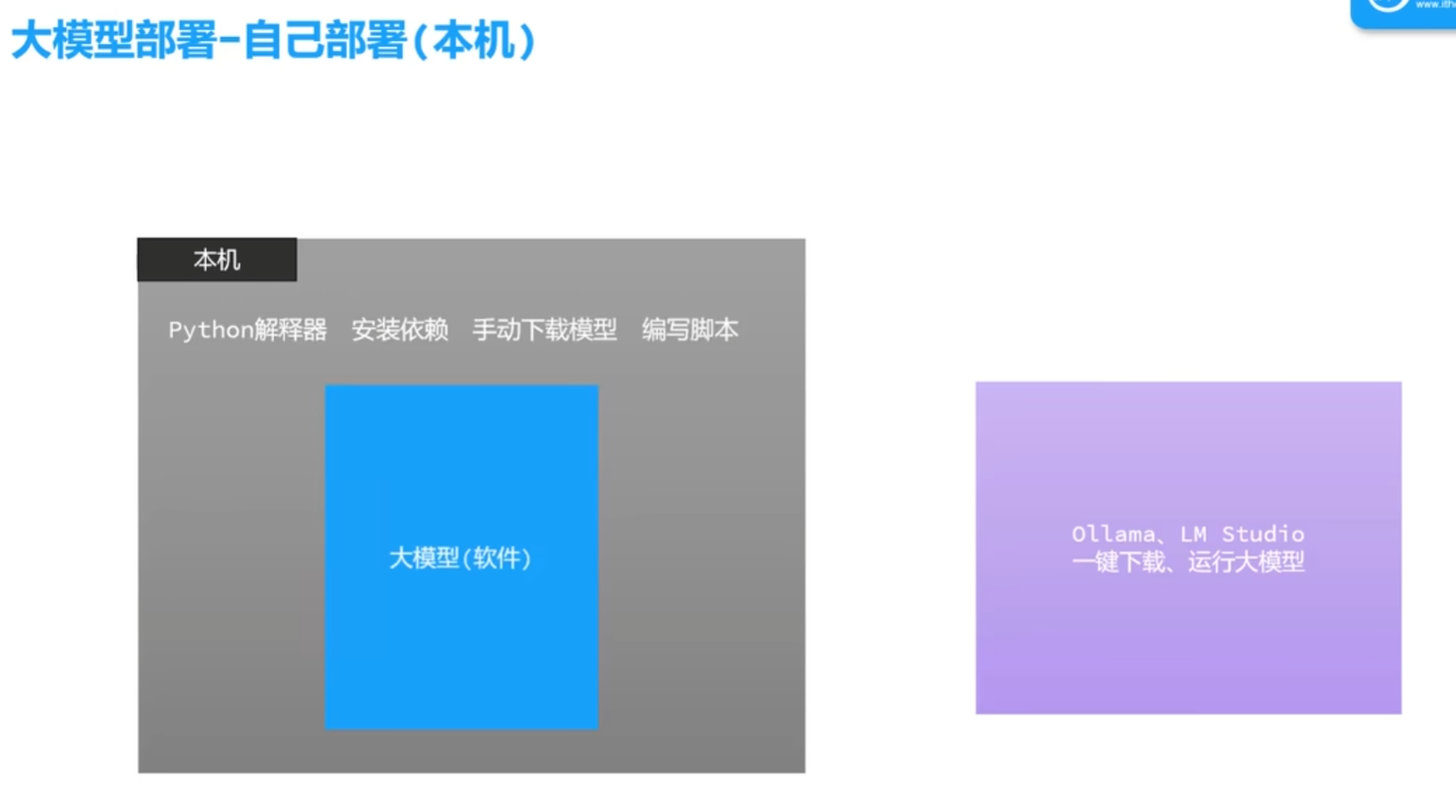

- 自己部署大模型有要下载不少依赖,而ollama提供了类似docker一样的环境。

部署Ollama

-

ollama run qwen3:0.6b

-

哪个平台的1b左右模型都是人工智障,而本课程居然使用0.6B的模型来做演示,看到这里,感觉这份课程更多偏向于科普。

-

不过太大的模型也无法在普通电脑上跑起来,可能也有这方面的考量

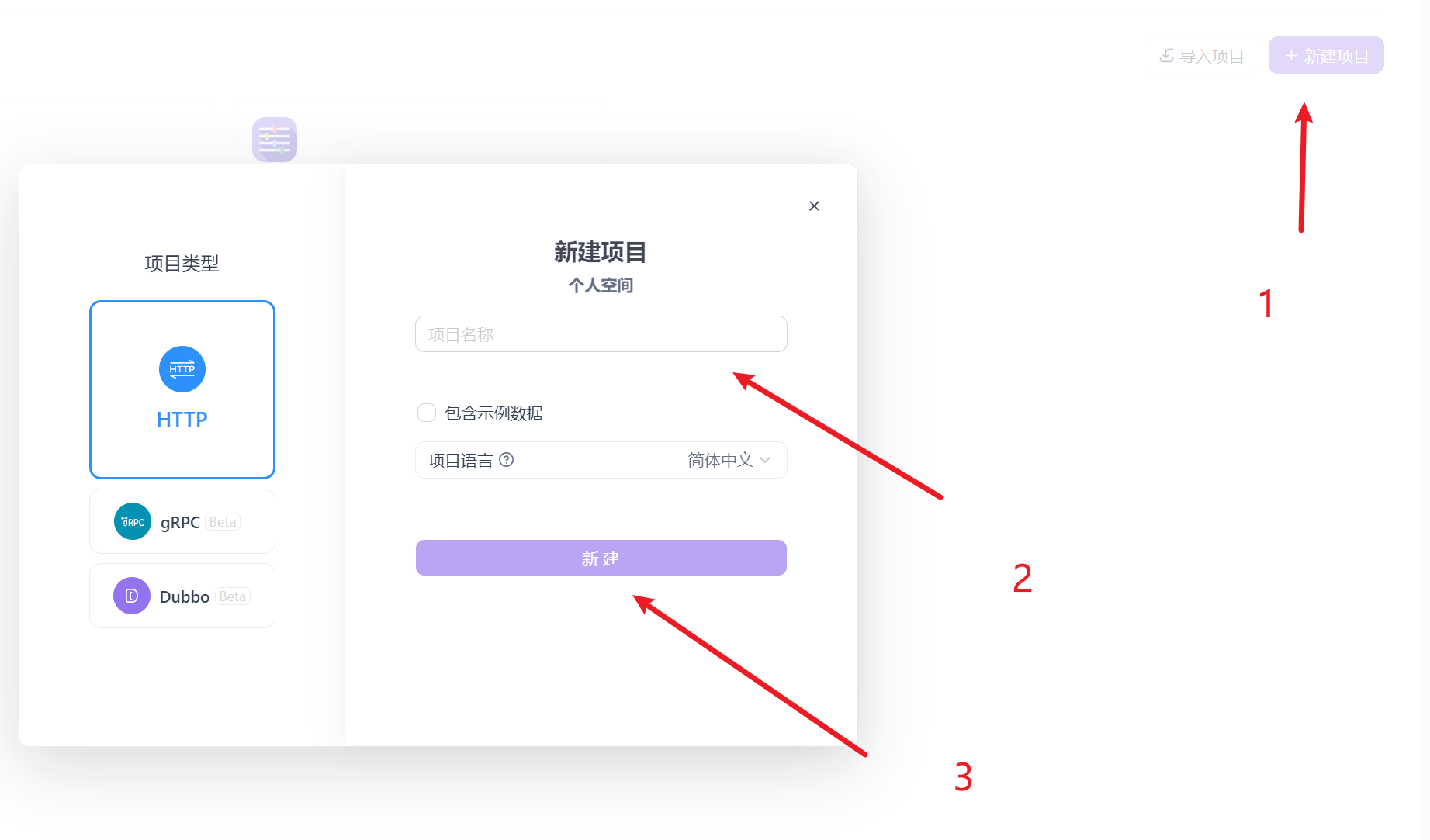

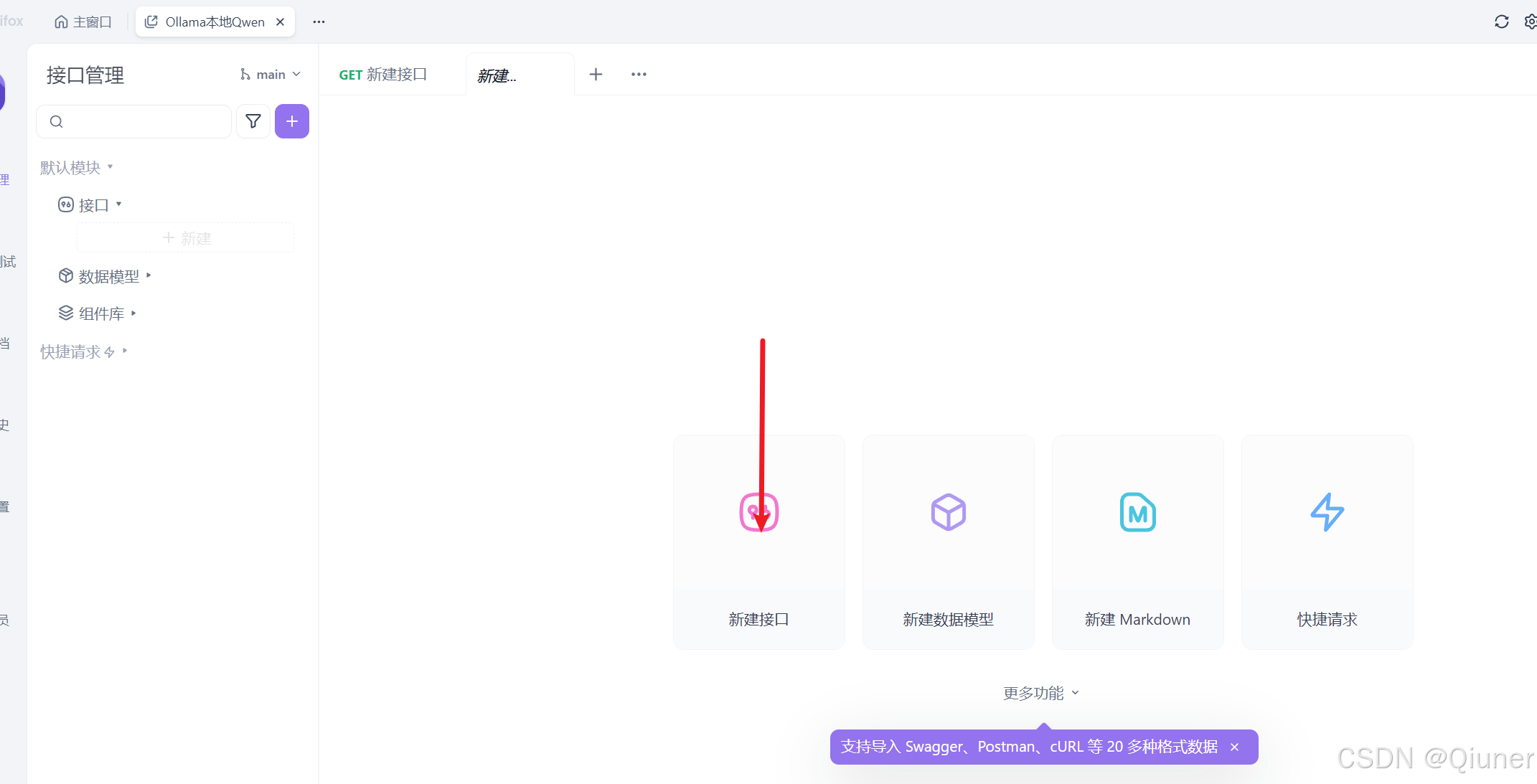

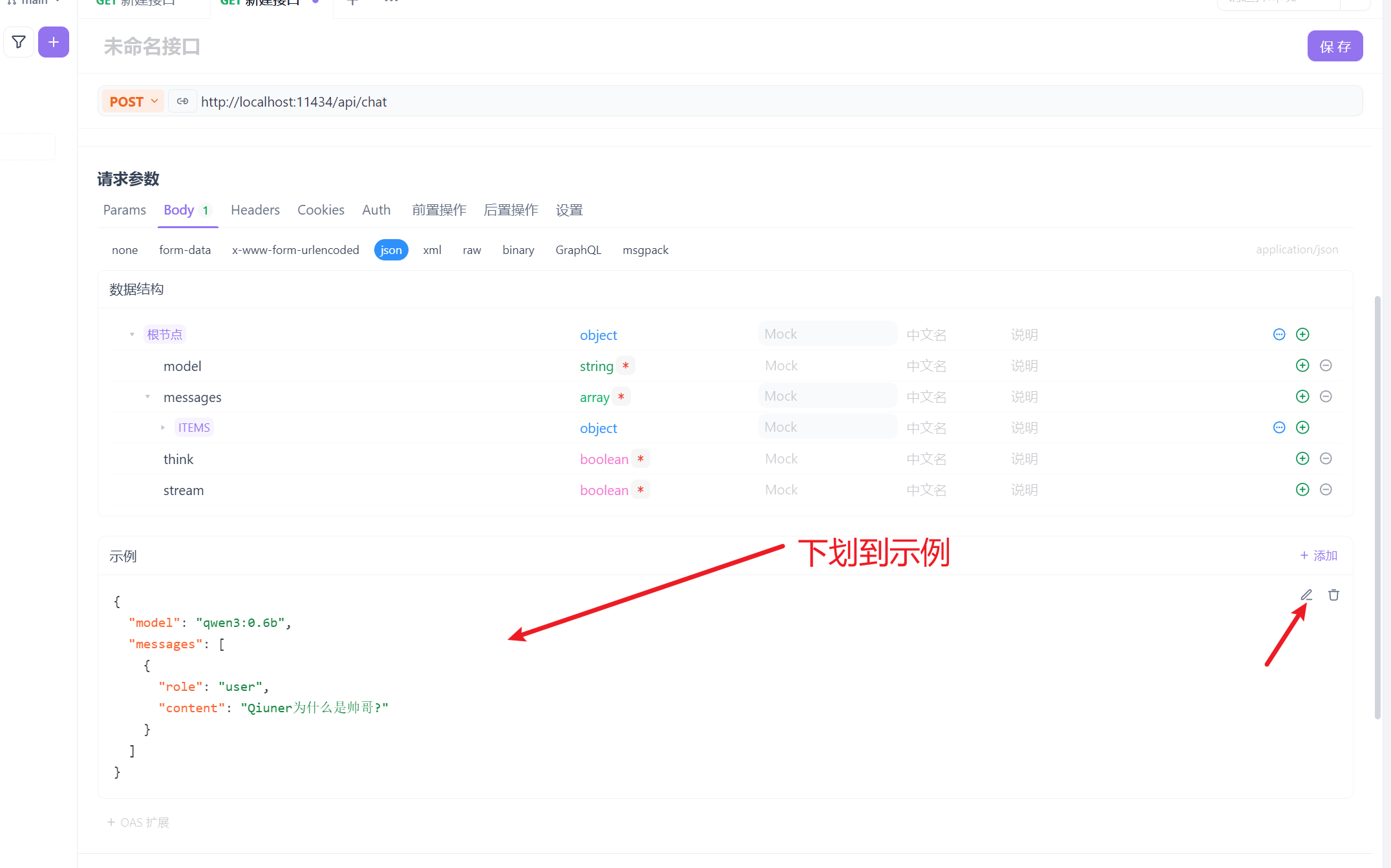

通过Aipfox向运行在ollama中的大模型发送请求

找到访问地址

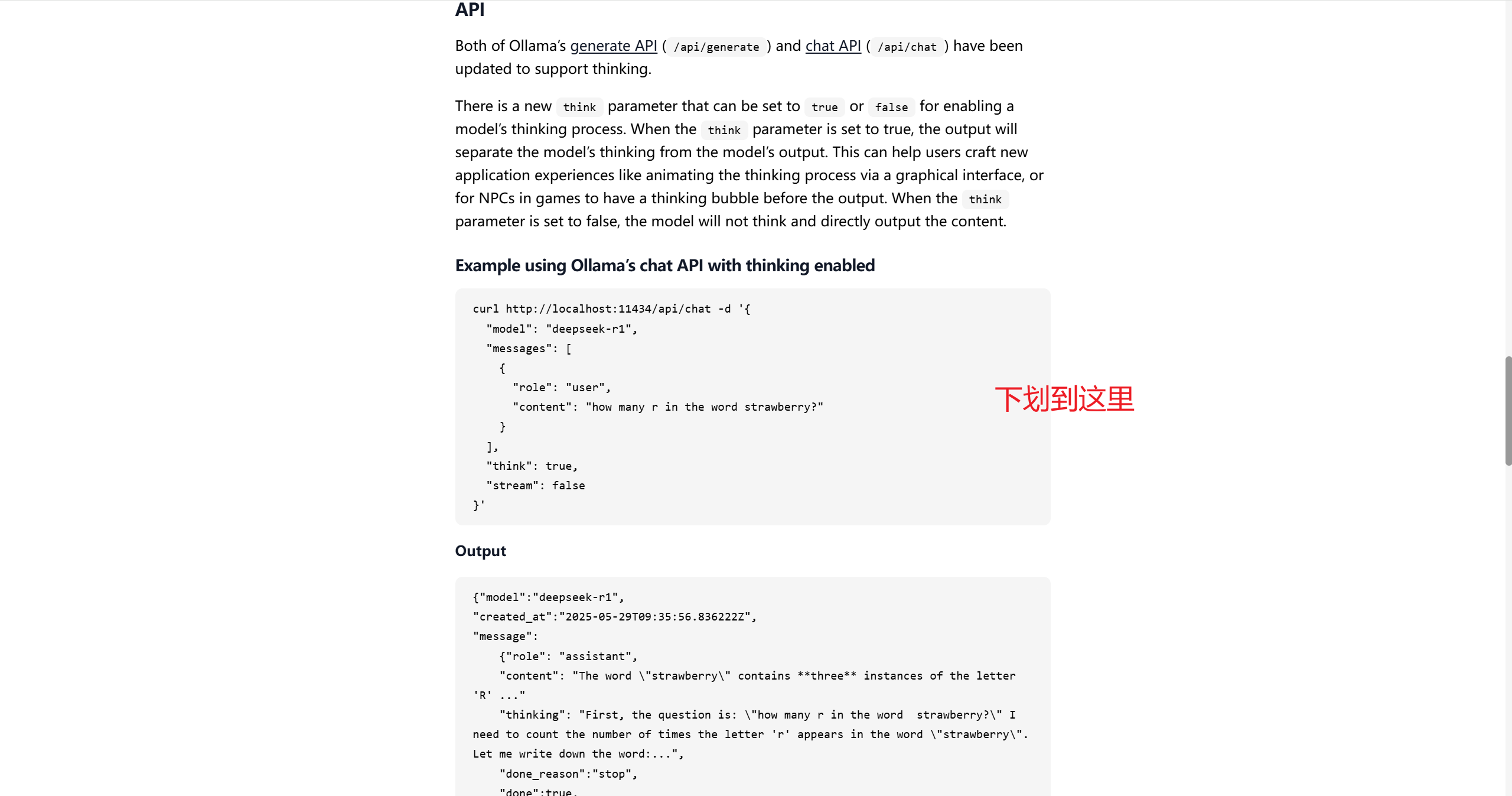

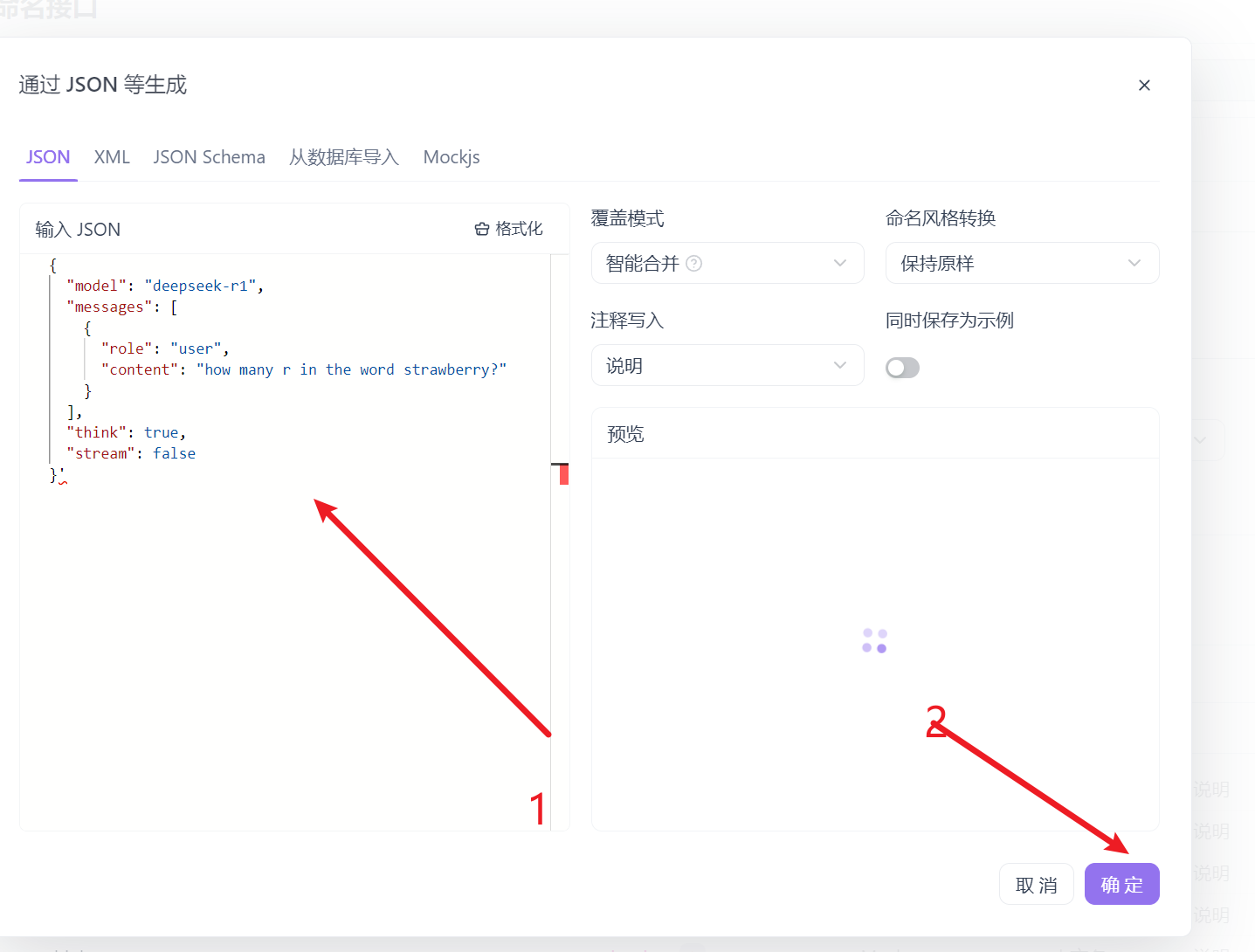

curl http://localhost:11434/api/chat -d '{

"model": "deepseek-r1",

"messages": [

{

"role": "user",

"content": "how many r in the word strawberry?"

}

],

"think": true,

"stream": false

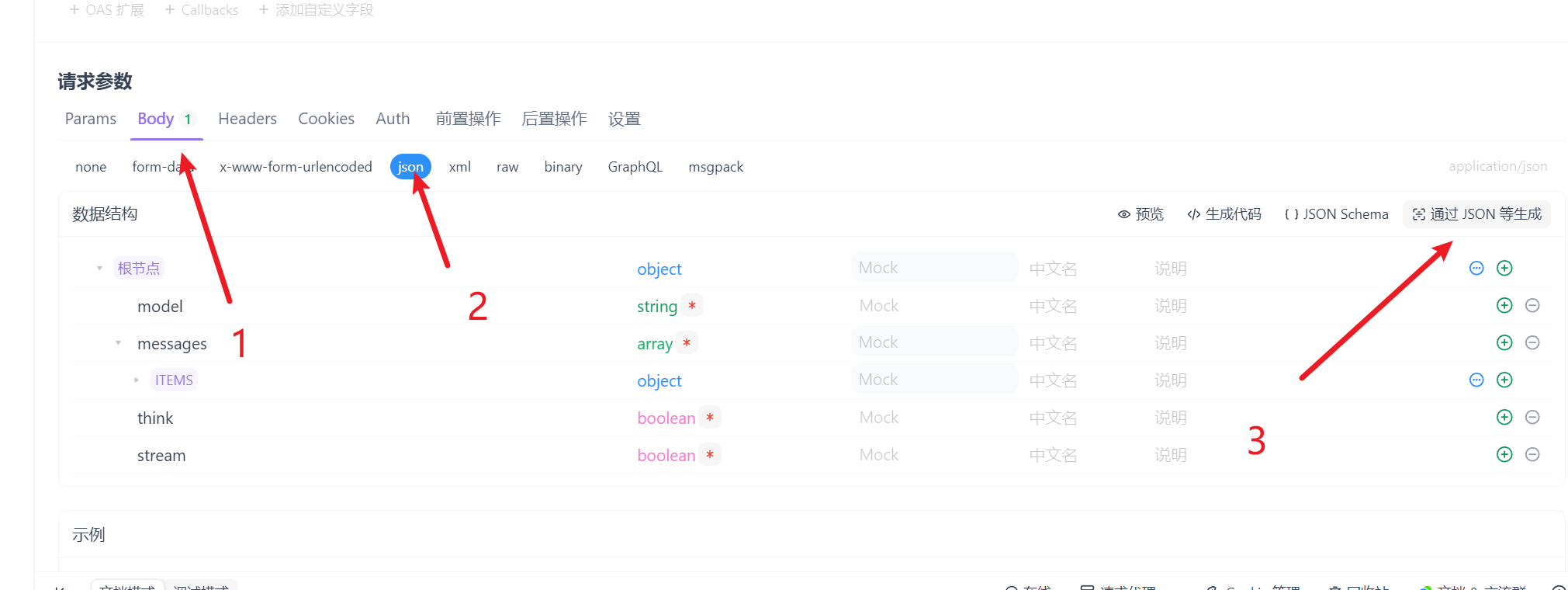

}'APifox使用

- 然后开始更改即可

我界面和黑马导师不一样阿??

方式一:

{

"model": "qwen3:0.6b",

"messages": [

{

"role": "user",

"content": "Qiuner为什么是帅哥?"

}

]

}

- 鼠标要悬浮到数据结构这一行才会显示

- 就可以了,不知道黑马导师使用的是什么风格,看着像postman,一开始使用按照我这个方式就能识别出相应数据

方式二:

{

"model": "qwen3:0.6b",

"messages": [

{

"role": "user",

"content": "Qiuner为什么是帅哥?"

}

]

}

P4要点

阿里云百炼

- 这里需要看一些协议来开通

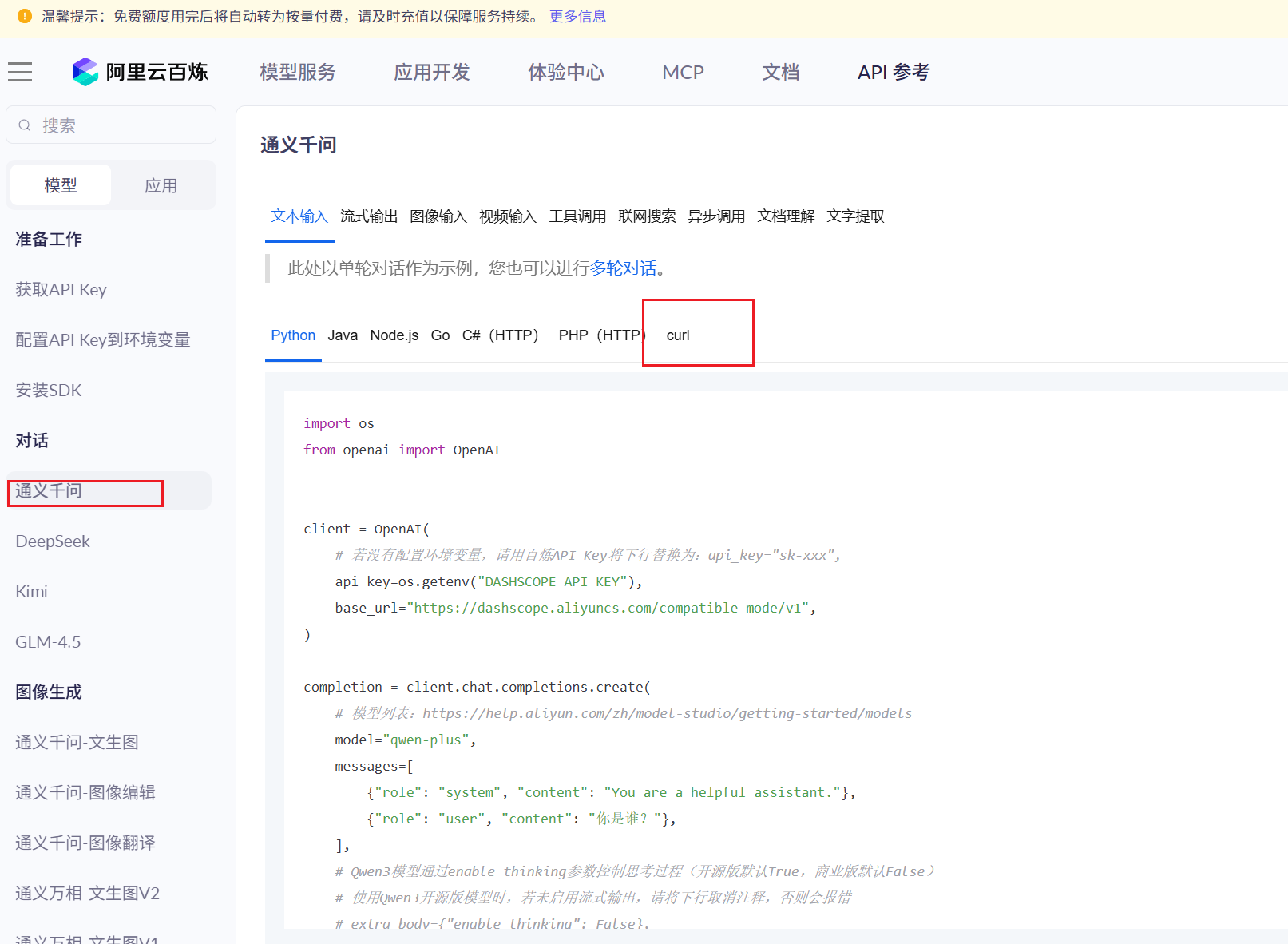

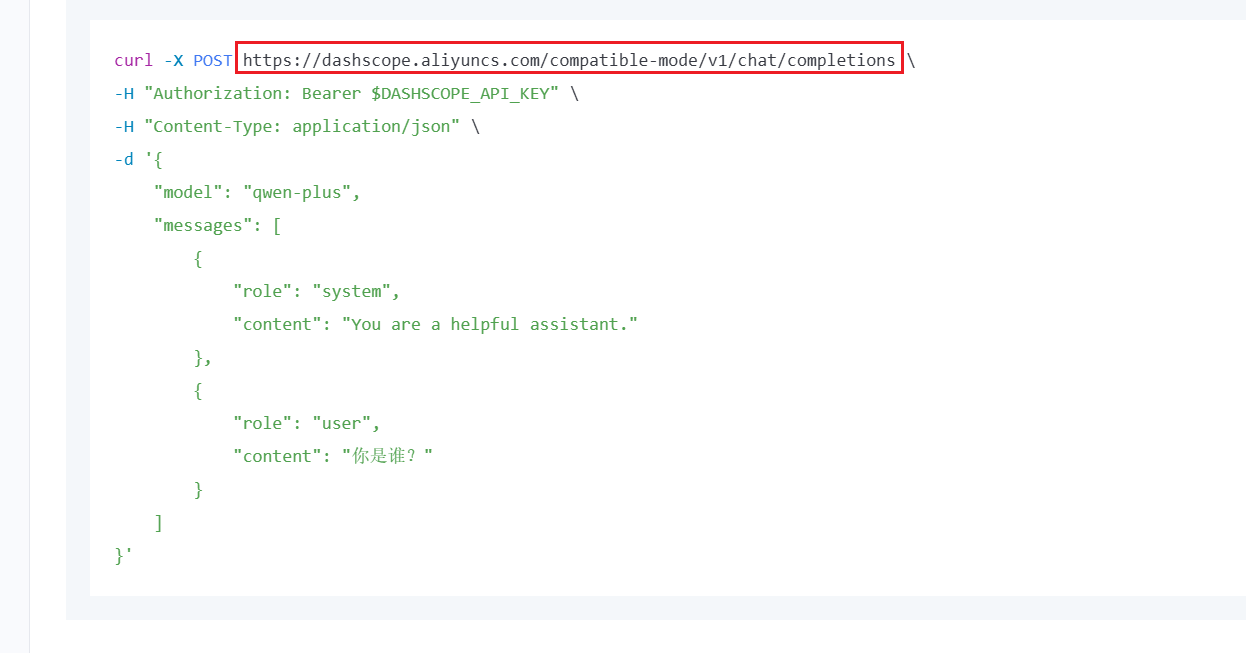

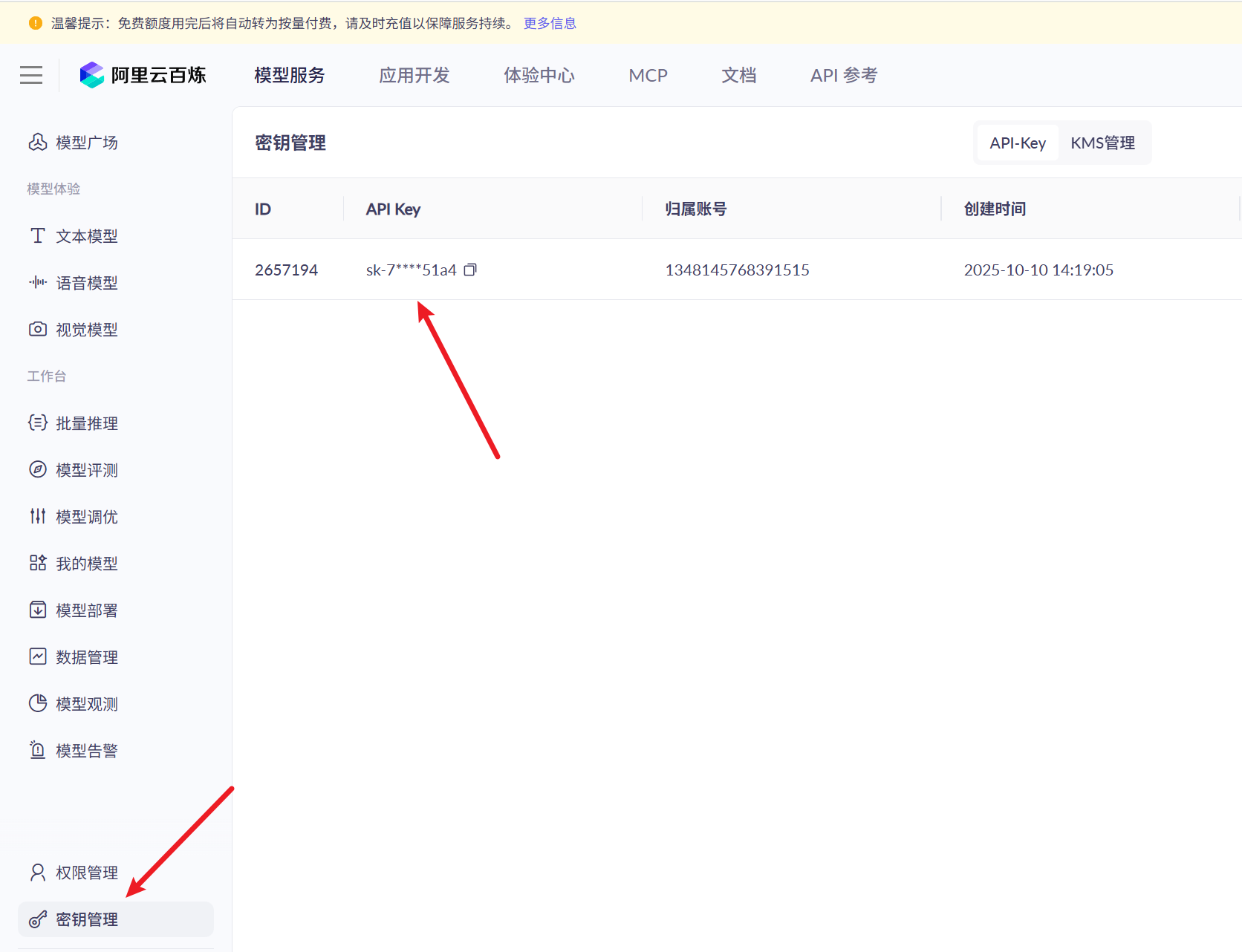

如何给阿里云百炼上的模型发请求?

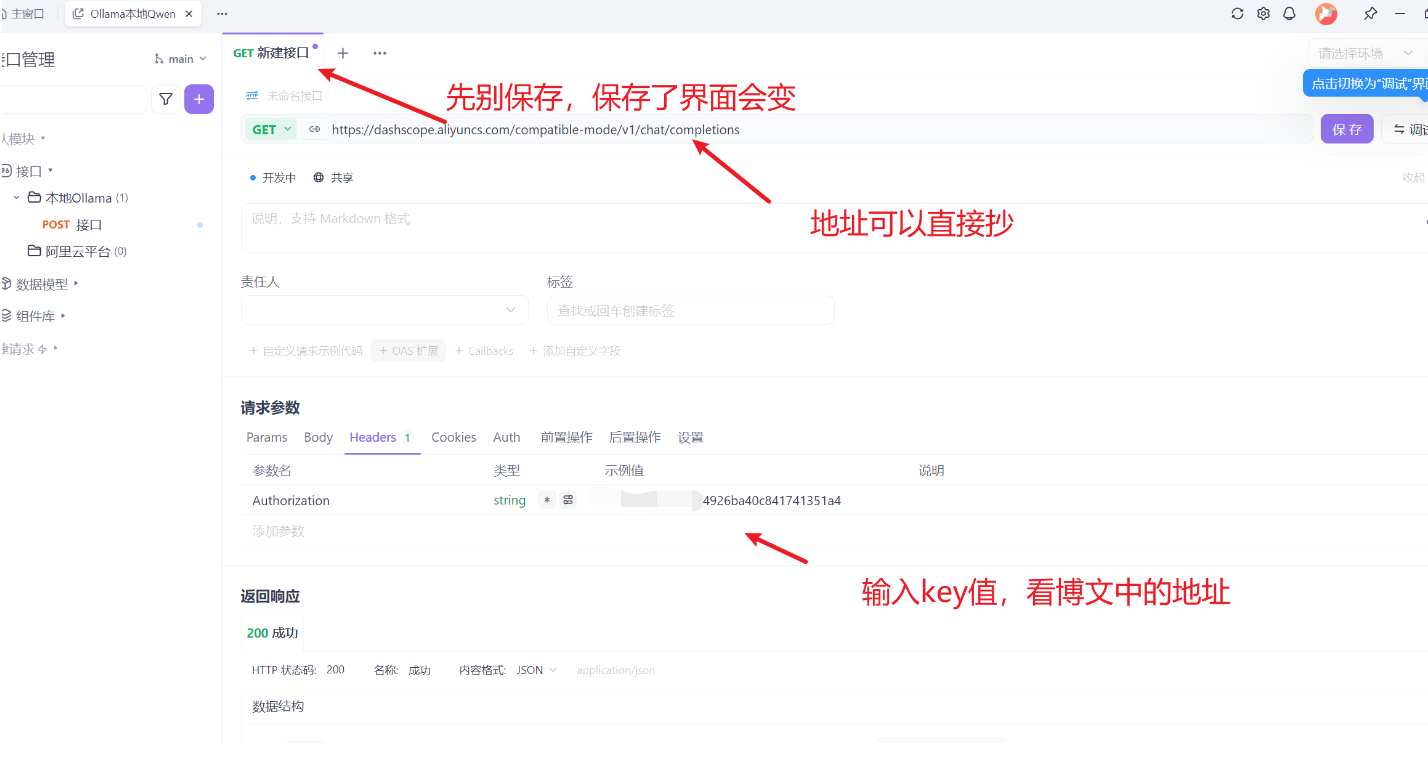

第一步:找到平台地址

第二步:在APifox中输入相关参数

输入网址

通义千问网址

https://dashscope.aliyuncs.com/compatible-mode/v1/chat/completions输入key

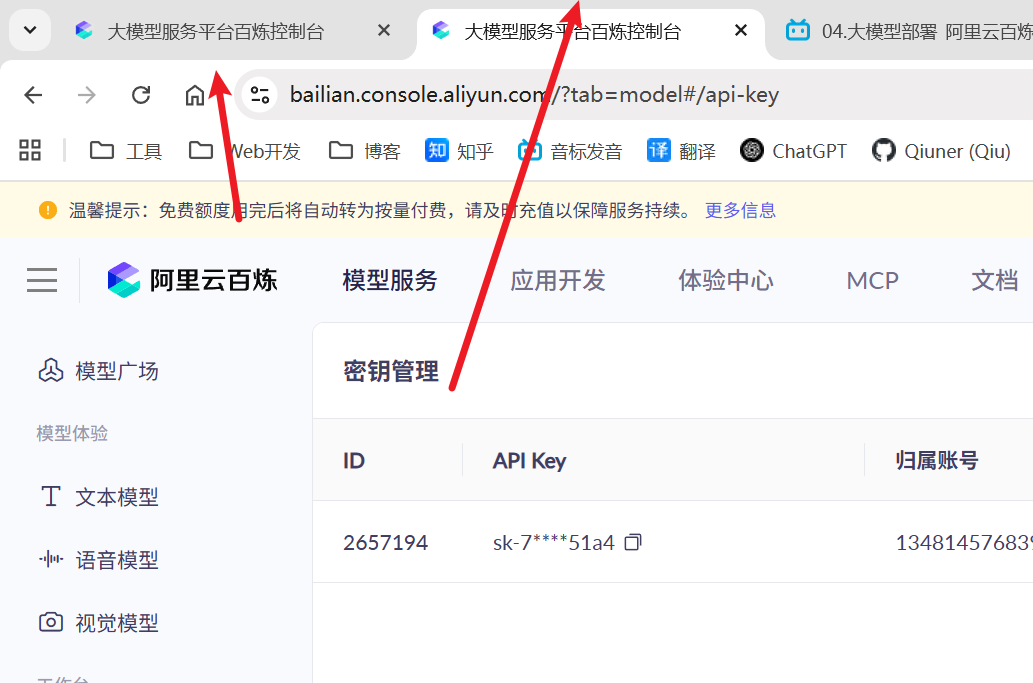

- 值得注意的是,api文档和百炼控制台不是在一个网址中,推荐开两个页面来交替使用

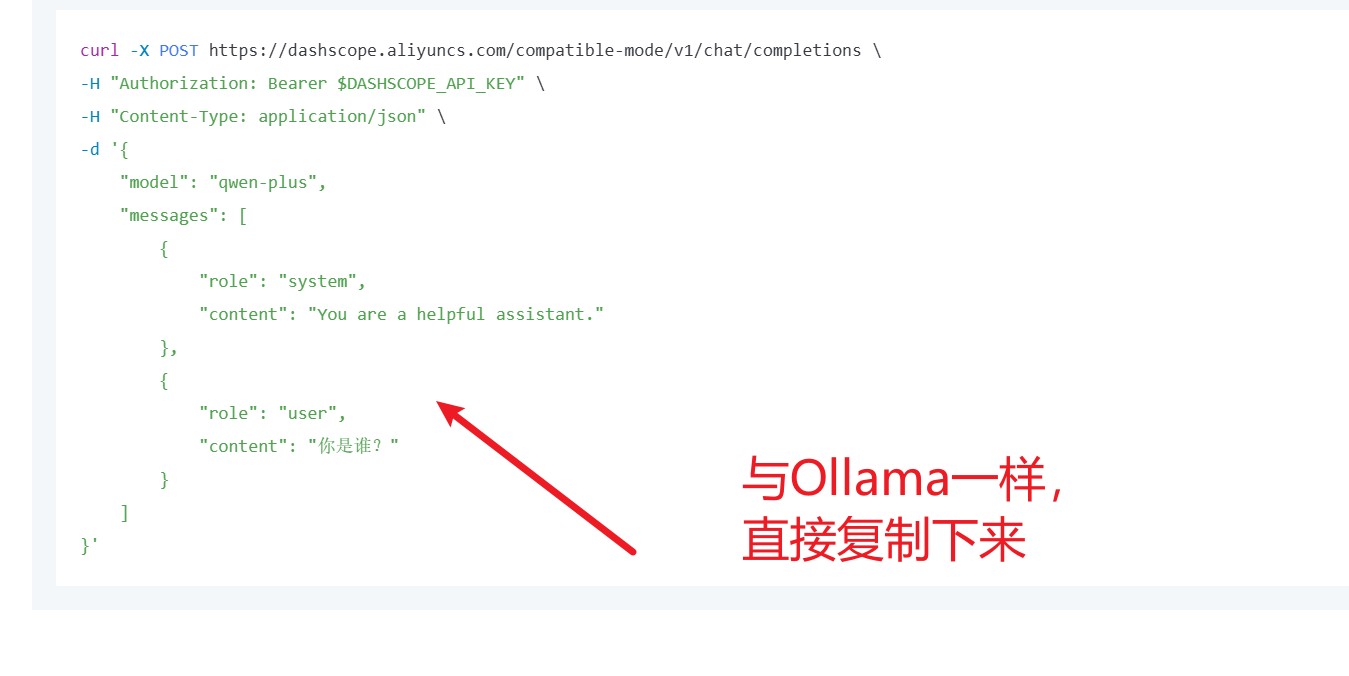

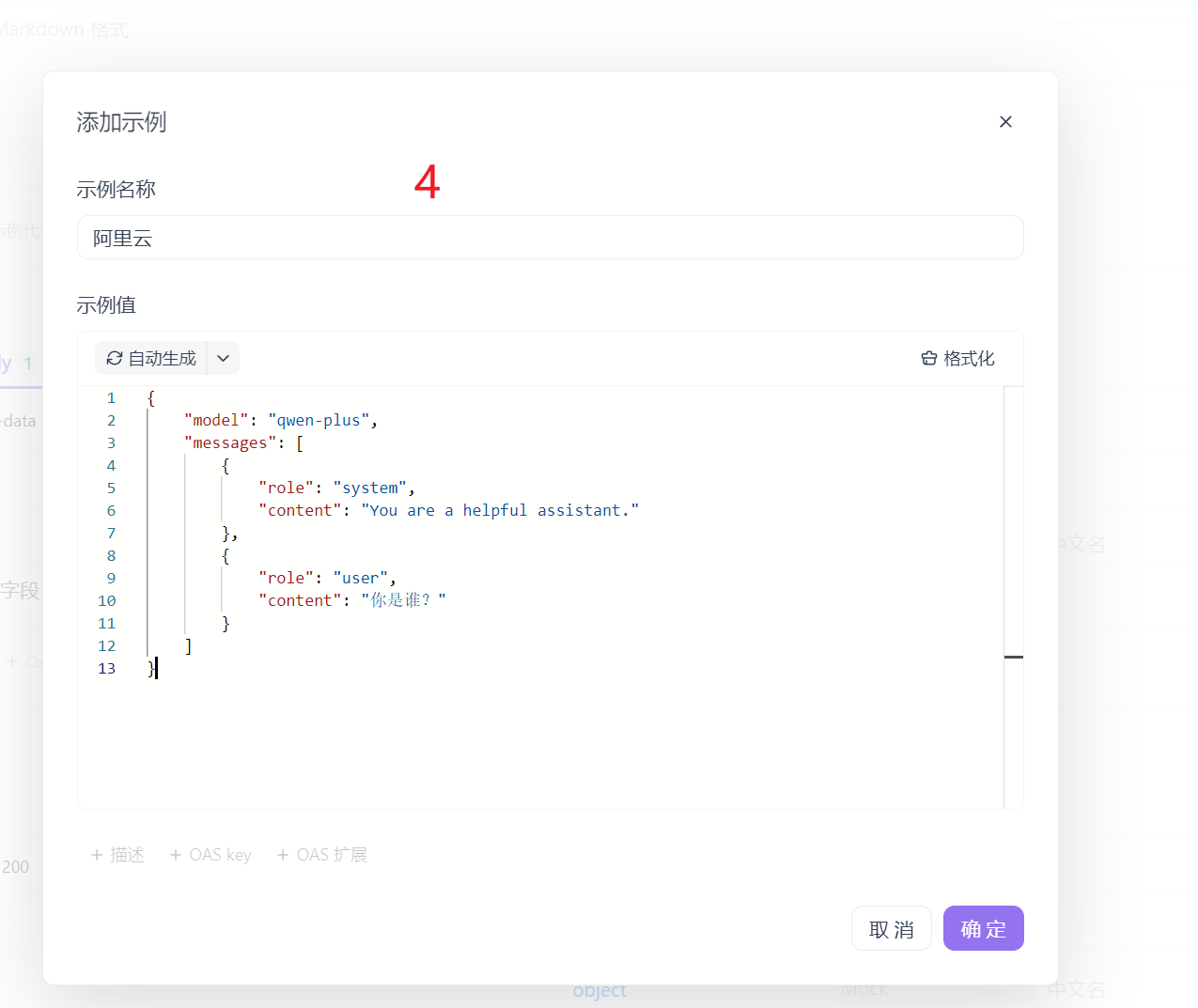

输入相关参数

{

"model": "qwen-plus",

"messages": [

{

"role": "system",

"content": "You are a helpful assistant."

},

{

"role": "user",

"content": "你是谁?"

}

]

}APifox界面发生了变化,根据下面操作来快一点

- 视频中将role 、content这两个参数所在删除,与ollama那里一样

- 接口请求方式记得调为post

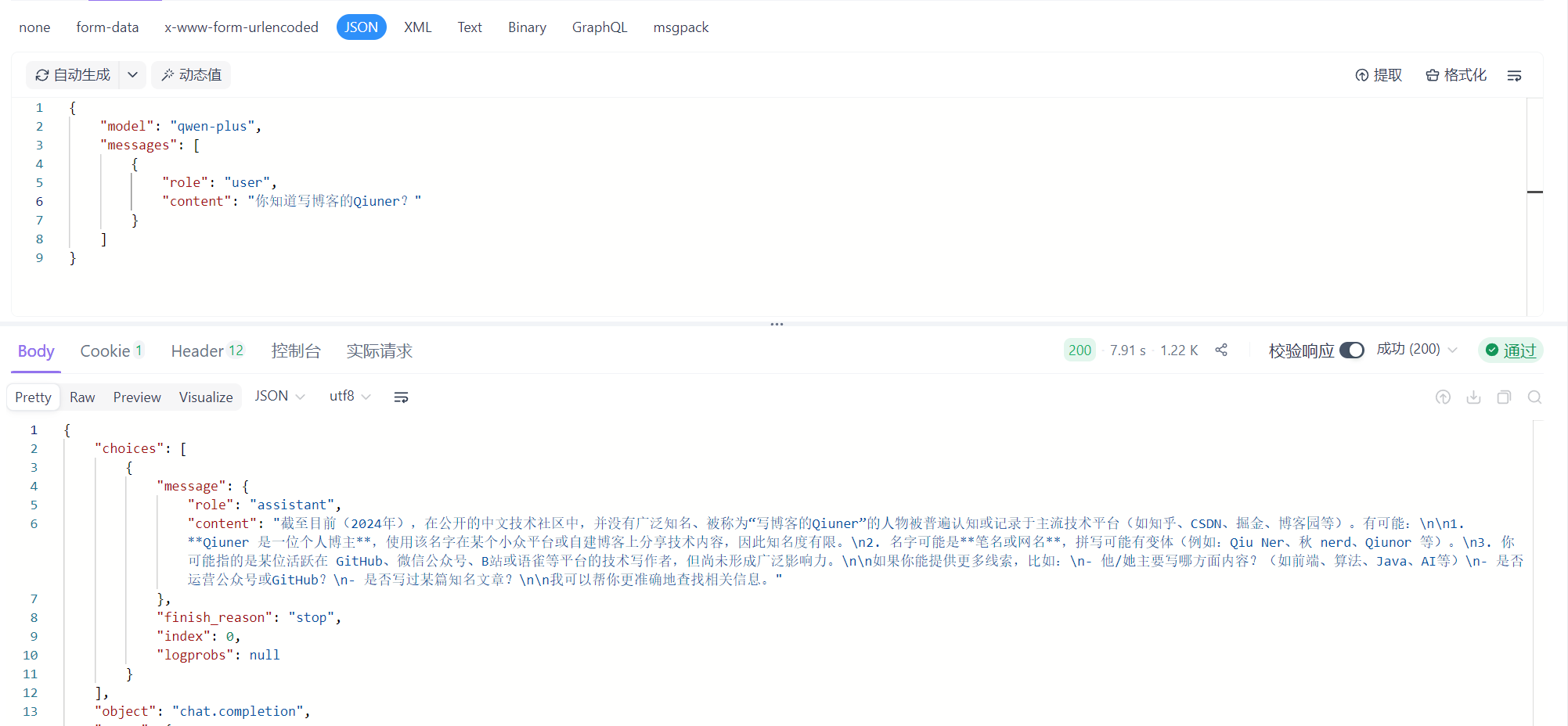

- 发送效果如图。不过我24年问gpt都能查到自己,现在问千问居然没查到,有点小失落

P5 大模型调用参数要点

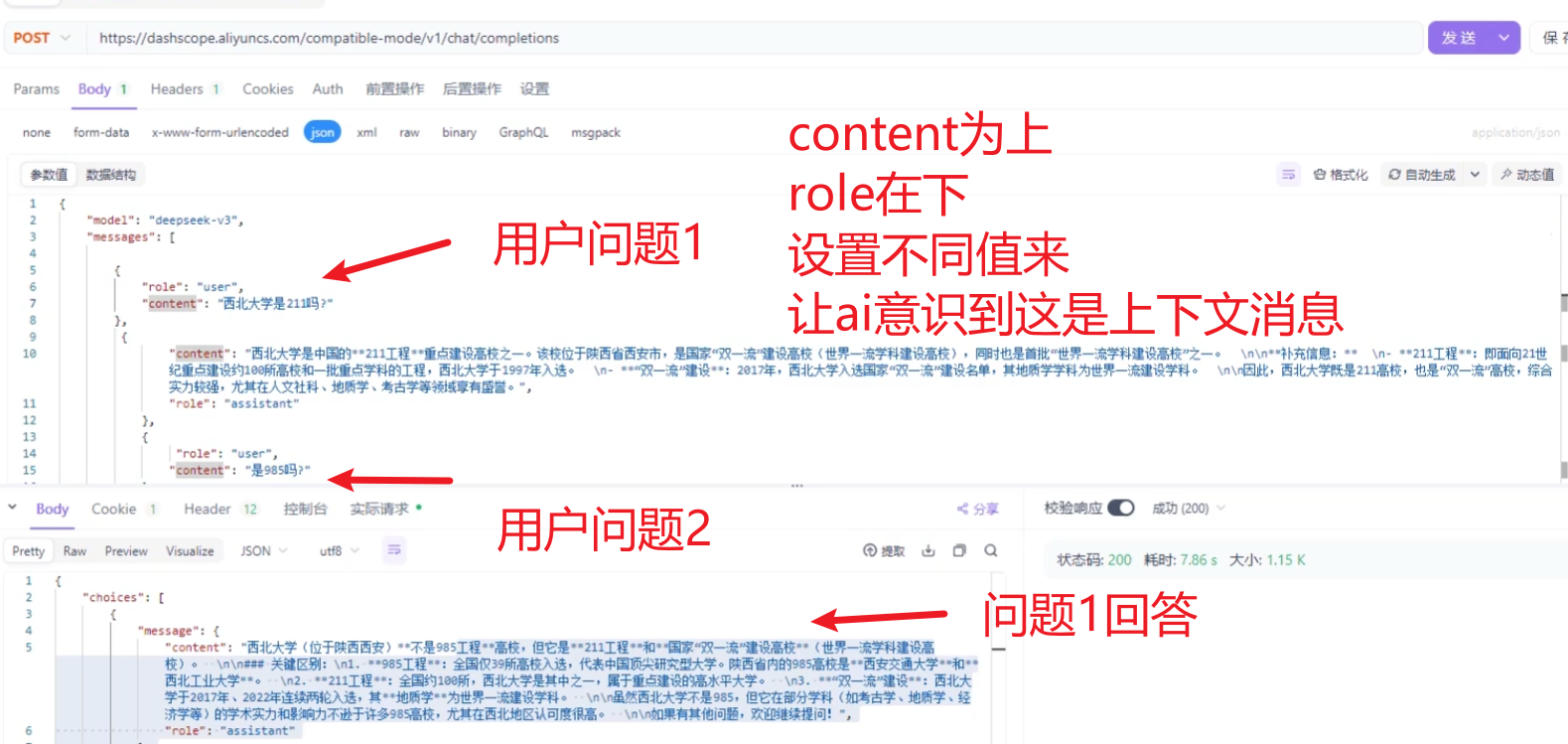

- 本节视频解释了各种参数,我觉得比较重要的就是模型回复消息

model

指定要使用的AI模型版本,不同模型具有不同的能力和特点。

contenet/role

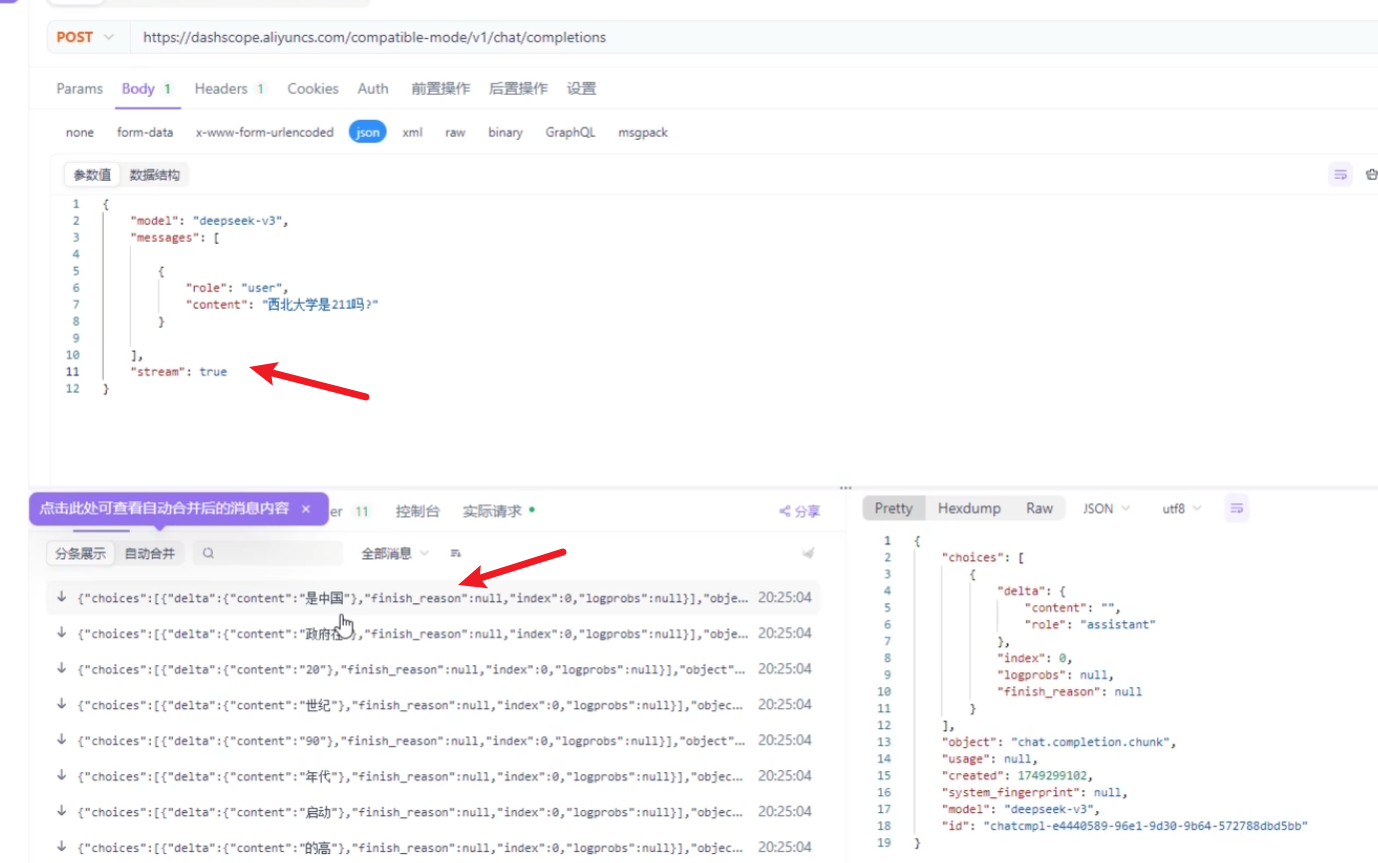

stream

- true: 流式返回,响应内容会逐步返回,用户可以实时看到生成过程

- false: 等待完整生成后一次性返回所有内容

enable_search

-

true: 模型可以联网搜索最新信息作为回答依据

-

false: 仅使用模型自身的知识库回答

总结

{

"model": "qwen-plus",

"messages": [

{

"role": "system",

"content": "你是Qiuner的ai助手"

},

{

"role": "user",

"content": "你是谁?"

},

{

"role": "assistant",

"content": "您好,有什么可以帮助您?"

}

],

"stream": true,

"enable_search": true

}| 参数名称 | 类型 | 说明 | 可选值/示例 |

|---|---|---|---|

| model | string | 告诉平台,当前调用哪个模型 | qwen-plus 等模型名称 |

| messages | array | 发送给模型的数据,模型会根据这些数据给出合适的响应 | 消息对象数组 |

| stream | boolean | 调用方式 | true: 非阻塞调用(流式调用) false: 阻塞调用(一次性响应),默认值 |

| enable_search | boolean | 联网搜索,启用后,模型会将搜索结果作为参考信息 | true: 开启 false: 关闭(默认) |

| 字段名称 | 说明 | 可选值 |

|---|---|---|

| role | 消息角色(类型) | user: 用户消息 system: 系统消息 assistant: 模型响应消息 |

| content | 消息内容 | 具体的文本内容 |

结束语

👨💻 关于我

持续学习 | 追求真我

如果本篇文章帮到了你 不妨点个赞吧~ 我会很高兴的。想看更多 那就点个关注吧 我会尽力带来有趣的内容 😎。

感谢订阅专栏 三连文章

掘金点击访问Qiuner CSDN点击访问Qiuner GitHub点击访问Qiuner Gitee点击访问Qiuner

| 专栏 | 简介 |

|---|---|

| 📊 一图读懂系列 | 图文并茂,轻松理解复杂概念 |

| 📝 一文读懂系列 | 深入浅出,全面解析技术要点 |

| 🌟持续更新 | 保持学习,不断进步 |

| 🎯 人生经验 | 经验分享,共同成长 |

你好,我是Qiuner. 为帮助别人少走弯路而写博客

如果本篇文章帮到了你 不妨点个赞 吧~ 我会很高兴的 😄 (^ ~ ^) 。想看更多 那就点个关注吧 我会尽力带来有趣的内容 😎。

代码都在Github或Gitee上,如有需要可以去上面自行下载。记得给我点星星哦😍

如果你遇到了问题,自己没法解决,可以去我掘金评论区问。CSDN评论区和私信消息看不完 掘金消息少一点.

| 上一篇推荐 | 链接 |

|---|---|

| Java程序员快又扎实的学习路线 | 点击该处自动跳转查看哦 |

| 一文读懂 AI | 点击该处自动跳转查看哦 |

| 一文读懂 服务器 | 点击该处自动跳转查看哦 |

| 2024年创作回顾 | 点击该处自动跳转查看哦 |

| 一文读懂 ESLint配置 | 点击该处自动跳转查看哦 |

| 老鸟如何追求快捷操作电脑 | 点击该处自动跳转查看哦 |

| 未来会写什么文章? | 预告链接 |

|---|---|

| 一文读懂 XX? | 点击该处自动跳转查看哦 |

| 2025年终总结 | 点击该处自动跳转查看哦 |

| 一图读懂 XX? | 点击该处自动跳转查看哦 |