今天铺天盖地的Llama 4,有些头晕眼花,在此我们梳理了下并站在更高的解读简单谈一谈~

深夜突袭:Meta的"开源核弹"为何此时引爆?

2025年4月5日,Meta突然在周末发布Llama 4系列,被网友戏称"报复性更新"------毕竟一个月前,我们的DeepSeek以"百万美元级成本"打造的R1模型横空出世,直接威胁Meta的开源霸主地位。

扎克伯格在Instagram上高调宣布:"开源AI将成为未来的主流!"而Llama 4的发布,正是Meta对市场的一次强力回应------用开源生态碾压闭源巨头,用性价比打爆竞争对手。

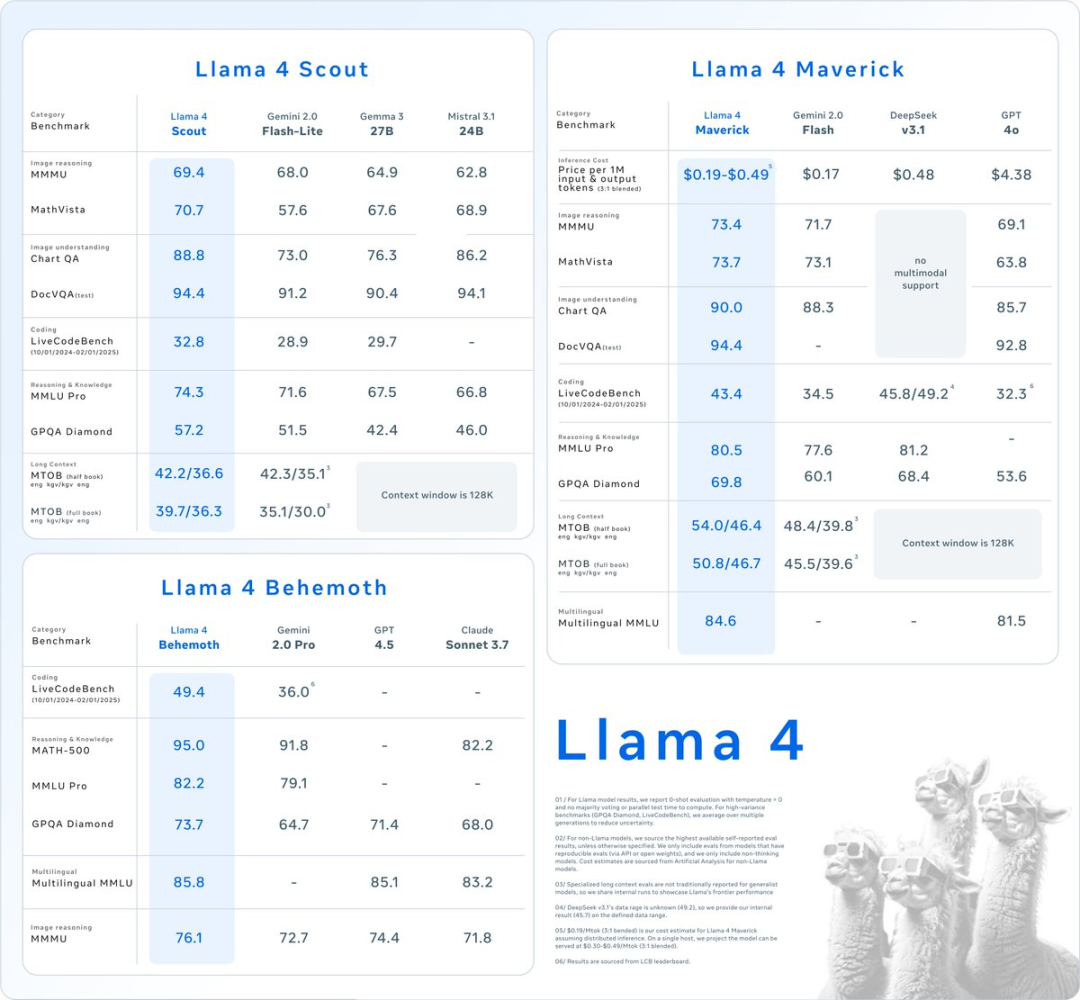

Llama4三款模型对比图,标注参数和性能差异

Llama4三款模型对比图,标注参数和性能差异

技术亮点全解析

① 原生多模态:Llama终于"长眼睛"了!

-

功能升级:用户可直接上传图片提问,比如圈出图中的"适合修水管的工具",或识别鸟类品种。

-

技术内核:早期融合架构(Early Fusion),将文本、图像、视频统一编码训练,告别"文字模型硬套图片"的尴尬。

-

行业意义:Meta终于补齐多模态短板,直接叫板GPT-4o和Gemini。

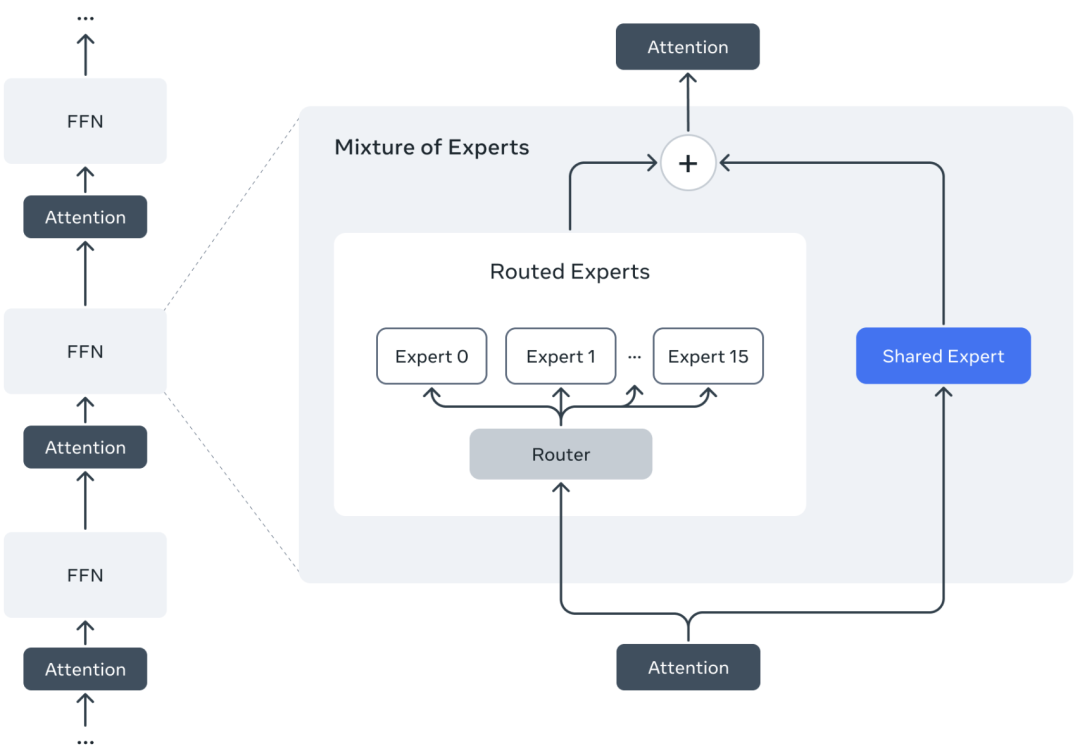

② 混合专家(MoE)架构:参数爆炸,推理成本却腰斩?

-

参数玄机:总参数高达2万亿的Behemoth模型,实际运行时仅激活170亿参数,推理效率飙升。

-

省钱密码 :单张H100显卡就能跑Llama 4 Scout,成本低至每百万tokens 0.19美元,比GPT-4o便宜20倍。

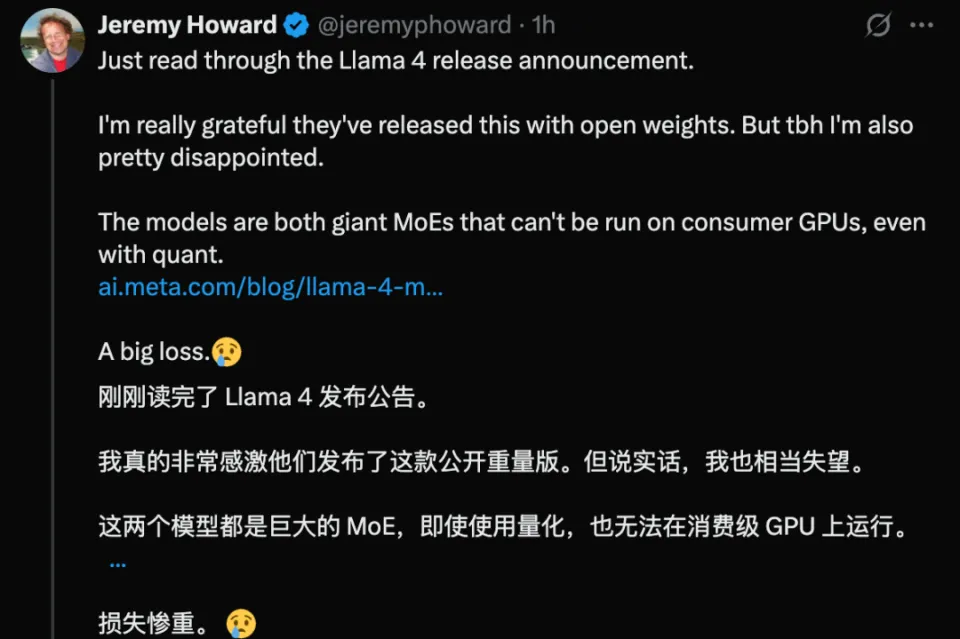

参数多到数不过来,但普通玩家还是玩不起啊!

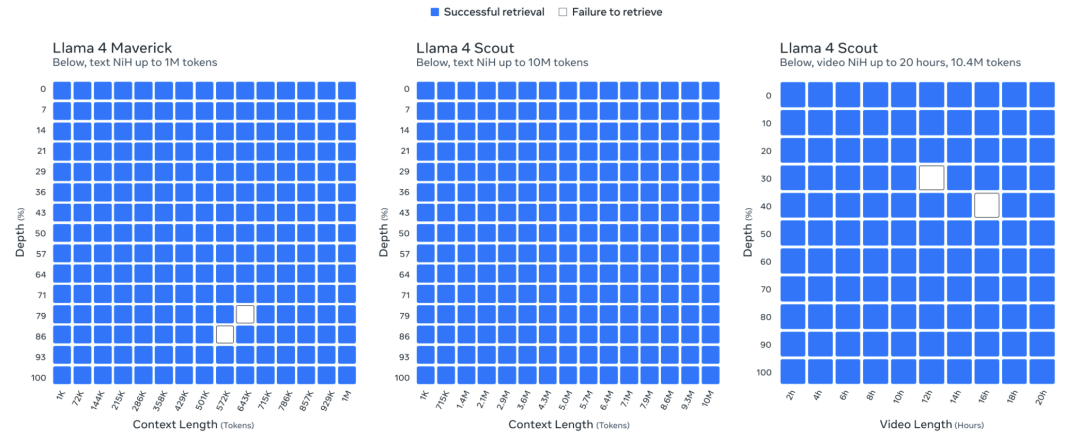

③ 千万级上下文:能塞下整部《三体》的"记忆宫殿"

-

惊人容量:Llama 4 Scout支持1000万token上下文(约1.5万页文本),可一次性分析整部《三体》三部曲。

-

技术突破:iRoPE架构实现"无限上下文"目标,推理时动态调整注意力机制,避免长文本"失忆"。

-

应用场景:医学文献分析、代码库全局优化、超长视频理解。

④ 训练黑科技MetaP:AI界的"一键复制粘贴"

- 核心功能:超参数自动迁移,小模型调好的参数可直接套用到大模型,省下天价训练成本。

这简直是Meta的'工业流水线',开源社区要卷疯了!xs

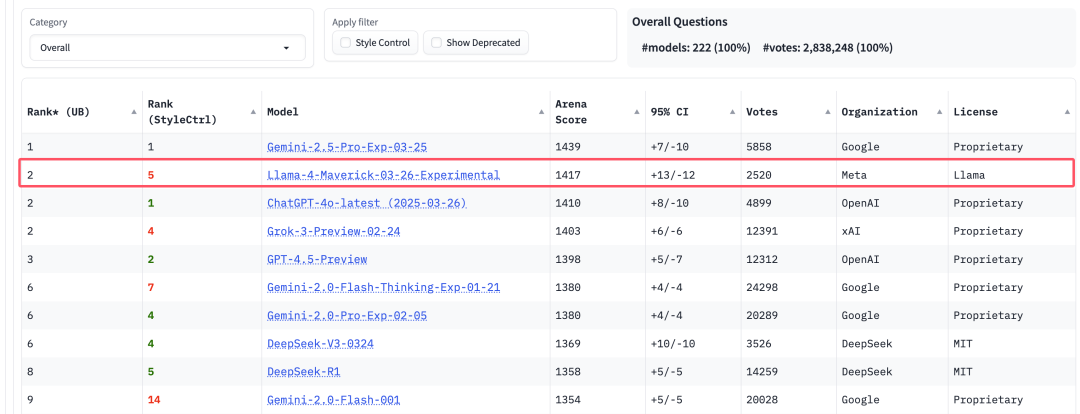

性能对决:正面硬刚DeepSeek与GPT-4

-

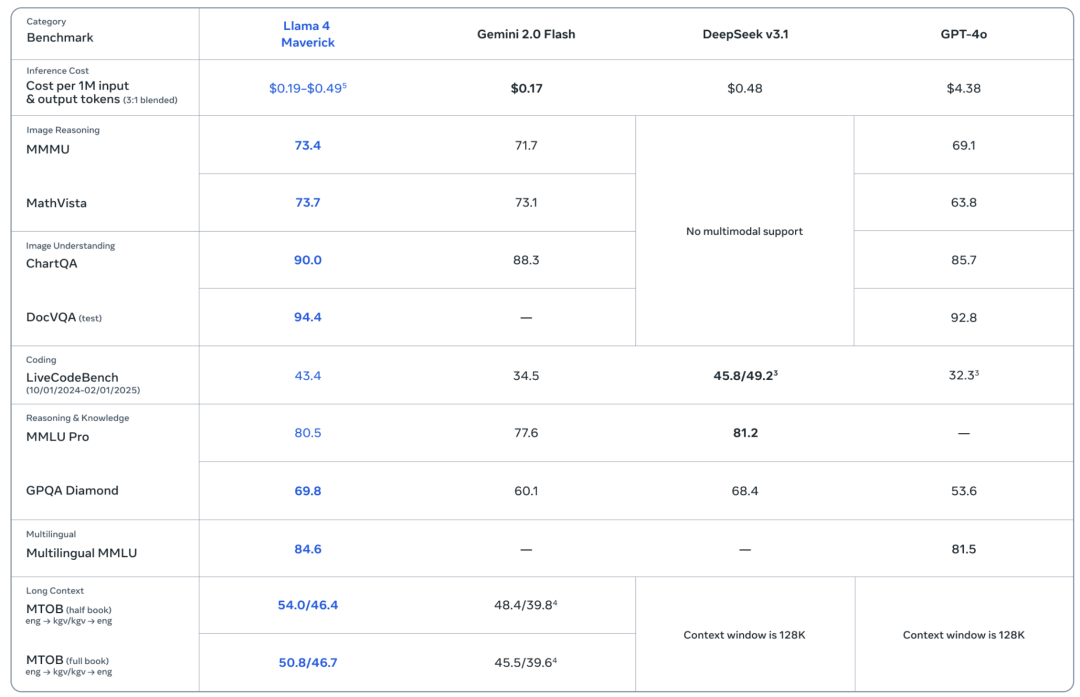

开源内战:Llama 4 Maverick以一半参数量追平DeepSeek v3的代码能力,登顶开源模型榜首。

-

闭源挑战:Behemoth模型在STEM领域碾压GPT-4.5和Claude 3.7,但推理能力仍逊于专用模型。

Meta用开源打闭源,用中杯价格卖超大杯性能,说实话这波赢麻了!

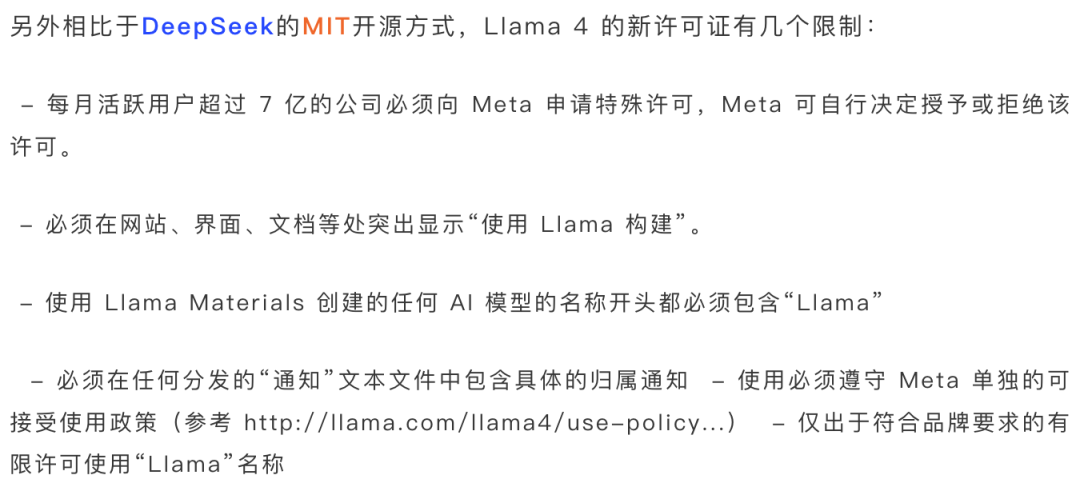

开源策略:Meta的"安卓梦"与暗藏的紧箍咒

-

安卓式野心:扎克伯格宣称"开源AI将统治世界",Llama生态下载量超3000万次,成开发者首选。

-

霸王条款 :月活超7亿的公司需申请特殊许可,且产品名必须带"Llama"------被调侃为"开源界的苹果税"。

行业冲击波:AI军备竞赛进入"拼多多"时代

-

价格战:Meta将推理成本压到极致,逼迫对手降价。

-

生态战 :Hugging Face已上线模型,开发者可一键微调。

-

数据战:训练数据量达30万亿token,是Llama 3的两倍,涵盖200种语言。

OpenAI和谷歌连夜开会,DeepSeek或被迫开源反击!

彩蛋:那些让人会心一笑的细节

-

扎克伯格的"小心机":发布会选在周末深夜,成功抢占全球头条。

-

程序员狂喜:网友用Llama 4 Scout生成《用Python算圆周率》代码,结果比GPT-4少3行。

-

Meta的自黑:官方承认"政治偏见更偏右派",嘿嘿 AI也要站队?

结语

Llama 4的发布,不仅是技术的跃进,更是开源与闭源阵营的终极对决。Meta用"开源核弹"炸开了AI垄断的高墙,但暗藏的许可证条款也引发争议。无论如何,这场战役的赢家或许是全体开发者------毕竟,能用H100跑出GPT-4级性能的时代,真的来了。

参考资料

-

Meta发布Llama 4系列模型,参数高达2万亿: https://finance.sina.com.cn/tech/roll/2025-04-06/doc-ineseshz9058195.shtml

-

Meta深夜开源Llama 4!首次采用MoE,惊人千万token上下文: https://www.163.com/dy/article/JSEVJ9UG0531E3NX.html

-

炸裂!Meta深夜推出Llama 4系列: https://news.qq.com/rain/a/20250406A01CME00

-

Meta推出LLaMA4:AI推荐算法革命性进步: https://www.sohu.com/a/806271771_121924584

-

Llama 4发布重夺开源第一!: https://so.html5.qq.com/page/real/search_news?docid=70000021_02867f1ee4888052\&faker=1

-

Llama生态系统:过去、现在和未来: https://www.163.com/dy/article/IFP24AJR05534HHB.html

备注:**昵称-学校/公司-方向/**会议(eg.ACL)****,进入技术/投稿群

id:DLNLPer,记得备注呦