前期说明

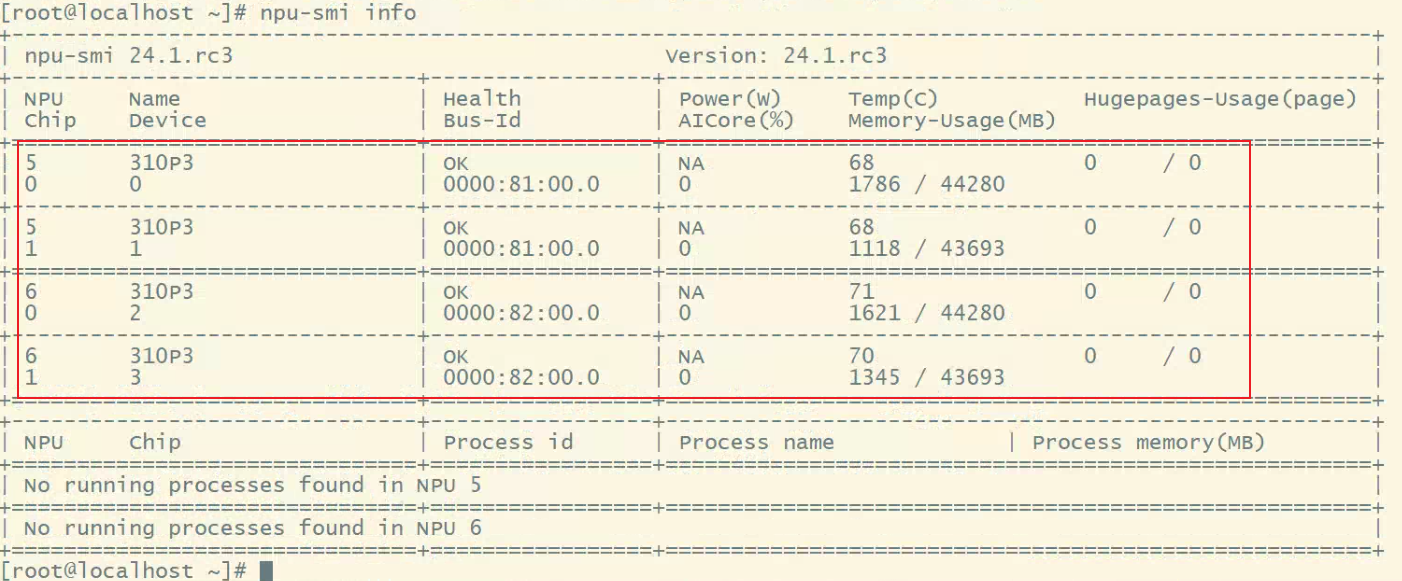

配置:2台鲲鹏32C2 + 2 Atlas300I duo,之前看网上文档,目前GPUstack只支持910B芯片,想尝试一下能不能310P也部署试试,毕竟华为的集群软件要收费。

系统:openEuler22.03-LTS

驱动:24.1.rc3

前期准备

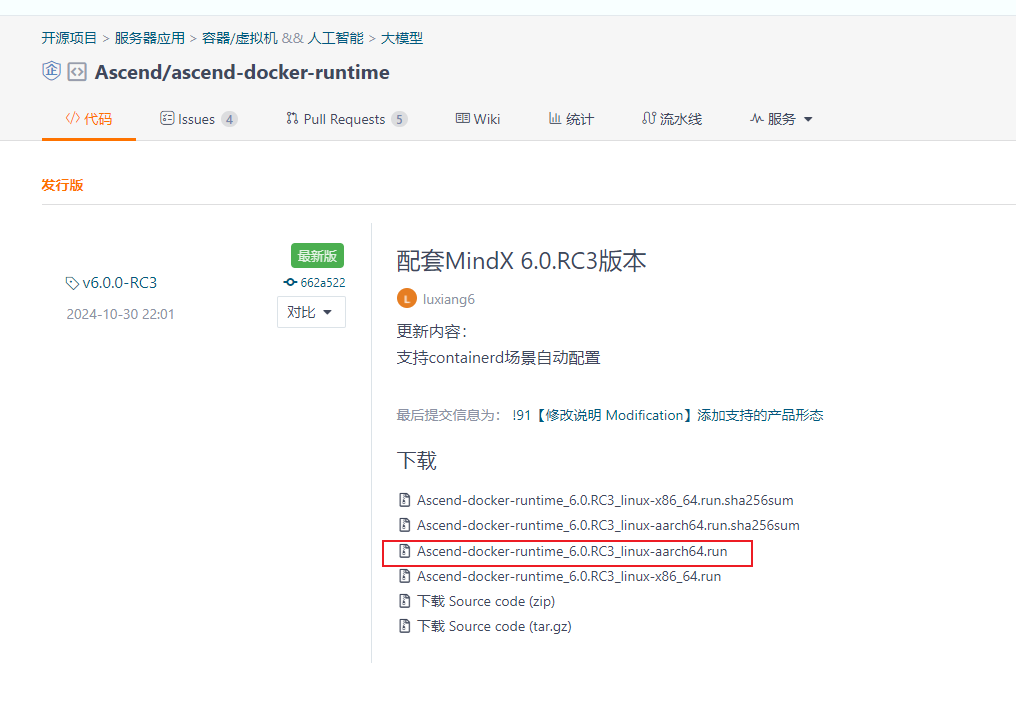

bash

chmod +x Ascend-docker-runtime_6.0.RC3_linux-aarch64.run

./Ascend-docker-runtime_6.0.RC3_linux-aarch64.run这玩意就是对Docker以插件方式提供Ascend NPU适配功能

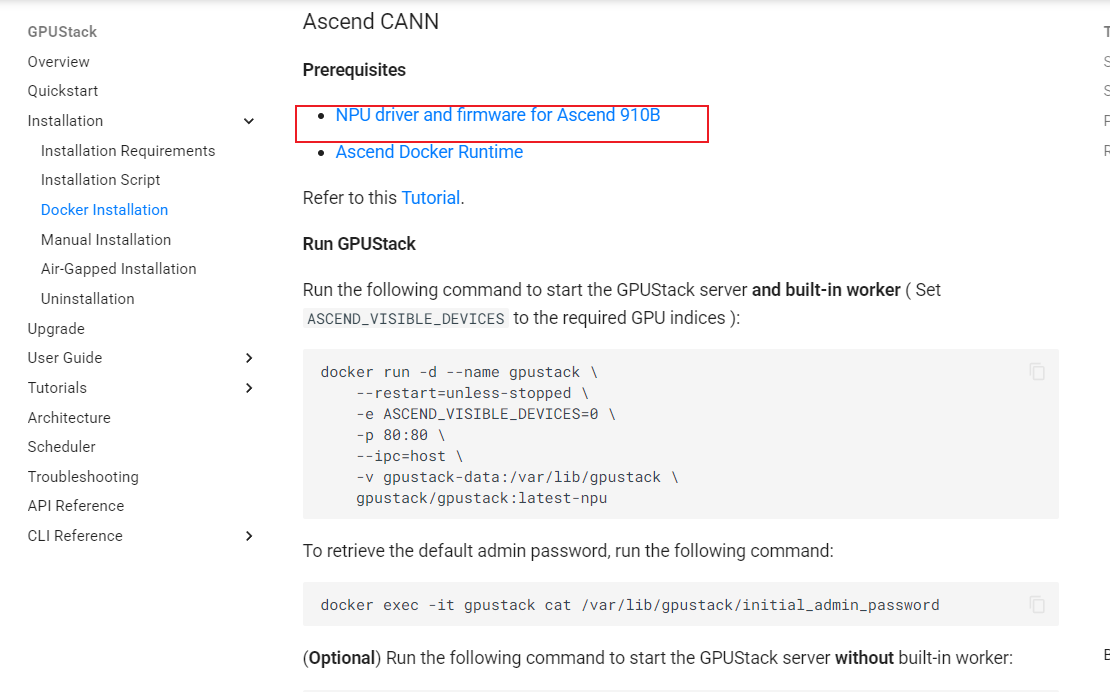

部署GPUStack

bash

docker run -it --privileged -u root --net=host --ipc=host \

--name=gpustack \

-p 80:80 \

-v /usr/local/Ascend/driver:/usr/local/Ascend/driver:ro \ #映射驱动

-v /usr/local/sbin:/usr/local/sbin:ro \

--device=/dev/davinci0 \ #2张卡4个芯片

--device=/dev/davinci1 \

--device=/dev/davinci2 \

--device=/dev/davinci3 \

gpustack/gpustack:latest-npu这个命令我自己改的,原本官方那个太坑了,不映射驱动和NPU卡!

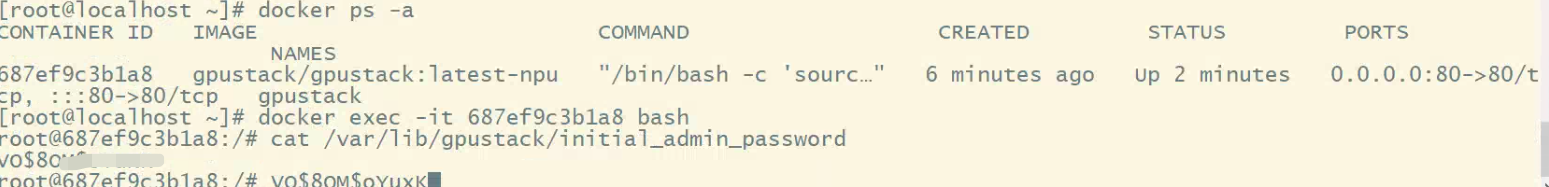

bash

docker exec -it gpustack cat /var/lib/gpustack/initial_admin_password ##获取密码,账号默认admin

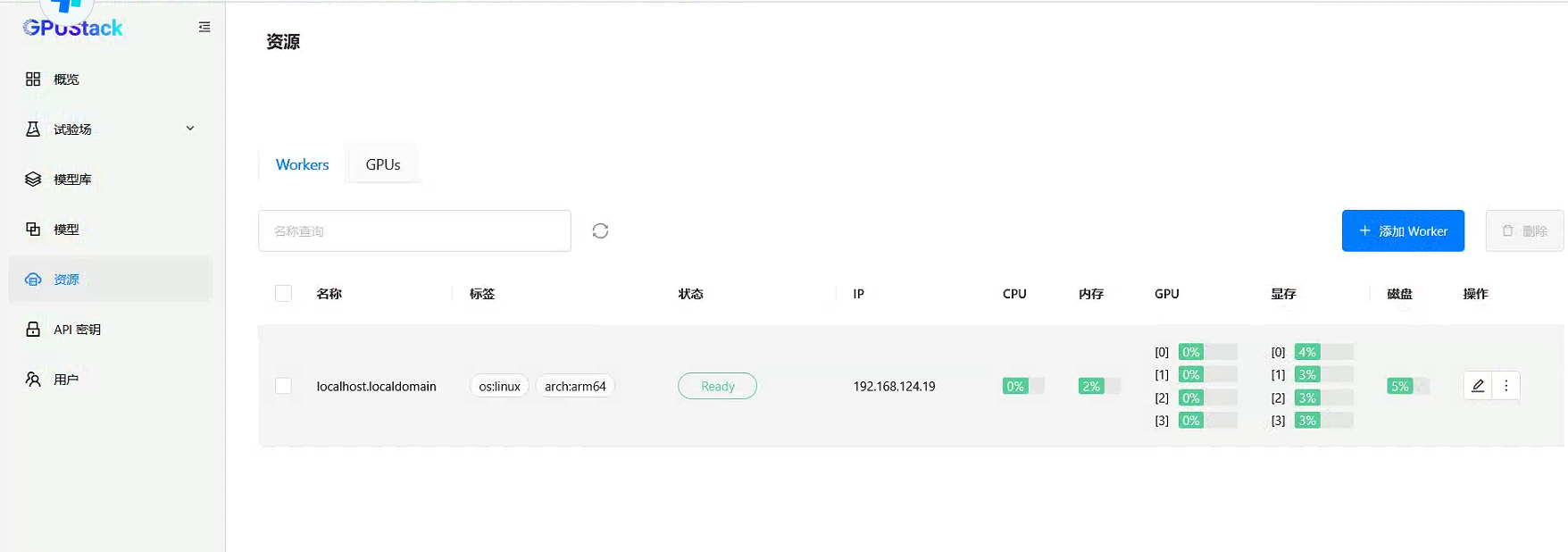

登录GPUStack

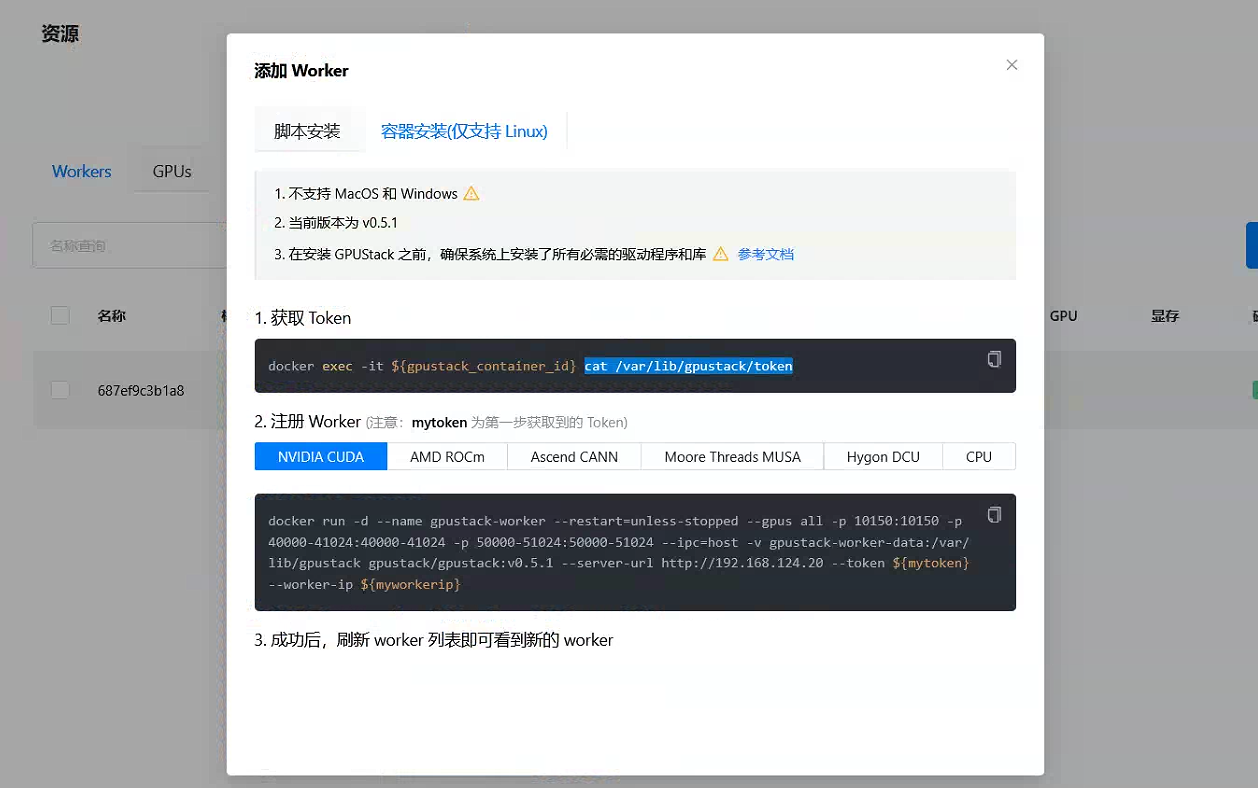

部署worker节点

bash

docker run -d \

--name gpustack-worker \

--restart=unless-stopped \

-e ASCEND_VISIBLE_DEVICES=0 \

-p 10150:10150 \

-p 40000-41024:40000-41024 \

-p 50000-51024:50000-51024 \

--ipc=host \

--device=/dev/davinci0 \

--device=/dev/davinci1 \

--device=/dev/davinci2 \

--device=/dev/davinci3 \

-v /usr/local/Ascend/driver:/usr/local/Ascend/driver:ro \

-v /usr/local/sbin:/usr/local/sbin:ro \

-v gpustack-worker-data:/var/lib/gpustack \

gpustack/gpustack:v0.5.1-npu \

--server-url http://192.168.124.19 \

--token 5a3b06c91adf9090890258301bb75710 \

--worker-ip 192.168.124.20创建容器命令我自己改的,可以根据我这个创建,官方给的都是坑!

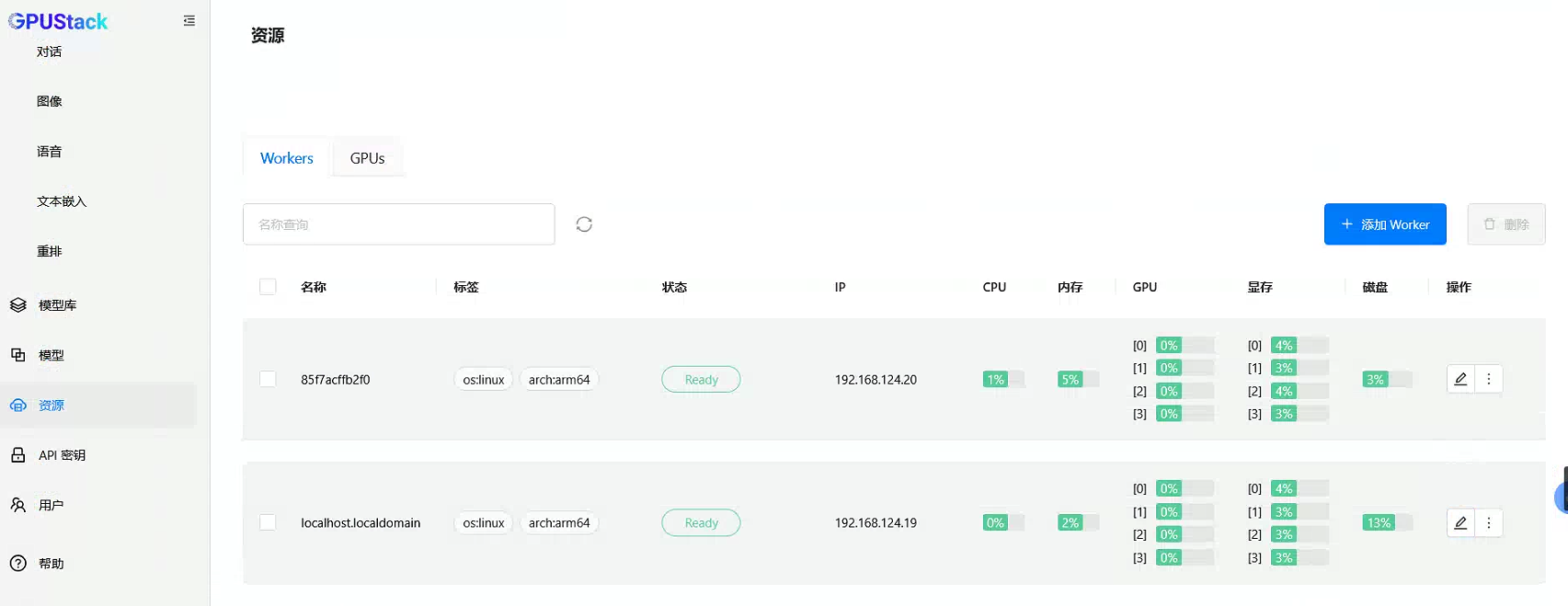

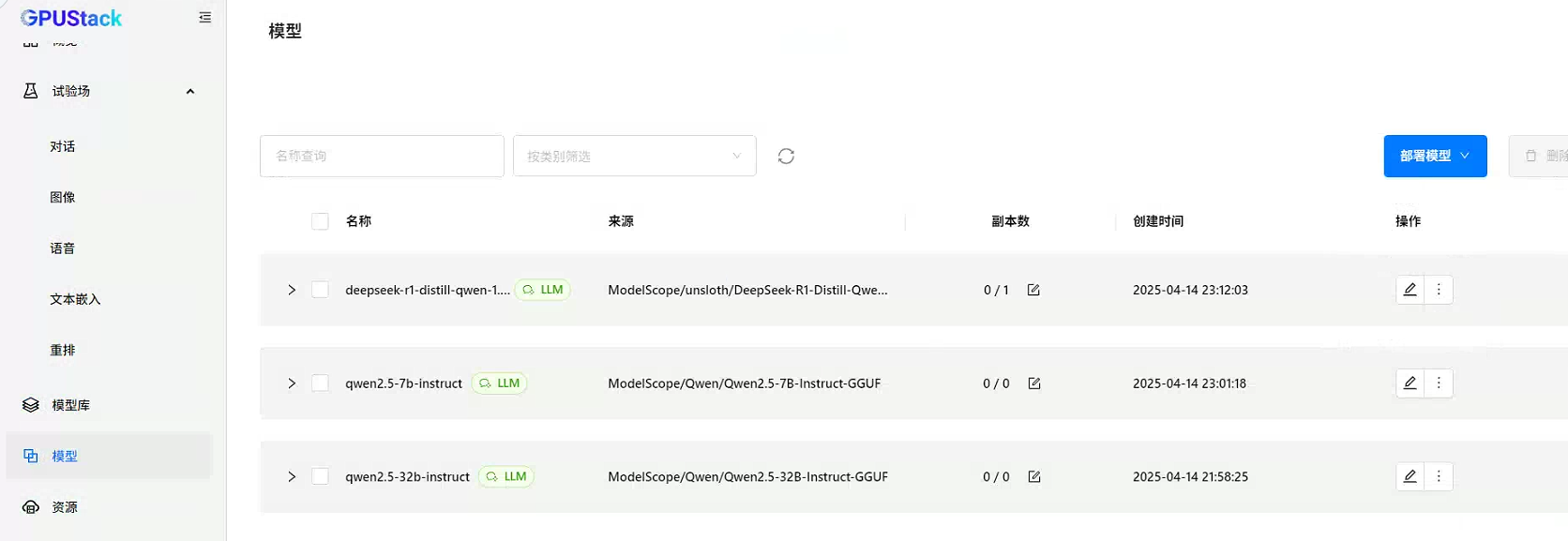

刷新一下页面,就可以看到worker节点了

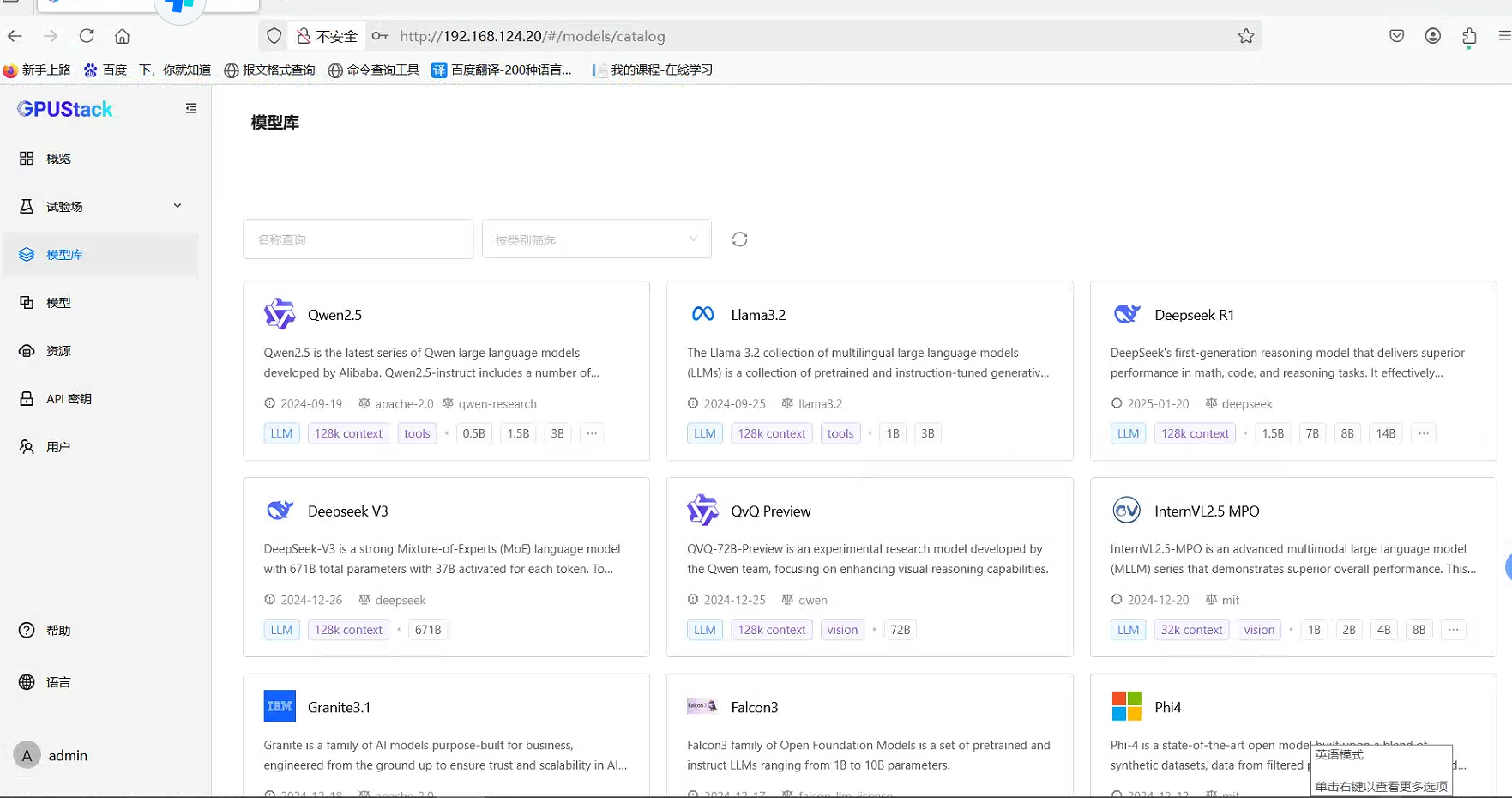

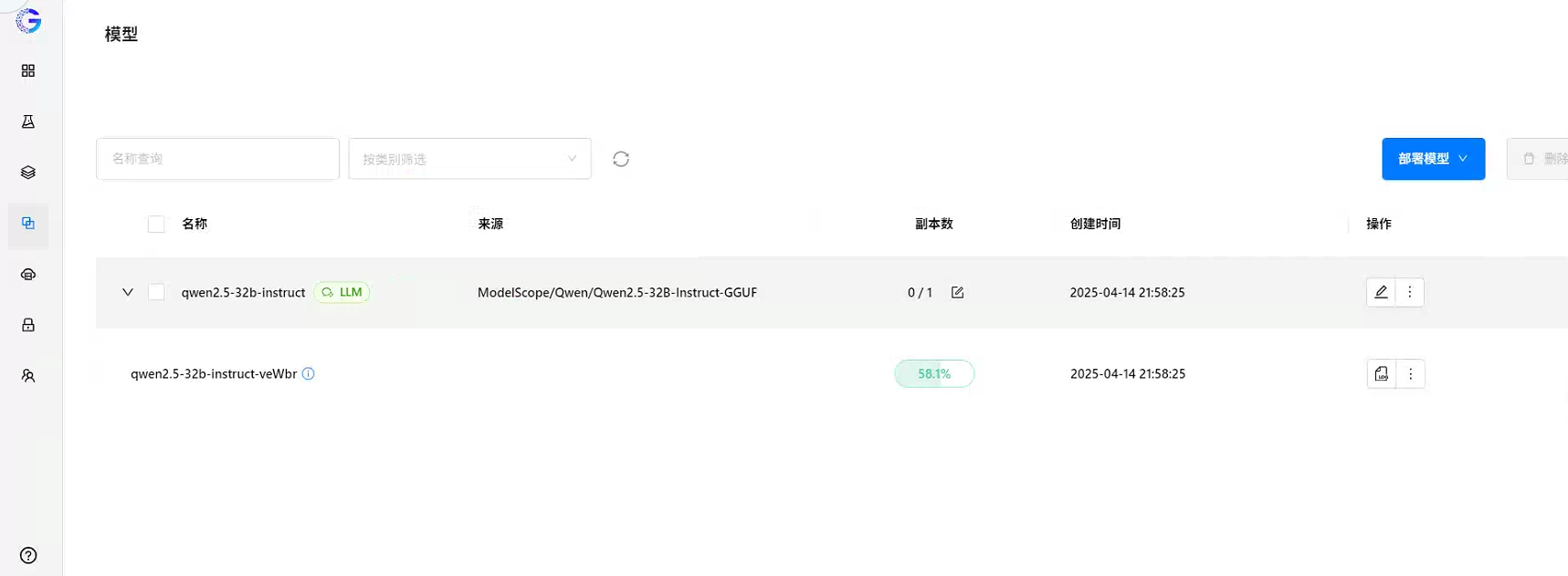

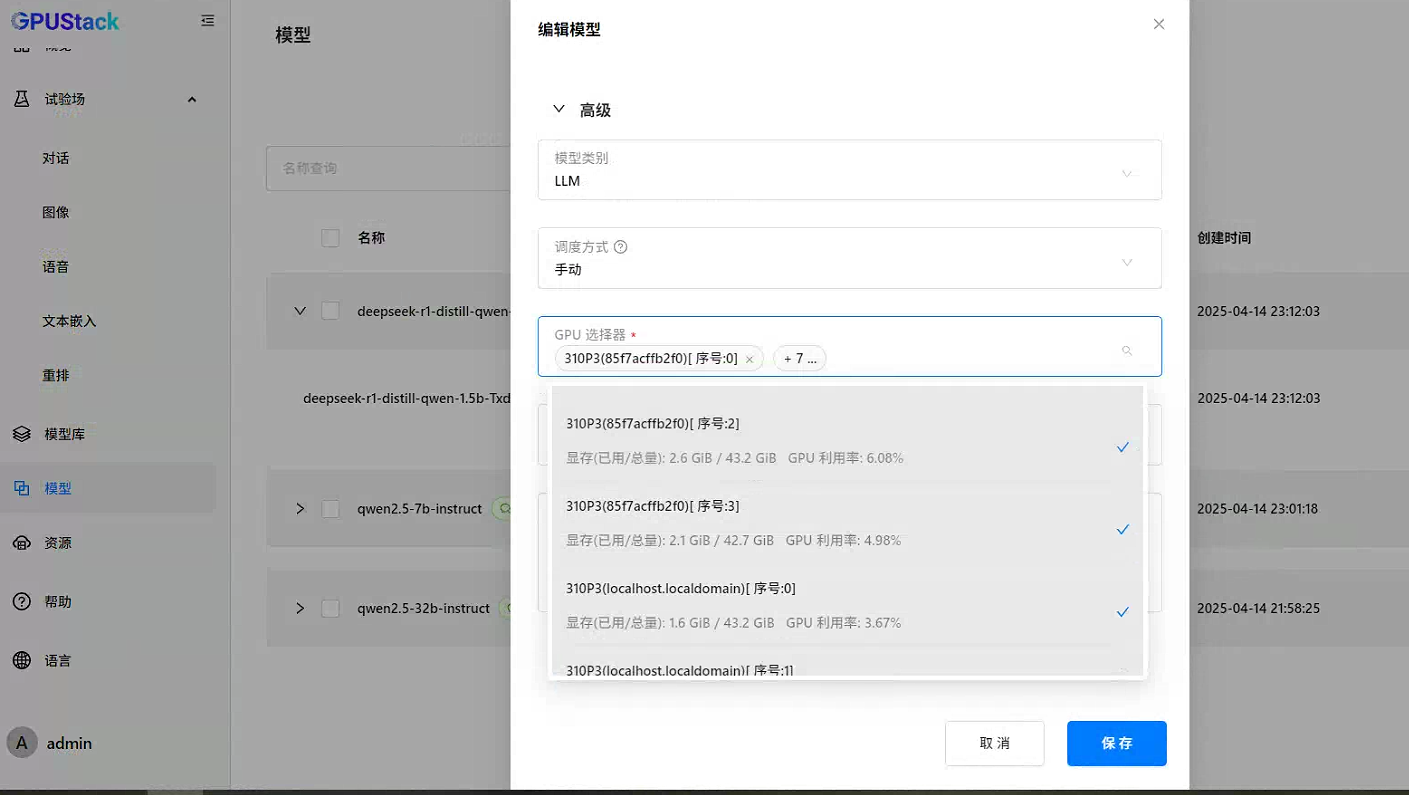

GPUStack部署模型测试

总结:下载了三个模型,测试对话都失败,确实不支持310P,目前只支持910B!但是作为开源软件来说,GPUStack确实功能齐全,用起来方便,非常不错!