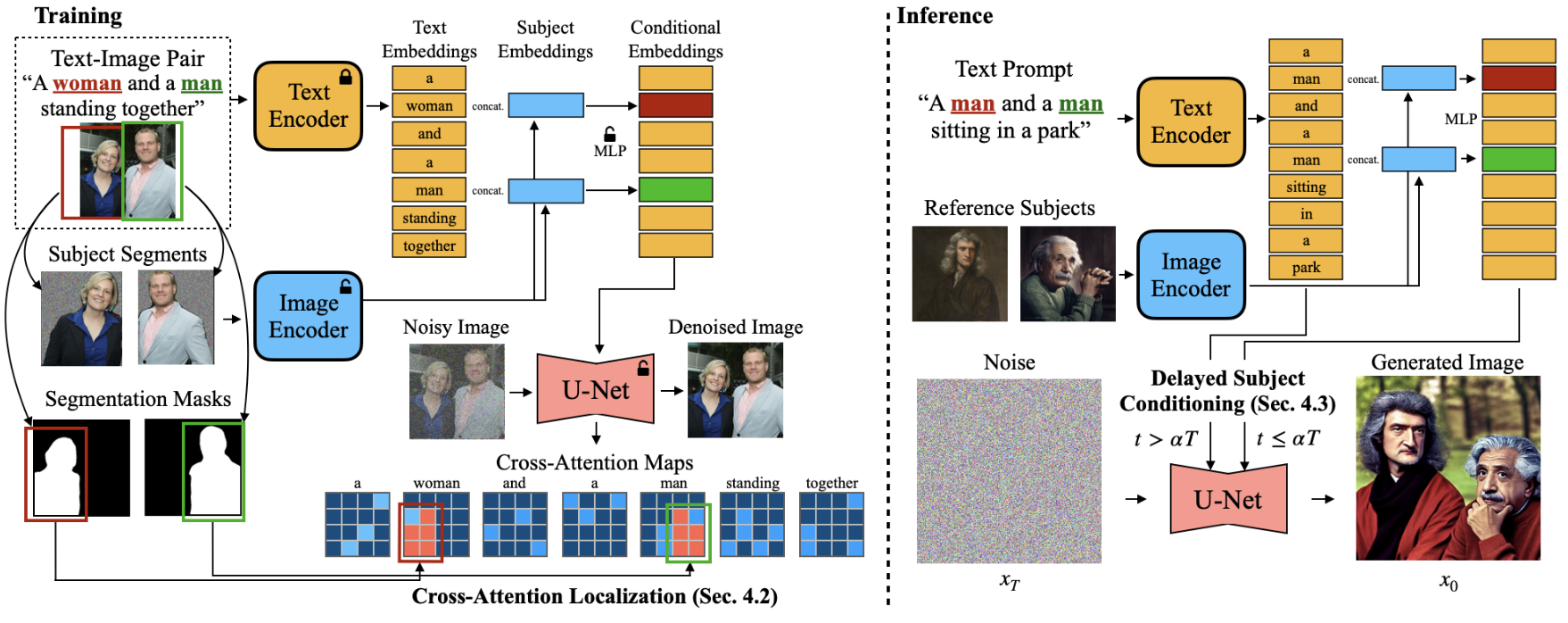

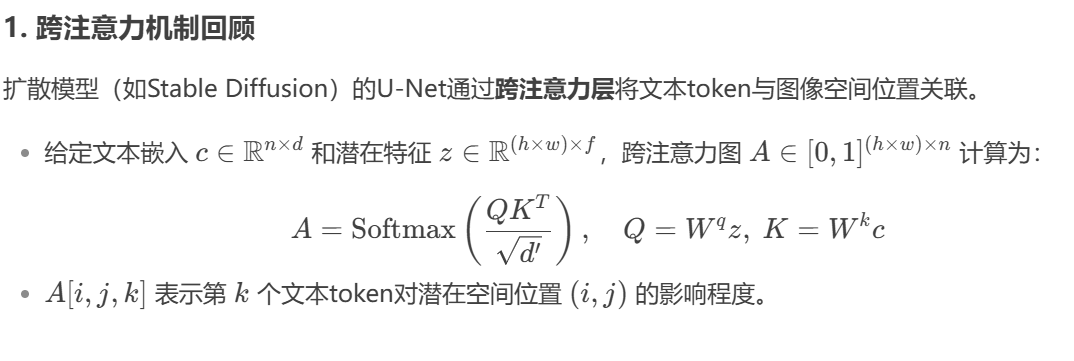

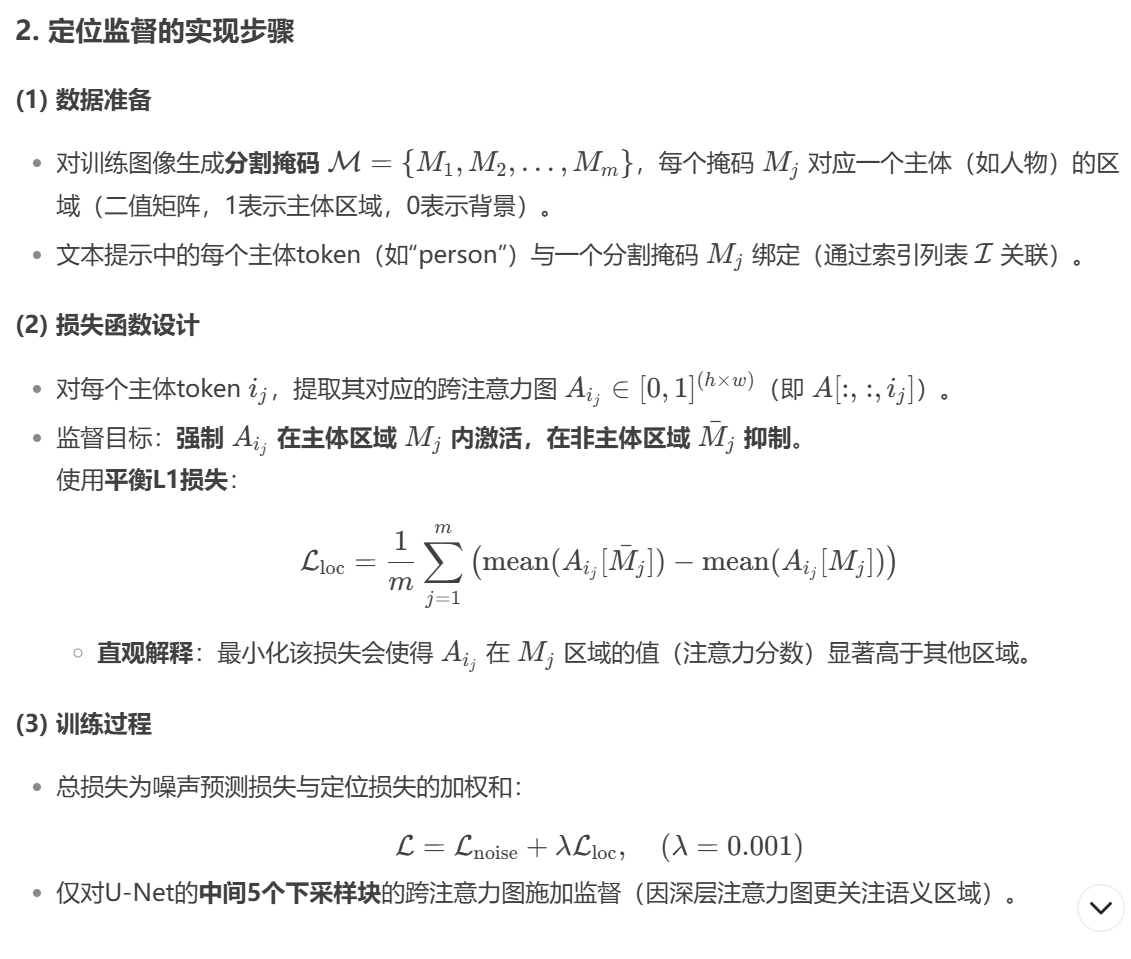

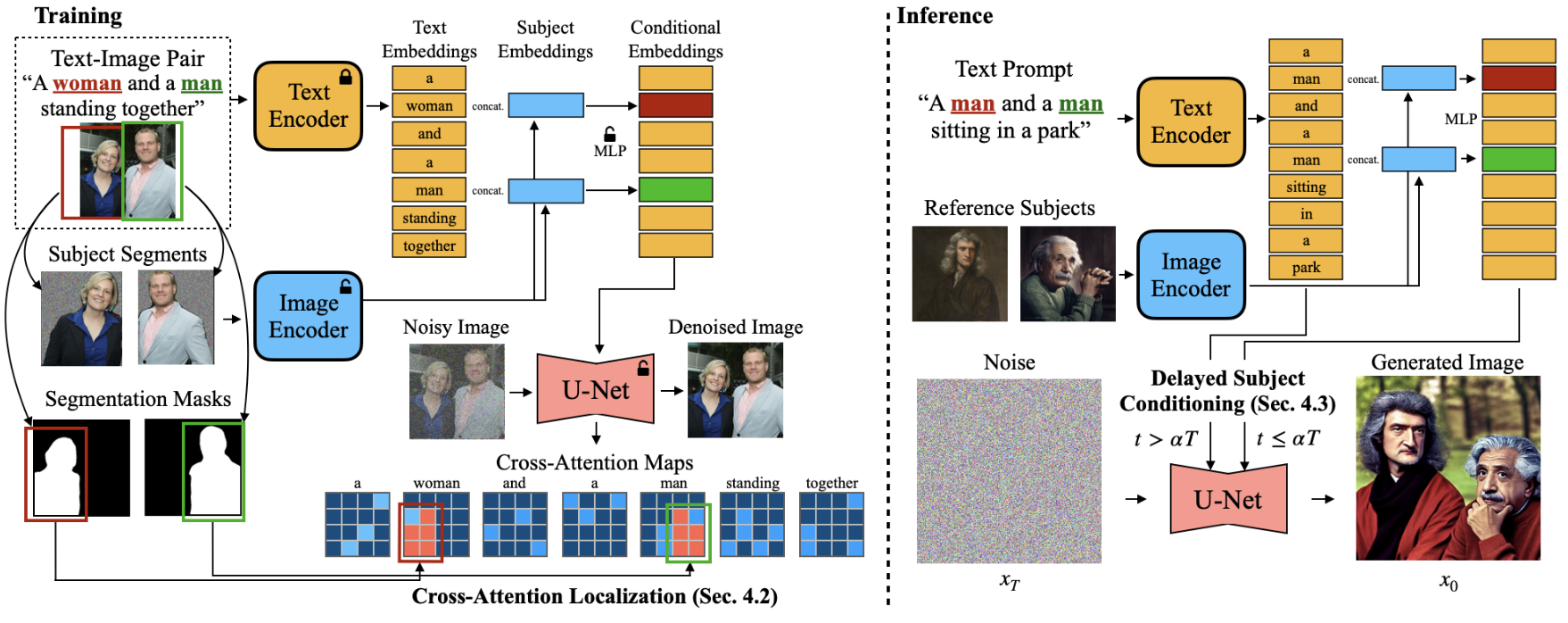

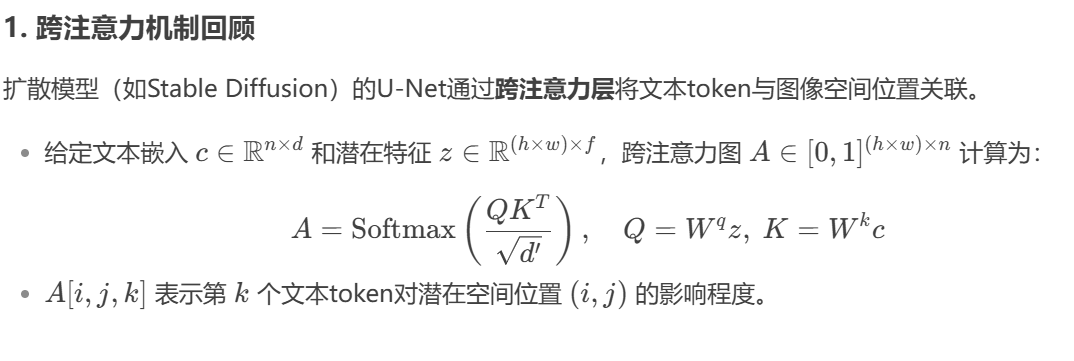

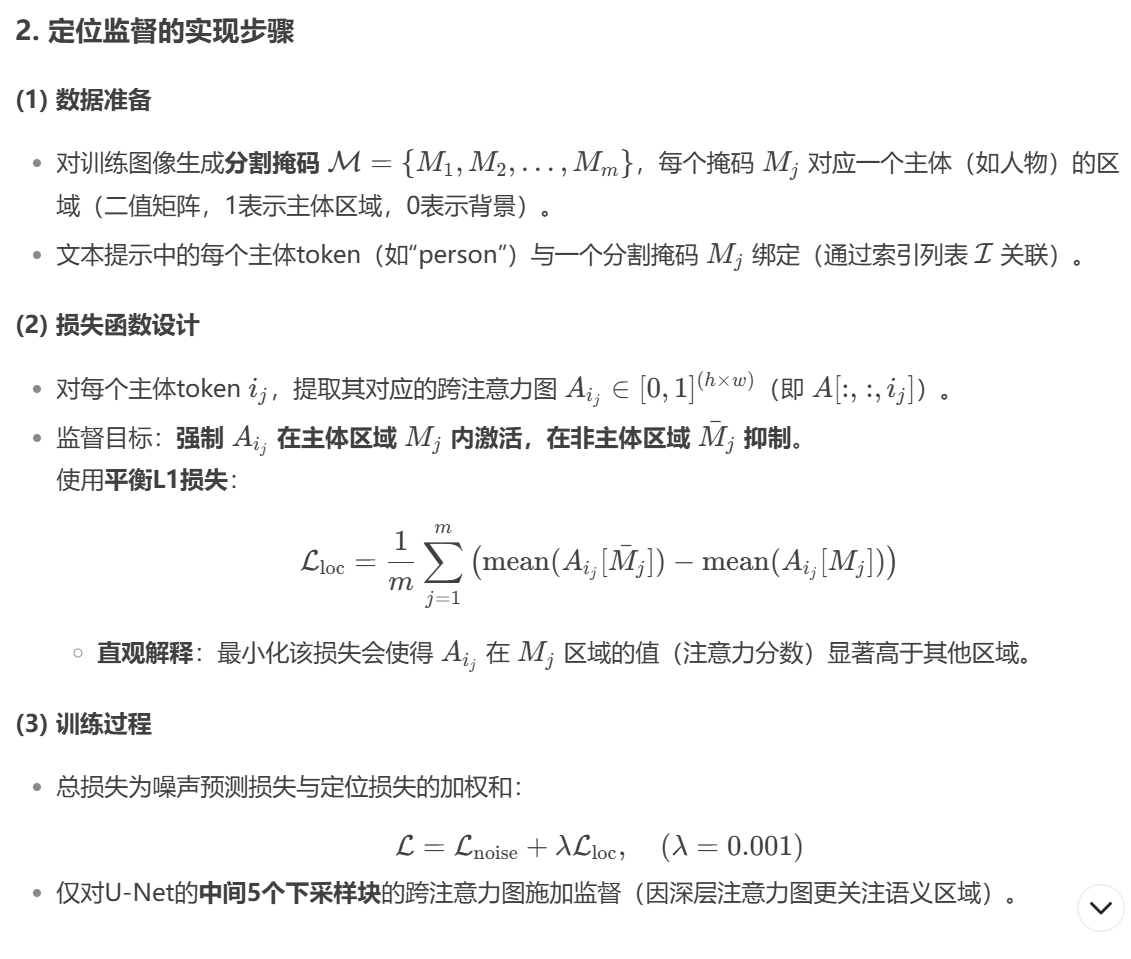

在FastComposer中,跨注意力定位监督(Cross-Attention Localization Supervision) 的实现是通过以下步骤完成的,核心思想是利用分割掩码约束扩散模型中跨注意力图的分布,确保每个主体的特征仅影响图像中对应的区域。具体实现细节如下:

在FastComposer中,跨注意力定位监督(Cross-Attention Localization Supervision) 的实现是通过以下步骤完成的,核心思想是利用分割掩码约束扩散模型中跨注意力图的分布,确保每个主体的特征仅影响图像中对应的区域。具体实现细节如下:

总结

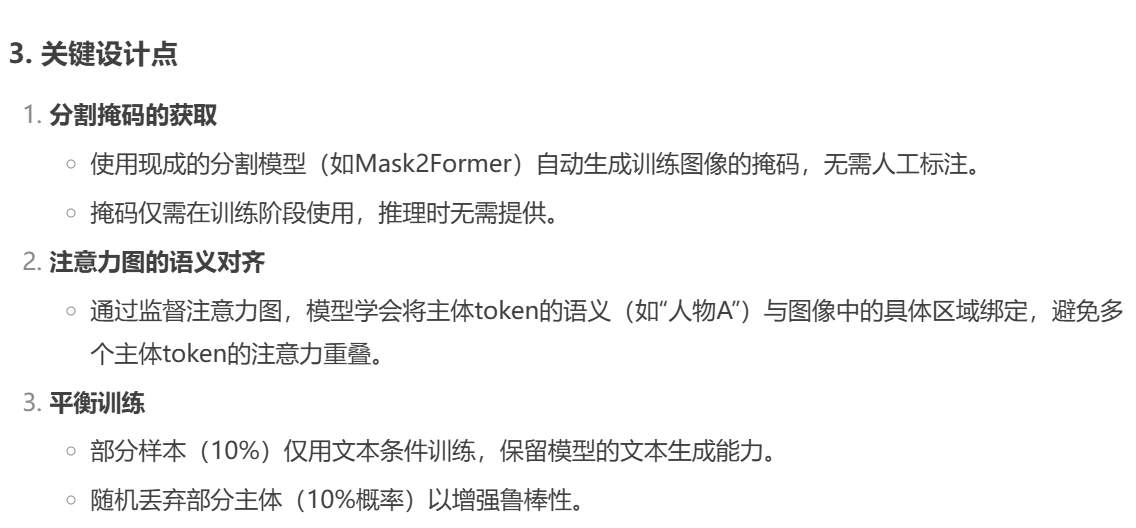

跨注意力定位监督通过分割掩码引导注意力分布 ,本质上是一种隐式的空间约束,使模型在训练中学会将文本token与图像区域精确对应。这一方法在多主体生成中至关重要,解决了传统扩散模型因注意力扩散导致的身份混合问题。

在FastComposer中,跨注意力定位监督(Cross-Attention Localization Supervision) 的实现是通过以下步骤完成的,核心思想是利用分割掩码约束扩散模型中跨注意力图的分布,确保每个主体的特征仅影响图像中对应的区域。具体实现细节如下:

在FastComposer中,跨注意力定位监督(Cross-Attention Localization Supervision) 的实现是通过以下步骤完成的,核心思想是利用分割掩码约束扩散模型中跨注意力图的分布,确保每个主体的特征仅影响图像中对应的区域。具体实现细节如下:

跨注意力定位监督通过分割掩码引导注意力分布 ,本质上是一种隐式的空间约束,使模型在训练中学会将文本token与图像区域精确对应。这一方法在多主体生成中至关重要,解决了传统扩散模型因注意力扩散导致的身份混合问题。