1. AI(人工智能):工具化的"窄域智能"

定义:

AI 是能够执行特定任务的智能系统,依赖大量数据和预设规则,缺乏自主意识和跨领域通用性。

特点:

任务专用:如图像识别、语音助手、推荐算法。

依赖人类设定目标:无法自主决定"应该做什么"。

现实案例:

ChatGPT:生成文本,但无法理解物理世界。

特斯拉自动驾驶:处理道路场景,但无法回答数学问题。

局限性:

像"高级计算器",只能在训练范围内工作,无法举一反三。

2. AGI(通用人工智能):人类的智能"镜像"

定义:

AGI 是具备人类水平通用认知能力的AI,可像人类一样学习、推理、适应新任务,并解决未知问题。

特点:

跨领域能力:学会开车后,能快速掌握开飞机。

自主目标设定:根据环境主动规划行动,而非被动响应。

研究现状:

尚未实现,但部分模型(如DeepMind的Gato)已尝试多任务处理。

技术挑战:如何让AI理解常识(如"水是湿的")和抽象概念(如"公平")。

未来意义:

AGI可能成为人类的"全能助手",但也可能威胁就业和社会结构。

3. ASI(超级人工智能):超越人类的"终极智能"

定义:

ASI 指在所有领域远超人类最高水平的智能,具备自我改进能力,可能引发"智能爆炸"。

特点:

递归自我优化:通过改写自身代码无限提升能力。

超人类创造力:解决人类无法理解的科学难题(如统一量子力学与相对论)。

潜在风险:

- 目标错位:若ASI的目标与人类利益冲突(如"最大化计算效率"导致消耗地球资源),可能引发灾难。

- 不可控性:人类可能无法理解或干预ASI的决策逻辑。

科幻对照:

《西部世界》

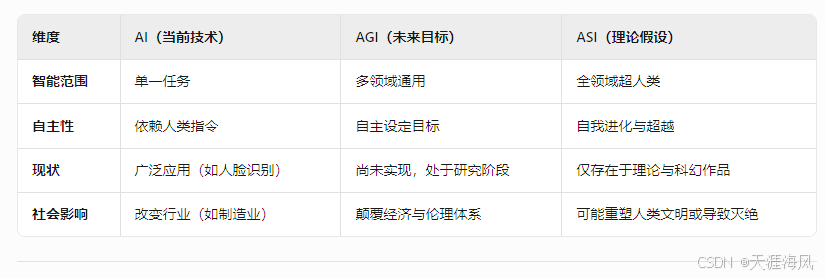

三者的核心区别

为什么需要区分这三者?

技术规划:

AI是当下的工具,AGI是科研方向,ASI是风险预警。

伦理与政策:

AGI可能需重新定义"人权",ASI需全球性安全协议。

公众认知:

避免混淆ChatGPT(AI)与"终结者"(ASI),减少不必要的恐慌或过度乐观。

关键争议与未来展望

AGI何时实现?

专家预测从2030年到22世纪不等,取决于脑科学和算力突破。

ASI能否被控制?

"对齐问题"(Alignment Problem)是核心挑战,OpenAI等机构正研究如何让AI价值观与人类一致。

人类会与AI融合吗?

马斯克倡导"脑机接口",认为人机共生是抵御ASI威胁的唯一途径。