深度前馈神经网络

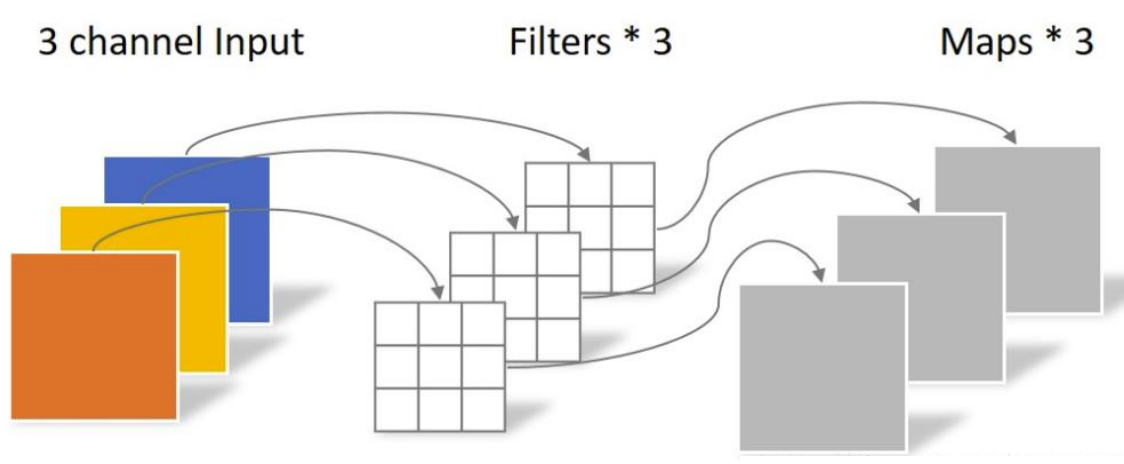

卷积神经网络

Advanced卷积神经网络

Lightweight CNN

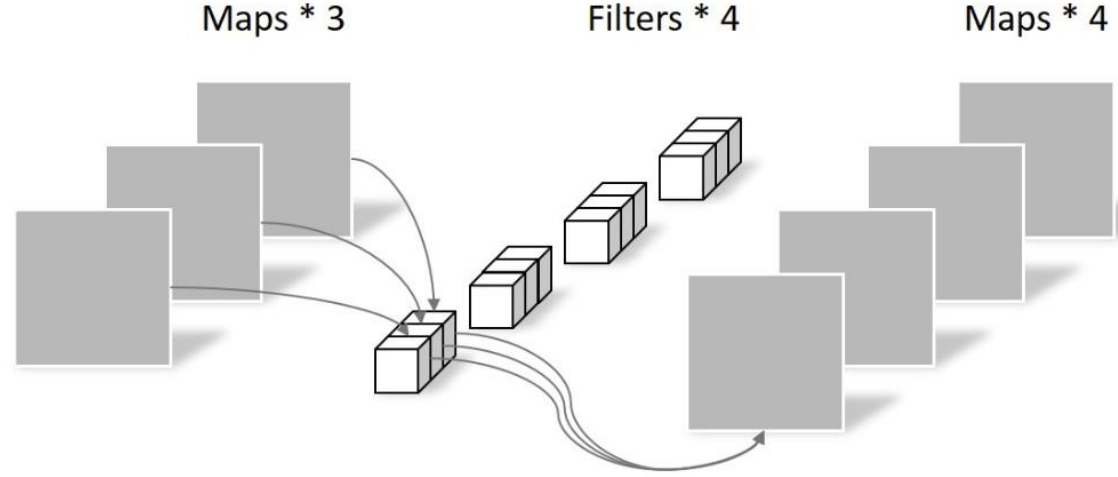

dwconv

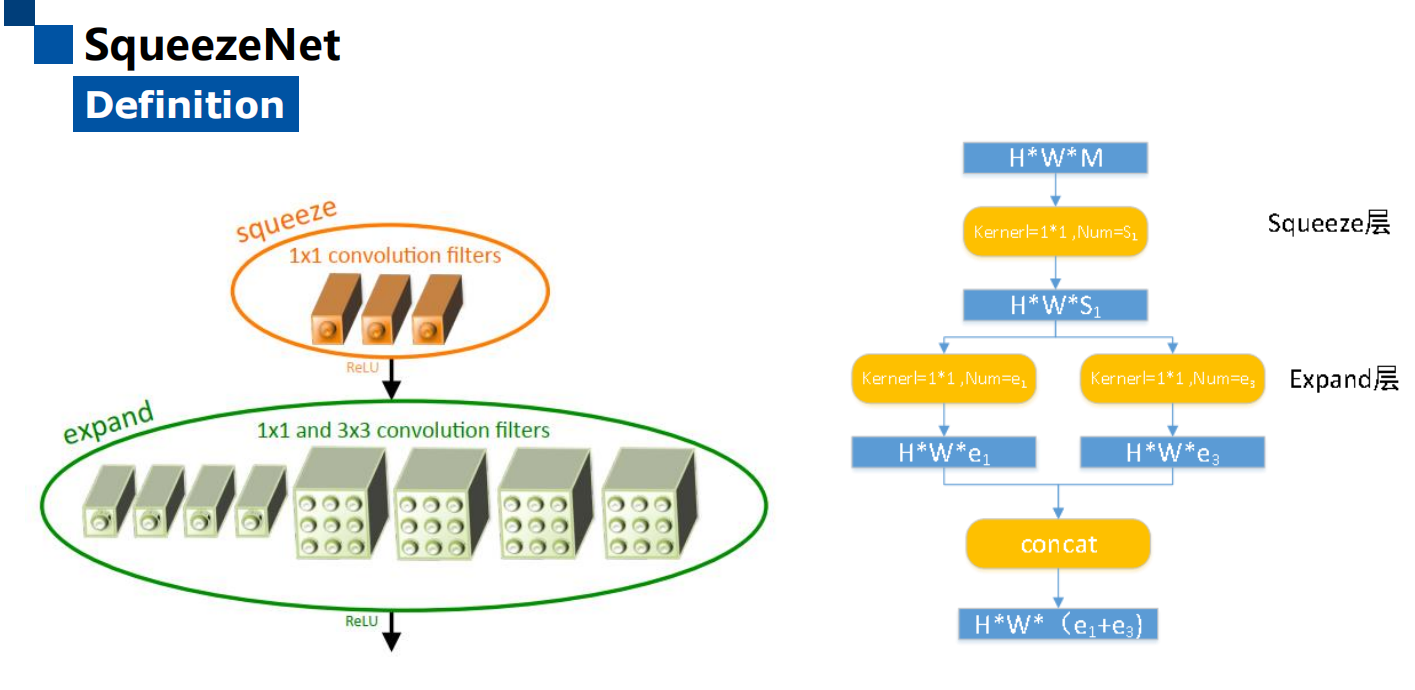

squeezenet

这边右侧的e3是3x3卷积吧

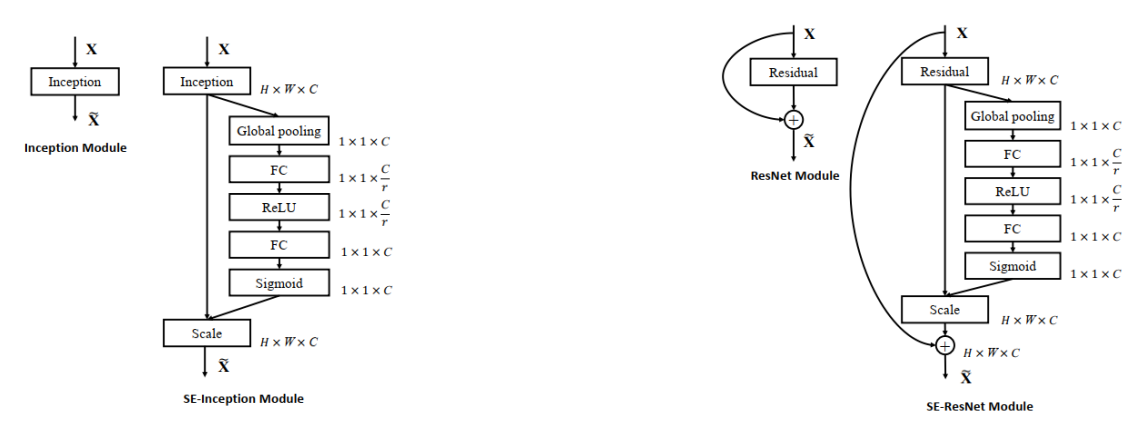

SENet

在通道维度压一下,强迫各维度混合学习,再还原

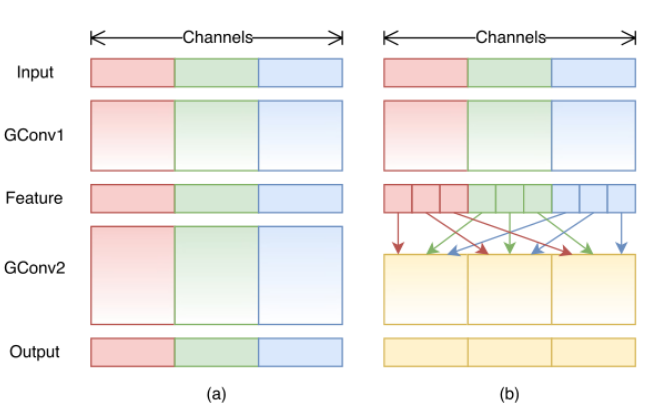

ShuffleNet

Group Convolution在 AlexNet 中引入,用于将模型分布到两块 GPU 上。但这样某个通道的输出只能来自一小部分输入通道,这样阻止了通道之间的信息流

打乱通道就能交流了

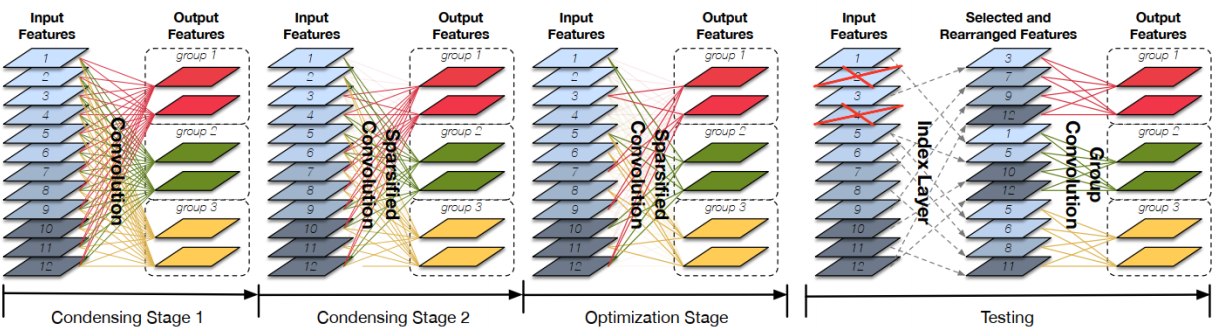

CondenseNet

分组卷积存在通道之间的信息沟通不畅以及特征多样性不足的问题。CondenseNet提出的解决策略是在训练的过程中让模型选择更好的分组方式

自学习分组卷积可以分成两个阶段:浓缩阶段和优化阶段。其中浓缩阶段用于剪枝没用的特征,优化阶段用于优化剪枝之后的网络。

浓缩时,在训练该网络时使用了分组lasso正则项,会有 1/C 的特征被剪枝掉

CondenseNet的剪枝并不是直接将这个特征删除,而是通过掩码的形式将被剪枝的特征置0,因此在训练的过程中CondenseNet的时间并没有减少,反而会需要更多的显存用来保存掩码

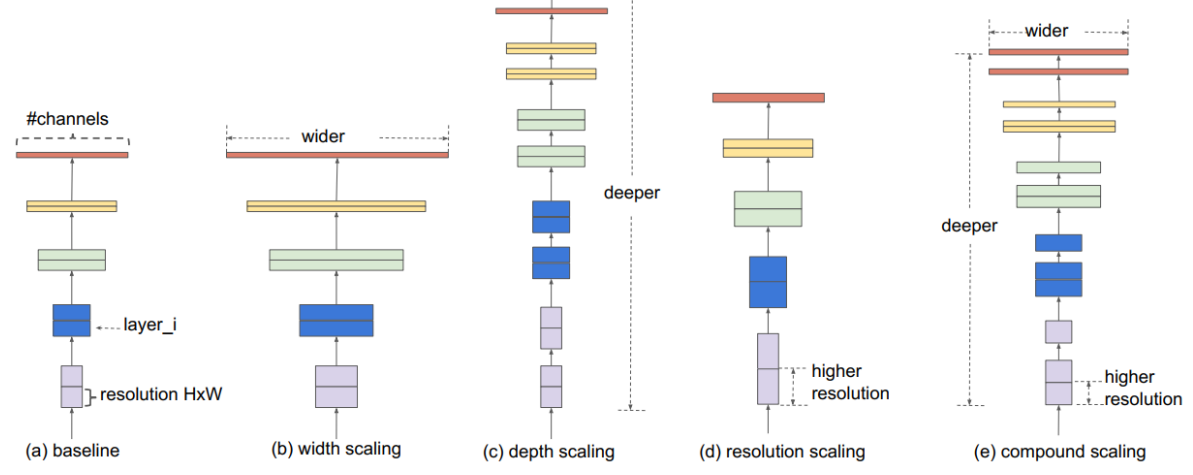

EfficientNet

用NAS调模型宽度和深度

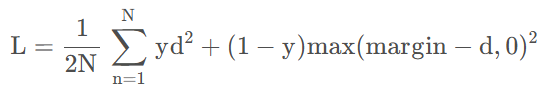

间隔损失

contrastive loss

其中d代表两个样本特征的欧氏距离,y为两个样本是否匹配的标签,y=1代表两个样本相似或者匹配,y=0则代表不匹配。margin为设定的阈值,这种损失函数主要是用在降维中,即本来相似的样本,在经过降维(特征提取)后,在特征空间中,两个样本仍旧相似;而原本不相似的样本,在经过降维后,在特征空间中,两个样本仍旧不相似。

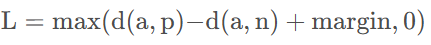

Triplet Loss

输入是一个三元组 <a, p, n>

- a: anchor,表示一个基准样本

- p: positive, 与 a 是同一类别的样本,比如就是同一个人的照片

- n: negative, 与 a 是不同类别的样本,比如就是不同人的照片

希望让a和p的距离尽可能小,而a和n的距离尽可能大

Center Loss

为了解决open set问题,即当训练集和测试集的类别不完全相同的情况

通过MSE做类似聚类的loss,保证最小化类内距离的同时保证特征可分,来提高特征之间的可判别性

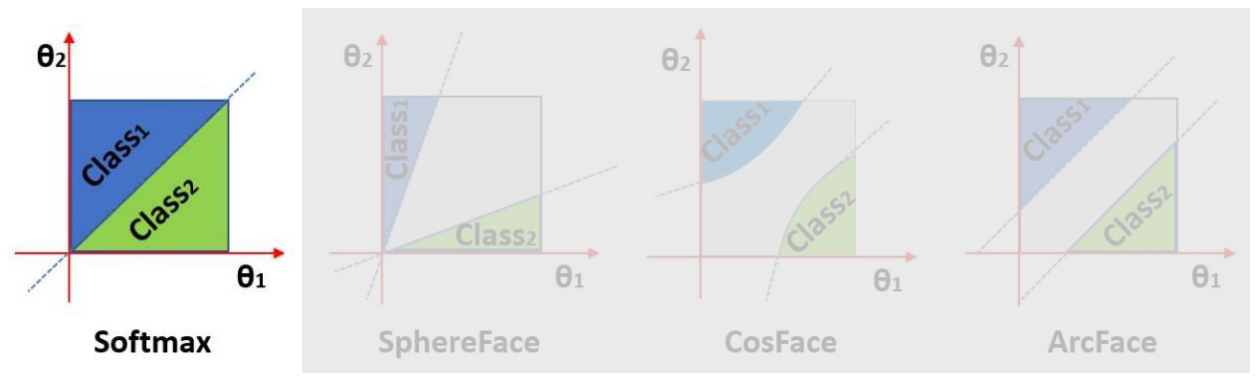

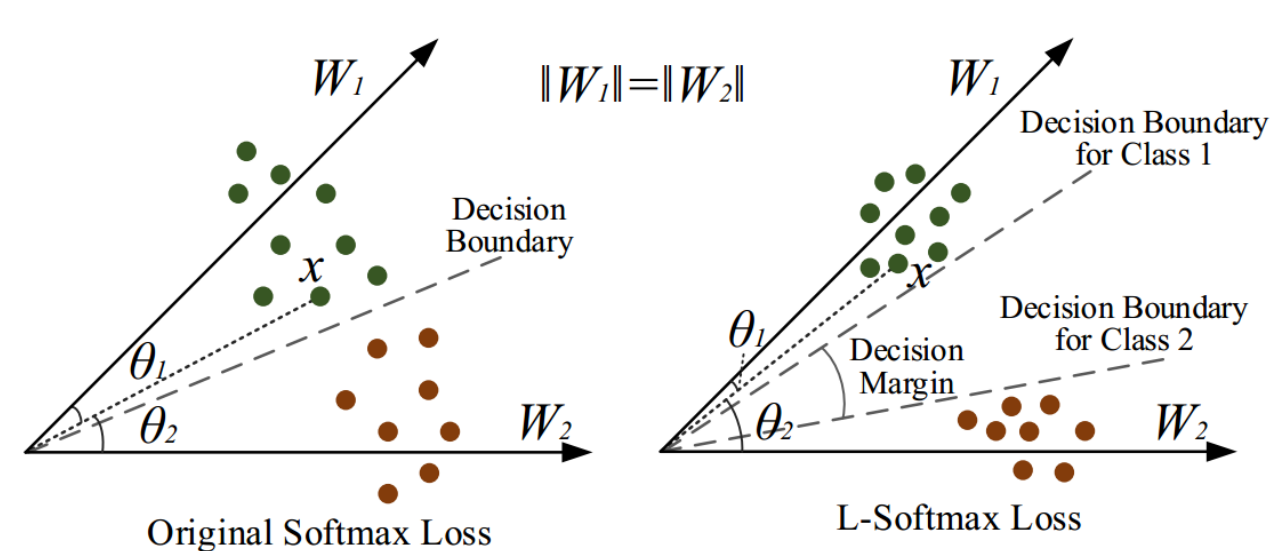

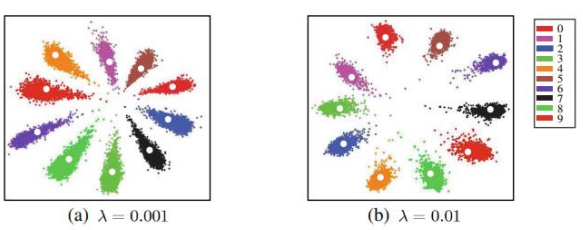

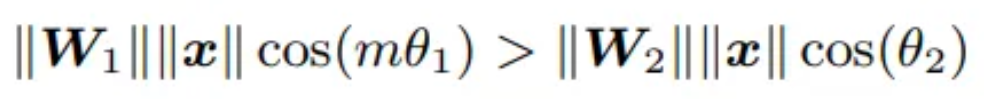

L-Softmax

在softmax基础上将 theta 1 乘以正整数m

m越大,决策间隔越大

Modified Softmax

限制了一些条件:∥Wi∥=1,bi=0,由这些条件,可以得到修正的损失函数