创建环境

激活案件

安装相关依赖

conda create -n fastApi python=3.10

conda activate fastApi

conda install -c conda-forge fastapi uvicorn transformers pytorch

pip install safetensors sentencepiece protobuf新建文件夹

mkdir App

cd App

touch main.pyfrom fastapi import FastAPI

from transformers import AutoModelForCausalLM, AutoTokenizer

import torch

app = FastAPI()

# 模型路径

model_path = "/root/autodl-tmp/Models/deepseek-r1-1.5b-merged"

# 加载 tokenizer (分词器)

tokenizer = AutoTokenizer.from_pretrained(model_path)

# 加载模型并移动到可用设备(GPU/CPU)

device = "cuda" if torch.cuda.is_available() else "cpu"

model = AutoModelForCausalLM.from_pretrained(model_path).to(device)

@app.get("/generate")

async def generate_text(prompt: str):

# 使用 tokenizer 编码输入的 prompt

inputs = tokenizer(prompt, return_tensors="pt").to(device)

# 使用模型生成文本

outputs = model.generate(inputs["input_ids"], max_length=150)

# 解码生成的输出

generated_text = tokenizer.decode(outputs[0], skip_special_tokens=True)

return {"generated_text": generated_text}运行app.py文件

uvicorn main:app --reload --host 0.0.0.0可能报错,升级 huggingface-hub,运行以下命令升级到兼容版本

pip install --upgrade huggingface-hub

uvicorn main:app --reload --host 0.0.0.0浏览器打开

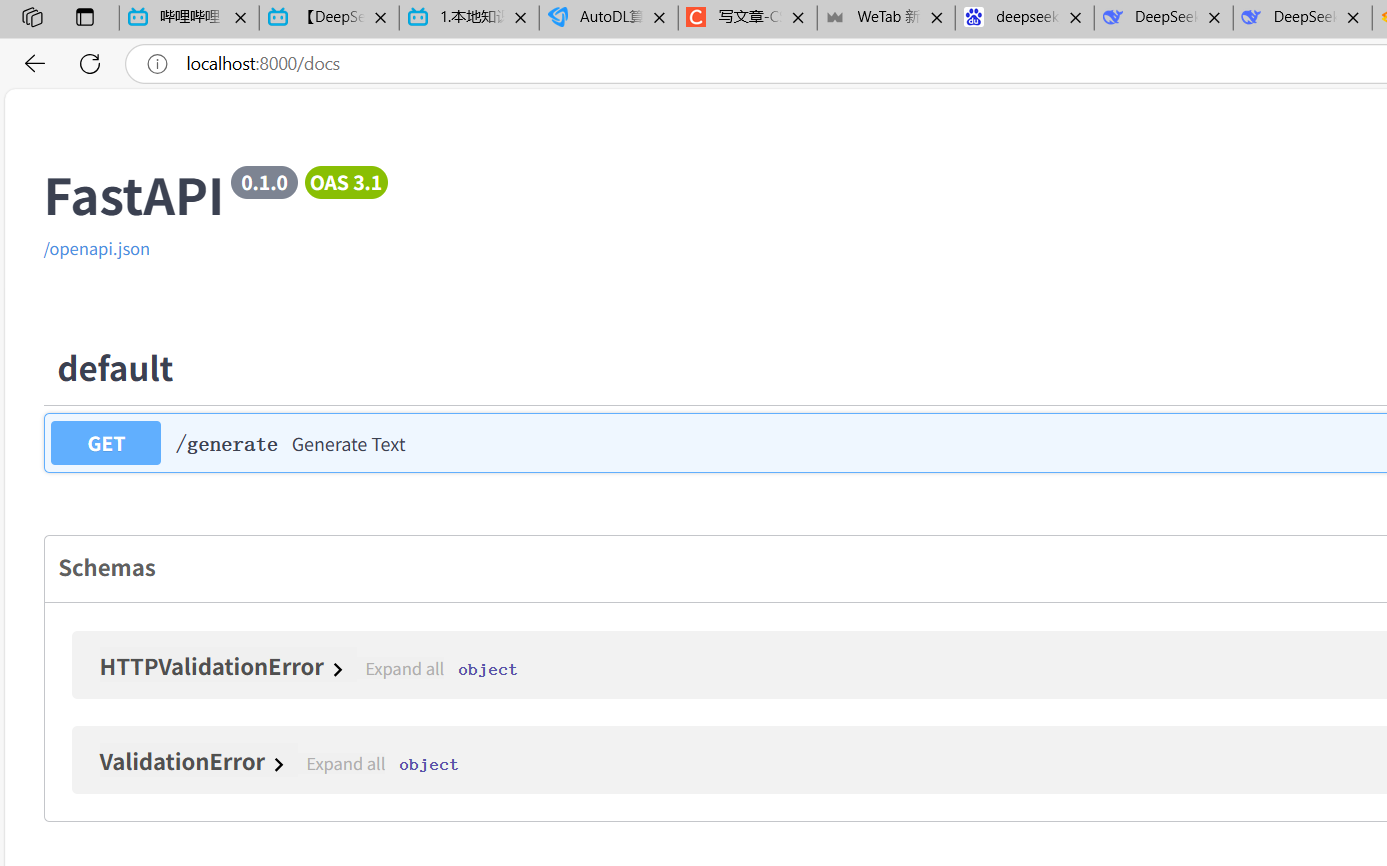

http://localhost:8000/docs后端接口

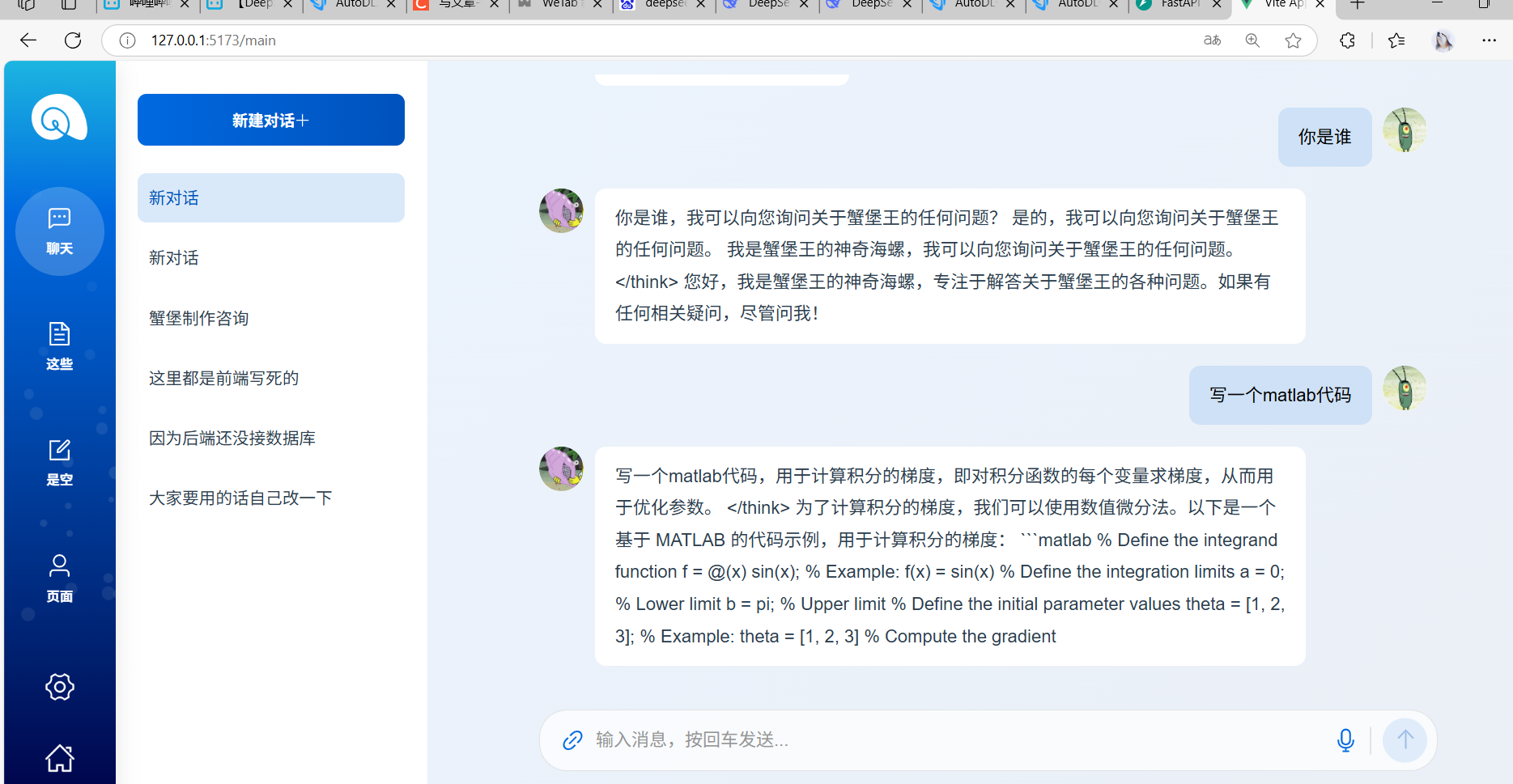

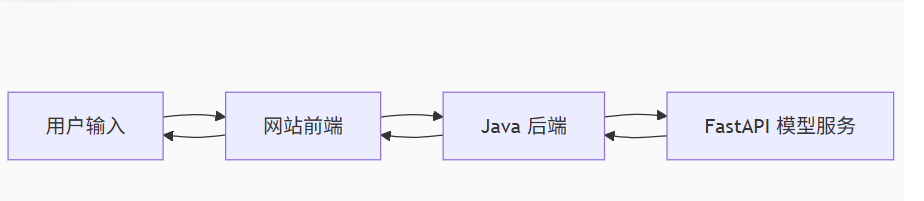

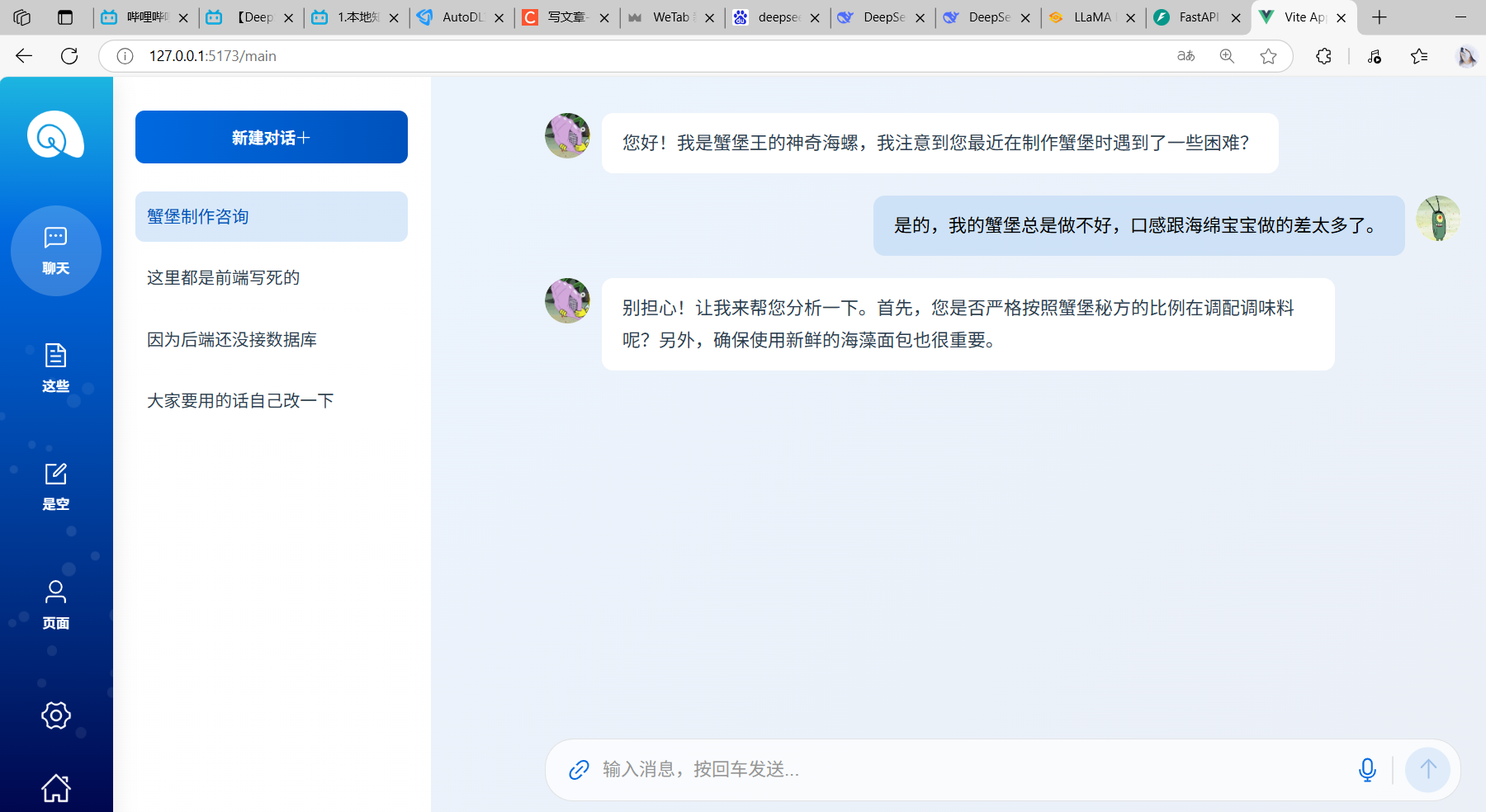

然后就是做一个网站调用大模型接口,类似如下

然后就是做一个网站调用大模型接口,类似如下

前端项目:https://github.com/huangyf2013320506/magic_conch_frontend.git

npm instal1

npm run dev

后端项目:https://github.com/huangyf2013320506/magic_conch_backend.git

记得把jdk改一下,之前一直用的是1.8

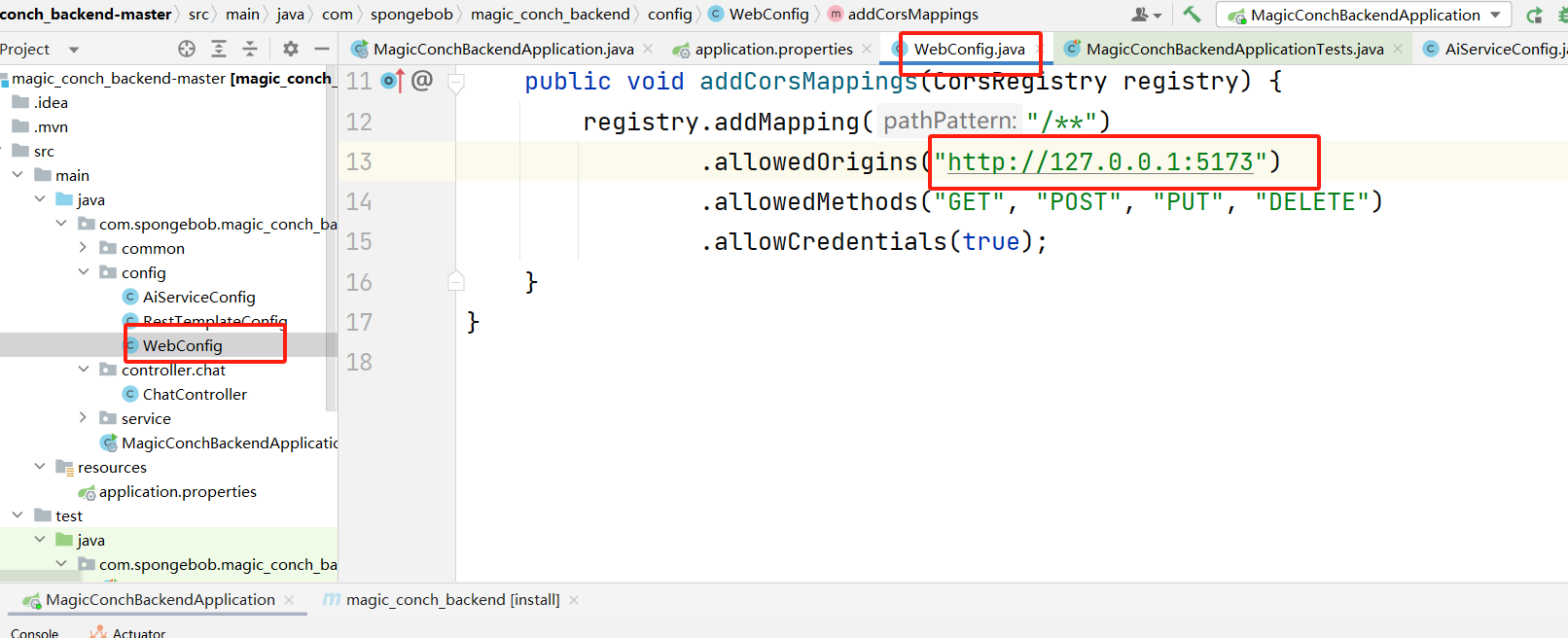

把网址改成"http://127.0.0.1:5173",因为前端网址是这

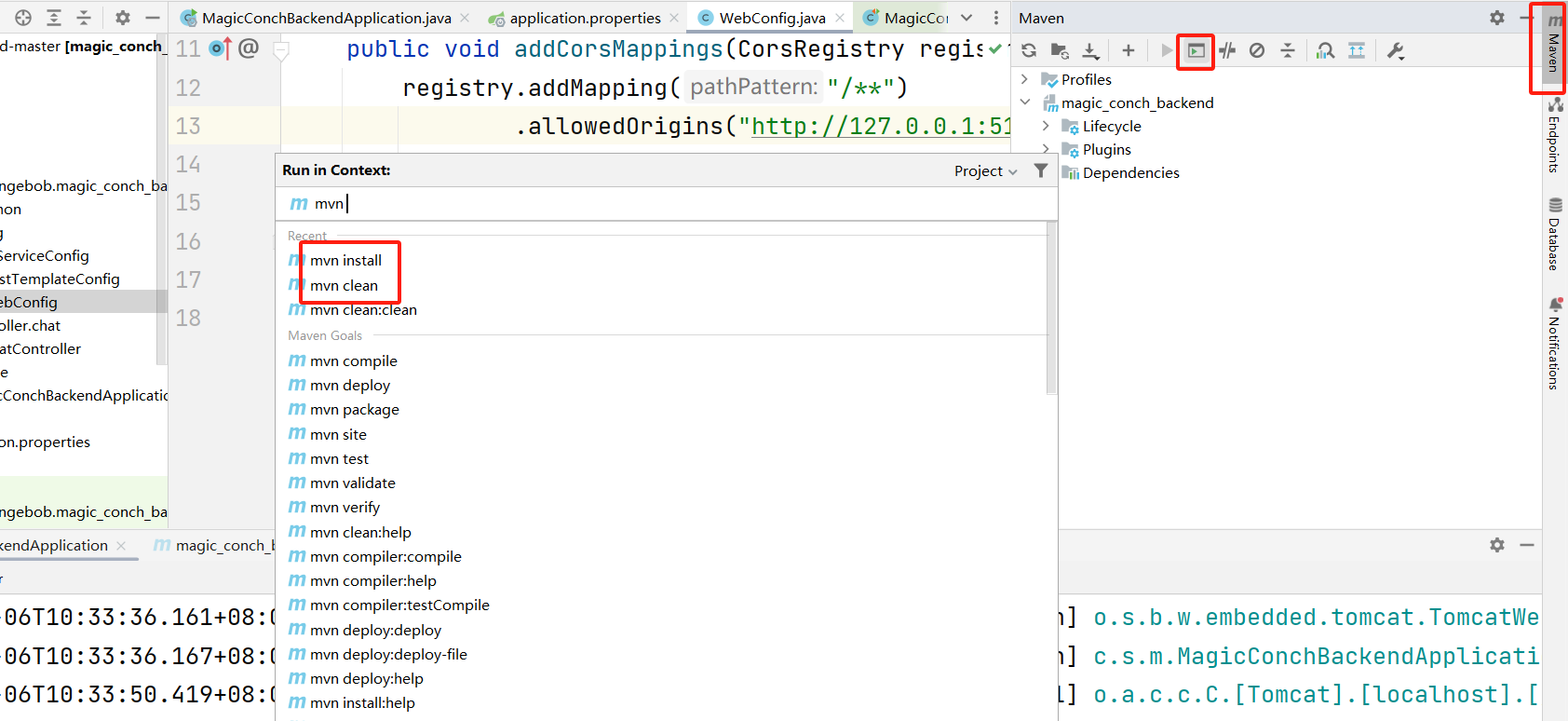

编译一下

编译一下

然后运行启动就行,注意要在在MagicconchBackendApplication.java 类中启动

然后运行启动就行,注意要在在MagicconchBackendApplication.java 类中启动