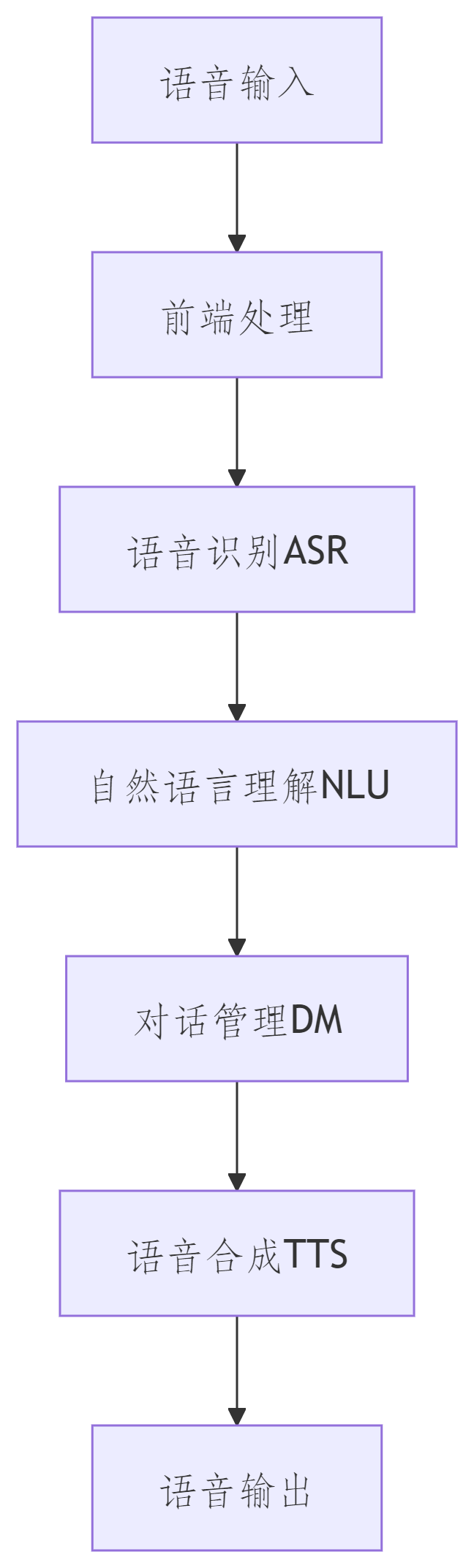

一、现代语音交互技术栈剖析

1. 核心组件架构

2. 全链路Java实现示例

java

// 语音交互处理管道

public class VoiceInteractionPipeline {

private AudioPreprocessor preprocessor;

private ASREngine asrEngine;

private NLUProcessor nluProcessor;

private DialogManager dialogManager;

private TTSEngine ttsEngine;

public String process(String audioInput) {

// 1. 音频预处理

AudioData processedAudio = preprocessor.process(audioInput);

// 2. 语音识别

String transcript = asrEngine.transcribe(processedAudio);

// 3. 语义理解

Intent intent = nluProcessor.understand(transcript);

// 4. 对话管理

Response response = dialogManager.handle(intent);

// 5. 语音合成

AudioData output = ttsEngine.synthesize(response);

return output;

}

}二、关键技术深度解析

1. 实时语音处理优化

java

# 基于WebRTC的实时语音处理

import webrtcvad

class RealTimeProcessor:

def __init__(self):

self.vad = webrtcvad.Vad(3) # 激进模式

def process_frame(self, frame):

is_speech = self.vad.is_speech(frame, sample_rate=16000)

if is_speech:

# 发送到ASR引擎

asr_result = asr_engine.process(frame)

return asr_result

return None

# 使用示例

processor = RealTimeProcessor()

audio_stream = get_audio_stream()

for frame in audio_stream:

result = processor.process_frame(frame)

if result:

handle_transcript(result)2. 多模态交互实现

java

// 结合视觉和语音的多模态交互

class MultimodalInterface {

constructor() {

this.faceDetector = new FaceApi();

this.voiceRecognizer = new VoiceRecognizer();

}

async processInteraction() {

const [faceResult, voiceResult] = await Promise.all([

this.faceDetector.detectEmotion(),

this.voiceRecognizer.recognize()

]);

if(faceResult.emotion === 'angry' && voiceResult.tone === 'high') {

return this.generateCalmResponse();

}

return this.dialogManager.generateResponse(voiceResult.text);

}

}三、行业解决方案剖析

1. 智能客服系统集成

java

// 基于Spring的智能客服控制器

@RestController

@RequestMapping("/voicebot")

public class VoiceBotController {

@Autowired

private VoiceService voiceService;

@PostMapping("/query")

public ResponseEntity<byte[]> handleVoiceQuery(

@RequestParam("audio") MultipartFile audio) {

// 1. 语音识别

String query = voiceService.recognize(audio);

// 2. 业务处理

String response = businessService.process(query);

// 3. 语音合成

byte[] audioResponse = voiceService.synthesize(response);

return ResponseEntity.ok()

.contentType(MediaType.APPLICATION_OCTET_STREAM)

.body(audioResponse);

}

}2. 车载语音系统优化方案

java

// 车载环境下的语音增强处理

class CarVoiceEnhancer {

public:

AudioData process(AudioData input) {

// 1. 降噪处理

applyNoiseReduction(input);

// 2. 回声消除

applyEchoCancellation(input);

// 3. 波束成形

applyBeamforming(input);

return input;

}

private:

NoiseProfile carNoiseProfile;

EchoCanceller echoCanceller;

Beamformer beamformer;

};四、前沿趋势与挑战

1. 2023年技术风向标

-

情感识别:结合语音语调的情感分析

-

个性化声纹:用户自适应的语音交互

-

边缘智能:端侧实时语音处理

-

多语言混合:无缝切换的跨语言交互

2. 典型技术挑战

java

# 语音交互质量评估工具

class VoiceInteractionEvaluator:

@staticmethod

def evaluate_response(response):

metrics = {

'latency': response.end_time - response.start_time,

'accuracy': calculate_asr_accuracy(response),

'naturalness': predict_naturalness_score(response.audio)

}

return metrics

@staticmethod

def calculate_asr_accuracy(response):

# 实现WER计算逻辑

return wer(reference, hypothesis)五、开发实战建议

1. 性能优化checklist

java

// 语音交互性能监控组件

public class PerformanceMonitor {

private static final Map<String, Long> timers = new ConcurrentHashMap<>();

public static void startTimer(String phase) {

timers.put(phase, System.currentTimeMillis());

}

public static long endTimer(String phase) {

return System.currentTimeMillis() - timers.get(phase);

}

public static void logMetrics() {

System.out.println("性能指标:");

System.out.println("ASR延迟: " + endTimer("asr") + "ms");

System.out.println("NLU延迟: " + endTimer("nlu") + "ms");

System.out.println("TTS延迟: " + endTimer("tts") + "ms");

}

}2. 最佳实践指南

-

延迟优化:预处理与识别并行化

-

容错设计:语音指令的模糊匹配

-

上下文保持:对话状态管理

-

隐私保护:语音数据脱敏处理

结语:语音交互的未来之路

随着大模型技术的爆发,语音交互正从"能听会说"向"善解人意"演进。开发者需要关注:

-

多模态融合:结合视觉、触觉等多通道交互

-

认知智能:实现真正的语义理解

-

普惠接入:让技术适应各类用户群体

"未来五年,语音交互将像触摸屏一样成为智能设备的标配" ------ Amazon Alexa首席科学家

互动讨论:

你在开发语音交互应用时遇到过哪些挑战?是如何解决的?欢迎分享你的实战经验!