- 说明:ubuntu是虚拟机的,用的桥接模式,与本地同局域网不同ip地址。

参考VM虚拟机网络配置(ubuntu24桥接模式):配置静态IP - 前提:需要有docker及docker-compose环境

参考ubuntu24安装docker及docker-compose

源码下载

下载地址:https://github.com/langgenius/dify

切换到自己要存放该源码的目录下,拉取代码

shell

# 没有git就安装一下

# 1.首先更新软件包列表

sudo apt update

# 2.安装git

sudo apt install git

# 3.查看git版本

git --version

# 拉取

git clone https://github.com/langgenius/dify.git修改.env环境配置信息

dify/docker目录下,直接copy就行

shell

cp .env.example .env拉取镜像并运行容器

dify/docker目录下

shell

docker-compose up -d

# 启动后查看下

docker ps

访问(默认80端口)

- 注册并登录

本机的话直接localhost即可

首次访问会让注册账号,我这里已经注册过了,所以显示登录界面。

添加ollama模型供应商

.env配置Ollama的API地址

在dify/docker下.env文件最后添加以下配置

.env

# 启用自定义模型

CUSTOM_MODEL_ENABLED=true

# 指定Ollama的API地址(根据实际部署环境调整IP)

OLLAMA_API_BASE_URL=http://192.168.XX.XX:11434关闭并重启docker

shell

docker-compose down

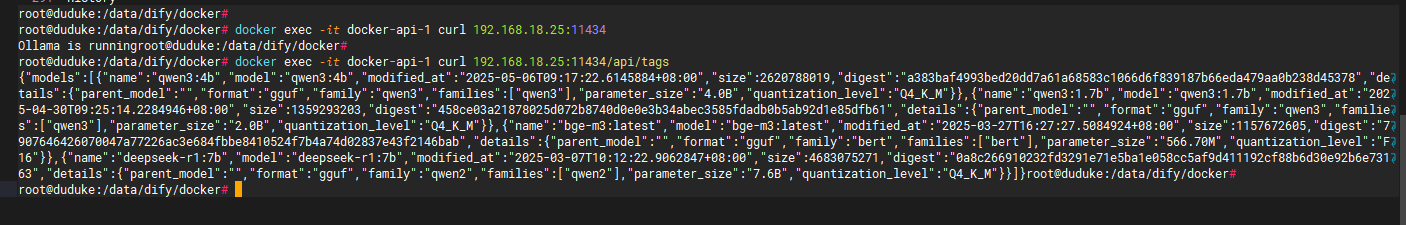

docker-compose up -d测试docker是否能访问ollama

我本地ollama的模型

docker测试是否能调用ollama:

shell

# 192.168.18.25:11434切换成自己ollama的ip地址

docker exec -it docker-api-1 curl 192.168.XX.XX:11434/api/tags

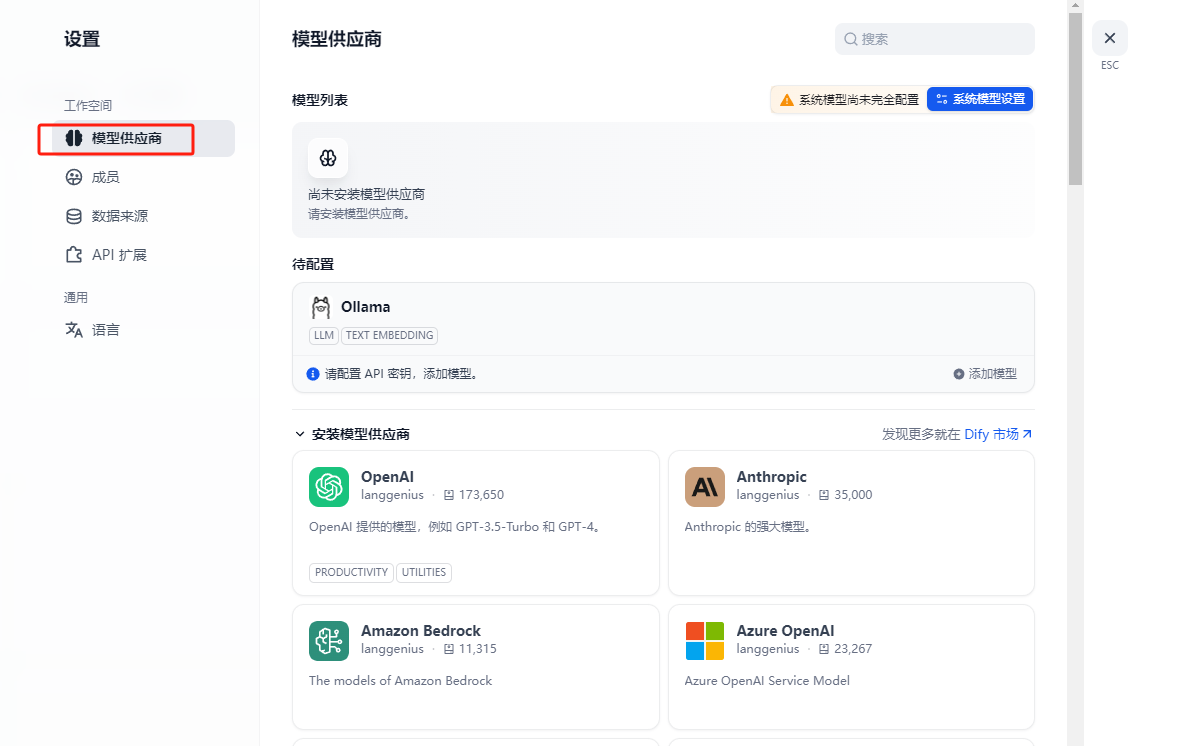

配置ollama

右上角-设置-模型供应商-安装模型供应商:找到ollama并安装,安装完之后可以在上方待配置处看到

(我下载的这个dify版本,需要点击两次安装才能安装成功)

配置相应的ollama模型,并保存。