📄论文题目:RoboBrain: A Unified Brain Model for Robotic Manipulation from Abstract to Concrete

✍️作者及机构:Yuheng Ji、Huajie Tan、Jiayu Shi 等(北京大学、北京人工智能研究院、中国科学院自动化研究所等机构)12

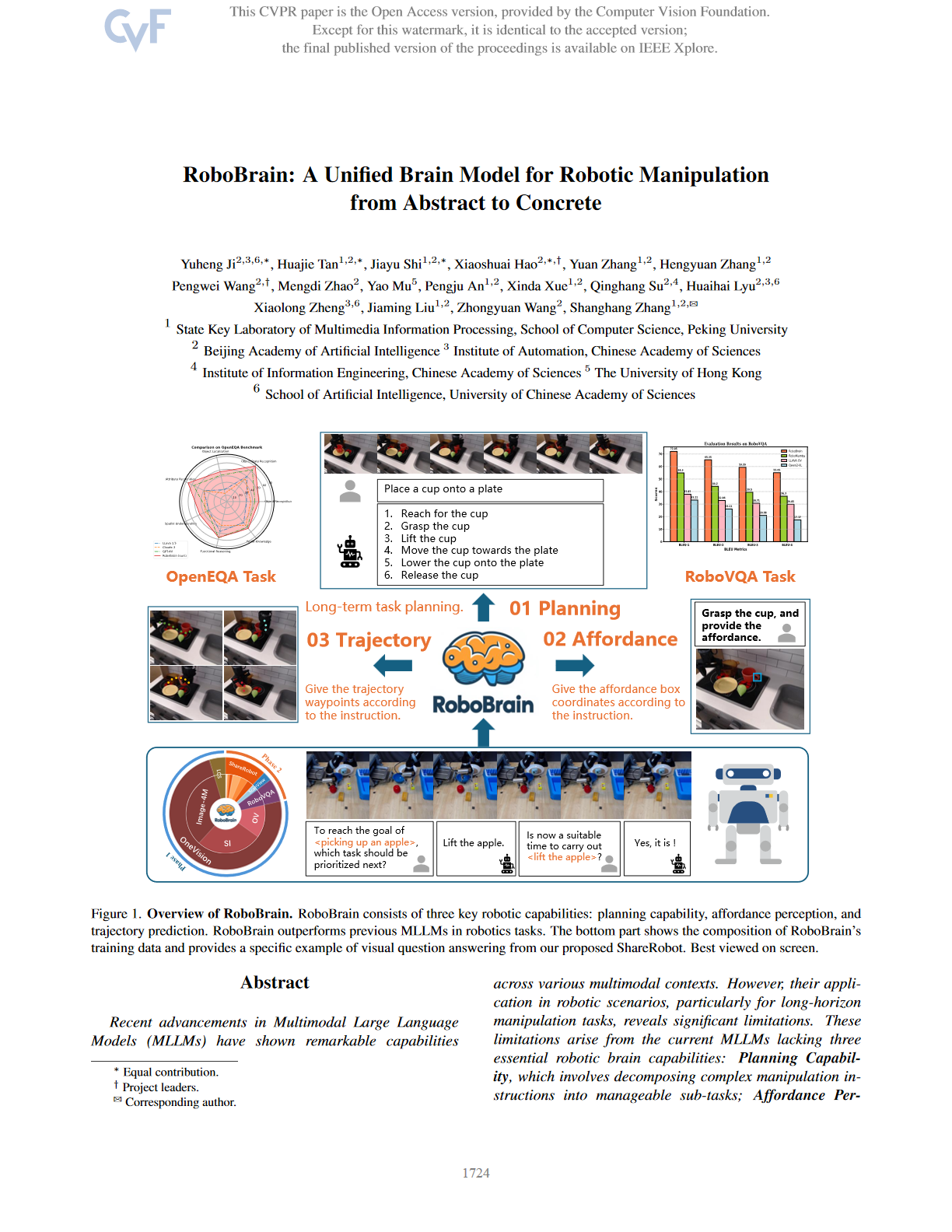

🧩面临问题:当前多模态大语言模型(MLLMs)在机器人长程操作任务中存在显著局限。一方面,缺乏将复杂操作指令分解为子任务的规划能力;另一方面,难以识别物体可操作区域(Affordance 感知)和预测完整操作轨迹,核心原因是缺乏专门针对机器人操作的大规模细粒度数据集345。

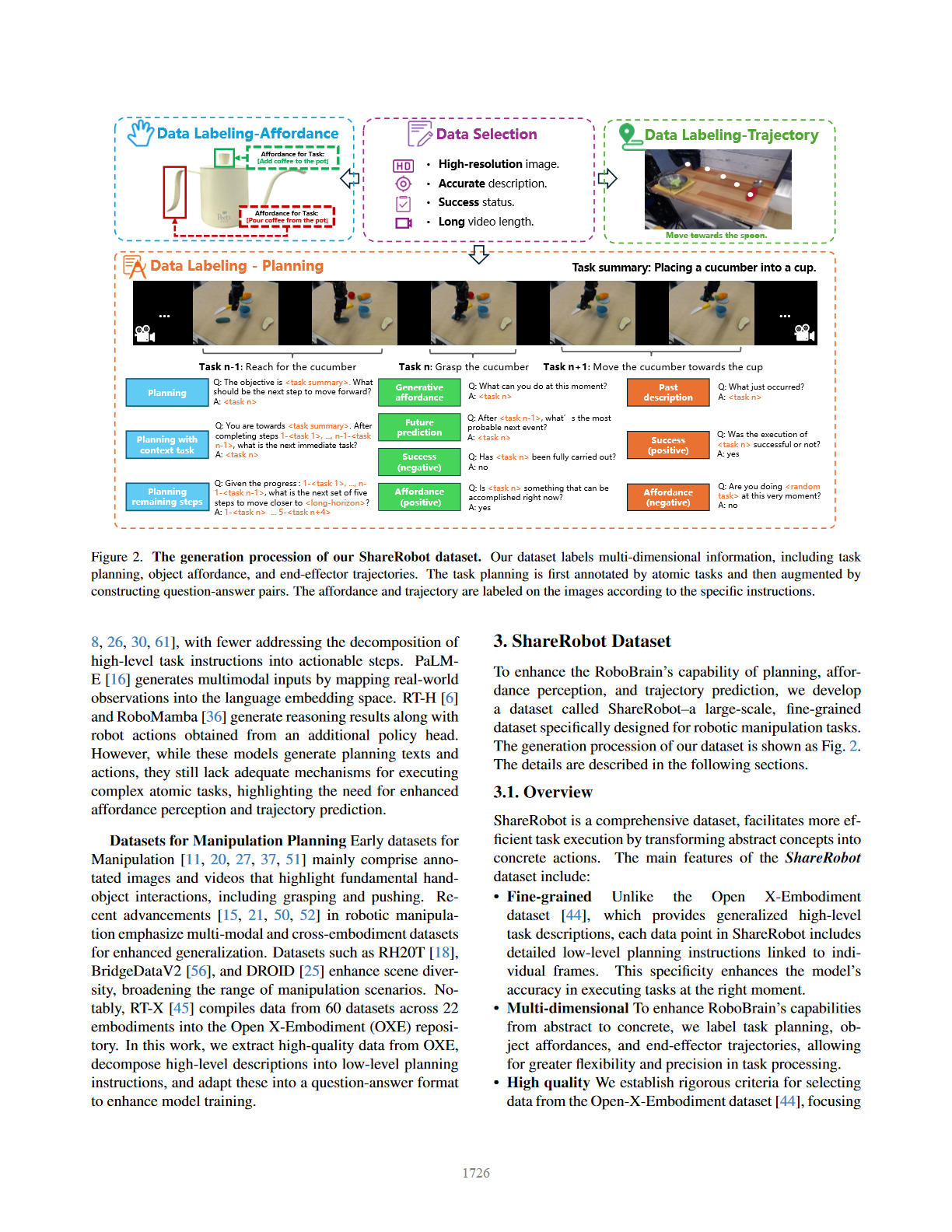

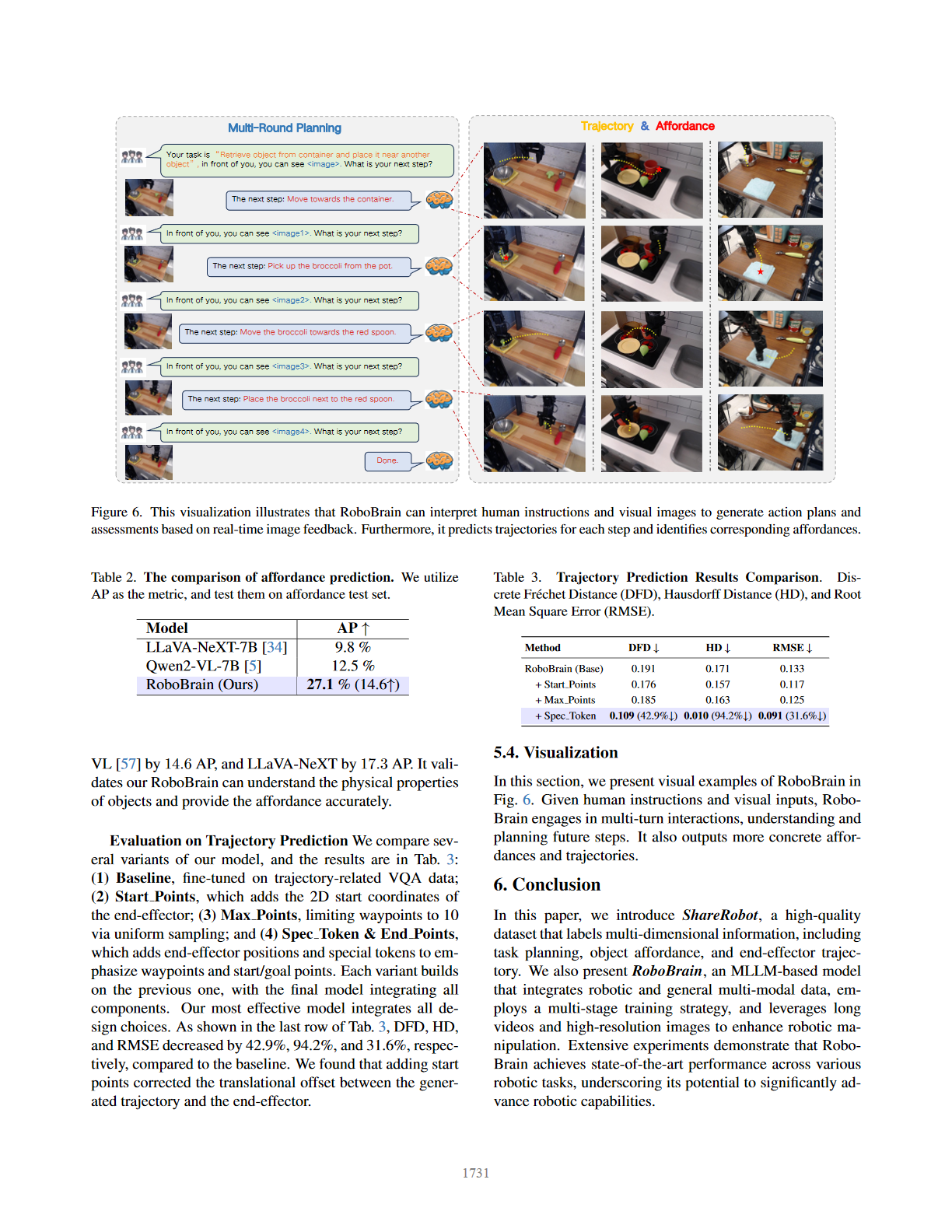

🎯创新点及其具体研究方法:

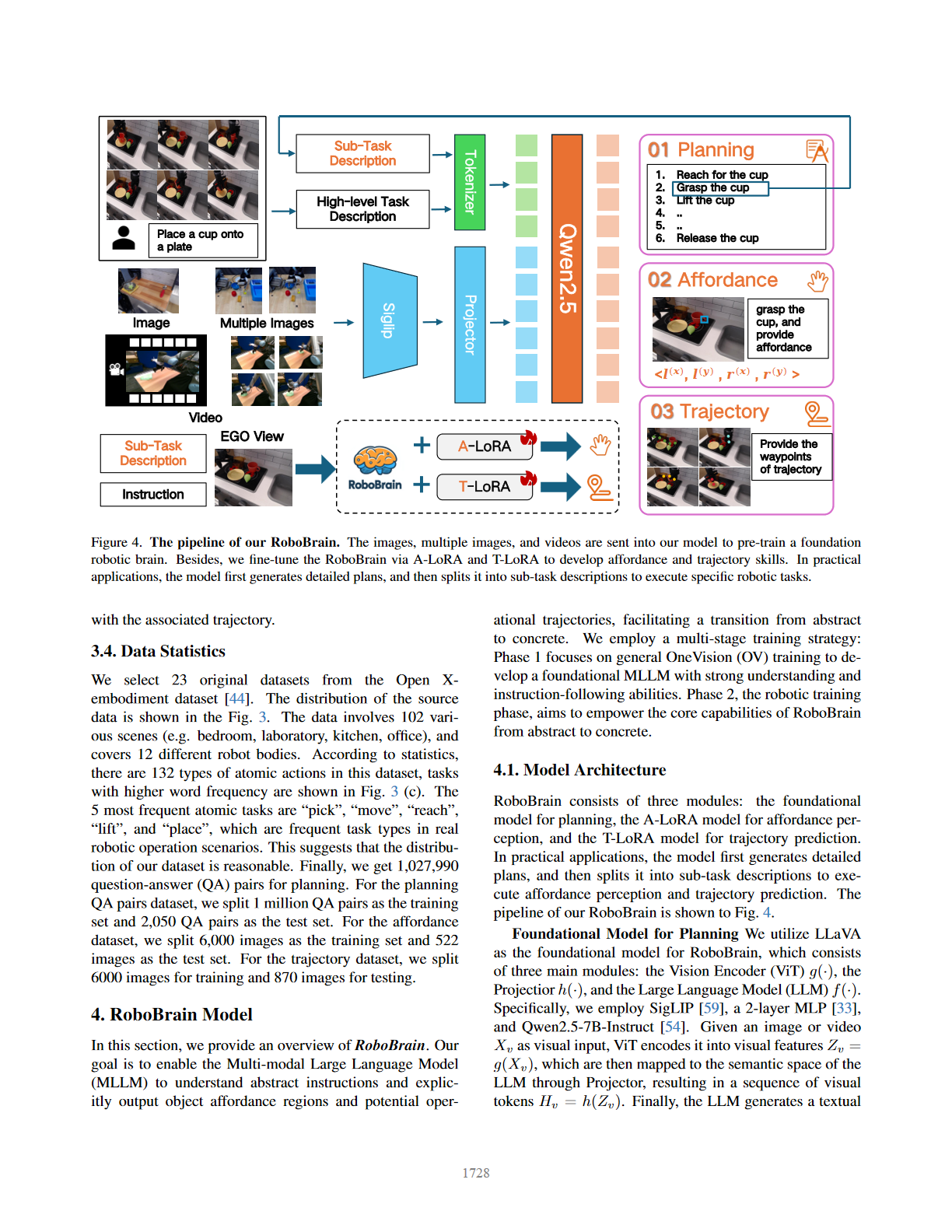

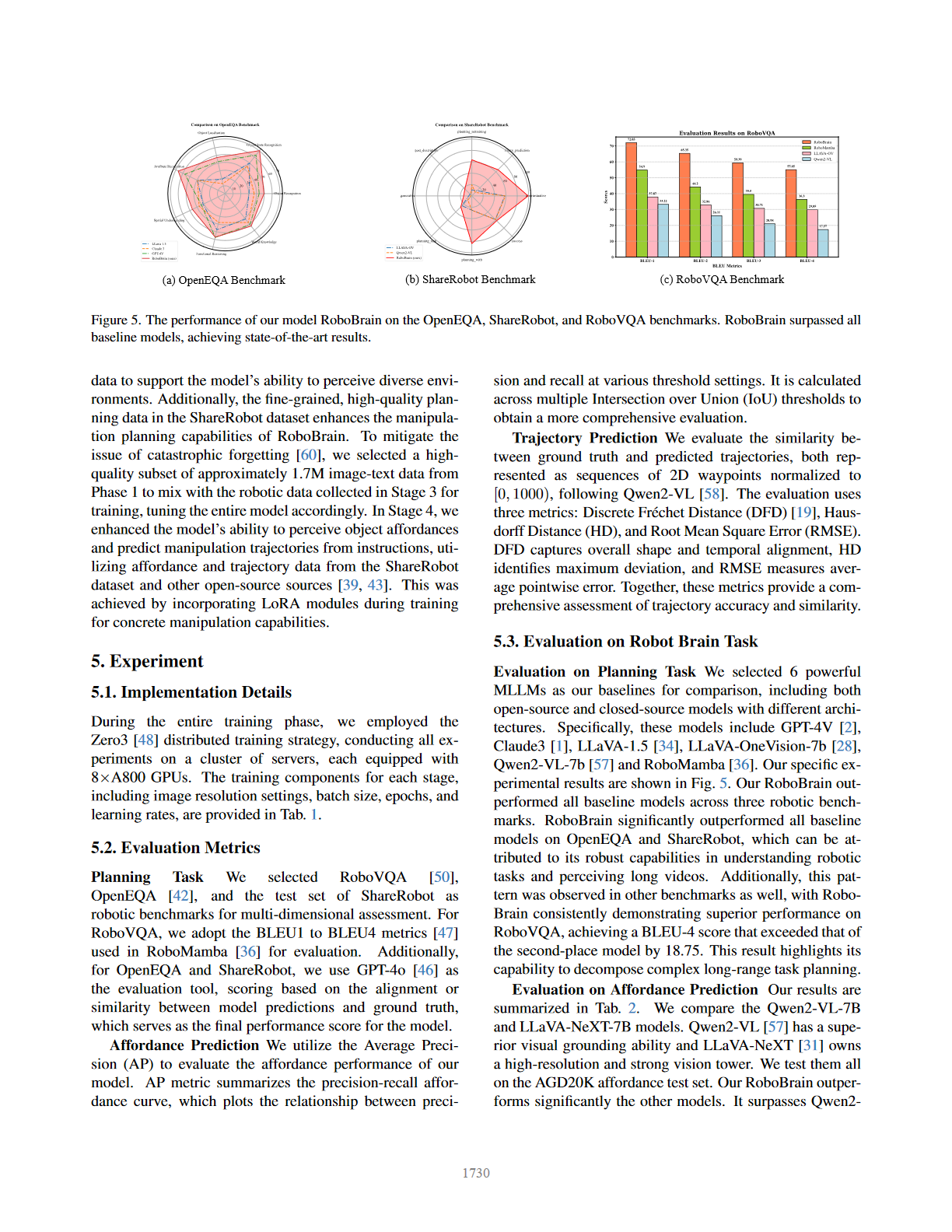

1️⃣ 提出 RoboBrain 统一模型:基于 LLaVA 架构,整合三大核心模块实现从抽象指令到具体动作的转化。包括用于任务规划的基础模型(采用 SigLIP 视觉编码器和 Qwen2.5-7B 语言模型)、A-LoRA 模块(输出物体可操作区域坐标)和 T-LoRA 模块(预测轨迹关键点的 2D 坐标序列)13141718。

2️⃣ 多阶段训练策略:分两阶段提升模型能力。Phase 1(通用 OV 训练)利用 LCS558K 等图像文本数据、单图及视频数据,培养通用多模态理解与指令遵循能力;Phase 2(机器人训练)融入 3M 机器人数据(含 ShareRobot 子集),通过 A-LoRA 和 T-LoRA 微调 Affordance 感知与轨迹预测能力,同时混合 Phase 1 优质数据避免灾难性遗忘15192021。

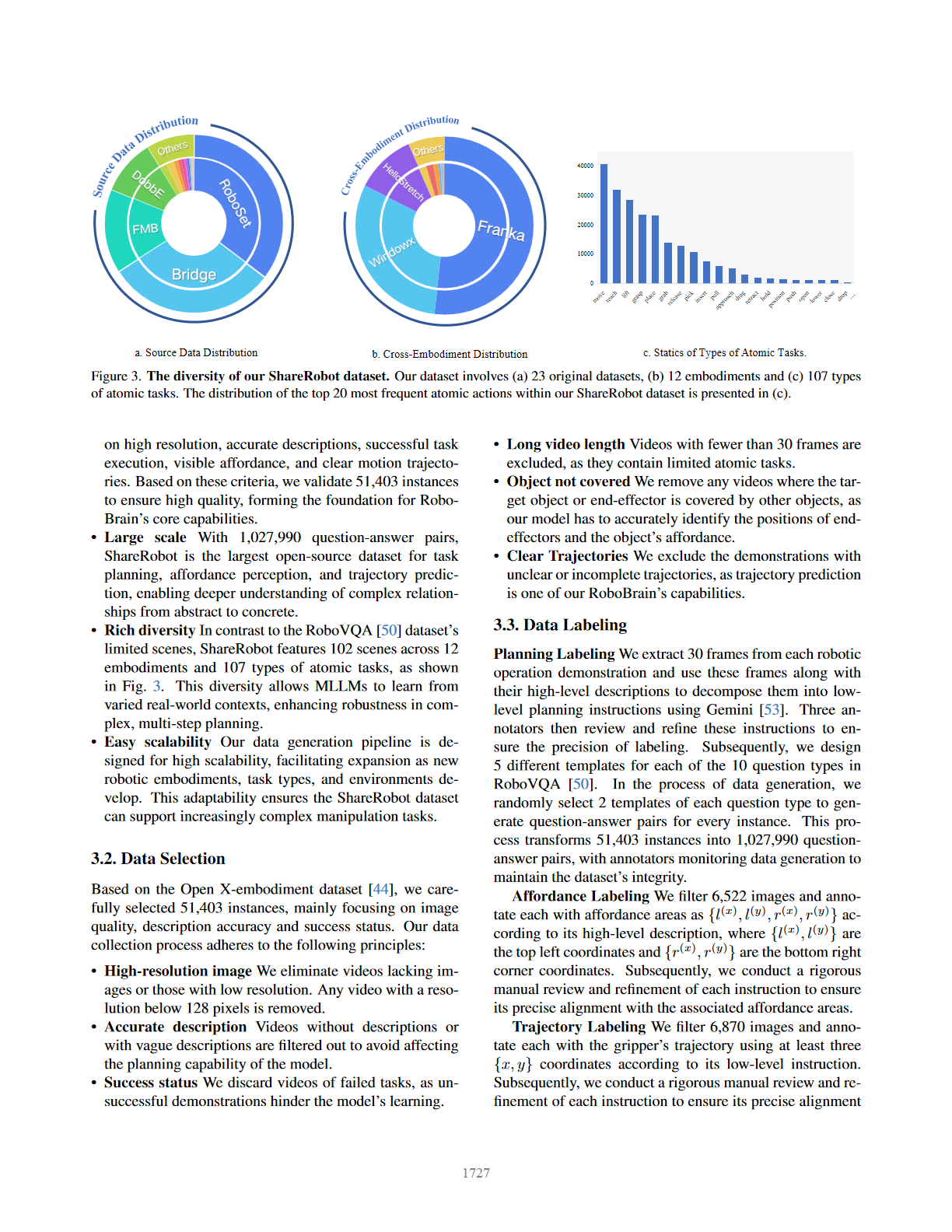

3️⃣ 构建 ShareRobot 高质量数据集:从 Open X-Embodiment 筛选 51,403 个实例,标注多维度信息。任务规划方面拆分为 107 种原子任务,生成 1,027,990 个 QA 对;Affordance 标注 6,522 张图像的可操作区域坐标;轨迹标注 6,870 张图像的机械臂运动关键点,且数据集具备细粒度、多维度、高质量等特点6789。

#论文精读 #机器人学 #多模态大语言模型 #计算机视觉 #深度学习 #机器人操作 #CVPR 顶会 #开源数据集