本文较长,建议点赞收藏,以免遗失。更多AI大模型开发学习视频籽料,

都在这>>Github<<

「Foundations of Large Language Models」 📚,无论你是一名想继续深入学习大模型的 LLM Engineer,还是刚入门的大模型小白,这本书都可以作为你日常学习的基础书籍。

本书来自:东北大学自然语言处理实验室 Tong Xiao/肖桐 and Jingbo Zhu/朱靖波

本书旨在概述大型语言模型的基本概念并介绍相关技术。全文分为 Pre-trainning, Generative Models, Prompting, Alignment 四个大章节:

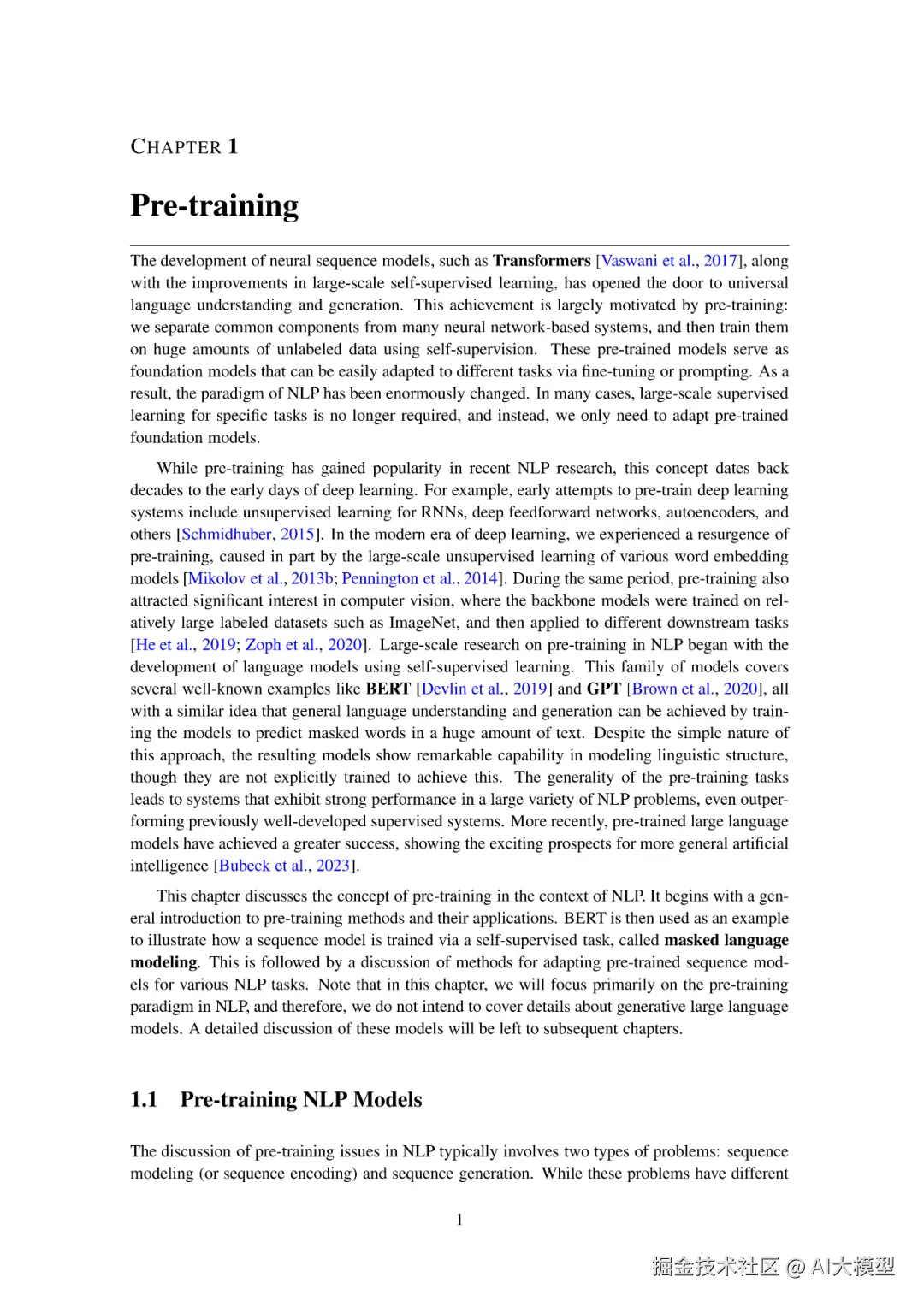

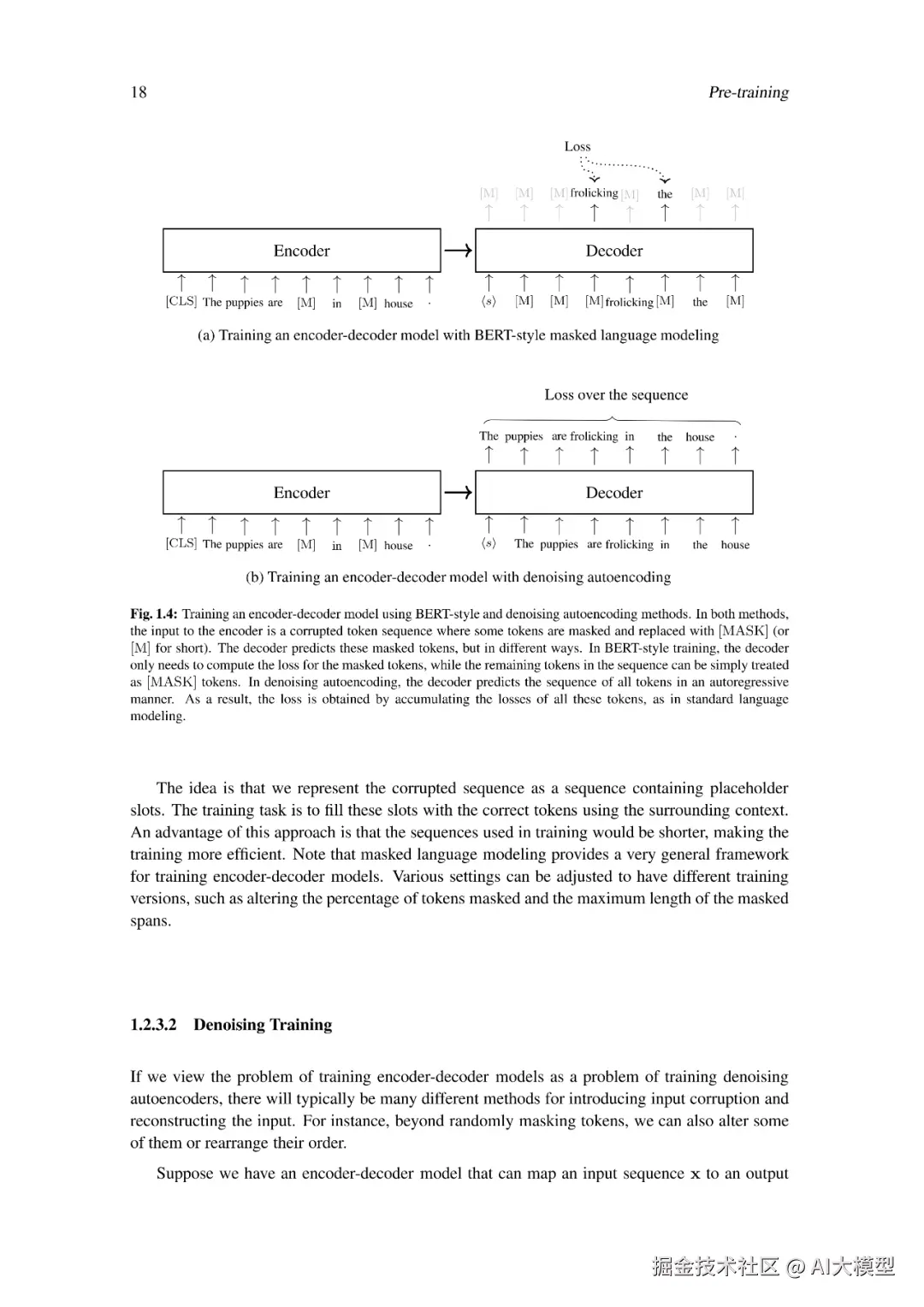

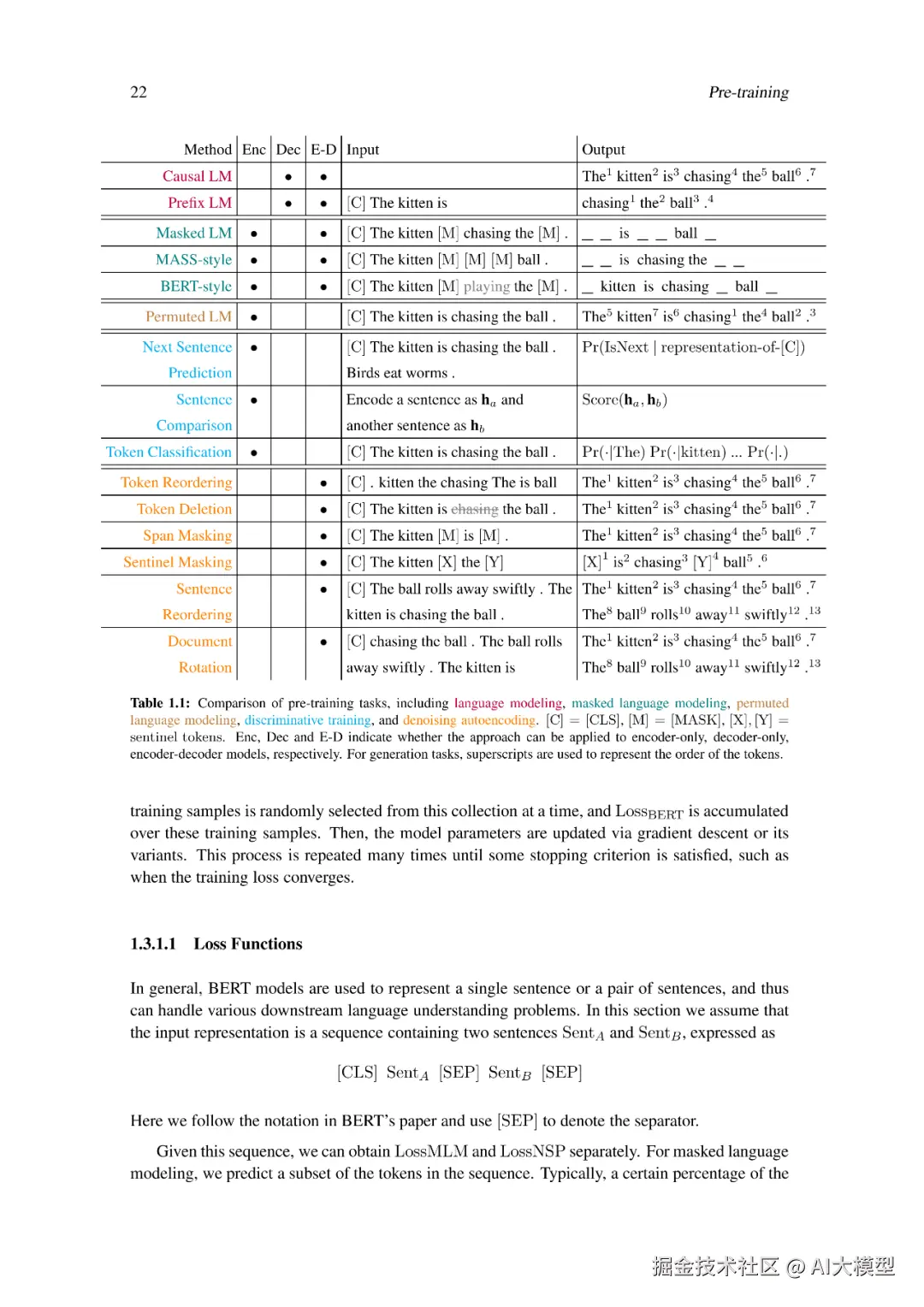

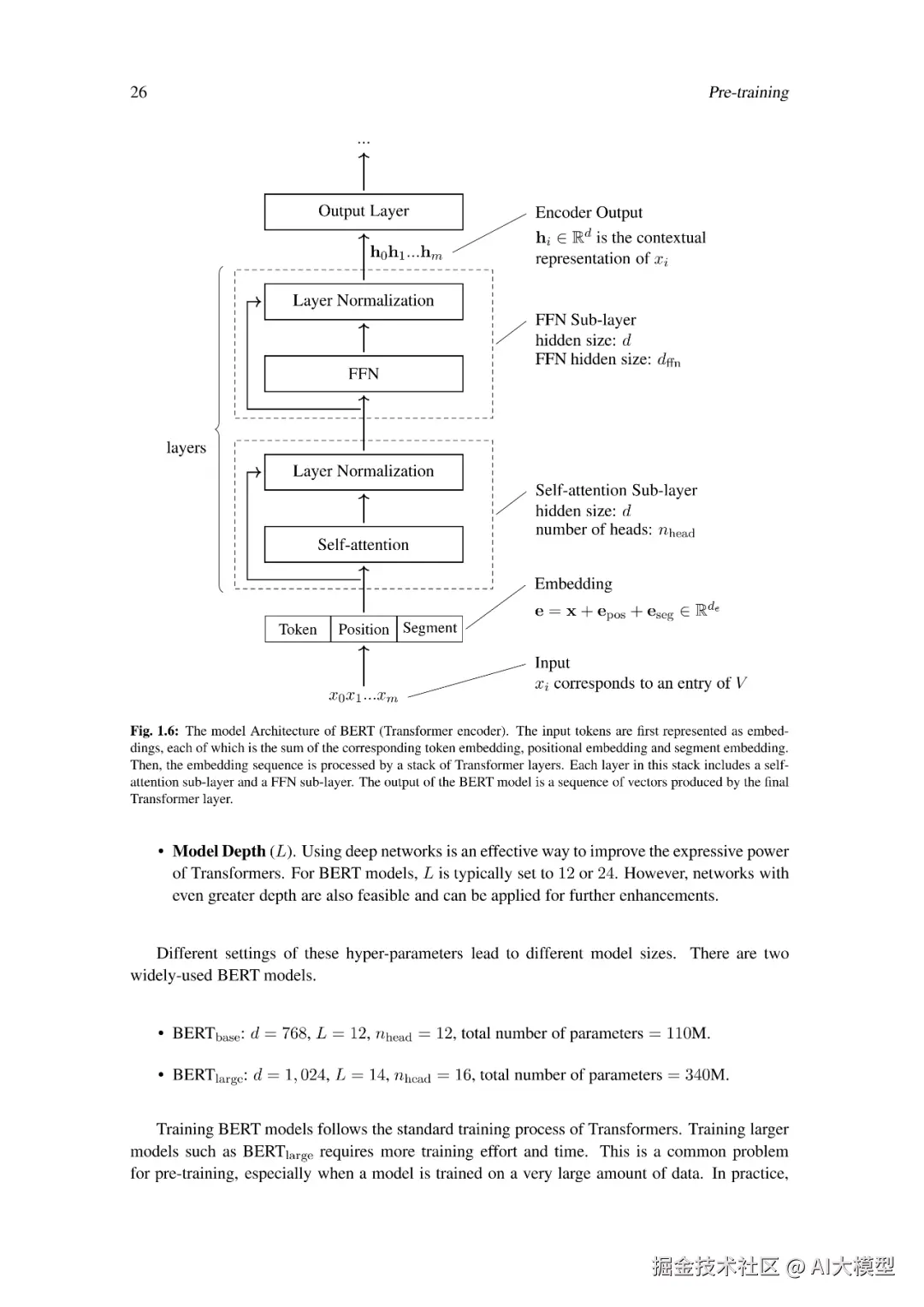

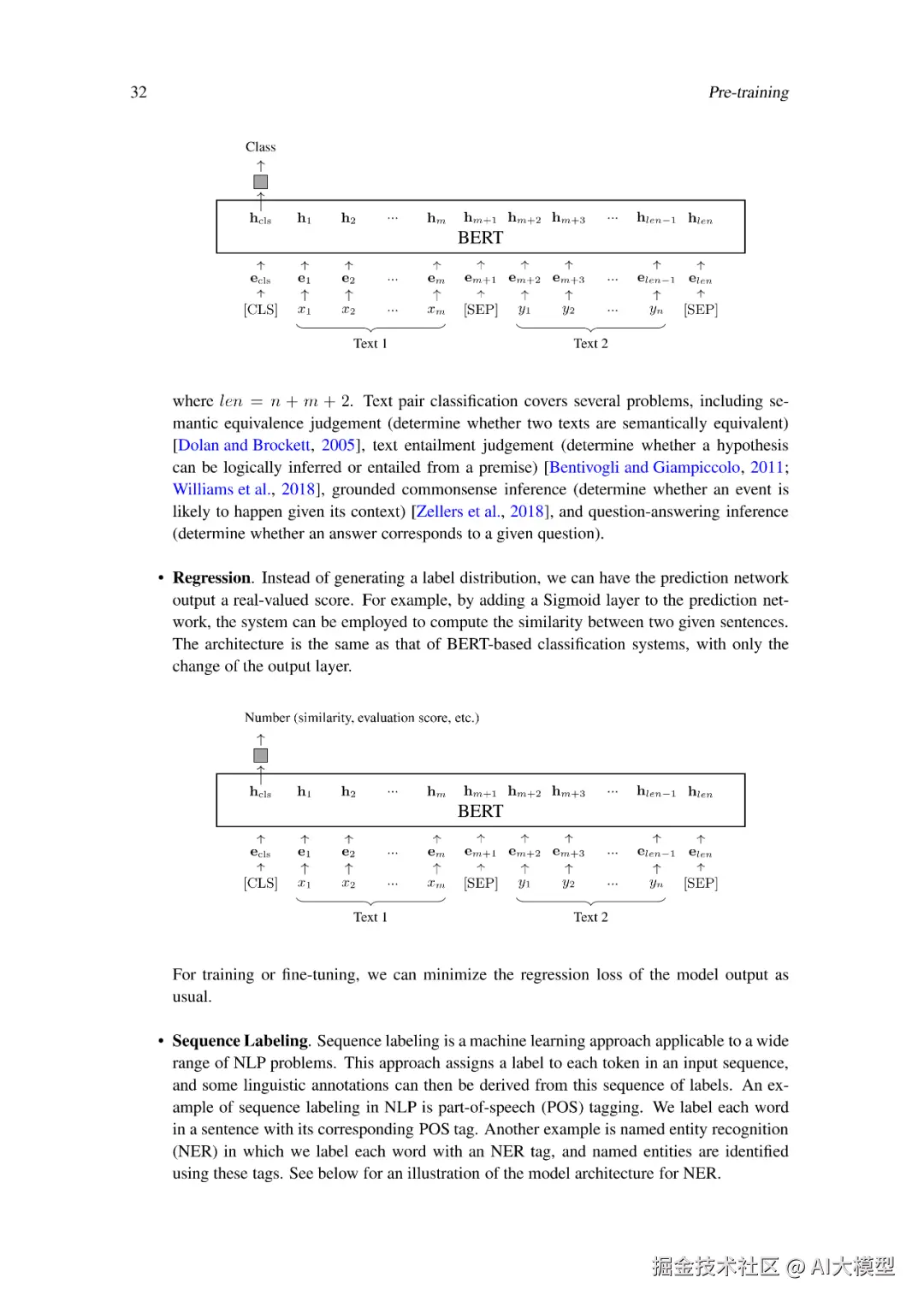

- 第 1 章:介绍预训练的基础知识。这是大型语言模型的核心基础,其中会讨论常见的预训练方法和模型架构。

- 第 2 章:介绍生成式模型,也就是我们通常所指的大型语言模型。在阐述构建这些模型的基本过程后,还将探讨如何扩展模型训练规模及处理长文本。

- 第 3 章:介绍大型语言模型的提示方法。将讨论各种提示策略,以及诸如链式推理和自动提示设计等更高级的方法。

- 第 4 章:介绍大型语言模型的对齐方法。本章的重点是基于人类反馈的指令微调与对齐技术。

完全符合大模型的 lifecycle,可以帮助大家建立结构化的知识架构,避免知识碎片化, 正如书名所示,本书更关注大型语言模型的基础方面,而非全面覆盖所有前沿方法。

如果读者具备一定的机器学习和自然语言处理背景,并对诸如 Transformer 等神经网络有一定了解,那么阅读本书将非常轻松。然而,即使没有相关基础知识也无妨,因为作者力求使每一章的内容尽可能自成体系,确保读者不会因阅读难度过大而感到负担。

整个的排版非常劲道,内容专业度自不必说,更为难得的是其配图全部是 TikZ 绘制而成,这是你如果做书稿排版非常不可多得的排版样例,不管你是要出版英文书籍,博士论文等,都是非常棒的参考素材。Happy LaTeXing!~

获取方式

更多AI大模型开发学习视频籽料,都在这>>Github<<

更多AI大模型开发学习视频籽料,都在这>>Github<<