英伟达直接把服务器级别的算力塞进了机器人体内。

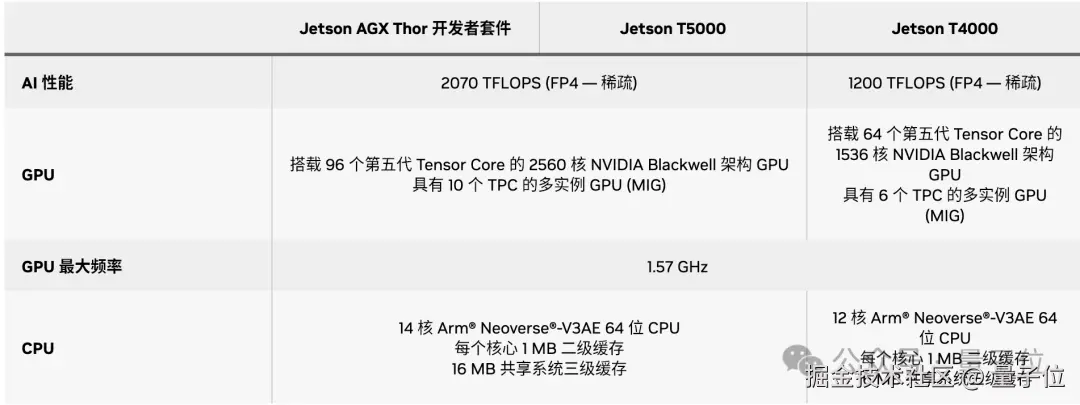

全新的机器人计算平台 Jetson Thor 正式发售,基于最新的 Blackwell GPU 架构,AI 算力直接飙升到 2070 TFLOPS,比上一代 Jetson Orin 提高至整整 7.5 倍,同时能效提高至 3.5 倍。

128GB 的超大内存配置,在边缘计算设备里是前所未有。

在宣传片中,黄仁勋把他当成送给所有机器人的礼物:

黄仁勋表示:

Jetson Thor 助力全球百万开发者构建可与物理世界交互、甚至改变物理世界的机器人系统。具备无与伦比的性能与能效,还能够在边缘设备上同时运行多个 AI 模型。

作为一款卓越的超级计算机,Jetson Thor 正在推动物理 AI 与通用机器人时代真正到来。

Jetson Thor 基于 Jetson 软件栈优化,支持所有流行的生成式 AI 框架和 AI 推理模型,包括主流语言模型 Qwen、DeepSeek 以及视觉语言动作模型到和视觉语言模型等。

Jetson AGX THOR 开发者套件美国售价 3499 美元_(约 25000 人民币,但中国售价尚未公布)_。

T5000 模组也已发售,购买 1000 片以上单价 2999 美元。

其中 T5000 模组是完整版,T4000 模组则是为那些想从 Orin 升级的用户准备的精简版,功耗也从 130W 降到了 75W。

性能爆表背后的技术细节

Thor 的强悍不仅体现在 AI 算力上,人形机器人需要大量实时控制计算,需要 CPU 与 AI 算力同样重要,存储与带宽方面也都得到了升级。

具体特性如下:

-

GPU:Blackwell 架构,最高 2560 个 CUDA 核 / 9 个第五代 Tensor Core,并支持 MIG 技术(多实例 GPU)将 GPU 资源按多任务隔离与并行调度,适配并行多代理 / 多工作流场景。

-

CPU:14 核 Arm Neoverse V3AE,面向实时控制与任务管理的确定性执行与更高吞吐,CPU 性能相较前代显著提升。

-

存储与带宽:128GB 256-bit LPDDR5X,273GB/s 显存带宽,为大型 Transformer 推理与高并发视频编解码提供保障。

-

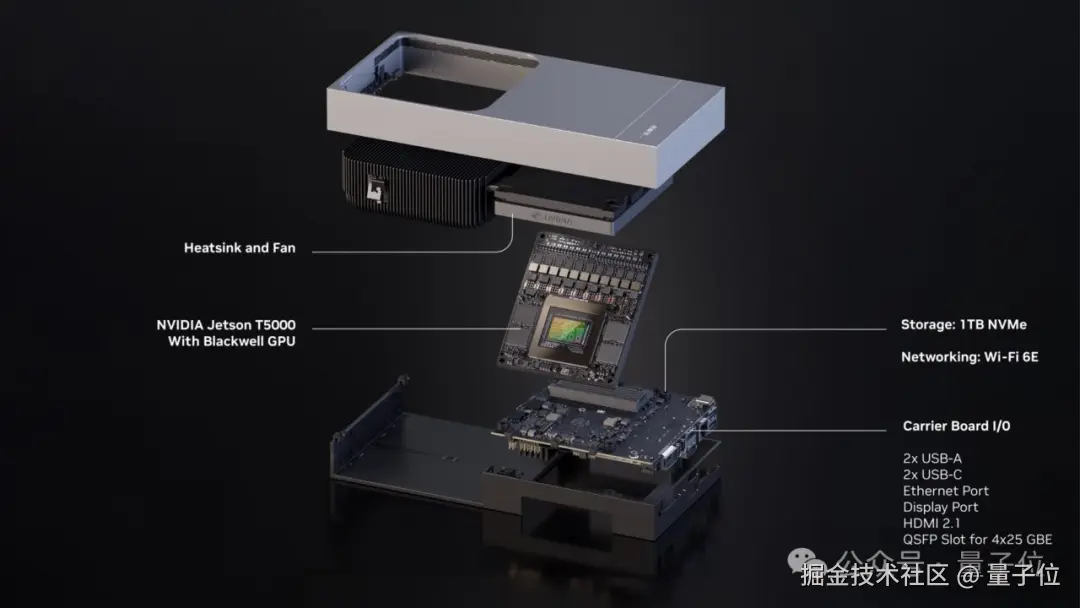

功耗:40--130W,支持从移动平台到固定式机器人多样热 / 功耗配置,开发套件集成导热板与风扇便于热设计评估。

-

视频编解码:多路 4K/8K 编解码能力显著增强,有利于多摄并发与长时视频代理推理。

-

网络与传感:最多 4×25GbE,搭配高速摄像头卸载引擎与 Holoscan Sensor Bridge,将相机、雷达、激光雷达等数据以极低时延直送 GPU 内存,提升多传感器融合与高频闭环控制的稳定性。

-

I/O:开发套件与量产模组提供 QSFP28、RJ45、USB 3.x、PCIe Gen5 等接口,适配机器人传感 / 执行器与加速外设扩展

在软件优化上,英伟达也下了功夫。

Jetson Thor 原生支持 NVIDIA Isaac(仿真 / 开发)、Isaac GR00T(人形机器人基础模型)、Metropolis(视觉 AI)、Holoscan(传感器工作流),支持从云到边缘统一开发 / 部署路径。

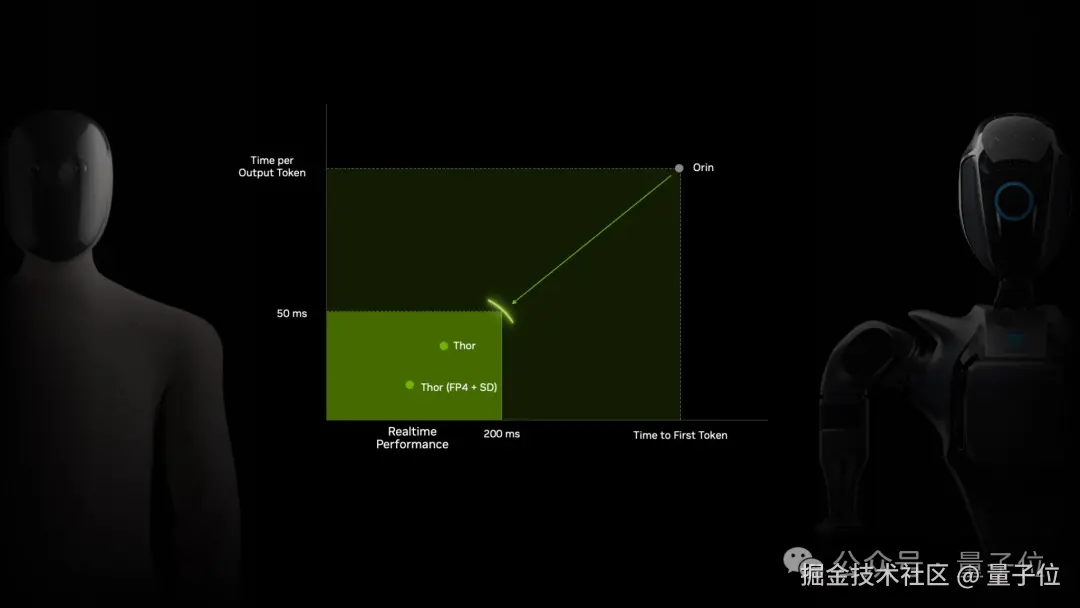

通过 FP4 量化和推测解码(speculative decoding)技术,在某些模型上能再获得 2 倍的性能提升。

数据显示,Thor 能在 200 毫秒内给出第一个 token 响应,每秒能生成超过 25 个 token,这个速度已经能支撑实时人机对话。

研华科技、Aetina、ConnectTech、米文动力、天准科技等正在打造具备量产条件的 Jetson Thor 系统,拥有灵活的输入输出接口、定制化配置,并能够提供多种形态规格。

亚德诺半导体、e-con Systems、英飞凌、Leopard Imaging、RealSense、森云智能等传感器与执行器企业,正将摄像头、雷达、激光雷达等设备的传感器数据,以超低延迟直接传输至 Jetson Thor 的 GPU 内存中。

首批供应里中国玩家占多数

第一批采用 Thor 的公司里,中国企业占了很大比例。联影医疗、万集科技、优必选、银河通用、宇树科技、众擎机器人和智元机器人等都已经开始集成这个新平台。

宇树科技创始人王兴兴表示:"Jetson Thor 带来了计算能力的巨大飞跃,机器人更强的敏捷性、更快的决策制定以及更高的自主水平,这对于机器人在现实世界中实现导航与交互至关重要。"

银河通用 CTO 王鹤则透露,他们的 G1 Premium 机器人在采用 Thor 后,运动速度和动作流畅性已经有了显著提升。

此外波士顿动力正将 Jetson Thor 集成到其人形机器人 Atlas,让 Atlas 得以在设备端搭载此前仅服务器才具备的计算能力。

Agility Robotics 计划将 Jetson Thor 作为第六代 Digit 计算核心,在仓库与制造环境中执行堆叠、装载及码垛等物流任务。

在演讲中,英伟达机器人与边缘 AI 副总裁 Deepu Talla 提出了这样的观点:要真正实现物理 AI 和机器人,需要三台计算机协同工作。

第一台是用来训练 AI 的 DGX 系统,第二台是用来在仿真环境中测试 AI 的 Omniverse 平台,第三台才是装在机器人身上的" 大脑",也就是今天发布的 Jetson Thor。

他特别强调仿真测试这一步至关重要,因为仿真相比在真实物理环境中开发更快、更安全、更便宜。

而且这不是一次性的过程,即使机器人部署到现场后,这个训练 - 仿真 - 部署的循环还会持续进行,不断升级机器人的能力。

参考链接:

1blogs.nvidia.cn/blog/jetson...

2blogs.nvidia.cn/blog/nvidia...

欢迎在评论区留下你的想法!

--- 完 ---