【导读】

在无人机拍摄的航拍图像中,目标往往只有几十个像素大小,分辨率低,容易被复杂背景淹没。如何准确识别这些小目标,是计算机视觉中最难的任务之一。传统检测模型不仅精度有限,而且在算力受限的无人机平台上运行时,速度与能效往往难以兼顾。

近期,研究团队提出了全新模型 LCW-YOLO ,它在小目标检测任务中实现了精度、效率与可解释性 的三重平衡,为无人机应用带来了新的可能。

为什么这项研究重要

小目标检测不仅是学术难题,更关系到实际应用:

- 搜救: 更快找到被困人员,提升救援效率。

- 交通管理: 大规模监控道路状况,提高智慧交通水平。

- 安防监控: 在算力有限的无人机端,也能保持检测稳定。

传统 CNN 受制于感受野和特征层次设计,不适合捕捉细粒度的目标特征。LCW-YOLO 的提出,正是为了解决"无人机小目标检测难题"。

LCW-YOLO

- LCW-YOLO 的含义

模型名称直接点出了三大核心:

- L(Lightweight) 轻量化: 减少计算量,同时提升准确率。

- C(Channel-wise) 通道注意力: 利用先进的注意力机制,让模型"看得更精细"。

- W(Wise-IoU v3) 智能损失函数: 动态降低低质量样本的影响,提升鲁棒性。

换句话说,LCW-YOLO = 轻量通道注意力 YOLO + 智能 WIoU。

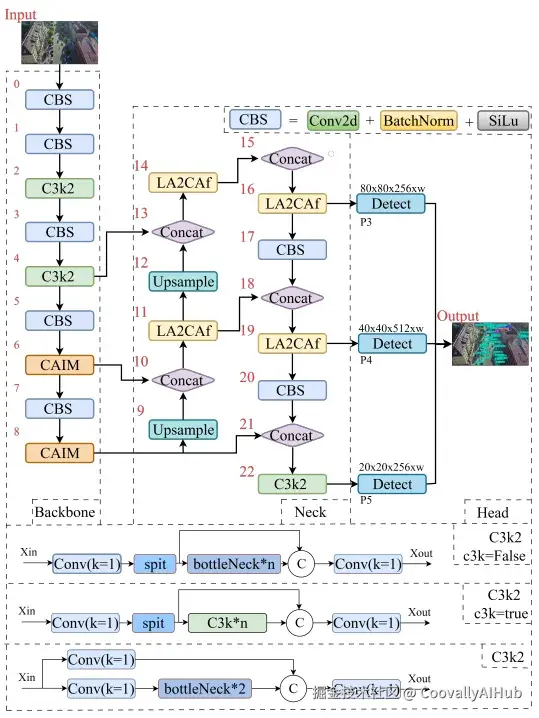

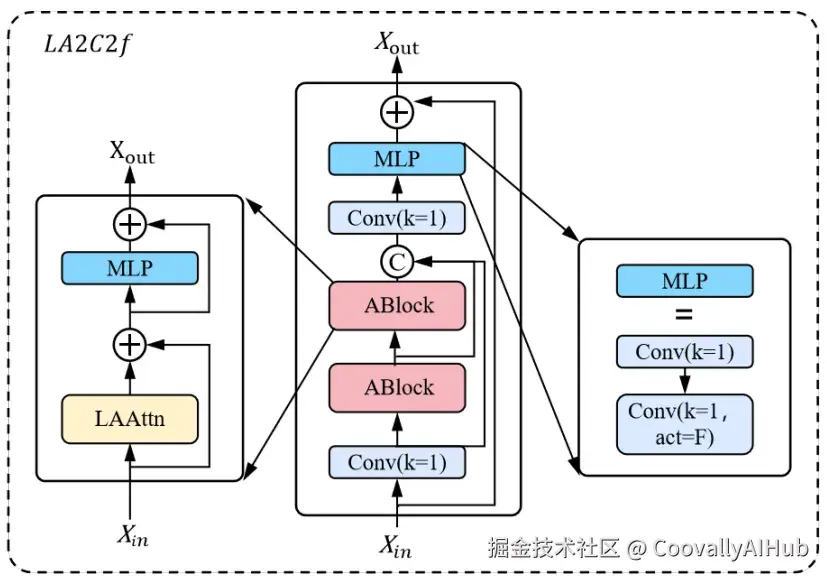

- LA2C2f 模块

- 改进 YOLOv12 的注意力结构,引入 3×3 和 5×5 并行卷积替代传统 7×7 卷积。

- 不仅增强了小目标的空间感知,还降低了 38% 的计算量。

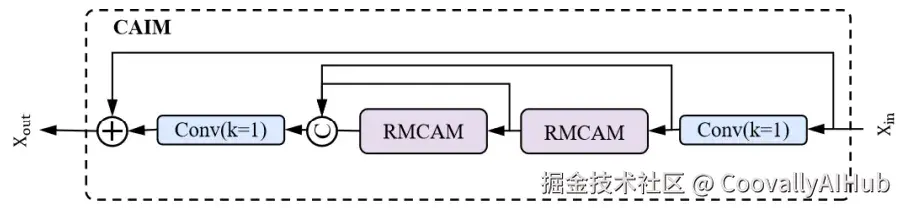

- CAIM 模块

- 融合卷积与多维注意力(通道、高度、宽度、原始特征),实现局部细节与全局语义的结合。

- 对只有几像素大小的目标尤为关键。

- Wise-IoU v3 损失函数

- 根据样本质量动态分配权重:高质量样本影响更大,低质量样本被抑制。

- 有效减少噪声干扰,提高模型泛化能力。

LCW-YOLO实验结果

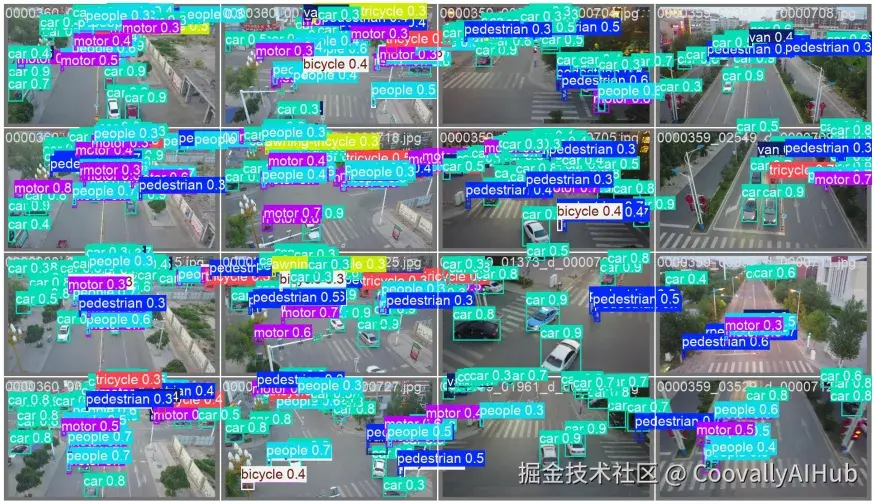

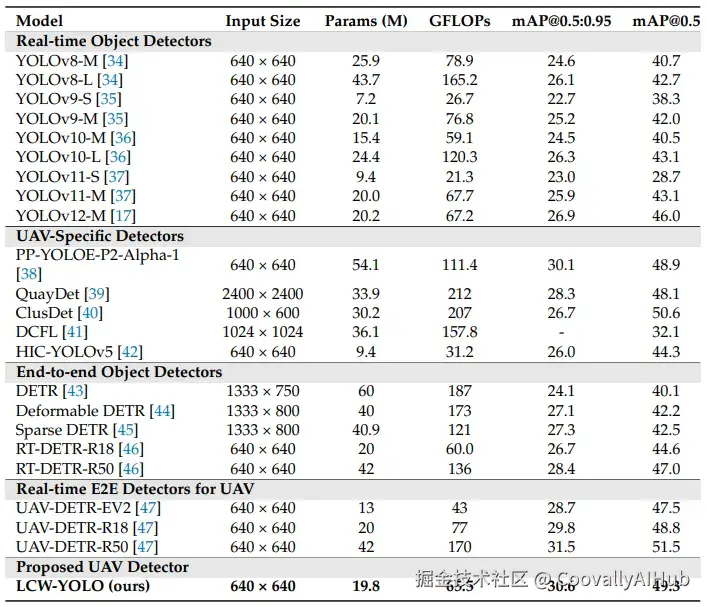

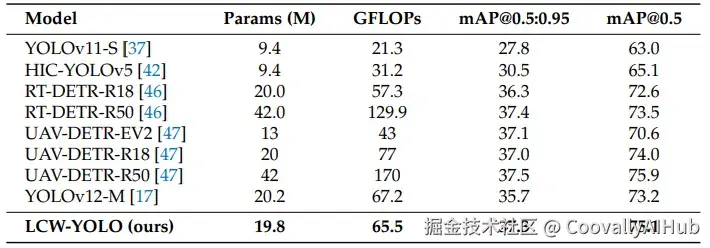

团队在两个权威无人机数据集上验证了模型性能:

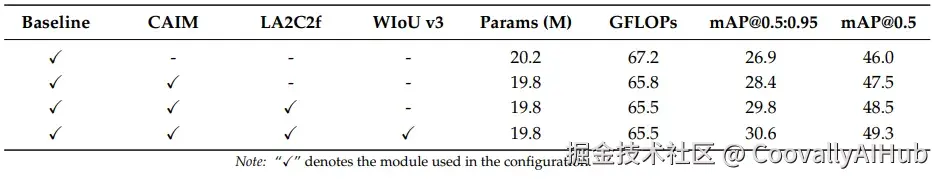

- VisDrone2019 数据集

- mAP@0.5 提升 3.3%(从 46.0% 到 49.3%)。

- 参数量减少 0.4M。

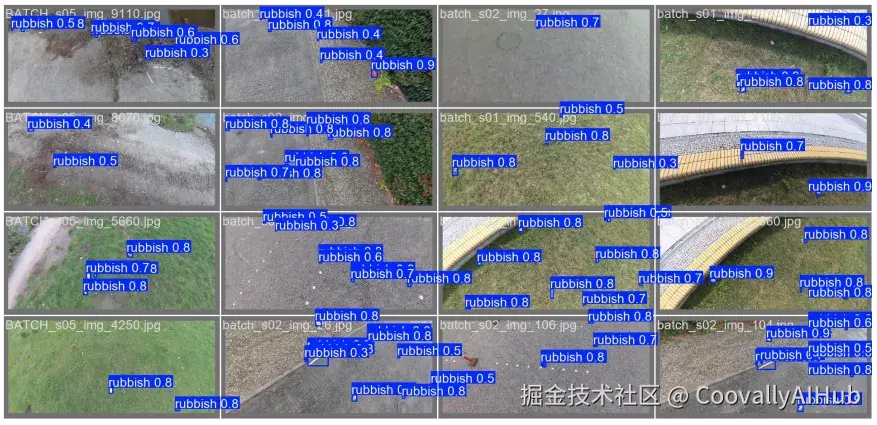

- UAVVaste 数据集

- mAP@0.5 提升 1.9%。

此外,消融实验表明,逐步引入 LA2C2f、CAIM、WIoU v3,性能持续提升,验证了各个模块的有效性。

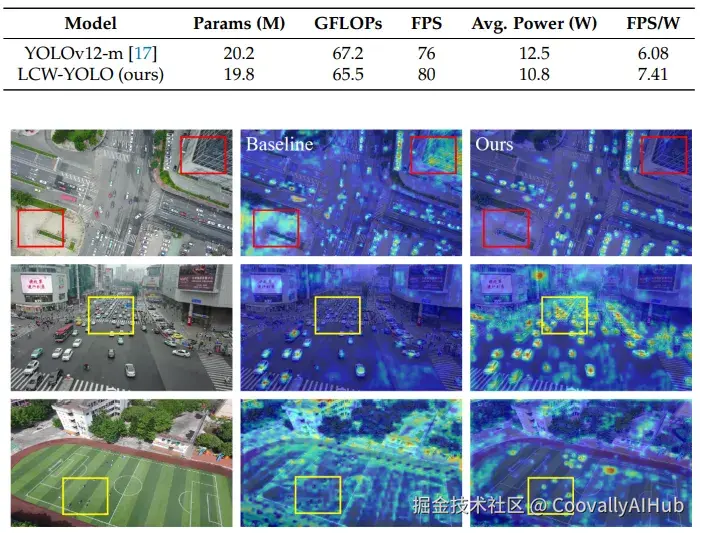

更直观的是可视化结果:热力图显示,LCW-YOLO 比 YOLOv12 更聚焦于小目标及其上下文信息,对遮挡目标的检测也更加稳定。

在推理速度与能效方面,LCW-YOLO 达到 80 FPS ,同时功耗降低 14% ,适合无人机实时部署。

- 可解释性优势

与传统"黑箱"模型不同,LCW-YOLO 具备可解释性(XAI):

- 注意力热力图 → 直观展示模型在检测时"看哪里"。

- 特征融合可视化 → 展示局部与全局信息如何结合。

- WIoU 权重分布 → 揭示哪些训练样本可能存在噪声或标注问题。

这种透明性在搜救、无人机安防等高风险领域尤为重要。

- 实际意义

对于工程师与无人机开发者,LCW-YOLO 带来:

- 轻量化设计: 便于边缘设备快速部署。

- 泛化能力强: 在不同无人机场景下表现稳定。

- 解释性增强: 避免盲目信任 AI,帮助人工校验与监督。

- 数据集优化: 利用 WIoU 的权重分布,辅助发现问题样本。

- 未来开发

当然,LCW-YOLO 也存在一些局限:

- 解释性指标尚未统一,评估方法需要标准化。

- 嵌入式硬件的更多实测数据仍需积累。

未来的研究方向包括:

- 融合视频时序信息(利用连续帧提升检测稳定性)。

- 扩展多模态(红外+可见光+热成像)。

- 软硬件协同优化,进一步提升实用性。

总结

一句话总结: LCW-YOLO 让无人机小目标检测不仅"更准、更快",还能"看得懂、解释清"。

它推动了无人机小目标检测模型从"黑箱工具"走向"透明伙伴",为搜救、交通管理、安防监控等场景带来新的可能。