什么叫做双目系统

计算机视觉中,之前很多大佬做了很多研究都是关于如何模拟两个人眼来确定空间中的一个点的远近(Z方向坐标),我们都知道一个相机在一定程度上是可以描述XY方向的信息,那么双目系统就是在XY方向的信息中再增加Z方向上的信息。

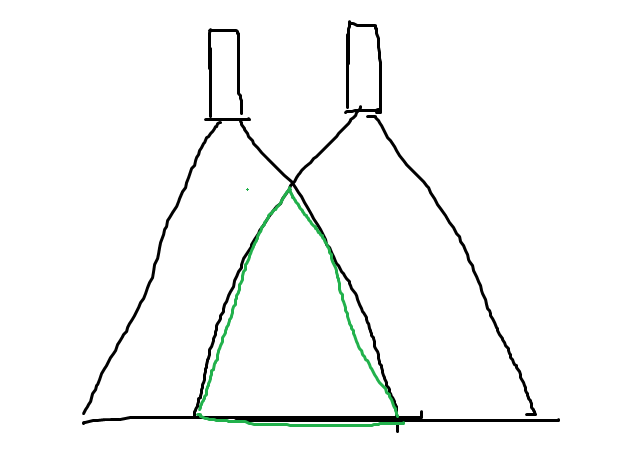

双目就是两个相机,一般是并排着放置,请看灵魂画手绘制的下图:

双目系统标定究竟标定什么

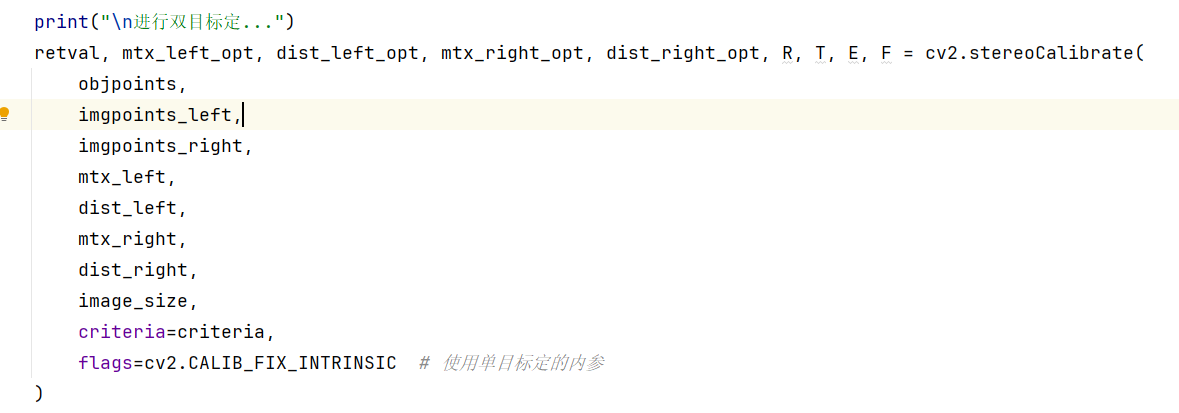

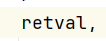

说到这里就可以直接上代码

先看看这个函数的参数:

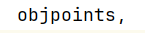

第一个参数是标定板坐标系上的三维角点数据

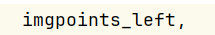

第二个数据是左相机在图像上识别到的二维像素点数据

第三个数据是右相机识别到的二维像素点数据

第四个数据是左相机在之前标定出来的内参矩阵K

第五个是做相机在之前标定出来的畸变系数

下面两个是右相机的标定数据,就不一一说了

这个是图像是尺寸

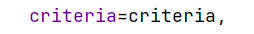

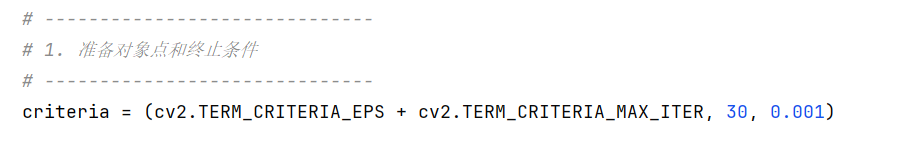

这个是标定算法迭代的终止条件

上述的具体内容是说EPS误差小于0.001或者迭代次数大于30次任意满足一个条件算法就可以停止下来了。

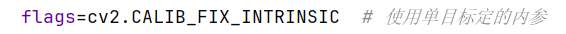

这个参数是说两个相机的内参矩阵就保持之前单目标定的内参矩阵,不需要在双目标定的过程中再重新计算了。

当然你也可以选现在双目标定的时候再优化一下左右相机的内参矩阵,个人感觉区别并不是很大。

双目标定得到什么

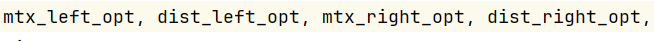

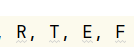

那么需要给进去的数据说完了,那么双目标定完成之后我们可以得到什么数据呢?

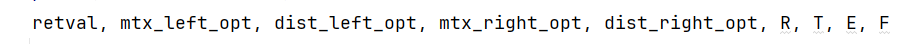

得到了一堆东西,依次来说

按道理来说是标定的rms误差,像素单位的,如果这个值小于0,那么大概率标定失败了,应该检查一下传入的数据是否错误;

这四个对象看名字就知道了,这是左右相机优化之后的相机内参矩阵和畸变系数

这四个名字很简单的矩阵就是我们的重头戏了

一看到RT我们就要想到旋转矩阵和平移向量,事实证明确实也是这样的,这是左右相机坐标系的RT矩阵,共同描述在空间中从左相机坐标系到右坐标系的转换关系;

E矩阵叫做本质矩阵

F矩阵叫做基础矩阵

这里不展开来说了,稍微有点点说不清楚,有点小复杂。

我们后续作用比较大的还是相机的内参矩阵和RT矩阵