文章核心观点

为解决自动驾驶中雷达-相机多模态感知的模态差异与空间错位问题,本文提出RCBEVDet及升级版本RCBEVDet++。RCBEVDet基于相机3D目标检测模型,新增雷达特征提取器RadarBEVNet和跨注意力多层融合模块(CAMF):RadarBEVNet通过双流雷达骨干(点基与Transformer基分支)及RCS感知BEV编码器,将稀疏雷达点编码为密集BEV特征;CAMF利用可变形注意力动态对齐雷达与相机BEV特征,并通过通道-空间融合层增强特征聚合。RCBEVDet++进一步升级CAMF以支持稀疏融合,适配基于查询的多视图相机感知模型,扩展至3D目标检测、BEV语义分割、3D多目标跟踪等任务。在nuScenes数据集上,RCBEVDet提升现有相机模型性能,RCBEVDet++则在三任务上均达SOTA,尤其以ViT-L为图像骨干时,3D目标检测实现72.73 NDS和67.34 mAP(无测试时增强或模型集成),验证了其高效性与泛化性。

核心内容

本文围绕自动驾驶中雷达 - 相机融合的3D感知展开,提出了RCBEVDet和RCBEVDet++框架,核心内容如下:

1 自动驾驶感知与传感器融合

感知任务:自动驾驶需全面感知环境,3D目标检测、BEV语义分割和3D多目标跟踪是关键任务。相机和雷达融合可提升感知性能,但存在模态差异挑战。

传感器特点:LiDAR提供详细几何信息但成本高;相机捕捉高分辨率语义细节;毫米波雷达在距离和速度估计上有优势且适应多样天气,4D毫米波雷达技术逐渐克服其稀疏点局限。

2 相关工作

2.1 基于相机的3D感知

几何方法:利用深度预测网络估计图像深度分布,将2D图像特征转换为3D相机视锥体特征,再通过体素池化等操作构建体素或BEV空间特征,如Lift - Splat - Shoot、FIERY、BEVDet、BEVDepth、BEVDet4D、SOLOFusion等。

基于Transformer的方法:利用注意力机制将预定义查询投影到多视图图像平面,用多视图图像特征更新查询特征,如DETR3D、CVT、BEVformer、PETR、PETRv2、Sparse4D、Sparse4Dv2、StreamPETR、SparseBEV等。

2.2 雷达 - 相机3D感知

毫米波雷达常作为辅助模态与多视图相机结合,现有方法如RadarNet、CenterFusion、MVFusion、Simple - BEV、CRAFT、RADIANT、CRN、RCFusion、BEVGuide、BEVCar等,主要采用BEVFusion管道将多视图图像和雷达特征投影到BEV,但存在空间不对齐和未充分考虑雷达特性问题。

3 RCBEVDet框架

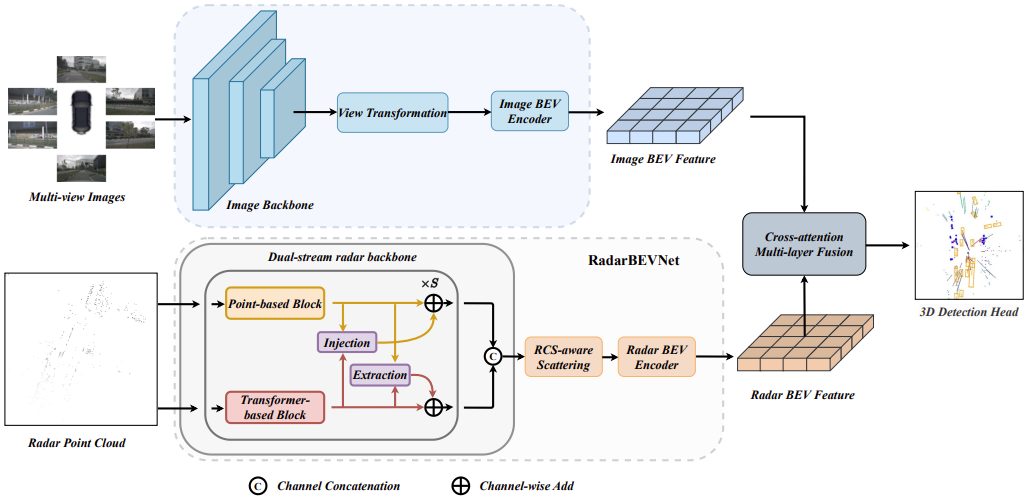

总体流程:多视图图像经图像编码器提取特征并转换为图像BEV特征,雷达点云由RadarBEVNet编码为雷达BEV特征,两者通过Cross - Attention Multi - layer Fusion模块融合,最终用于3D目标检测。

3.1 RadarBEVNet

专为雷达BEV特征提取设计,采用双流雷达骨干网络将稀疏雷达点编码为局部点基和全局Transformer基表示,通过注入和提取模块融合,再经RCS - aware BEV编码器利用RCS作为物体大小先验,将单点特征散射到BEV空间多个像素,解决BEV特征图稀疏问题。

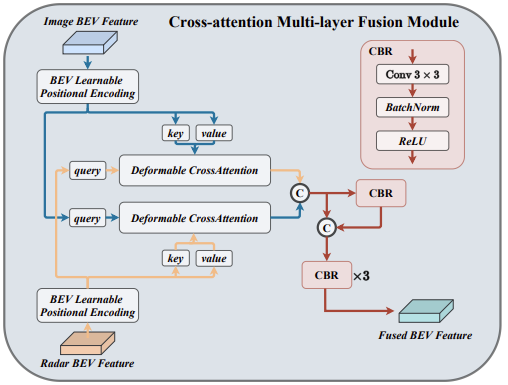

3.2 Cross - Attention Multi - layer Fusion模块

多模态特征对齐:采用可变形交叉注意力机制动态对齐雷达和相机BEV特征,解决雷达特征与相机BEV特征的不对齐问题,同时降低计算复杂度。

通道和空间融合:对齐后通过通道和空间融合层聚合多模态BEV特征,先拼接特征,再通过CBR块进行融合。

4 RCBEVDet++框架

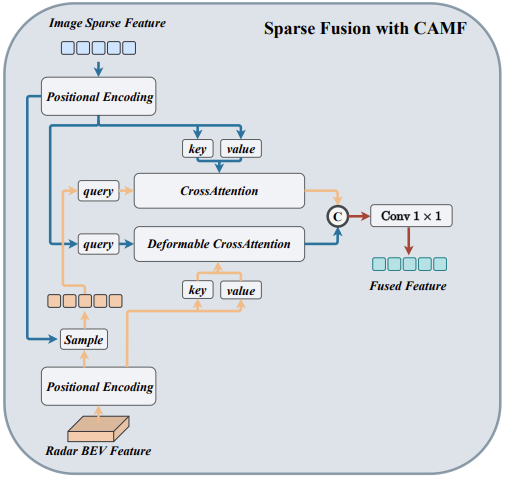

4.1 稀疏融合与CAMF

对CAMF模块扩展,采用稀疏融合将密集雷达BEV特征与图像稀疏特征融合,通过项目和采样过程关联特征,利用位置编码网络转换位置信息,采用可变形交叉注意力和简单交叉注意力对齐多模态特征,最后用简单线性层融合。

4.2 下游3D感知任务

3D目标检测:采用基于查询的Transformer解码器,在每个解码器层应用稀疏融合与CAMF模块预测3D边界框。

3D多目标跟踪:采用跟踪 - 检测框架,基于速度的贪婪距离匹配,通过预测速度补偿计算多帧中物体中心距离,以分配相同ID。

BEV语义分割:将多模态特征转换为密集BEV特征,遵循CVT解码器架构解码为不同语义表示地图,使用多个头处理不同分割任务,采用focal loss和sigmoid层作为训练监督。

5 实验

实验设置:使用nuScenes数据集,3D目标检测指标包括mAP、NDS等;BEV语义分割使用mIoU;3D多目标跟踪使用AMOTA和AMOTP。模型采用两阶段训练,使用AdamW优化器,进行多种数据增强。

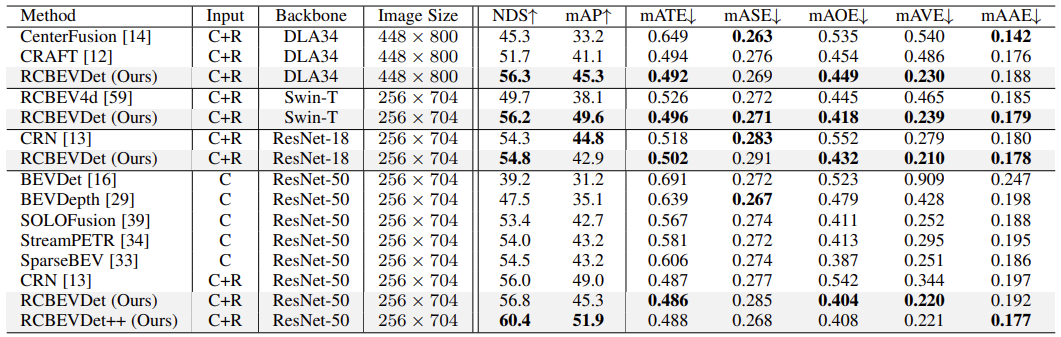

对比实验:与当前最先进方法在3D目标检测、BEV语义分割和3D多目标跟踪任务上对比。RCBEVDet在3D目标检测中超越先前雷达 - 相机多模态方法,RCBEVDet++进一步提升性能,在BEV语义分割和3D多目标跟踪任务中也取得优异成绩。

消融实验:对RCBEVDet和RCBEVDet++的主要组件进行消融实验,验证RadarBEVNet、CAMF、稀疏融合等组件有效性,分析各组件对性能影响。

任务权衡分析:在BEV语义分割中调整车辆、可行驶区域和车道分割任务的损失权重,找到最佳权衡点。

鲁棒性分析:通过随机丢弃传感器输入和扰动雷达坐标分析RCBEVDet在传感器故障和模态对齐方面的鲁棒性,结果表明其鲁棒性优于CRN。

模型泛化性分析:在不同骨干架构和3D检测器架构上实验,证明RCBEVDet可提升不同架构性能,具有良好泛化能力。

6 结论

RCBEVDet提升基于相机的3D目标检测器性能且对传感器故障有鲁棒性;RCBEVDet++进一步扩展功能,支持基于查询的模型和更多感知任务,在nuScenes数据集上取得新的最先进结果。