一、主从集群搭建

Redis 的主从集群是一个"一主多从"的读写分离集群。集群中的 Master 节点负责处理客户端的读写请求,而 Slave 节点仅能处理客户端的读请求。

只所以要将集群搭建为读写分离模式,主要原因是,对于数据库集群,写操作压力一般都较小,压力大多数来自于读操作请求。所以,只有一个节点负责处理写操作请求即可。

1.1 伪集群搭建与配置

1.1.1 复制redis.conf

在 redis 安装目录中 mkdir 一个目录,这里命名为 cluster。然后将 redis.conf 文件复制到 cluster 目录中。该文件后面会被其它配置文件包含,所以该文件中需要设置每个 Redis 节点相同的公共的属性。

1.1.2 修改redis.conf

masterauth

搭建主从集群,且每个主机都有可能会是 Master,所以最好不要设置密码验证属性 requirepass。如果真需要设置,一定要每个主机的密码都设置为相同的。此时每个配置文件中都要设置两个完全相同的属性:requirepass 与 masterauth。其中 requirepass 用于指定当前主机的访问密码,而 masterauth 用于指定当前 slave 访问 master 时向 master 提交的访问密码,用于让 master 验证自己身份是否合法。

repl-disable-tcp-nodelay

该属性用于设置是否禁用 TCP 特性 tcp-nodelay。设置为 yes 则禁用 tcp-nodelay,此时 master 与 slave 间的通信会产生延迟,但使用的 TCP 包数量会较少,占用的网络带宽会较小。相反,如果设置为 no,则网络延迟会变小,但使用的 TCP 包数量会较多,相应占用的网络带宽会大。

1.1.3 新建redis6380.conf

新建一个 redis 配置文件 redis6380.conf,该配置文件中的 Redis 端口号为 6380。

cs

include redis.conf

# 包含(引入)主的 redis.conf 配置文件

pidfile /var/run/redis_6380.conf # 指定 Redis 服务进程 ID(PID)文件的路径和名称

# 当 Redis 服务启动时,会将进程 ID 写入该文件,方便系统管理工具识别和管理 Redis 进程

port 6382

# Redis 服务监听的端口号为 6380

dbfilename dump6380.rdb

# 指定 Redis 持久化数据的 RDB(Redis Database)文件名称

# RDB 是 Redis 的一种持久化方式,会将内存中的数据定期或在特定条件下快照存储到磁盘文件中

appendfilename appendonly6380.aof

# Redis 另一种持久化方式 AOF(Append Only File)的文件名称。

# AOF 会以日志的形式记录每一条写操作命令,当 Redis 重启时,通过重新执行 AOF文件中的命令来恢复数据

replica-priority 90

# 设置 Redis 从节点(replica)的优先级

# 哨兵(sentinel)会根据从节点的优先级来选择新的主节点,优先级数值越小,优先级越高

# logfile access6380.log1.1.4 设置主从关系

cs

slaveof 127.0.0.1 63801.1.5 查看状态信息

cs

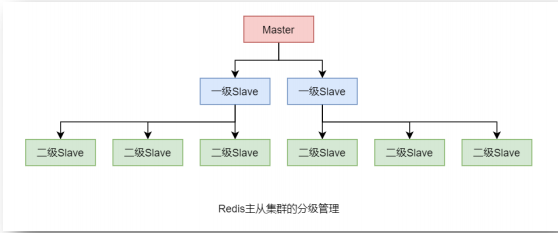

info replication1.2 分组管理

若 Redis 主从集群中的 Slave 较多时,它们的数据同步过程会对 Master 形成较大的性能压力。此时可以对这些 Slave 进行分级管理。

1.3 容灾冷处理

在 Master/Slave 的 Redis 集群中,若 Master 出现宕机怎么办呢?有两种处理方式,一种是通过手工角色调整,使****Slave 晋升为 Master 的冷处理 ;一种是使用哨兵模式,实现****Redis 集群的高可用 HA ,即热处理。

无论 Master 是否宕机,Slave 都可通过 slaveof no one 将自己由 Slave 晋升为 Master。如果其原本就有下一级的 Slave,那么,其就直接变为了这些 Slave 的真正的 Master 了。而原来的 Master 也会失去这个原来的 Slave。

二、主从复制原理

2.1 主从复制过程

当一个 Redis 节点(slave 节点)接收到类似 slaveof 127.0.0.1 6380 的指令后直至其可以从 master 持续复制数据;

-

- 当 slave 接收到 slaveof 指令后,slave 会立即将新的 master 的地址保存下来。

-

- slave 中维护着一个定时任务,该定时任务会尝试着与该 master 建立 socket 连接。如果连接无法建立,则其会不断定时重试,直到连接成功或接收到 slaveof no one 指令。

-

- 连接建立成功后,slave 会发送 ping 命令进行首次通信。如果 slave 没有收到 master 的回复,则 slave 会主动断开连接,下次的定时任务会重新尝试连接。

-

- 如果 master 收到了 slave 的 ping 命令,并不会立即对其进行回复,而是会先进行身份验证。如果验证失败,则会发送消息拒绝连接;如果验证成功,则向 slave 发送连接成功响应。

-

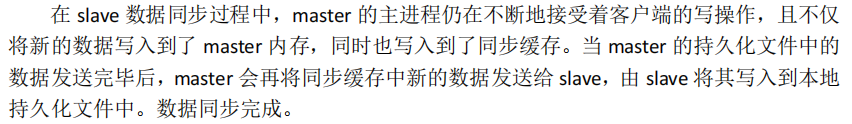

- 首次通信成功后,slave 会向 master 发送数据同步请求。当 master 接收到请求后,会 fork 出一个子进程,让子进程以异步方式立即进行持久化。

-

- 持久化完毕后 master 会再 fork 出一个子进程,让该子进程以异步方式将数据发送给 slave。slave 会将接收到的数据不断写入到本地的持久化文件中。

-

当 slave 与 master 的数据同步完成后,slave 就会读取本地的持久化文件,将其恢复到本地内存,然后就可以对外提供读服务了。

-

在 slave 对外提供服务过程中,master 会持续不断的将新的数据以增量方式发送给 slave,以保证主从数据的一致性。

2.2 数据同步演变过程

2.2.1 sync同步

Redis 2.8 版本之前,首次通信成功后,slave 会向 master 发送 sync 数据同步请求。然后 master 就会将其所有数据全部发送给 slave,由 slave 保存到其本地的持久化文件中。这个过程称为全量复制。

在全量复制过程中可能会出现由于网络抖动而导致复制过程中断。当网络恢复后,slave 与master 重新连接成功,此时 slave 会重新发送 sync 请求,然后会从头开始全量复制。

由于全量复制过程非常耗时,所以期间出现网络抖动的概率很高。而中断后的从头开始不仅需要消耗大量的系统资源、网络带宽,而且可能会出现长时间无法完成全量复制的情况。

2.2.2 psync同步

Redis 2.8 版本之后,全量复制采用了 psync(Partial Sync,不完全同步)同步策略。当全量复制过程出现由于网络抖动而导致复制过程中断时,当重新连接成功后,复制过程可以"断点续传"。即从断开位置开始继续复制,而不用从头再来。

复制偏移量 offset master_repl_offset

系统为每个要传送数据进行了编号,该编号从 0 开始,每个字节一个编号。

该编号称为复制偏移量。参与复制的主从节点都会维护该复制偏移量。

master 每发送过一个字节数据后就会进行累计。统计信息通过 info replication 的master_repl_offset 可查看到。同时,slave 会定时向 master 上报其自身已完成的复制偏移量给 master,所以 master 也会保存 slave 的复制偏移量 offset。

slave在接收到 master 的数据后,也会累计接收到的偏移量。统计信息通过 info replication 的 slave_repl_offset 可查看到。

主节点复制ID

当 master 启动后就会动态生成一个长度为 40 位的 16 进制字符串作为当前 master 的复制 ID,该 ID 是在进行数据同步时 slave 识别 master 使用的。通过 info replication 的master_replid 属性可查看到该 ID。

复制挤压缓冲区

当 master 有连接的 slave 时,在 master 中就会创建并维护一个队列 backlog,默认大小为 1MB,该队列称为复制积压缓冲区。master 接收到了写操作数据不仅会写入到 master 主存,写入到 master 中为每个 slave 配置的发送缓存,而且还会写入到复制积压缓冲区。其作用就是用于保存最近操作的数据,以备"断点续传"时做数据补偿,防止数据丢失。

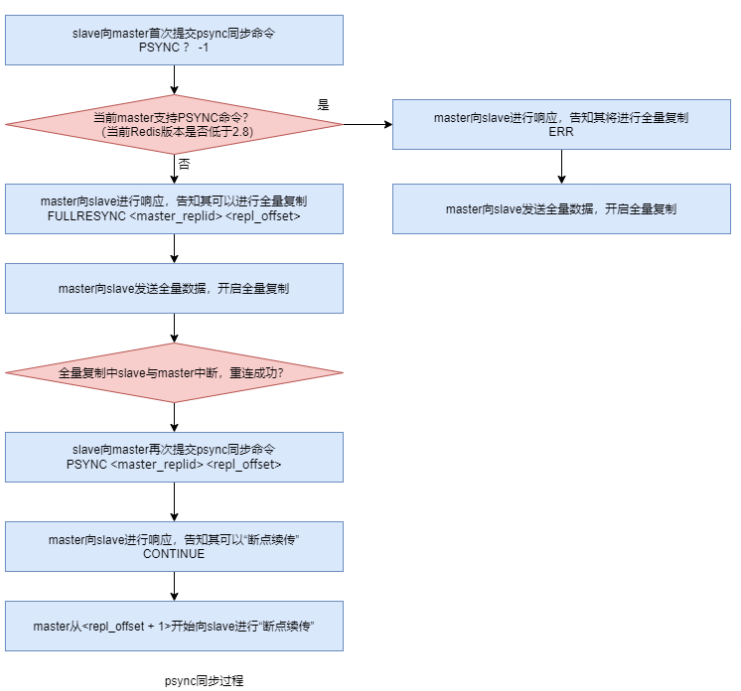

psync同步过程

cs

psync <master_replid> <repl_offset>psync 是一个由 slave 提交的命令,当前slave要从指定的master中的 repl_offset+1 处开始复制。repl_offset 表示当前 slave 已经完成复制的数据的 offset。该命令保证了"断点续传"的实现。

在第一次开始复制时,slave 并不知道 master 的动态 ID,并且一定是从头开始复制,所以其提交的 psync 命令为 PSYNC ? -1。即 master_replid 为问号(?),repl_offset 为-1。

如果复制过程中断后 slave 与 master 成功连接,则 slave 再次提交 psyn 命令。此时的 psyn 命令的 repl_offset 参数为其前面已经完成复制的数据的偏移量。

psync存在的问题

- 在 psync 数据同步过程中,若 slave 重启,在 slave 内存中保存的 master 的动态 ID 与续传 offset 都会消失,"断点续传"将无法进行,从而只能进行全量复制,导致资源浪费。

- 在 psync 数据同步过程中,master 宕机后 slave 会发生"易主",从而导致 slave 需要从新 master 进行全量复制,形成资源浪费。

2.2.3 psync同步改进(同源增量同步)

- 解决slave重启问题

将master的动态ID直接写入到了slave的持久化文件中;

slave重启后直接从本地持久化文件中读取master的动态ID,然后向master提交获取复制偏移量的请求。master会根据提交请求的slave地址,查找到保存在master中的复制偏移量,然后向slave回复

cs

fullresync <master_replid><repl_offset>以告知slave其马上要开始发送的位置,然后master开始"断点续传";

- 解决slave易主问题

slave易主之后需要和新master进行全量复制,本质原因是新master不认识slave提交的psync请求中"原master的动态ID",如果slave发送psync<原master_replid><repl_offset>命令,新master能够识别出该slave要从原master复制数据,而自己的数据也都是从该master复制来的,于是可以说明其与该slave"师出同门",应该接收其"断点续传"同步请求。

新master中恰好保存的有"原 master 的动态 ID", 改进后的 psync 中每个 slave 都在本地保存了当前 master 的动态 ID,所以当slave 晋升为新的 master 后,其本地仍保存有之前 master 的动态 ID。通过 master 的 info replicaton 中的 master_replid2 可查看到。如果尚未发生过易主,则该值为 40 个 0。

2.2.4 无盘操作

- 无盘全量同步:master 的主进程 fork 出的子进程直接将内存中的数据发送给 slave,无需经过磁盘。

- 无盘加载:slave 在接收到 master 发送来的数据后不需要将其写入到磁盘文件,而是直接写入到内存,这样 slave 就可快速完成数据恢复。

2.2.4 共享复制积压缓冲区

Redis 7.0 版本对复制积压缓冲区进行了改进,让各个 slave 的发送缓冲区共享复制积压缓冲区。这使得复制积压缓冲区的作用,除了可以保障数据的安全性外,还作为所有 slave 的发送缓冲区,充分利用了复制积压缓冲区。

三、哨兵机制实现

2.1 简介

Sentinel 哨兵机制;

在集群中再引入一个节点,该节点充当 Sentinel 哨兵,用于监视 Master 的运行状态,并在 Master 宕机后自动指定一个 Slave 作为新的 Master。整个过程无需人工参与,完全由哨兵自动完成。

不过,此时的 Sentinel 哨兵又成为了一个单点故障点:若哨兵发生宕机,整个集群将瘫痪。所以为了解决 Sentinel 的单点问题,又要为 Sentinel 创建一个集群,即 Sentinel 哨兵集群。一个哨兵的宕机,将不会影响到 Redis 集群的运行。

那么这些 Sentinel 哨兵是如何工作的呢?Sentinel 是如何知道其监视的 Master 状态的呢?每个 Sentinel 都会定时会向 Master 发送心跳,如果 Master 在有效时间内向它们都进行了响应,则说明 Master 是"活着的"。如果 Sentinel 中有 quorum 个哨兵没有收到响应,那么就认为 Master 已经宕机,然后会有一个 **Sentinel 做 Failover 故障转移,**即将原来的某一个 Slave 晋升为 Master。

2.2 Redis高可用集群搭建

-

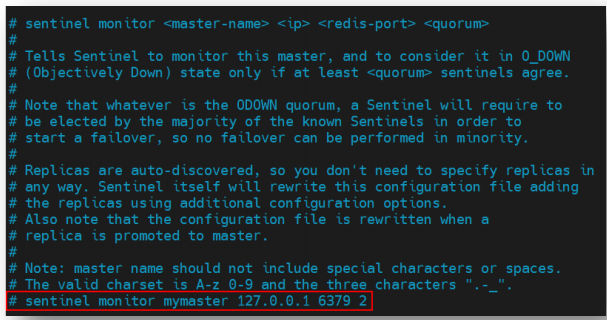

复制sentinel.conf

-

修改sentinel.conf

该配置用于指定Sentinel 要监控的 master 是谁<ip><redis-port>,为master起了一个名字mymaster。该名字在后面很多配置中都会使用,同时指定Sentinel集群中决定该master"客观下线状态"判断的法定sentinel数量<quorum>;<quorum>与sentinel的Leader选举有关,要求至少有max(quorum, sentinelNum/2+1)个 sentinel 参与,选举才能进行。

如果 Redis 主从集群中的主机设置了访问密码,那么该属性就需要指定 master 的主机名与访问密码。以方便 sentinel 监控 master。

- 新建sentinel26380.conf

在 Redis 安装目录下的 cluster 目录中新建 sentinel26380.conf 文件作为 Sentinel 的配置文件,

cs

include sentinel.conf

pidfile /var/run/sentinel_26380.pid

port 26380

sentinel monitor mymaster 192.168.192.102 6380 2

# sentinel monitor 属性用于指定当前监控的 master 的 IP 与 Port

# 同时为集群中 master 指定一个名称 mymaster

# logfile access26380.log- 复制sentinel26381.conf 与 sentinel26382.conf

2.3 Redis高可用集群的启动

首先要启动三台 Redis,然后再通过 slaveof 关联它们。

之后启动Sentinel集群,在/usr/local/bin 目录下有一个命令 redis-sentinel 用于启动 Sentinel.

在启动 Sentinel 时,需要指定 sentinel.conf 配置文件。

cs

# 启动方式

redis-sentinel sentinel26380.conf

redis-server sentinel26380.conf --sentinel

# 查看Sentinel信息

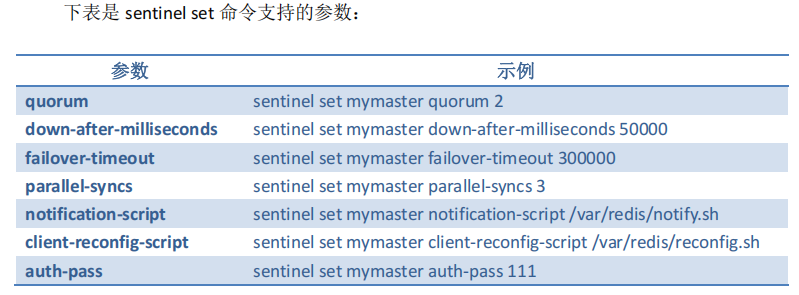

redis-cli -p 26380 info sentinel2.4 Sentinel优化配置

在公共的 sentinel.conf 文件中,还可以通过修改一些其它属性的值来达到对 Sentinel 的配置优化。

cs

sentinel down-after-milliseconds mymaster 30000

# 每个 Sentinel 会通过定期发送 ping 命令来判断 master、slave 及其它 Sentinel 是否存活。

# 如果 Sentinel 在该属性指定的时间内没有收到它们的响应,那么该 Sentinel 就会主观认为该主机宕机。

# 默认为 30 秒。

cs

sentinel parallel-syncs mymaster 1

# 该属性用于指定,在故障转移期间,即老的master出现问题,

# 新的master刚刚晋升后,允许多少个slave同时从新的master进行数据同步。

# 默认值为 1 表示所有 slave 逐个从新 master 进行数据同步。

cs

sentinel failover-timeout mymaster 180000

# 指定故障转移的超时时间,默认时间为 3 分钟

# 由于第一次故障转移失败,在同一个 master 上进行第二次故障转移尝试的时间为该 failover-timeout 的两倍

# 新 master 晋升完毕,slave 从老 master 强制转到新 master 进行数据同步的时间阈值

# 取消正在进行的故障转换所需的时间阈值

# 新 master 晋升完毕,所有 replicas(原来的slave) 的配置文件更新为新 master 的时间阈值

cs

sentinel deny-scripts-reconfig yes

# 指定是否可以通过命令 sentinel set 动态修改

# notification-script 与 client-reconfig-script 两个脚本。

# 默认是不能的。这两个脚本如果允许动态修改,可能会引发安全问题。

cs

# 动态修改配置

sentinel set mymaster quorum 2

四、哨兵机制原理

Sentinel 维护着三个定时任务以监测 Redis 节点及其它 Sentinel 节点的状态。

4.1 三个定时任务

4.1.1 info任务

每个 Sentinel 节点每 10 秒就会向 Redis 集群中的每个节点发送 info 命令,以获得最新的

Redis 拓扑结构。

4.1.2 心跳任务

每个 Sentinel节点每1秒就会向所有 Redis节点及其它Sentinel节点发送一条 ping命令,以检测这些节点的存活状态。该任务是判断节点在线状态的重要依据。

4.1.3 发布/订阅任务

每个 Sentinel 节点在启动时都会向所有 Redis 节点订阅**_ sentinel _:hello** 主题的信息,当 Redis 节点中该主题的信息发生了变化,就会立即通知到所有订阅者。

启动后,每个 Sentinel 节点每 2 秒就会向每个 Redis 节点发布一条_ sentinel _:hello 主题的信息,该信息是当前 Sentinel 对每个 Redis 节点在线状态的判断结果及当前 Sentinel 节点信息。

当Sentinel节点接收到_ sentinel _:hello 主题的信息之后,进行下面的三项工作:

-

- 如果发现有新的 Sentinel 节点加入,则记录下新加入 Sentinel 节点信息,并与其建立连接;

-

- 如果发现有 Sentinel Leader 选举的选票信息,则执行 Leader 选举过程;

-

- 汇总其它 Sentinel 节点对当前 Redis 节点在线状态的判断结果,作为 Redis 节点客观下线的判断依据;

4.2 Redis节点下线判断

-

对于每个 Redis 节点在线状态的监控是由 Sentinel 完成的;

4.2.1 主观下线

- 每个 Sentinel 节点每秒就会向每个 Redis 节点发送 ping 心跳检测,如果 Sentinel 在

- down-after-milliseconds 时间内没有收到某 Redis 节点的回复,则 Sentinel 节点就会对该Redis 节点做出"下线状态"的判断。这个判断仅仅是当前 Sentinel 节点的"一家之言",所以称为主观下线。

4.2.2 客观下线

当 Sentinel 主观下线的节点是 master 时,该 Sentinel 节点会向每个其它 Sentinel 节点发送 sentinel is-master-down-by-addr 命令,以询问其对 master 在线状态的判断结果。这些Sentinel 节点在收到命令后会向这个发问 Sentinel 节点响应 0(在线)或 1(下线)。当 Sentinel 收到超过 quorum 个下线判断后,就会对 master 做出客观下线判断;

4.3 Sentinel Leader选举

当 Sentinel 节点对 master 做出客观下线判断后会由 Sentinel Leader 来完成后续的故障转移,即 Sentinel 集群中的节点也并非是对等节点,是存在 Leader 与 Follower 的。

Sentinel 集群的 Leader 选举是通过 Raft 算法实现的。

每个选举参与者都具有当选 Leader 的资格,当其完成了"客观下线"判断后,就会立即"毛遂自荐"推选自己做 Leader,然后将自己的提案发送给所有参与者。其它参与者在收到提案后,只要自己手中的选票没有投出去,其就会立即通过该提案并将同意结果反馈给提案者,后续再过来的提案会由于该参与者没有了选票而被拒绝。当提案者收到了同意反馈数量大于等于 max(quorum,sentinelNum/2+1) 时,该提案者当选 Leader。

- 在网络没有问题的前提下,基本就是谁先做出了"客观下线"判断,谁就会首先发起Sentinel Leader 的选举,谁就会得到大多数参与者的支持,谁就会当选 Leader;

- Sentinel Leader 选举会在次故障转移发生之前进行。

- 故障转移结束后 Sentinel 不再维护这种 Leader-Follower 关系,即 Leader 不再存在。

4.4 master选择算法

在进行故障转移时,Sentinel Leader 需要从所有 Redis 的 Slave 节点中选择出新的 Master。

其选择算法为:

① 过滤掉所有主观下线的,或心跳没有响应 Sentinel 的,或 replica-priority 值为 0 的 Redis 节点;

② 在剩余 Redis 节点中选择出 replica-priority 最小的的节点列表。如果只有一个节点,则直接返回,否则,继续;

③ 从优先级相同的节点列表中选择复制偏移量最大的节点。如果只有一个节点,则直接返回,否则,继续 ;

④ 从复制偏移值量相同的节点列表中选择动态 ID 最小的节点返回;

4.5 故障转移过程

4.6 节点上线

不同的节点类型,其上线的方式也是不同的。

4.6.1 原Redis节点上线

无论是原下线的 master 节点还是原下线的 slave 节点,只要是原 Redis 集群中的节点上线,只需启动 Redis 即可。

因为每个 Sentinel 中都保存有原来其监控的所有 Redis 节点列表,Sentinel 会定时查看这些 Redis 节点是否恢复。如果查看到其已经恢复,则会命其从当前 master 进行数据同步;

如果是原 master 上线,在新 master 晋升后 Sentinel Leader 会立即先将原 master 节点更新为 slave,然后才会定时查看其是否恢复;

4.6.2 新Redis节点上线

如果需要在 Redis 集群中添加一个新的节点,其未曾出现在 Redis 集群中,则上线操作只能手工完成。即添加者在添加之前必须知道当前 master 是谁,然后在新节点启动后运行slaveof 命令加入集群;

4.6.3 Sentinel节点上线

如果要添加的是 Sentinel 节点,无论其是否曾经出现在 Sentinel 集群中,都需要手工完成。即添加者在添加之前必须知道当前 master 是谁,然后在配置文件中修改 sentinel monitor 属性,指定要监控的 master。然后启动 Sentinel 即可;

五、CAP定理

5.1 概念

CAP 定理指的是在分布式系统中,

一致性 Consistency、可用性 Availability、分区容错性 Partition tolerance,三者不可兼得。

一致性(C):分布式系统中多个主机之间是否能够保持数据一致的特性。即,当系统数据发生更新操作后,各个主机中的数据仍然处于一致的状态。

可用性(A):系统提供的服务必须一直处于可用的状态,即对于用户的每一个请求,系统总是可以在有限的时间内对用户做出响应。

分区容错性(P):分布式系统在遇到任何网络分区故障时,仍能够保证对外提供满足一致性和可用性的服务。

5.2 定理

CAP 定理的内容是:对于分布式系统,网络环境相对是不可控的,出现网络分区是不可避免

的,因此系统必须具备分区容错性。但系统不能同时保证一致性与可用性。即要么 CP,要么 AP。

5.3 BASE理论

BASE 是 **Basically Available(基本可用)、Soft state(软状态)和 Eventually consistent(最终一致性)**三个短语的简写,BASE 是对 CAP 中一致性和可用性权衡的结果,其来源于对大规模互联网系统分布式实践的结论,是基于 CAP 定理逐步演化而来的;

BASE 理论的核心思想是:即使无法做到强一致性,但每个系统都可以根据自身的业务特点,采用适当的方式来使系统达到最终一致性;

5.3.1 基本可用

基本可用是指分布式系统在出现不可预知故障的时候,允许损失部分可用性。

5.3.2 软状态

软状态,是指允许系统数据存在的中间状态,并认为该中间状态的存在不会影响系统的整体可用性,即允许系统主机间进行数据同步的过程存在一定延时。软状态,其实就是一种灰度状态,过渡状态。

5.3.3 最终一致性

最终一致性强调的是系统中所有的数据副本,在经过一段时间的同步后,最终能够达到一个一致的状态。因此,最终一致性的本质是需要系统保证最终数据能够达到一致,而不需要保证系统数据的实时一致性;

5.4 CAP的应用

在实际分布式系统中,P(分区容忍性)是必须的 ,因此系统设计通常是在 C 和 A 之间做权衡。

| 系统名称 | CAP 模式 | 一致性(C) | 可用性(A) | 分区容忍性(P) | 关键行为说明 |

|---|---|---|---|---|---|

| Zookeeper | CP | ✅ 强一致性 | ⚠️ 牺牲可用性 | ✅ 高度支持 | 当 Leader 数据变更,Follower 未同步完成前,集群不对外提供写服务;若发生网络分区或 Leader 选举,短暂不可用,但保证数据一致。选举速度快,重试对用户几乎无感。 |

| Consul | CP | ✅ 强一致性 | ⚠️ 牺牲可用性 | ✅ 高度支持 | 基于 Raft 算法,写操作必须通过 Leader,且多数节点确认才成功;在网络分区时,多数派可继续服务,少数派拒绝请求以保一致性,牺牲部分可用性。 |

| Redis(主从/哨兵) | AP | ⚠️ 牺牲强一致性 | ✅ 高可用性 | ✅ 支持 | 主从异步复制,主节点宕机时可能丢失未同步数据;但系统始终可写(即使数据不一致),优先保证服务可用性。 |

| Eureka | AP | ⚠️ 牺牲强一致性 | ✅ 高可用性 | ✅ 支持 | 每个节点独立运行,支持自我保护模式;在网络分区时仍可接受注册和查询,数据最终一致,但不保证强一致。 |

| Nacos | AP (默认) 支持切换为 CP | ⚠️ 默认最终一致 ✅ 可切为强一致 | ✅ 高可用性 ⚠️ CP 模式下降低可用性 | ✅ 支持 | 作为注册中心时默认采用 AP 模式(类似 Eureka);可通过接口切换为 CP 模式(基于 Raft),用于配置中心场景,保证一致性。 |

六、Raft算法

Raft 算法是一种通过对日志复制管理来达到集群节点一致性的算法。这个日志复制管理发生在集群节点中的 Leader 与 Followers 之间。Raft 通过选举出的 Leader 节点负责管理日志复制过程,以实现各个节点间数据的一致性。

在 Raft 中,节点有三种角色:

Leader:唯一负责处理客户端写请求的节点;也可以处理客户端读请求;同时负责日志复制工作;

Candidate:Leader 选举的候选人,其可能会成为 Leader。是一个选举中的过程角色;

Follower:可以处理客户端读请求;负责同步来自于 Leader 的日志;当接收到其它Cadidate 的投票请求后可以进行投票;当发现 Leader 挂了,其会转变为 Candidate 发起Leader 选举;

6.1 Leader选举

通过 Raft 算法首先要实现集群中 Leader 的选举;

6.1.1 我要选举

若 follower 在心跳超时范围内没有接收到来自于 leader 的心跳,则认为 leader 挂了。此时其首先会使其本地 term 增一。然后 follower 会完成以下步骤:

① 此时若接收到了其它 candidate 的投票请求,则会将选票投给这个 candidate;

② 由 follower 转变为 candidate;

③ 若之前尚未投票,则向自己投一票;

④ 向其它节点发出投票请求,然后等待响应。

6.1.2 我要投票

follower 在接收到投票请求后,其会根据以下情况来判断是否投票:

① 发来投票请求的 candidate 的 term 不能小于我的 term

② 在我当前 term 内,我的选票还没有投出去

③ 若接收到多个 candidate 的请求,将采取 first-come-first-served 方式投票

6.1.3 等待响应

当一个 Candidate 发出投票请求后会等待其它节点的响应结果。这个响应结果可能有三种情况:

① 收到过半选票,成为新的leader。然后会将消息广播给所有其它节点,以告诉大家我是新的 Leader 了;

② 接收到别的 candidate 发来的新 leader 通知,比较了新 leader 的 term 并不比自己的 term 小,则自己转变为 follower;

③ 经过一段时间后,没有收到过半选票,也没有收到新 leader 通知,则重新发出选举;

6.1.4 选举时机

在很多时候,当Leader真的挂了,Follower几乎会同时感知到,所以几乎同时会变为candidate发起新的新的选举。此时就可能会出现较多 candidate 票数相同的情况,即无法选举出 Leader。

为了防止这种情况的发生,Raft 算法其采用了 randomized election timeouts 策略来解决这个问题。其会为这些 Follower 随机分配一个选举发起时间 election timeout,这个 timeout 在 150-300ms 范围内。只有到达了 election timeout 时间的 Follower 才能转变为 candidate,否则等待。那么 election timeout 较小的 Follower 则会转变为 candidate 然后先发起选举,一般情况下其会优先获取到过半选票成为新的 leader。

6.2 数据同步

在 Leader 选举出来的情况下,通过日志复制管理实现集群中各节点数据的同步。

6.2.1 状态机

Raft 算法一致性的实现,是基于日志复制状态机的。状态机的最大特征是,不同 Server 中的状态机若当前状态相同,然后接受了相同的输入,则一定会得到相同的输出。

6.2.2 处理流程

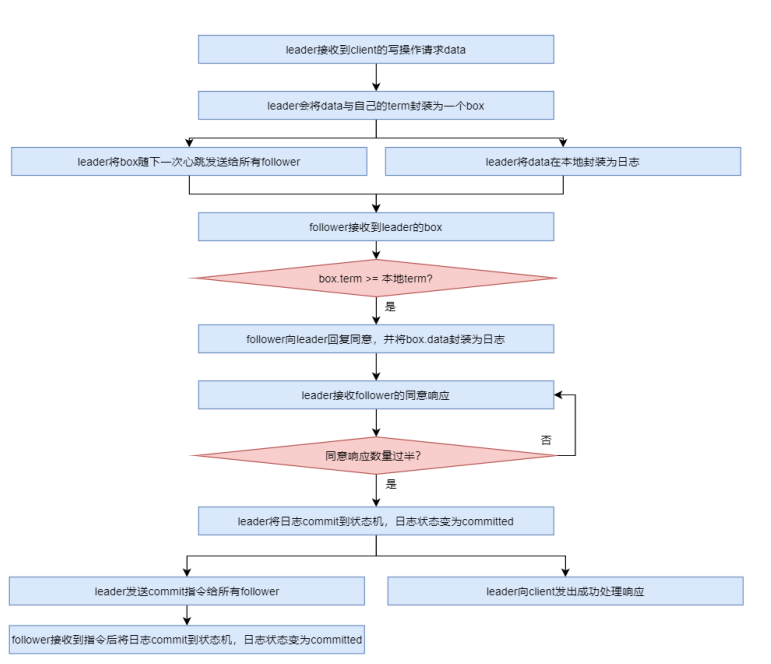

当 leader 接收到 client 的写操作请求后,大体会经历以下流程:

① leader 在接收到 client 的写操作请求后,leader 会将数据与 term 封装为一个 box,并随着下一次心跳发送给所有 followers,以征求大家对该 box 的意见。同时在本地将数据封装为日志;

② follower 在接收到来自 leader 的 box 后首先会比较该 box 的 term 与本地记录的曾接受过的 box 的最大 term,只要不比自己的小就接受该 box,并向 leader 回复同意。同时会将该 box 中的数据封装为日志。

③ 当 leader 接收到过半同意响应后,会将日志 commit 到自己的状态机,状态机会输出一个结果,同时日志状态变为了 committed;

④ leader 还会通知所有 follower 将日志 commit 到它们本地的状态机,日志状态变为了 committed ;

⑤ 在 commit 通知发出的同时,leader 也会向 client 发出成功处理的响应;

6.2.3 AP支持

Log由term index, log index 及command构成。为了保证可用性,各个节点中的日志数量 可以不完全相同,但 leader 会不断给 follower 发送 box,以使各个节点的 log 最终达到相同。即 raft 算法不是强一致性的,而是最终一致的。

6.2.4 脑裂

Raft 集群存在脑裂(分布式系统常见)问题。在多机房部署中,由于网络连接问题,很容易形成多个分区。而多分区的形成,很容易产生脑裂,从而导致数据不一致。

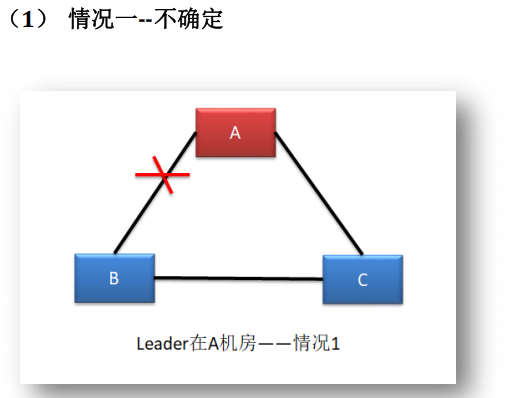

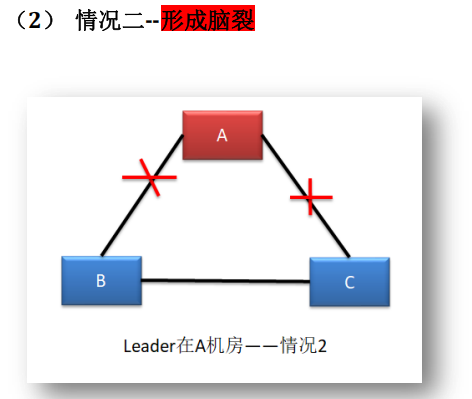

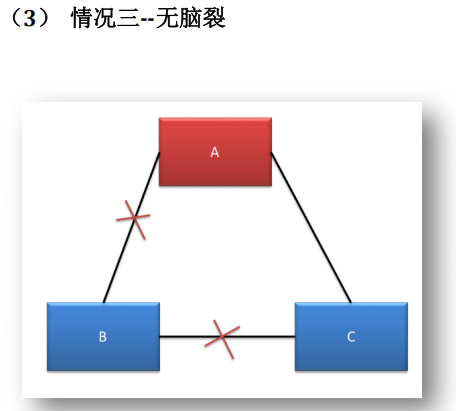

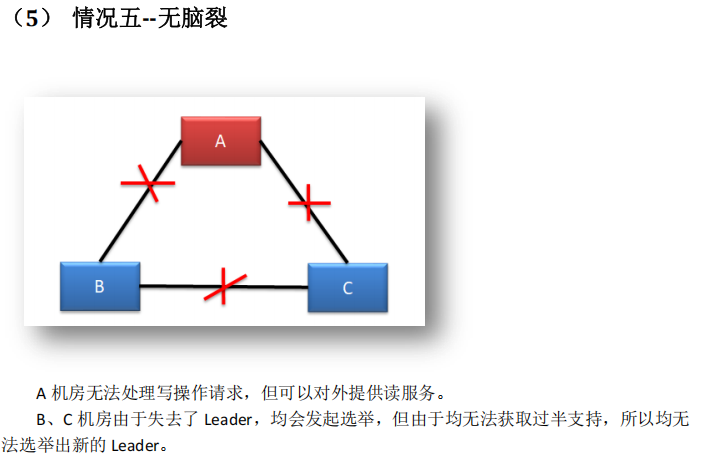

由于三机房部署的容灾能力最强,所以生产环境下,三机房部署是最为常见的。下面以三机房部署为例进行分析,根据机房断网情况,可以分为五种情况:

B机房的主机是感知不到Leader存在的,所以B机房中的主机会发起新一轮的Leader选举,由于B机房与C 机房是相连的,虽然 C 机房中的 Follower 能够感知到 A 机房中的Leader,但由于其接收到了更大 term 的投票请求,所以 C 机房的 Follower 也就放弃了 A 机房中的 Leader,参与了新 Leader 的选举;

若新 Leader 出现在 B 机房,A 机房是感知不到新 Leader 的诞生的,其不会自动下课,所以会形成脑裂。但由于 A 机房 Leader 处理的写操作请求无法获取到过半响应,所以无法完成写操作。但 B 机房 Leader 的写操作处理是可以获取到过半响应的,所以可以完成写操作。故,A 机房与 B、C 机房中出现脑裂,且形成了数据的不一致。

若新 Leader 出现在 C 机房,A 机房中的 Leader 则会自动下课,所以不会形成脑裂。

一定会形成脑裂,无论新 Leader 在 B 还是 C 机房;

A、C 可以正常对外提供服务,但 B 无法选举出新的 Leader。由于B中的主机全部变成了选举状态,所以无法提供任何服务,没有形成脑裂;

6.2.5 Leader宕机处理

① 请求到达前Leader挂了

client 发送写操作请求到达 Leader 之前 Leader 就挂了,因为请求还没有到达集群,所以这个请求对于集群来说就没有存在过,对集群数据的一致性没有任何影响。Leader挂了之后,选举产生新的Leader;

由于 Stale Leader 并未向 client 发送成功处理响应,所以 client 会重新发送该写操作请求;

② 未开始同步数据前Leader挂了

client 发送写操作请求给 Leader,请求到达 Leader 后,Leader 还没有开始向 Followers 发出数据 Leader 就挂了。这时集群会选举产生新的 Leader。

Stale Leader 重启后会作为Follower 重新加入集群,并同步新 Leader 中的数据以保证数据一致性。之前接收到 client 的数据被丢弃。

③ 同步完部分后Leader挂了

client 发送写操作请求给 Leader,Leader 接收完数据后向所有 Follower 发送数据。在部分 Follower 接收到数据后 Leader 挂了。由于 Leader 挂了,就会发起新的 Leader 选举。

- 若Leader 产生于已完成数据接收的 Follower,其会继续将前面接收到的写操作请求转换为日志,并写入到本地状态机,并向所有 Flollower 发出询问;在获取过半同意响应后会向所有 Followers 发送 commit 指令,同时向 client 进行响应。

- 若 Leader 产生于尚未完成数据接收的 Follower,那么原来已完成接收的 Follower 则会放弃曾接收到的数据。由于 client 没有接收到响应,所以 client 会重新发送该写操作请求。

④ commit通知发出后Leader挂了

client 发送写操作请求给 Leader,Leader 也成功向所有 Followers 发出的 commit 指令,并向client发出响应后,Leader挂了;

由于 Stale Leader 已经向 client 发送成功接收响应,且 commit 通知已经发出,说明这个写操作请求已经被 server 成功处理。