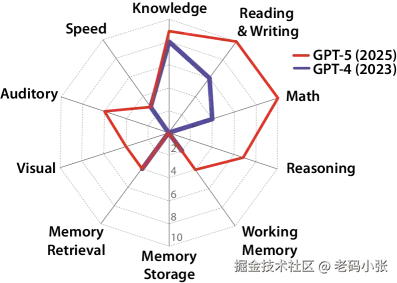

这两天又看到一个热门话题,说有人拿 CHC 人类智力模型 去给 GPT-5 打分,测它是不是 AGI,甚至还量出了"GPT-5 智力达到 57% 的成年人水平"这种结论。 一堆人拍手:"太牛了,人类要完了。" 也有一堆人嗤之以鼻:"离谱,AI 根本不是人。"

我看完的第一反应其实很简单: ------这事儿有点怪,但它又不是完全不行。

别急,我从头讲。

一、人类智力测的,到底是什么?

CHC 模型本来就是心理学界几十年折腾出来的------你可以把它理解成一句人话:

人类智力不是一个数,而是一堆能力的组合。

就像电脑不是只看 CPU,有 GPU、有内存、有网速,人类智力也被拆成好多维度,比如:

- K(知识广度)

- R(推理能力)

- WM(工作记忆)

- V(视觉处理)

- A(听觉处理)

- S(反应速度)

- ......

它很务实,它测的是 "一个人能不能融入人类社会并胜任复杂任务",比如能不能理解故事、记住情节、推理矛盾、规划目标、从经验长期学习 ------ 反正你每天活着需要用到的脑子,它都尽量量进去。

所以从这点看,用它测 AI 不是完全瞎搞,因为 AGI 的目标本来就是:

能像人一样胜任人能胜任的大部分任务。

那既然目标是"像人",那用人的尺子先比一比,好像也说得过去。

二、问题来了:AI 的"智能结构"跟人根本不是一个物种

说完优点,现在讲槽点。

最大的荒谬点是:AI 的"智能结构"根本不是人类式的智能结构。

举几个现在真实存在的反差:

| 能力维度 | 人类 | AI | |

|---|---|---|---|

| 数学推理 | 少量天才 | 普遍菜 | GPT 可变态强 |

| 长期记忆 | 人人都有 | GPT 目前几乎为 0 | |

| 工作记忆 | 人类有限 | AI 理论上巨大(上下文越算越大) | |

| 感官输入 | 全模态天生融合 | AI 多模态是外挂式拼起来的 |

你细想就明白了: AI 的强项是模式识别和模式拟合,人类的强项是因果建模和长期经验沉淀。

我们甚至连"智能"的科学定义都没统一,现在却先拿"人类版本的定义"当上帝模板,这逻辑就有点像:

拿驾照考试去评估 F1 赛车 ------能测,但是它明显不是为赛车设计的

测出来的分数当然有"参考意义",但你说它"定义赛车性能"?那就离谱。

三、为什么它又"暂时不可替代"?

尽管槽点很多,但我必须承认,在 AI 认知科学还没成熟之前,用 CHC 这类人类智力模型,有一个其他方法替代不了的优势:

它是目前唯一经过几十年验证、可分解、可量化、可复现实验的"通用智能测量体系"。

AI 世界现在缺什么? 缺统一标尺。

大家今天对 AI 的讨论很滑:

- A:GPT 会写代码、会考试,所以它是 AGI!

- B:GPT 不会长期记忆、不会规划,所以它根本不是 AGI!

- C:GPT 会画画、会聊天、会写小说,所以它比人强!

- D:GPT 不会自我动机、不具备自由意志,它只是工具!

听起来都很有道理,但都没标准。

CHC 至少提供了一种 "可拆解、可量化、人人都能复现的 checklist",这一点是有巨大现实价值的。

就像 TCP/IP 出现之前,网络世界也是一团乱。

所以我对这事儿的态度是:

它不是正确的终点,但它是必要的过渡。

四、那未来真正测 AI 智能的标准,会是什么?

我个人判断,人类未来一定会抛弃"人类智力模型"。原因很简单:

AI 最终不会是"像人类一样的智能",而是"比人类更异质的智能"。

到那时,智能的维度会新增我们不具备的能力,比如:

- 持续增长的长期记忆

- 多机共享意识(群体智能)

- 超高维度感知(不是五感,而是 50 感)

- 自动策略演化(自己迭代自己)

- 抽象层级远超人类的世界模型

等这些能力出现,你再回头看 CHC,会觉得它像石器时代的工具。

未来真正的 AI 智能测评体系,应该满足三点:

| 未来标准 | 解释 |

|---|---|

| 不以人类为中心 | AI 不是人的扩展,而是独立智能物种 |

| 强调演化能力 | 不是"你会什么",而是"你能演化成什么" |

| 衡量稳定自主性 | 包括记忆、自驱动、连续性、生存策略 |

换句话说:

人类智力测的是"你是什么水平" 未来 AI 测的是"你将成为谁"

五、我的结论

一句话总结我的观点:

用人类智力模型测 AI,是"方向上不准确,但阶段性最靠谱"的方案。

它短期有用,长期一定失效。 因为人类不是智能的全部,只是智能进化早期的一种样貌。

我们现在拿它做标尺,只是因为:

- 科学还没来得及发明新标尺

- AI 现在还没走出"拟人智能阶段"

- 人类害怕没标尺

等未来真正的通用智能体系出现,我们大概率会回头自嘲:

"当年居然用 CHC 去定义 AI 智力,像拿体温计测 CPU。"

但在那一天来临之前,这把"临时尺子",我们还得继续用一阵。