昨夜,黄仁勋又"炸场"了。

在 2025 年 10 月的 GTC 大会上,从量子计算到6G通信,从超级芯片到AI工厂,黄伟达在华盛顿勾勒出美国AI世纪的宏伟蓝图。

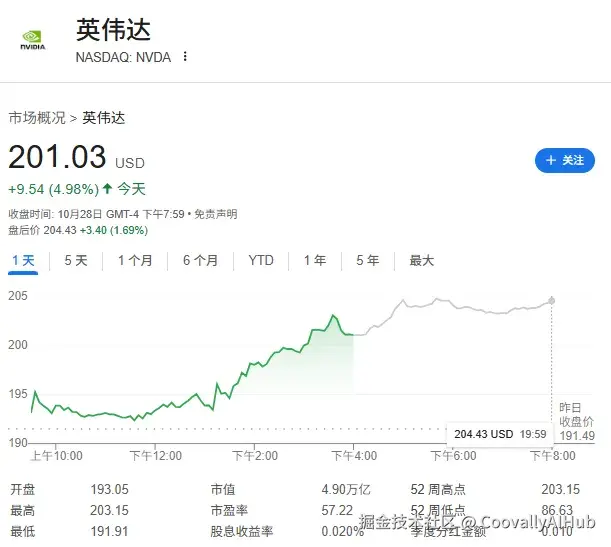

在黄仁勋GTC主题演讲结束后,英伟达股价应声上涨4.98% ,市值单日增加2300多亿美元,达到惊人的4.89万亿美元,盘中甚至触及4.94万亿美元的历史高点。

一场演讲,几乎定义了未来十年的算力方向。

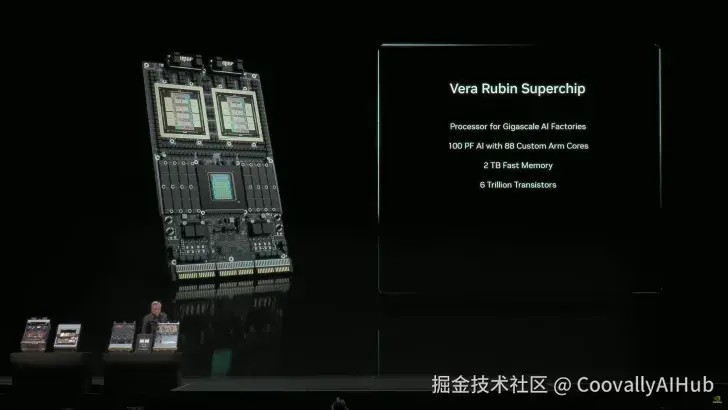

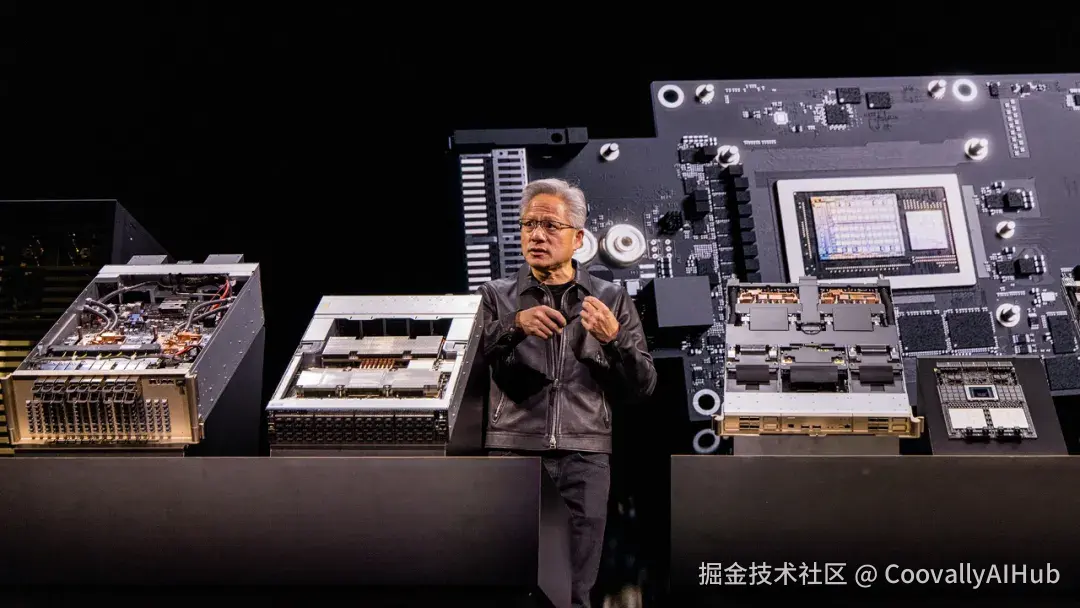

Vera Rubin 超级芯片正式亮相

在GTC大会上,黄仁勋首次向世界展示了下一代Vera Rubin****超级芯片的实际样品,这被称为"超级芯片"的主板搭载了Vera CPU和两颗强大的Rubin GPU。

这是一块前所未见的"主板级计算怪兽":

- CPU: Vera 架构,88 个定制 ARM 核心,176 线程;

- GPU: 两颗 Rubin GPU,每颗包含两片 Reticle 大小芯片;

- 显存: 8 个 HBM4 显存位点,总计 288 GB;

- 系统内存: 32 组 LPDDR;

- 互连带宽: NVLINK-C2C,速率高达 1.8 TB/s。

这台"巨兽"不仅计算性能恐怖,更重要的是,它标志着英伟达正式跨入 CPU + GPU + Memory + Network 的统一算力架构时代。

黄仁勋透露,Rubin GPU 已经重返实验室,由台积电代工生产,预计将在 2026 年第三季度进入量产。

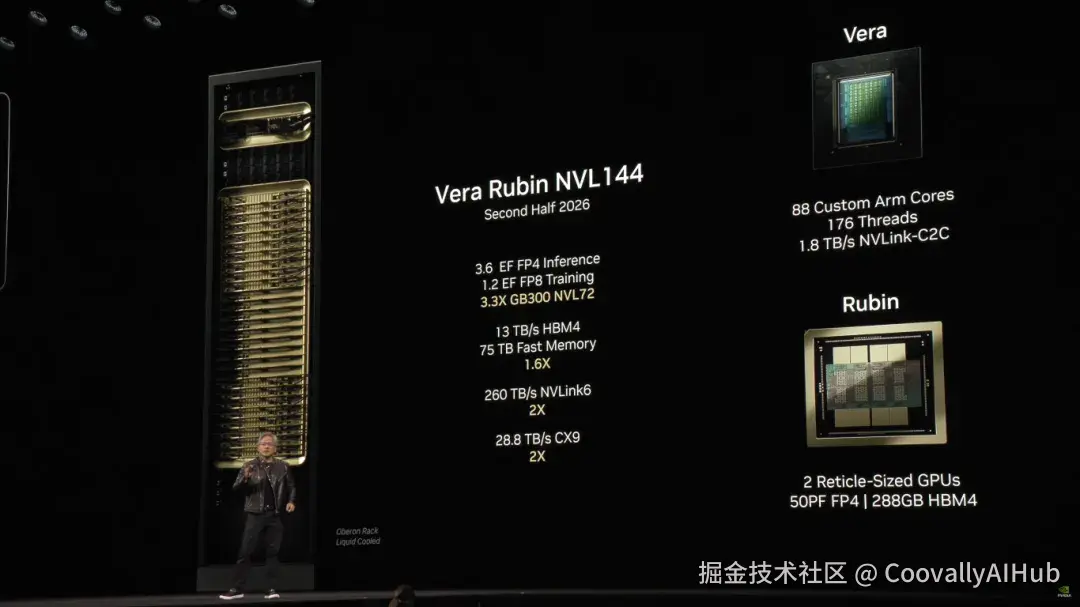

NVL144 平台性能:3.6 Exaflops 的怪物

规格方面,NVIDIA Vera Rubin NVL144平台采用两颗全新芯片:

- Rubin GPU: 两颗Reticle大小芯片,FP4性能高达50 PFLOP

- 配备288 GB的下一代HBM4显存

- 88核Vera CPU,定制Arm架构,176线程

- 高达1.8 TB/s的NVLINK-C2C互连

性能参数堪称离谱:

- FP4 推理性能: 3.6 Exaflops;

- FP8 训练性能: 1.2 Exaflops;

- 内存带宽: 13 TB/s;

- 快速内存: 75 TB;

NVLINK 与 CX9 速率:分别高达 260 TB/s 与 28.8 TB/s。

相比上一代 Blackwell GB300 NVL72,整整提升 3.3 倍性能、60% 内存容量,互联速率翻倍。

而下一代加强版------Rubin Ultra NVL576 ------计划于 2027 年登场,GPU 数量翻倍,HBM4e 内存总容量达到 1 TB,FP4 性能直飙 15 Exaflops。

从 CPU 到 GPU 加速计算:英伟达的终极回答

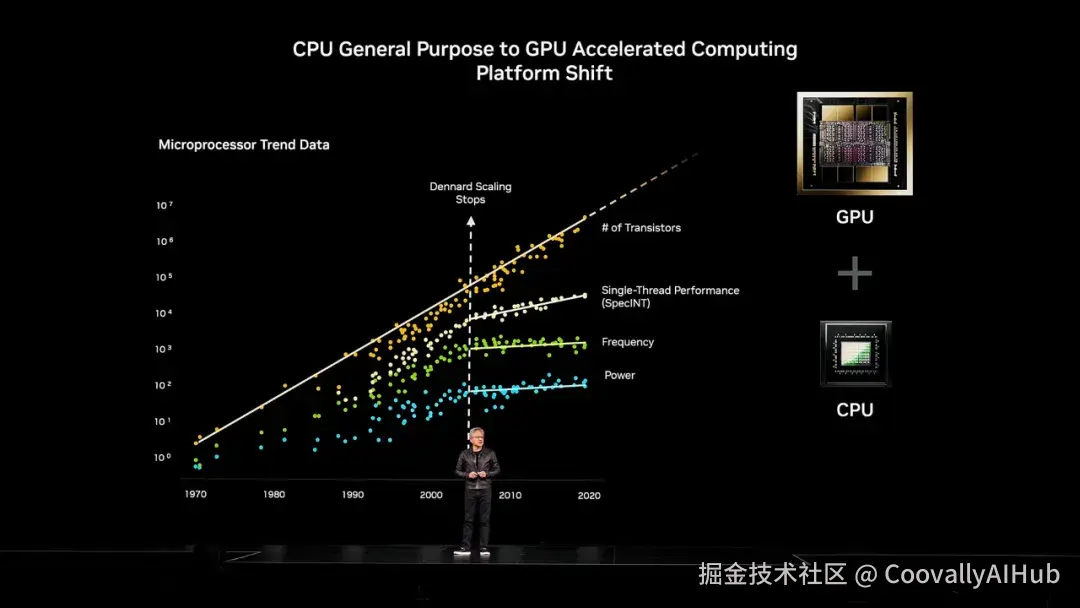

黄仁勋回顾了计算架构的演变历程:"几十年来,CPU的性能增长一直如时钟般精准------直到登纳德缩放定律失效。"

英伟达的答案是并行计算、GPU和加速计算。"我们发明这种计算模型,是因为我们想解决通用计算机无法解决的问题。"黄仁勋解释道。

当摩尔定律和登纳德缩放定律失效后,CPU 性能的线性增长停滞,而英伟达用 GPU 并行计算重新点燃了算力曲线。

如今,整个 CUDA-X 生态已经成为英伟达的护城河:

从深度学习的 cuDNN、推理引擎 TensorRT-LLM,到量子计算的 CUDA-Q,再到光刻计算的 cuLitho,几乎覆盖了所有高性能计算方向。

这不仅是硬件进化,更是软件定义计算的胜利。

AI 原生 6G:英伟达 x 诺基亚联手破局

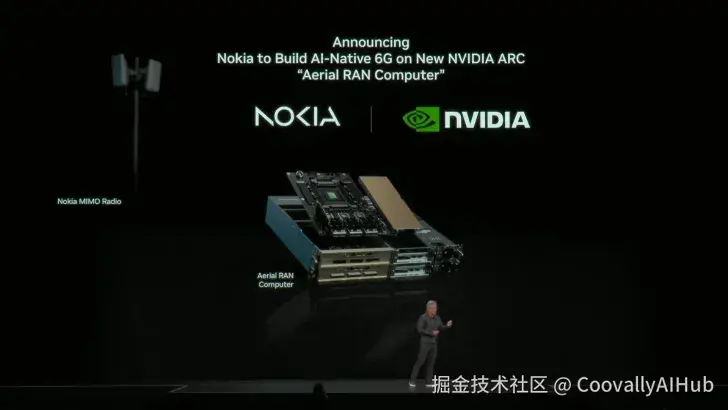

在一项出乎意料的合作中,英伟达宣布与诺基亚联手,利用新型AI-RAN产品(包括Grace CPU和Blackwell GPU)实现6G连接。

黄仁勋强调电信业对国家的重要性:"电信是我们经济和国家安全的命脉。然而,如今全球范围内的无线技术在很大程度上依托外国技术部署,我们的基础通信技术建立在外国技术之上,这种情况必须停止------而且我们有机会做到这一点。"

他坚定地表示:"是时候'重返赛场'了。"

英伟达将以每股6.01美元的价格向诺基亚投资10亿美元,共同开启AI原生无线时代,为AI赋能的消费者体验和边缘企业服务奠定基础。

英伟达为该项目推出的全新产品系列名为ARC(空中RAN计算机)。黄仁勋透露:"ARC将搭载Grace CPU和Blackwell GPU,标志着电信基础设施首次拥有如此强大的性能。"

ARC生态系统将集成到诺基亚现有的RAN建设中,使客户能够无缝过渡到6G。诺基亚将加速其5G和6G RAN软件在NVIDIA CUDA平台上的部署,通过将NVIDIA ARC-Pro嵌入到全新AI-RAN解决方案的核心中,扩展其RAN产品组合。

这项技术即将走向现实:网络运营商T-Mobile将于2026年开始对AI-RAN技术进行"现场测试",为美国6G创新铺平道路。

量子飞跃:NVQLink连接量子与GPU计算

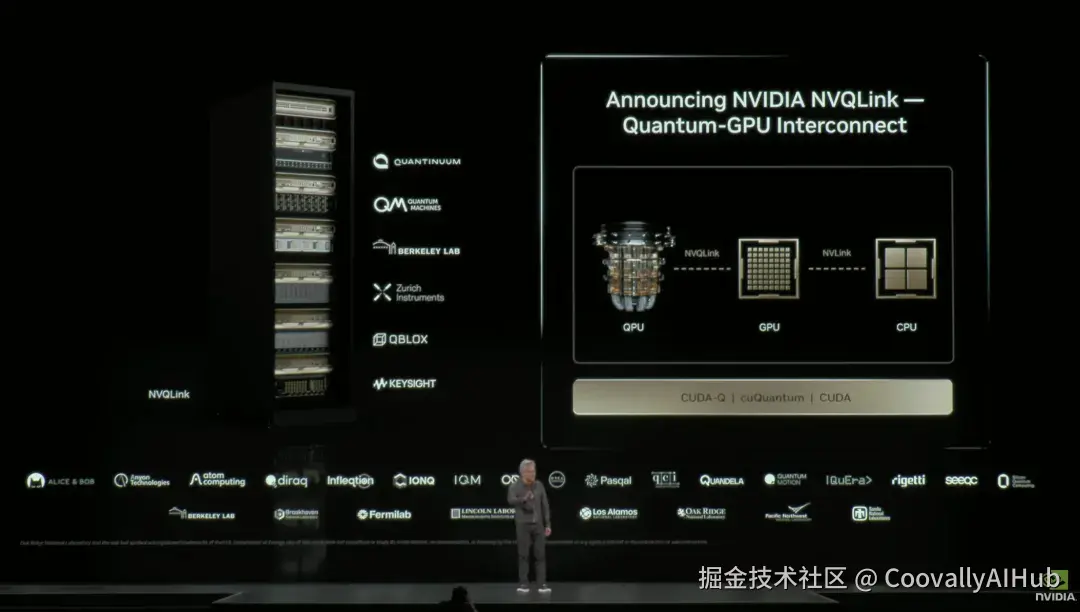

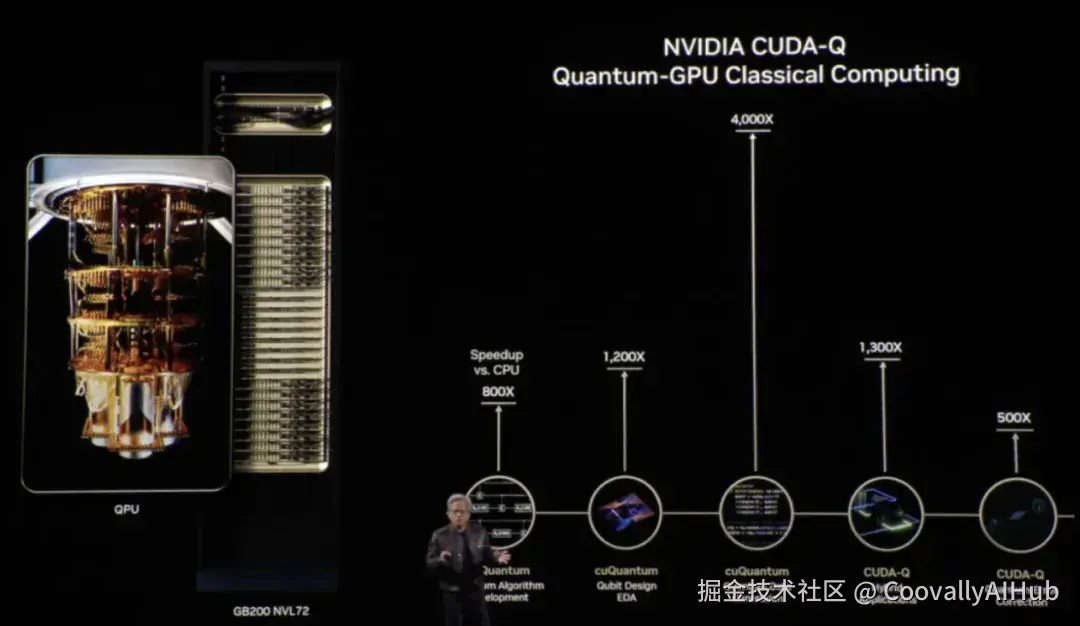

四十年前,量子物理学家理查德·费曼设想了一种能直接模拟自然现象的新型计算机。如今,英伟达正将这一愿景变为现实。

黄仁勋表示,现在已经可以制造出相干、稳定且能纠错的逻辑量子比特,但这些量子比特"极为脆弱",需要强大的技术来进行量子纠错。

为了连接量子计算和GPU计算,英伟达宣布推出NVQLink------一种量子GPU互连技术,可实现从QPU进行实时CUDA-Q调用,延迟低至约4微秒。

"几乎每个能源部实验室都在与我们的量子计算公司生态系统以及这些量子控制器合作,以便将量子计算融入到未来的科学发展中。"黄仁勋展示的幻灯片上列出了17家量子计算公司和多个美国能源部实验室的支持。

AI工厂:从工具到AI工作者的转变

"AI不是工具,AI本身就是工作。"黄仁勋宣称,"技术第一次能够真正干活,帮助我们提高生产力。这种从工具到AI工作者的转变,正在创造全新的计算形式。"

AI工厂是专门构建的平台,用于大规模生成、移动和服务token,而不仅仅是传统的数据中心。

"然后,因为AI是一个如此庞大的问题,我们对其进行了纵向扩展。我们创造了一台完整的计算机......这是第一次,一台计算机被扩展成了整个机架。"黄仁勋解释道。

随着这些AI工厂的崛起,它们正在催生AI工程、机器人技术、量子科学和数字运营等领域的新职业------这些职位在几年前还根本不存在。

"这个良性循环现在已经启动了。"黄仁勋说,"我们需要做的,是大幅降低成本。这样一来,首先,用户体验会更好......其次,通过降低成本,我们能让这个良性循环持续下去。"

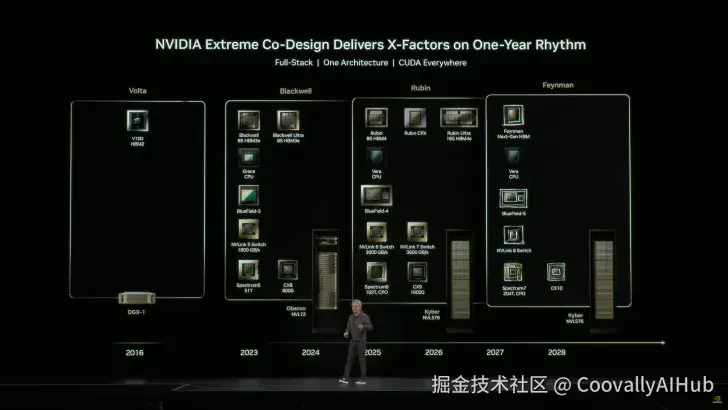

解决方案是"极限协同设计"------同时设计全新的基础计算机架构,包括新的芯片、系统、软件、模型和应用。

黄仁勋还发布了全新的NVIDIA BlueField-4 DPU,这款处理器配备了64核的NVIDIA Grace CPU和NVIDIA ConnectX-9,为其AI工厂的操作系统提供动力,计算能力约为BlueField-3的6倍。

发布Omniverse DSX:千兆瓦级AI工厂蓝图

黄仁勋介绍了Omniverse DSX,这是一个用于设计和运营100兆瓦到数千兆瓦级别AI工厂的综合蓝图。该蓝图已在弗吉尼亚州马纳萨斯的AI工厂研究中心得到验证。

DSX包括三个关键组件:

- DSX Flex: 用于动态电网协作

- DSX Boost: 用于优化每瓦性能

- DSX Exchange: 用于统一IT/OT集成

"AI基础设施是一个生态系统级别的挑战,需要数百家公司协同合作。NVIDIA Omniverse DSX是一个用于构建和运营千兆瓦级AI工厂的蓝图。"黄仁勋表示,"借助DSX,英伟达在全球的合作伙伴能够以前所未有的速度构建和启动AI基础设施。"

自动驾驶再加速:Hyperion 10 来了

黄仁勋宣布,Uber和英伟达正在合作构建自动驾驶出行的中坚力量------目标是部署约100,000辆自动驾驶汽车,并从2027年开始规模化。

NVIDIA DRIVE AGX Hyperion 10是L4级别的参考架构:它安全、可扩展、由软件定义------将人类驾驶员和机器人驾驶员统一在同一个网络上。

"在未来,你将能叫到这样一辆车。"黄仁勋说,"这个生态系统将变得极其丰富,我们的Hyperion自动驾驶出租车将遍布世界各地。"

多家汽车制造商已加入这一生态系统:Lucid、梅赛德斯-奔驰和Stellantis集团正在为其具备L4级别能力的乘用车采用DRIVE Hyperion。

为什么这次 GTC 值得关注?

- 行业拐点正在加速: AI 从"算法"进化到"算力 + 网络 + 量子"四维融合,NVIDIA 正在定义新一轮科技周期的基石。

- 技术红利正下沉: 从云端到制造、通信、交通、机器人,AI 正在深入实体经济。

- 战略信号强烈: 在中美竞争背景下,英伟达选择在华盛顿举办 GTC、强调美国制造,这不仅是技术动作,更是地缘政治的宣言。

英伟达不只是卖芯片的公司,而是在重构"计算"这件事本身。

当 Vera Rubin、ARC、Omniverse DSX 和 NVQLink 一起登场,我们看到的,或许不是一次发布会------而是一个新的「AI 基础设施时代」的开端。