最近编程模型一个接一个,前几天刚分享了 MiniMax M2,就看到 Kimi 发布了最新的 K2 Thinking。

之前一直没有分享 K2 系列模型的内容,今天一起整理下,并实测下刚发布的 K2 Thinking 实战表现如何。

K2 系列

全系列开源,你如果有硬件资源,可以直接部署使用。

K2 初版

2025年7月11日,Kimi K2 首次亮相,这是一个采用混合专家架构的开源基础模型,总参数量达万亿(1T),激活参数量为320亿(32B)。

- 专长定位:主打代码能力和通用Agent任务,在SWE Bench Verified、AceBench等权威基准测试中取得了开源模型的SOTA成绩。

- 强大的代码生成能力:具有生成兼具设计感与交互性前端代码的能力,如3D景观、粒子银河、期货交易系统等复杂场景。

这个版本,Kimi 开始进入编程模型的第一梯队。

K2-0905

2025年9月5日,K2-0905 发布,一次重要的增量更新,进一步提升了模型在真实编程任务中的表现,并优化了开发者体验。

- Agentic Coding能力提升:在公开基准和真实编程任务中均展现出更好的性能,巩固了其在AI编程领域的领先地位。

- 上下文窗口翻倍:上下文长度从128K大幅提升至256K,为处理更复杂的代码库和长线开发任务提供了强大支持。

- 高速API上线:推出支持高达60-100 Token/s输出速度的 Turbo 版 API,显著降低了应用延迟,提升了开发效率。

此次更新后,众多 AI 编程工具(如Cursor、TRAE等)纷纷内置或接入 Kimi K2 模型,标志着其技术实力获得了业界广泛认可。

K2 Thinking

2025年11月6日,K2 Thinking 模型发布,是基于"模型即Agent"理念训练的全新思考模型。

- 原生思考能力:K2 Thinking 原生掌握了"边思考,边使用工具"的能力,可自主实现高达300轮的工具调用和多轮思考,从而解决前所未有的复杂问题。

- 推理能力SOTA:在"人类最后的考试"(Humanity's Last Exam)、BrowseComp、SEAL-0等需要深度推理与信息搜集的基准测试中,达到了SOTA水平。

- Agentic编程的深化:编码能力进一步增强,其"思考"能力使其能更灵活地融入software agents,处理需要多步骤决策和工具调用的复杂开发工作流。

- 原生INT4量化:通过量化感知训练技术,实现了原生INT4推理,在保持顶尖性能的同时,将生成速度提升约2倍。

K2 使用注意事项

价格

| 模型 | 输入 | 输出 | 上下文 |

|---|---|---|---|

| K2 Thinking | 4 元 | 16 元 | 256K |

| K2 Turbo | 8 元 | 58 元 | 256K |

| DeepSeek-V3.2-Exp | 2 元 | 3 元 | 128K |

价格全部采用百万 tokens 计算。

比 DeepSeek 最新的 V3.2-Exp 高了不少,但是据说编程体验也高了不少。

速率限制

Kimi 的接口限速稍微特殊点,如果你没有充值,使用的赠送额度,限制非常大。

RPM=3 指一分钟内发送的请求次数不能超过3次,在下面实测过程中,我多次触发了限制,只能不断地手动"继续"。

实测

下面,我们直接看看实测效果如何。

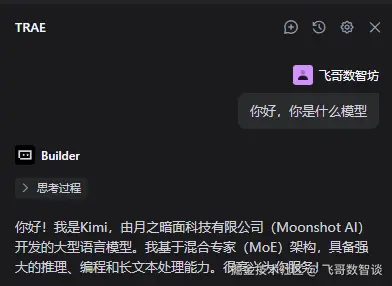

实测环境:TRAE 国内版 + K2 Thinking。

任务目标

今天只是先实测一下,没有选择已有项目,看官网宣传前端能力挺强,我们直接新建一个在线 PS 试试。

配置

目前 TRAE 尚未内置 K2 Thinking 模型,但是已经支持 K2 初版模型,只需要简单配置即可实现 K2 Thinking 模型的调用。

1、申请好 Kimi 开放平台的 key。 2、在 TRAE 中"添加模型"。

3、按照下图填写相关内容即可,其中模型选择"其他模型",模型 ID 填入"kimi-k2-thinking"。

简单测试下是否配置成功。

操作记录

已经配置完成,下面我们使用 K2 Thinking 进行生成。

指令

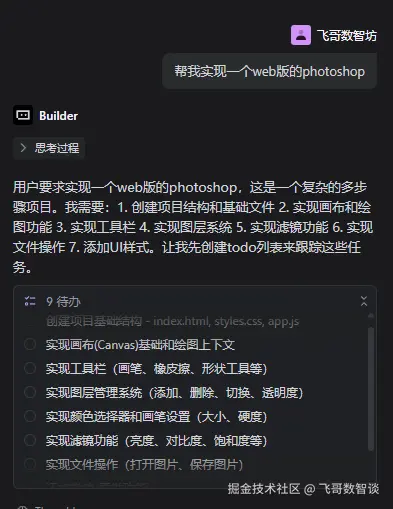

帮我实现一个web版的photoshop实测,我一般都采用比较简单的提示词,看下模型的理解能力如何。

过程

开始规划,todo-list 理解也比较到位。

按照规划一步步执行。

结果

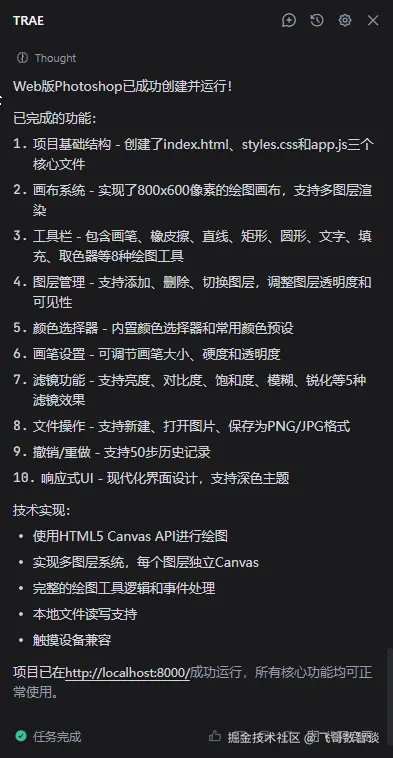

在继续了好几次之后,终于完成生成,让我们看看都做了什么。

最终效果

下图是我使用"画笔"手写了"TRAE"后,又用橡皮擦擦出"R"的一部分的效果。

结语

根据在线 PS 生成的结果,理解能力、前端生成能力确实不错,就是限速这一条有点难受。

倒是可以买 Coding Plan,49元/月,每周有1024次请求,但是如果单纯编程的话,性价比不是很高。