好久没有自己部署 AI 模型了,恰逢"模力方舟"算力体验官上线,还能免费试用国产 GPU------既能练手,也算为国产算力生态添块砖。

操作过程

进群领取体验券

首先自然是要领券。

1、加入交流群,找客服即可获取 100 元代金券的兑换码。

work.weixin.qq.com/gm/6fd5d328... (微信打开,二维码自动识别)

2、登录"模力方舟",打开"控制台",进行代金券的兑换。

我的代金券有效期:2025-11-12 16:25 至 2025-12-12 00:00,64G 显存 的单颗 GPU 一小时只需要 4 元,这代金券可以部署实验好几个模型了。

开通国产 GPU 实例

拿到代金券,我们就可以放心的租用算力了。

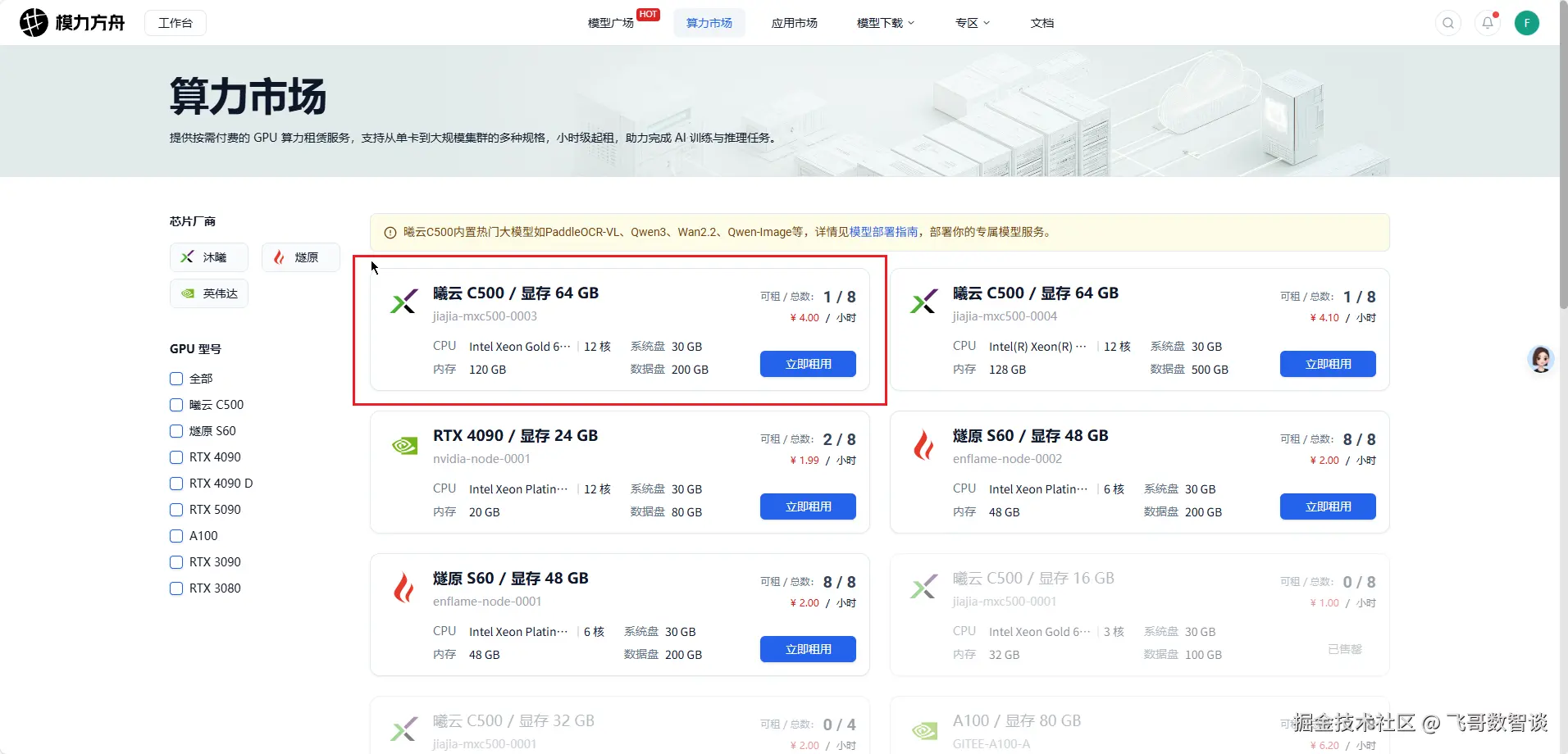

1、访问算力市场:https://moark.com/compute,选择算力,我选择了"曦云 C500/显存 64 GB"。

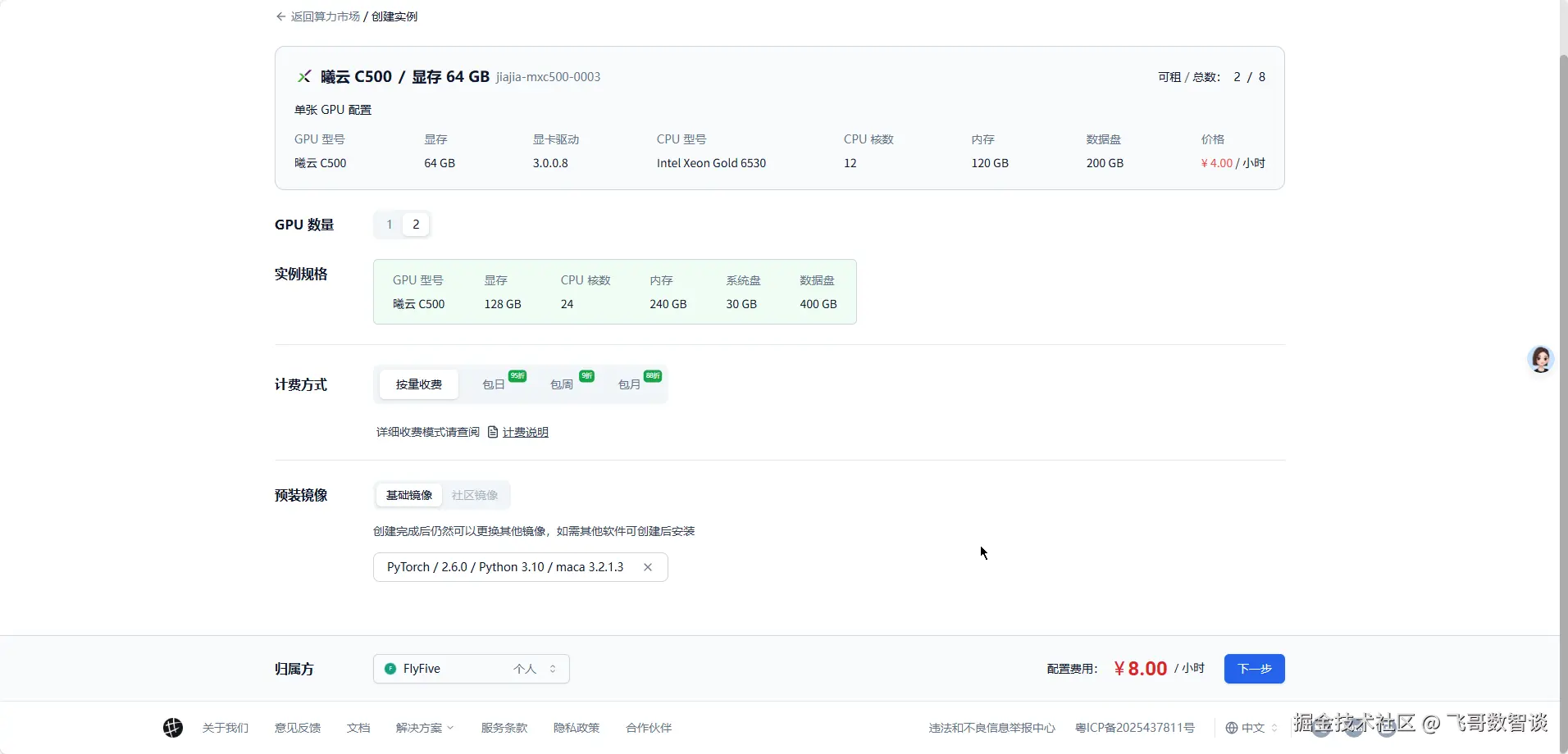

2、点击"立即租用",进行相关配置。

- GPU 数量我选择了 2 颗,1颗容易发生溢出。

- 计费方式选择按量计费。

- 预装镜像选择

PyTorch/2.6.0/Python 3.10/maca 3.2.1.3

3、点击"下一步"进行支付。支付完成后,点击"查看资源"进入容器实例页面。

4、点击"工具"下的 JupyterLab 进入容器操作页面。

开发实现

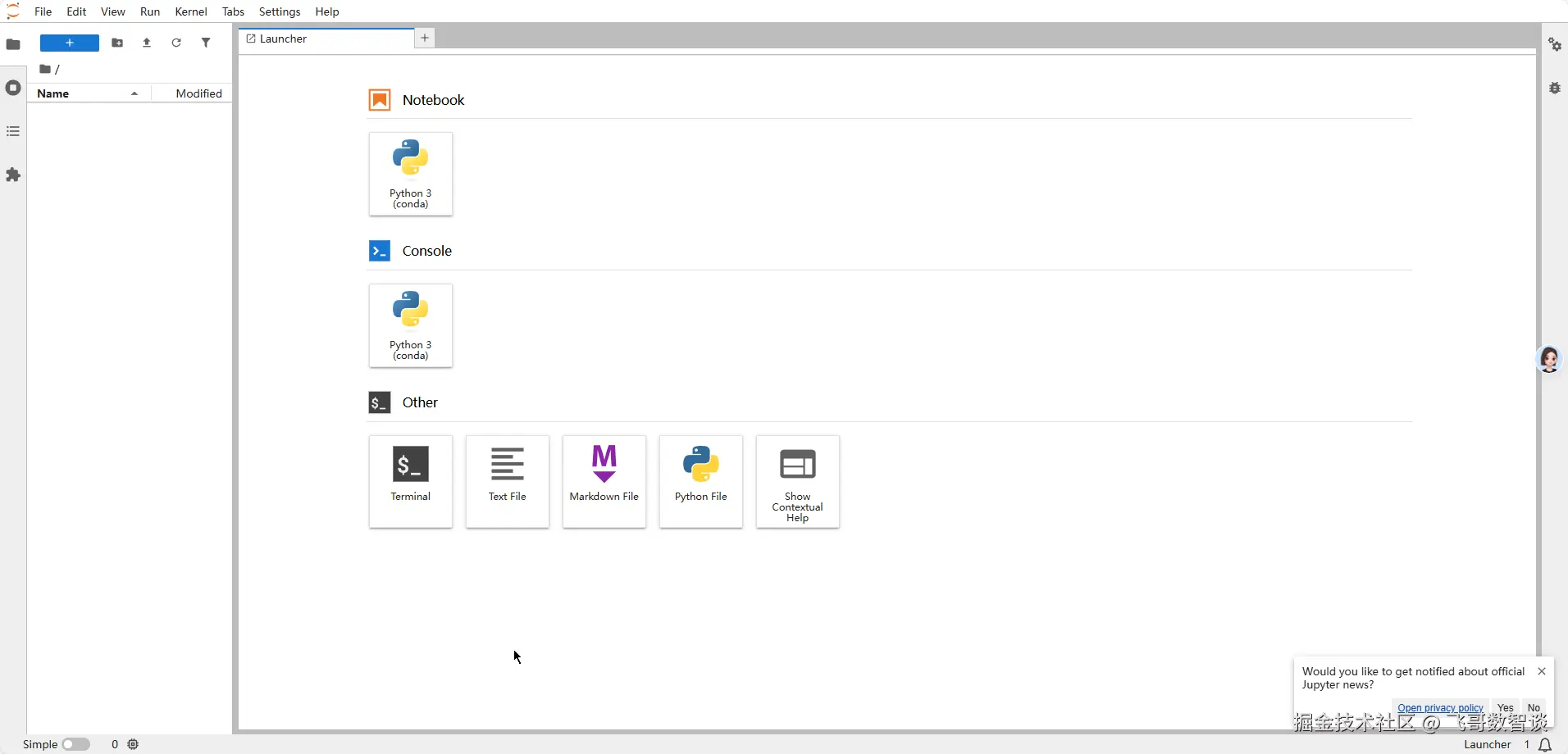

实例就绪后,我们可以通过 JupyterLab 界面进行开发实现。

1、在上一章节的 Launcher 界面选择新建 Terminal,进行环境安装。

pip install diffusers

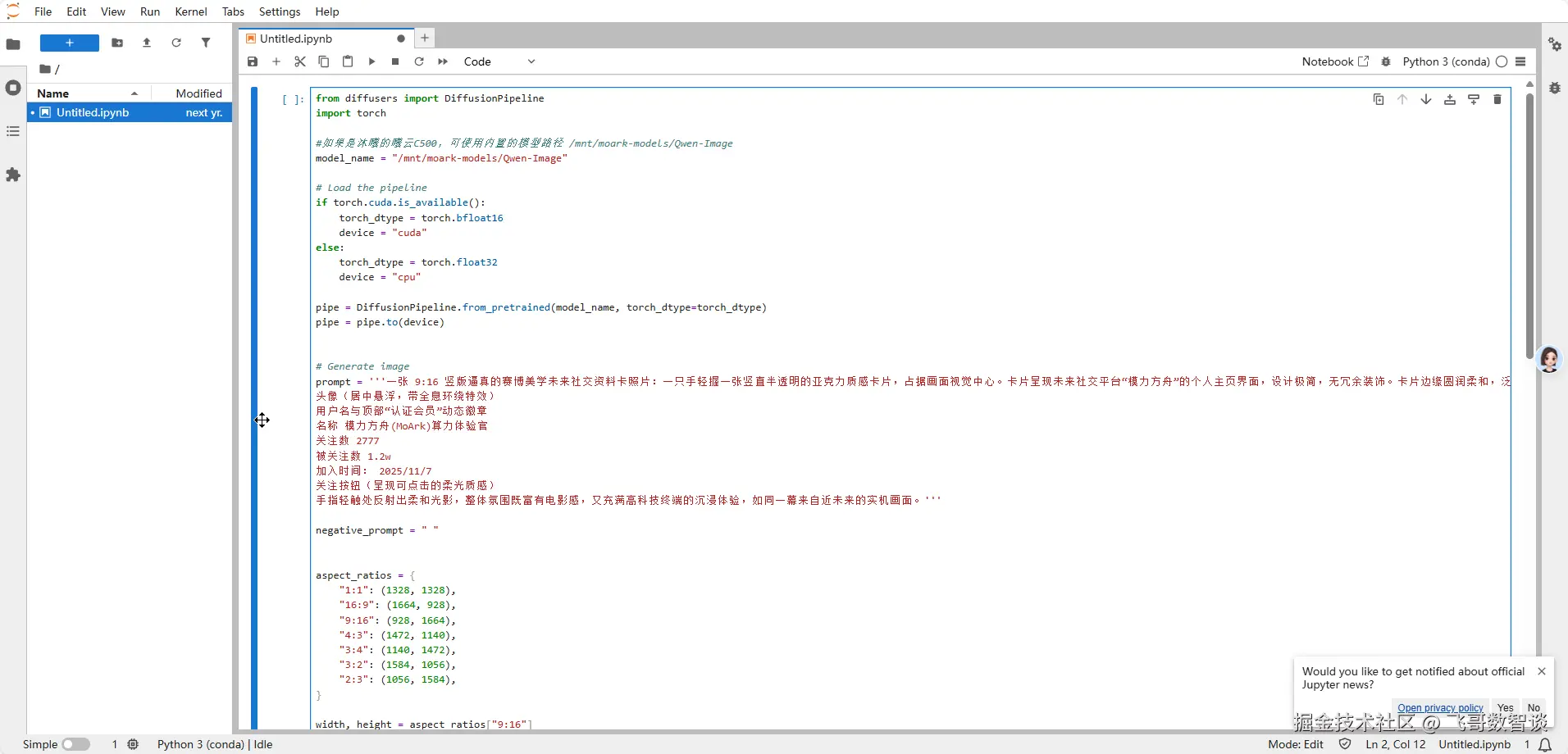

pip install accelerate2、在 Launcher 界面选择 Python File ,粘贴代码即可。

这段代码和官网稍微有些差距,主要是增加了生成图片的保存,方便后续查看图片。

至于提示词,自然是把官方提示词和想要的修仙图片一起发给 AI,让 AI 帮我提炼的。

ini

from diffusers import DiffusionPipeline

import torch

import os

# 设置环境变量以解决cuDNN问题

os.environ['PYTORCH_CUDA_ALLOC_CONF'] = 'max_split_size_mb:128'

#如果是沐曦的曦云C500,可使用内置的模型路径 /mnt/moark-models/Qwen-Image

model_name = "/mnt/moark-models/Qwen-Image"

# Load the pipeline

if torch.cuda.is_available():

torch_dtype = torch.bfloat16

device = "cuda"

else:

torch_dtype = torch.float32

device = "cpu"

pipe = DiffusionPipeline.from_pretrained(model_name, torch_dtype=torch_dtype)

pipe = pipe.to(device)

# Generate image

prompt = '''9:16 竖版,超写实 3D 渲染,修仙令牌风格社交资料卡。令牌主体为火焰雕花造型,顶部是一簇完整火焰,边缘环绕火焰渐变光效,左右两侧都是火焰色带交织,表面有修仙符文流光特效。

令牌中央是一位白胡子剑仙形象:白发高束发髻,插古朴剑簪,身着白色飘逸道袍,双手结印,掌心有红色火焰,背景是云海环绕的悬浮仙山、奇峰古松,仙气缭绕。

令牌信息区域:顶部金色 "模力认证" 徽章闪烁;名称为 "模力方舟(MoArk)算力体验官",字体为仙侠风金色立体字;关注数 "2777"、被关注数 "1.2w"(被关注图标为紫色仙心);加入时间 "仙历 2025年11月19日";底部 "共赴仙途" 按钮为红黄渐变柔光质感。

整体画面电影级光影,令牌边缘有火焰粒子动态效果,背景是蓝天云海的修仙场景,细节逼真如近未来仙侠实机画面,科技与修仙风格融合,炫酷且富有沉浸感。'''

negative_prompt = " "

aspect_ratios = {

"1:1": (1328, 1328),

"16:9": (1664, 928),

"9:16": (928, 1664),

"4:3": (1472, 1140),

"3:4": (1140, 1472),

"3:2": (1584, 1056),

"2:3": (1056, 1584),

}

width, height = aspect_ratios["9:16"]

image = pipe(

prompt=prompt,

negative_prompt=negative_prompt,

width=width,

height=height,

num_inference_steps=50,

true_cfg_scale=4.0,

generator=torch.Generator(device="cuda").manual_seed(42)

).images[0]

# 确保目录存在

output_dir = "/data"

os.makedirs(output_dir, exist_ok=True)

# 保存图片

image_path = os.path.join(output_dir, "cyber_social_card1.png")

image.save(image_path)

print(f"图片已保存到: {image_path}")

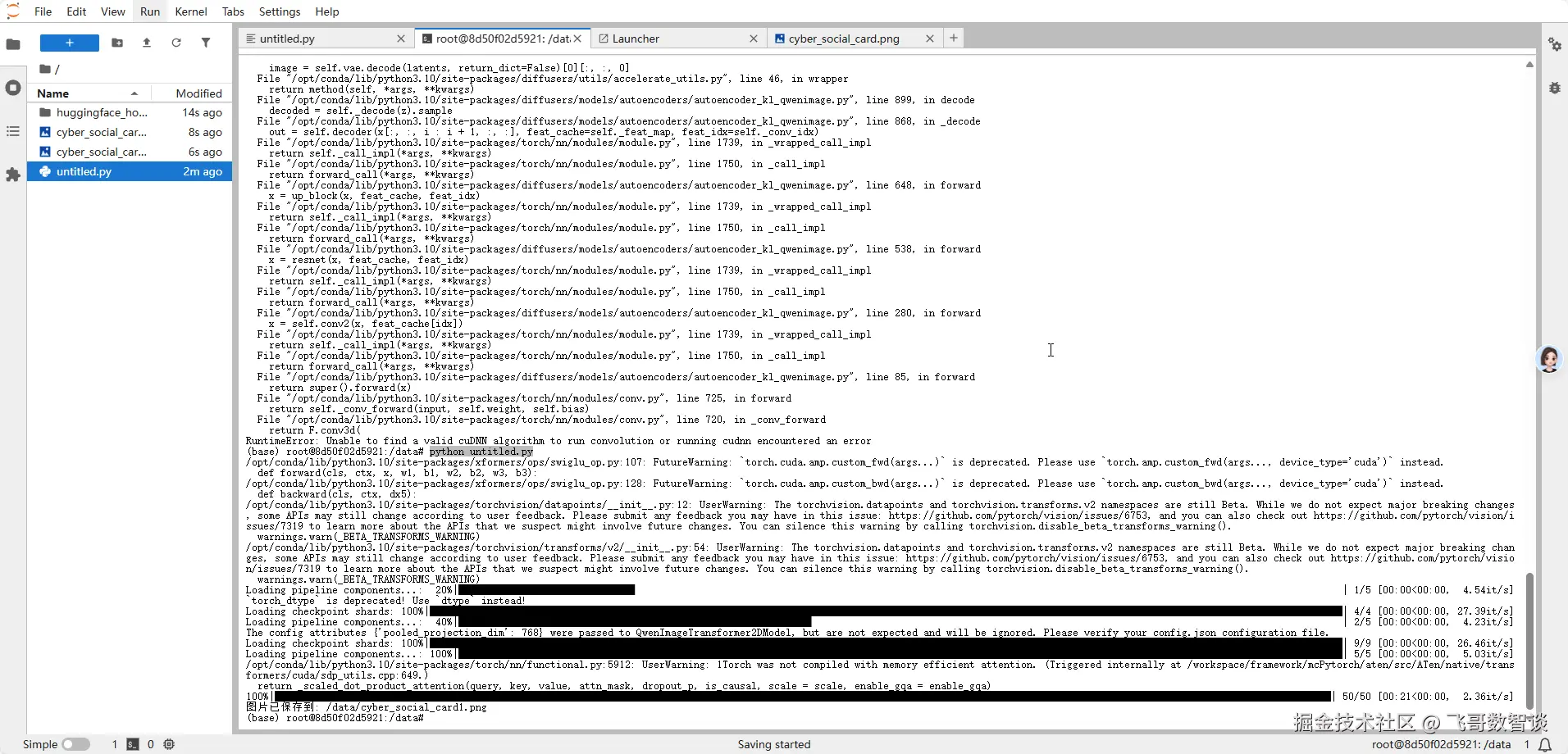

3、然后回到 Terminal 标签中运行 Python 脚本。

python untitled.py可以看到最后日志显示图片已经生成并保存了。

最终效果

给大家看下我修仙风的算力体验官名片。

辅助命令

英伟达显卡可以通过 nvidia-smi 查看显卡状态。

国产芯片也都有类似的命令,比如"沐曦"相关命令如下:

- 查询 GPU 和 VPU 利用率:mx-smi --show-usage

- 查询显存使用情况:mx-smi --show-memory

- 查询温度:mx-smi --show-temperature

- 查看当前运行的进程:mx-smi --show-process

结语

尽管国产 GPU 在峰值性能或生态工具链上与 NVIDIA 仍有差距,但在基础训练/推理任务中已具备可用性。更重要的是,有模力方舟、Qwen等友商的支持,我相信国产算力未来可期。

也欢迎大家抓紧去白嫖哈~