Libevent 的核心使命:跨平台与统一

它的首要目标是解决一个现实问题:不同操作系统有不同的高性能I/O机制。

-

Linux:

epoll -

macOS/FreeBSD:

kqueue -

Windows:

IOCP -

还有通用的

select/poll

Libevent 在底层为这些不同的I/O复用机制(它称之为 "后端" 或 "多路复用器")提供了一套统一的抽象接口。在编译或运行时,它会自动检测并选择当前系统上可用的、性能最高的后端。

1. struct event (事件对象)

这是Libevent工作的基本单位。它代表一个你感兴趣的事情 ,以及当这个事情发生时需要执行的函数 。

一个 event 主要包含:

-

ev_fd: 与此事件关联的文件描述符(如果是I/O事件)。 -

ev_events: 你关心的事件类型(如EV_READ,EV_WRITE)。 -

ev_callback: 回调函数指针------这是事件驱动编程的灵魂。当事件发生时,这个函数会被调用。 -

ev_flags: 事件的内部状态标志(如正在激活、已持久化等)。

创建事件 :你告诉Libevent:"嗨,帮我监视这个socket(ev_fd)的读事件(ev_events),一旦它可读了,就调用我这个函数(ev_callback)。"

2. event_base (事件反应堆)

这是Libevent的心脏和大脑 。每个 event_base 都拥有一个独立的事件循环。它的核心职责是:

-

汇集所有事件 :管理所有通过

event_add()注册进来的event对象。 -

对接系统后端 :内部封装了所选的后端(如

epoll),并调用后端的等待函数(如epoll_wait)。 -

调度与分发 :当有事件就绪时,它负责找到对应的

event对象,并执行其回调函数。

你可以有多个 event_base,每个都在自己的线程中运行,但通常一个线程一个 event_base 就够了。

3. Event Backend (多路复用器后端)

这是Libevent的引擎 ,是真正与操作系统打交道的地方。event_base 依赖于它来检测事件。

-

epoll.c: 封装Linux的epoll系统调用。 -

kqueue.c: 封装BSD的kqueue系统调用。 -

select.c: 封装select系统调用。 -

poll.c: 封装poll系统调用。 -

win32select.c: 封装Windows的IOCP等。

这些后端都实现了一套相同的接口(如 add, del, dispatch),供 event_base 调用。这种设计模式叫 "策略模式"。

Libevent 的工作流程(底层循环)

让我们跟踪一次 event_base_dispatch() 的完整调用链:

-

初始化

-

应用程序创建

event_base。 -

Libevent检测并初始化最合适的后端(例如,在Linux上就是

epoll)。

-

-

注册事件

-

应用程序创建

event对象并调用event_add()。 -

底层 :

event_add()最终会调用后端(如epoll)的add()方法。对于epoll后端,这其实就是执行epoll_ctl(EPOLL_CTL_ADD, ...),将fd和事件添加到内核的epoll实例中。

-

-

事件循环 (

event_base_dispatch/event_base_loop)-

步骤一:计算超时。计算下一次定时器事件的时间,作为I/O多路复用系统调用的超时参数。

-

步骤二:阻塞等待 。调用后端的

dispatch()方法。对于epoll后端,这就是调用epoll_wait()。进程在此处阻塞,直到有I/O事件发生或定时器超时。 -

步骤三:将就绪事件放入激活队列 。当

epoll_wait()返回后,Libevent 收到一组就绪的fd。它并不是立即执行回调,而是将这些对应的事件对象放入一个 "激活队列" 中。 -

步骤四:执行回调 。Libevent 从激活队列中取出事件,逐个执行 每个事件的回调函数 (

ev_callback)。

-

-

循环往复

清空激活队列后,循环回到步骤一 ,再次调用

epoll_wait(),开始新一轮的等待和处理。

关键特性与底层实现

-

缓冲区事件 (

bufferevent) :这是Libevent的一个高级抽象,非常实用。它在普通事件之上,自动管理了读/写缓冲区。你不再需要自己调用read()/write(),当有数据可读时,它的回调被触发,数据已经在它的输入缓冲区里了;你想发送数据,只需写入它的输出缓冲区,Libevent会在可写时自动帮你发送。这大大简化了网络编程。 -

线程安全 :默认情况下,

event_base不是线程安全的。如果你需要在另一个线程中通知事件循环,可以使用event_base_loopbreak()或 "线程通知" 机制。Libevent内部通过一个管道(或eventfd)创建一个内部事件,当其他线程通知时,向这个管道写数据,从而唤醒阻塞在epoll_wait上的主线程。

总结

Libevent 的本质是一个精巧的封装器和调度器。

-

底层 :它通过多路复用器后端 与操作系统高效交互,使用

epoll等机制监听fd。 -

核心 :

event_base作为中央调度器,管理着所有注册的事件,并运行着等待->激活->回调的核心循环。 -

上层 :它向应用程序提供统一的

event接口和方便的bufferevent抽象,让开发者只需关注业务逻辑的回调函数。

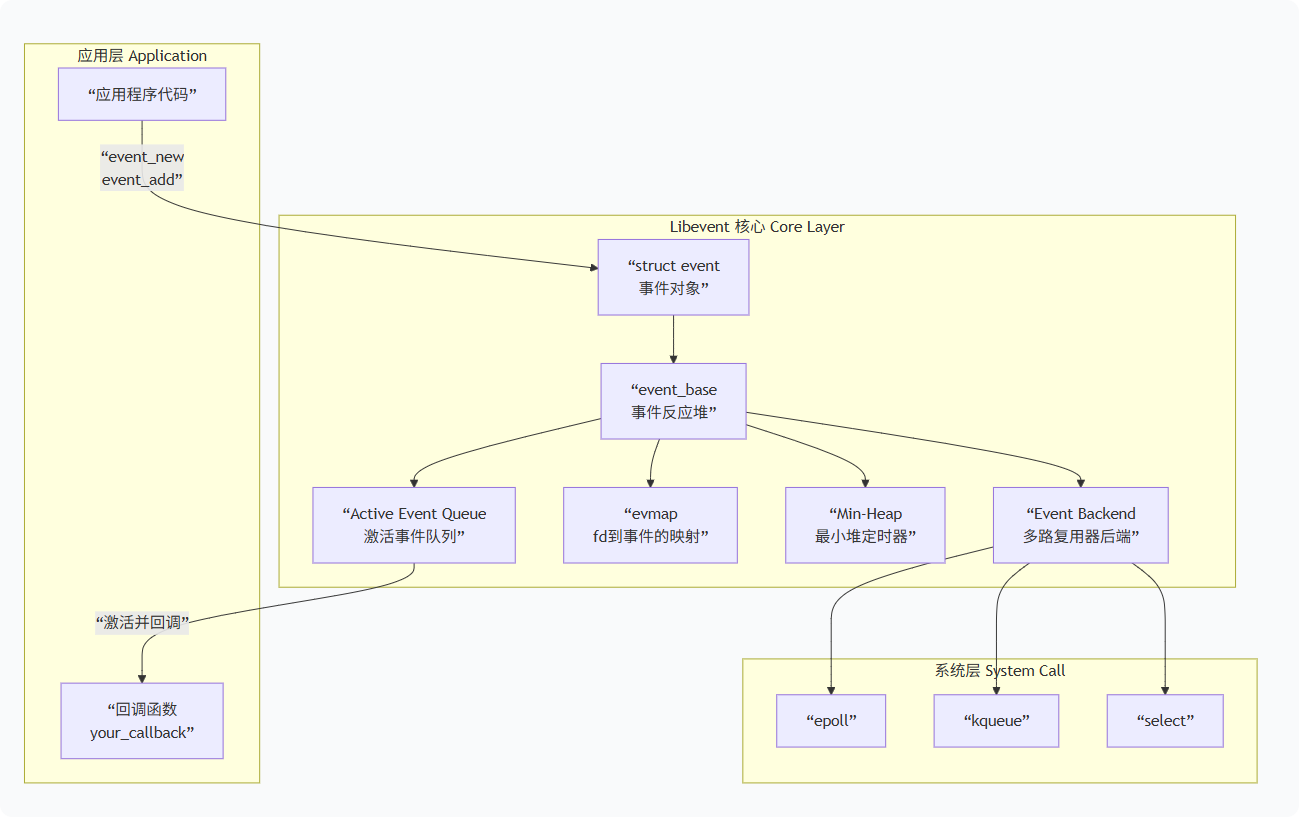

Libevent 底层架构:三层设计

Libevent 的架构可以清晰地划分为三层,下图展示了数据在这些层级间的流动过程与核心组件的交互:

我们来逐层拆解,特别是底层的数据流。

第一层:应用接口层 (API Layer)

这一层是你直接打交道的。

核心对象:struct event

它不仅仅是一个fd,而是一个事件的抽象。它可以代表:

-

I/O事件:文件描述符可读或可写。

-

信号事件 :如

SIGINT。 -

定时器事件:在指定时间后触发。

-

持久事件:触发后不被删除,等待下次触发。

关键数据结构:

c

struct event {

// 链接到不同队列的节点 (激活队列、已注册队列等)

TAILQ_ENTRY(event) ev_active_next;

TAILQ_ENTRY(event) ev_next;

// 核心信息

struct event_base *ev_base; // 属于哪个event_base

evutil_socket_t ev_fd; // 关联的文件描述符

short ev_events; // 关注的事件类型 (EV_READ|EV_WRITE|EV_PERSIST)

// 灵魂所在:回调函数

void (*ev_callback)(evutil_socket_t, short, void *);

void *ev_arg; // 回调函数的参数

// 内部状态标志

short ev_flags;

// 其他字段...

};第二层:核心引擎层 (Core Engine Layer)

这是Libevent真正的大脑 ,以 event_base 为中心。

1. struct event_base - 心脏

它管理着整个事件循环的生命周期。其内部包含几个至关重要的成员:

2. evmap - I/O事件注册表

这是最关键的数据结构之一,面试常被忽略。

-

是什么 :一个哈希表(或双链表数组),key是文件描述符(fd) ,value是一个链表,链接着所有注册在这个fd上的event结构。

-

为什么需要 :因为一个fd上可能同时注册了读事件和写事件,甚至多个不同用途的读事件。当

epoll_wait返回说fd可读时,Libevent需要通过evmap找到所有注册在这个fd上的、关心读事件的event对象,然后把它们全部加入激活队列。 -

工作流程 :

event_add()->evmap_io_add()-> 将(fd, event)对加入到evmap中。

3. 定时器管理 - 最小堆

-

数据结构 :一个最小堆。

-

为什么 :堆能保证堆顶的元素总是最先超时的。这样,在计算

epoll_wait的超时时间时,直接取堆顶元素的时间与当前时间的差值即可。效率是O(1)获取,O(logN)插入/删除。

4. 激活事件队列 - Active Event Queue

-

是什么:一个存放就绪事件的队列。

-

工作流程 :当后端

epoll_wait返回后,Libevent遍历就绪的fd,通过evmap找到所有对应的event,并按优先级插入到激活队列。事件循环再从队列中依次取出执行回调。

第三层:系统后端层 (Backend Layer)

这一层是Libevent跨平台和高效的根源。

1. 后端抽象接口

每个后端都必须实现一套统一的接口:

c

const struct eventop {

const char *name;

void *(*init)(struct event_base *); // 初始化, 如创建epfd

int (*add)(struct event_base *, evutil_socket_t fd, short old, short events, void *fdinfo); // 如epoll_ctl ADD

int (*del)(struct event_base *, evutil_socket_t fd, short old, short events, void *fdinfo); // 如epoll_ctl DEL

int (*dispatch)(struct event_base *, struct timeval *); // 如epoll_wait

// ...

};2. 后端选择策略

在 event_base_new() 时,Libevent会遍历一个全局的 eventops 数组(里面是 epollops, kqueueops, selectops 等),通过调用它们的 init 方法,选择第一个成功初始化的、可用的后端。数组顺序是按性能降序 排列的,所以会优先选择 epoll。

3. 后端与引擎的协作(以epoll为例)

这是最核心的数据流,结合上面的架构图看:

-

注册 :

event_add()最终调用epollops.add(),也就是epoll_ctl(epfd, EPOLL_CTL_ADD, fd, &ev)。注意,这里ev.data.ptr指向的是一个内部结构,而不是直接的event。这是因为一个fd可能对应多个event。 -

等待 :

event_base_loop()调用epollops.dispatch(),也就是epoll_wait(epfd, events, maxevents, timeout)。 -

翻译 :当

epoll_wait返回后,对于每一个就绪的epoll_event,Libevent通过ev.data.ptr找到内部结构,再通过evmap找到所有关联的event对象。 -

激活 :将这些

event对象插入到Active Event Queue。 -

回调 :事件循环从队列中取出

event,执行ev_callback。

深入evmap 与 多事件处理

"如果一个Socket上同时注册了读和写事件,Libevent如何管理?"

回答:

"通过 evmap 这个核心数据结构。它维护了从fd到event列表的映射。当这个socket同时可读可写时,epoll_wait 会返回 EPOLLIN | EPOLLOUT。Libevent收到后:

-

根据fd从

evmap中取出这个socket上注册的所有event的列表。 -

遍历这个列表,找出所有关注读事件

EV_READ的event,将它们加入激活队列。 -

再找出所有关注写事件

EV_WRITE的event,加入激活队列。 -

最后,事件循环会先后触发这两个event的回调函数。

所以,Libevent完美支持在同一个fd上注册和管理多个不同类型的事件。"

总结:如何回答"Libevent底层原理?"

-

一句话概括 :"Libevent是一个跨平台的事件驱动网络库,它通过封装各系统的I/O复用器,提供统一接口,其核心是围绕

event_base的事件循环。" -

核心三组件:

-

event: 事件抽象,包含fd、事件类型和回调函数。 -

event_base: 心脏,驱动循环,管理定时器、激活队列。 -

Backend: 引擎,如epoll/kqueue,负责与OS交互。

-

-

关键数据结构:

-

evmap: 实现fd到多个event的映射,是处理多事件的核心。 -

最小堆: 管理定时器,高效计算超时。

-

激活队列: 存放就绪事件,实现回调调度。

-

-

工作流程 :"注册 -> 等待 -> 翻译 -> 激活 -> 回调 "。重点是

evmap在"翻译"阶段的作用。 -

亮点 :主动提及

evmap和 "同一fd多事件处理" 的细节,这能立刻展现出你的深度。