⭐ 深度学习入门体系(第 1 篇):什么是神经网络?------从生活到公式,一次讲清!

如果你刚开始学深度学习,可能会被"神经元、权重、激活函数、损失函数、反向传播"等名词弄得头晕。

别急,这篇文章会用生活化的方式,一次性把"神经网络到底是什么"讲清楚,让你真正理解它的底层逻辑。

文章目录

- [⭐ 深度学习入门体系(第 1 篇):什么是神经网络?------从生活到公式,一次讲清!](#⭐ 深度学习入门体系(第 1 篇):什么是神经网络?——从生活到公式,一次讲清!)

- [🧠 一、神经网络到底是什么?(一句人话)](#🧠 一、神经网络到底是什么?(一句人话))

- [🧱 二、神经元是如何工作的?(最贴近生活的类比)](#🧱 二、神经元是如何工作的?(最贴近生活的类比))

-

- [🍜 类比:神经元就是"给一道菜打分的美食评论家"](#🍜 类比:神经元就是“给一道菜打分的美食评论家”)

- [🧩 三、什么是神经网络中的"权重"?(关注度的数学版本)](#🧩 三、什么是神经网络中的“权重”?(关注度的数学版本))

- [🎚 四、偏置有什么用?(网络的"默认倾向")](#🎚 四、偏置有什么用?(网络的“默认倾向”))

- [⚡ 五、激活函数:神经网络的大脑"决策开关"](#⚡ 五、激活函数:神经网络的大脑“决策开关”)

-

- [🔌 类比:激活函数就像电灯开关](#🔌 类比:激活函数就像电灯开关)

- [🧱 六、层(Layer):神经元组成「小队」](#🧱 六、层(Layer):神经元组成「小队」)

- [🧠 七、神经网络如何学习?(最通俗的解释)](#🧠 七、神经网络如何学习?(最通俗的解释))

-

-

- [1. 前向传播(Forward)](#1. 前向传播(Forward))

- [2. 计算损失(Loss)](#2. 计算损失(Loss))

- [3. 反向传播(Backward)](#3. 反向传播(Backward))

- [4. 更新参数(Optimizer)](#4. 更新参数(Optimizer))

-

- [🎓 八、一个简单例子:让神经网络认识猫](#🎓 八、一个简单例子:让神经网络认识猫)

- [🏁 九、小结:你现在可以真正回答"神经网络是什么了"](#🏁 九、小结:你现在可以真正回答“神经网络是什么了”)

-

-

- [✔ 它是一个由很多"打分器(神经元)"组成的数学模型](#✔ 它是一个由很多“打分器(神经元)”组成的数学模型)

- [✔ 每个神经元根据输入进行加权求和,决定是否输出](#✔ 每个神经元根据输入进行加权求和,决定是否输出)

- [✔ 通过激活函数增加复杂决策能力](#✔ 通过激活函数增加复杂决策能力)

- [✔ 网络通过"错误反向传播"不断调整权重](#✔ 网络通过“错误反向传播”不断调整权重)

- [✔ 最终变成一个有经验的分类器/识别器](#✔ 最终变成一个有经验的分类器/识别器)

-

- [🔜 下一篇:](#🔜 下一篇:)

🧠 一、神经网络到底是什么?(一句人话)

如果有人问你:

"神经网络是什么?"

你可以用一句最简单的话回答:

神经网络就是一个"根据经验更新自己的数学系统"。

就像一个小孩学认猫:

- 看到一张图片(输入)

- 说:这是猫!(预测)

- 大人说:错了,这是狗(误差 / 损失)

- 小孩根据被批评的程度,下次改口(更新参数)

神经网络做的事情和小孩几乎一模一样。

🧱 二、神经元是如何工作的?(最贴近生活的类比)

一个神经元(Neuron)其实非常简单,就是这个公式:

输出 = 激活函数( Σ(输入 × 权重) + 偏置 )别慌,我们用生活中的例子解释:

🍜 类比:神经元就是"给一道菜打分的美食评论家"

比如你给一碗面打分,会考虑:

- 面条口感(输入1)

- 汤底味道(输入2)

- 配料丰富度(输入3)

但你不会把它们都当成一样重要,对吧?

比如你觉得汤底最关键,那么你的"汤底权重"就更大。

于是你的打分方式是:

得分 =(口感 × 0.3) + (汤底 × 0.5) +(配料 × 0.2) + 偏置神经元做的就是一样的事:

- 输入 = 特征

- 权重 = 每个特征的重要程度

- 偏置 = 主观偏好

- 激活函数 = 最终把分数转成"要不要输出"

这是不是一下就清晰了?

🧩 三、什么是神经网络中的"权重"?(关注度的数学版本)

你可以把权重理解为:

模型对某个特征的重要程度。

就像你评价一碗面:

- 如果你特别在乎汤底 → 权重大

- 如果你不太关心配料 → 权重小

训练神经网络,就是不断"调整权重"。

🎚 四、偏置有什么用?(网络的"默认倾向")

偏置(bias)可以理解成:

模型在没有输入特征的时候的默认判断。

生活化比喻:

- 你本来就喜欢吃辣,所以对所有食物都会"自动加一点评价"。

这就是偏置的作用。

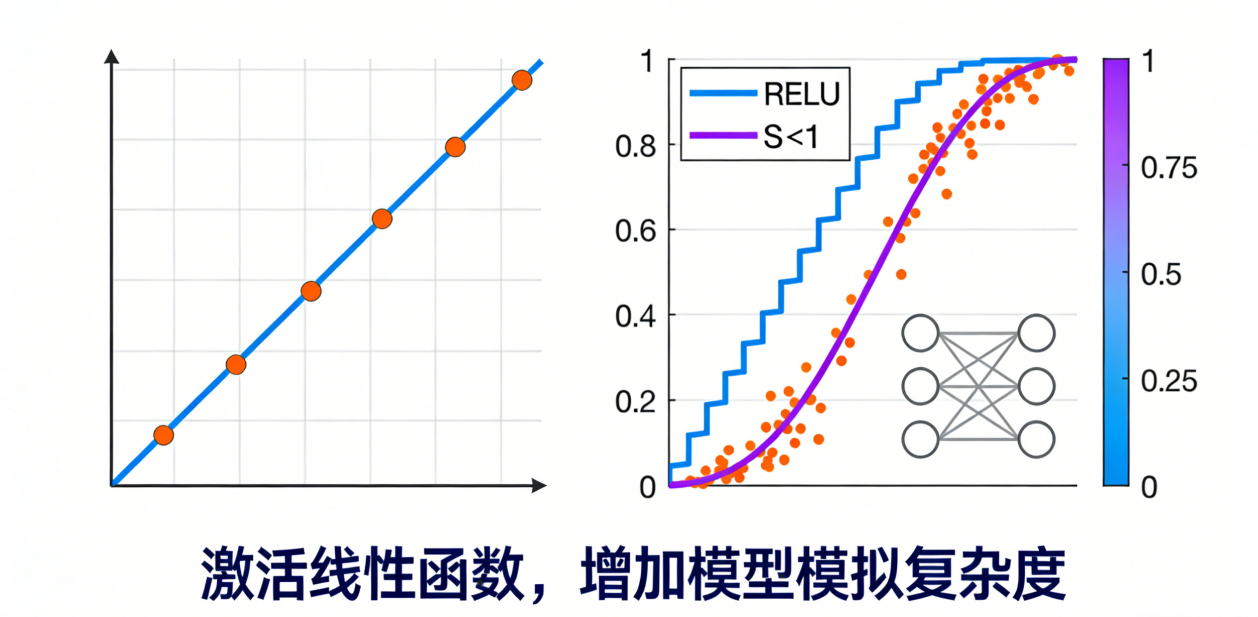

⚡ 五、激活函数:神经网络的大脑"决策开关"

激活函数(activation function)是神经网络的灵魂。

为什么?

因为如果没有激活函数,神经网络只能学线性的东西,什么图像识别、语音识别都做不了。

你可以把激活函数想象成:

"根据综合得分决定是否要启动下一层神经元的按钮。"

🔌 类比:激活函数就像电灯开关

- Σ(输入 × 权重) + 偏置 = 电压

- 激活函数 = 开关

- 输出 = 灯亮不亮

ReLU 就像:

电压 > 0:亮

电压 ≤ 0:不亮

非常简单,但非常强大。

🧱 六、层(Layer):神经元组成「小队」

单个神经元能力有限,那多来几个不就变强了吗?

于是有了:

- 输入层

- 隐藏层(多个)

- 输出层

每一层里面包含很多"打分的美食评论家(神经元)"。

共同对输入数据进行分析。

🧠 七、神经网络如何学习?(最通俗的解释)

神经网络的学习流程,其实特别像:

学生做题 → 老师批改 → 下次继续做 → 再被批改 → 不断进步

专业一点说:

1. 前向传播(Forward)

网络根据输入做一次预测。

就像学生做题。

2. 计算损失(Loss)

预测错多少?

就像老师给作业打分。

3. 反向传播(Backward)

根据错误程度调整权重。

就像学生根据老师的批评修改做题方式。

4. 更新参数(Optimizer)

让模型慢慢变得更聪明。

就像学生不断提高成绩。

这个循环就是学习。

🎓 八、一个简单例子:让神经网络认识猫

你给模型看一些图片:

这是猫

这是猫

这不是猫

这是猫模型开始时乱猜:

看见猫 → 说是狗

看见狗 → 说是猫它会疯狂被"老师(损失函数)"批评。

于是它调整:

- 毛色特征的权重

- 耳朵形状的权重

- 身体轮廓的权重

慢慢以后,它能做到:

看见猫 90% 准确率

看见狗 95% 准确率 这就是学习的本质。

🏁 九、小结:你现在可以真正回答"神经网络是什么了"

如果别人再问你:

"神经网络到底是什么?它是怎么学习的?"

你现在可以这样回答:

✔ 它是一个由很多"打分器(神经元)"组成的数学模型

✔ 每个神经元根据输入进行加权求和,决定是否输出

✔ 通过激活函数增加复杂决策能力

✔ 网络通过"错误反向传播"不断调整权重

✔ 最终变成一个有经验的分类器/识别器

🔜 下一篇:

《深度学习入门体系(第 2 篇):为什么神经网络一定需要激活函数?------用生活例子讲清非线性》