无人机应用的普及给社会带来便利的同时,也带来了新的安全隐患。未经许可的无人机入侵机场、军事区等敏感区域,已成为不容忽视的安全威胁。如何在复杂环境中,尤其是在夜间或远距离条件下,准确识别无人机,一直是技术上的难题。YOLOv9-CAG算法,通过融合可见光、红外与音频多源数据,显著提升了无人机识别的准确率与鲁棒性。

识别挑战

现有的无人机识别研究多依赖于单一类型的数据,如光学图像、红外图像或雷达信号。这些方法虽然在特定条件下有效,但在复杂环境、小目标、低可见度场景中表现往往大打折扣。

例如,在夜晚或雾霾天气,可见光摄像头几乎失效;而在远距离条件下,无人机在图像中可能仅占几十个像素,特征极其微弱,极易被背景噪声淹没。

此外,鸟类与无人机在形态和运动模式上具有一定相似性,进一步增加了误识别的风险。

YOLOv9-CAG的三大创新

为了克服上述挑战,研究团队在经典的YOLOv9目标检测框架基础上,引入了三个关键改进模块,构建了YOLOv9-CAG模型。

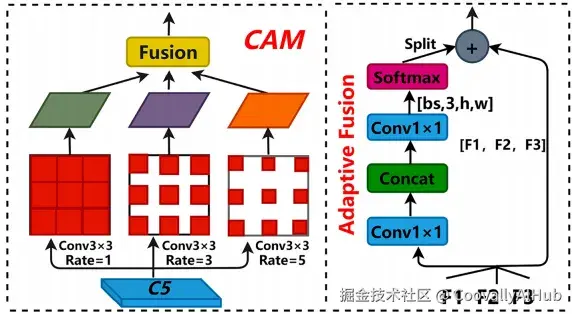

首先,在主干网络末端,用 CAM上下文特征增强模块替换了原有结构。该模块能更好地建模全局上下文信息,尤其有利于在复杂背景中提取小目标的细微特征,提升模型对无人机关键部位的关注度。

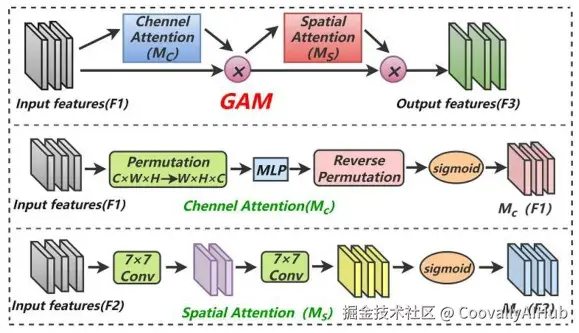

其次,在头部网络的中间部分,集成 GAM全局注意力机制。该机制能自适应地对特征图进行通道和空间上的加权,让模型聚焦于图像中的关键区域,同时抑制无关背景干扰,从而提升对远距离、小尺寸无人机的识别精度。

最后,在头部网络的末端,采用 AKConv动态卷积替代标准卷积。传统卷积核是固定形状的,而AKConv能根据输入特征动态调整卷积核的采样点位置与形状,从而更灵活地适应不同尺度、不同形态的无人机目标,更好地捕捉其轮廓细节。

构建全方位感知数据集

模型的训练与验证离不开高质量的数据。研究团队构建了四个大规模、多模态的数据集,涵盖可见光、红外和音频频谱,以满足不同场景下的评估需求。

- 可见光数据集: 包含8978张图像,涵盖静态鸟、飞鸟、旋翼无人机、固定翼无人机四类。

- 红外数据集: 包含10,614张图像,同样包含鸟类与多种无人机类别,重点解决夜间和低能见度下的识别问题。

- 可见光与红外混合数据集: 包含19,592张图像,用于测试模型在多模态信息融合下的性能。

- 音频频谱数据集: 包含1088张频谱图,由鸟类和无人机的声音信号转化而来,为识别提供额外的声学维度特征。

实验结果

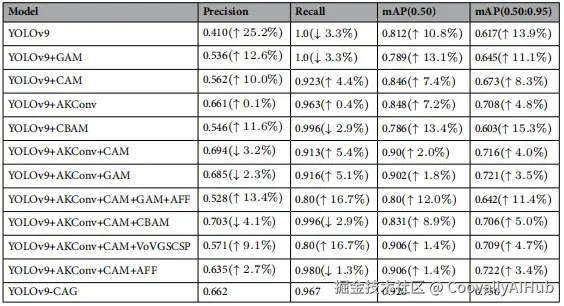

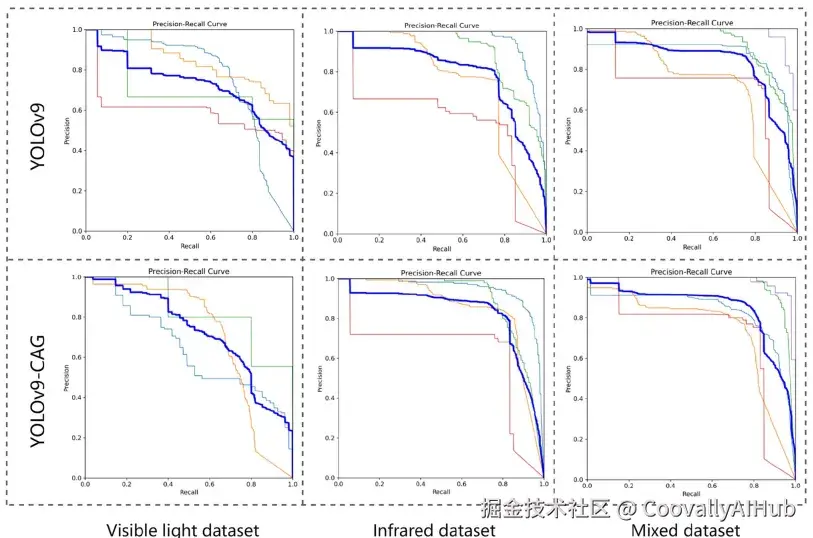

通过在多个数据集上进行消融实验和对比实验,YOLOv9-CAG模型展现了全面而显著的性能提升。

- 在可见光数据上,针对无人机的mAP0.50达到92.0%,比原版YOLOv9高出10.8%。

- 在红外数据上,mAP0.50和召回率分别达到86.5%和89.2%,分别提升12.4%和11.4%。

- 在音频频谱数据上,mAP0.50和召回率也分别提升了8.4%和14.3%。

除了无人机,模型对鸟类的识别能力也同步增强。在可见光和红外条件下,对鸟类的mAP0.50分别达到85%和94.8%,有效降低了无人机与鸟类之间的误判。

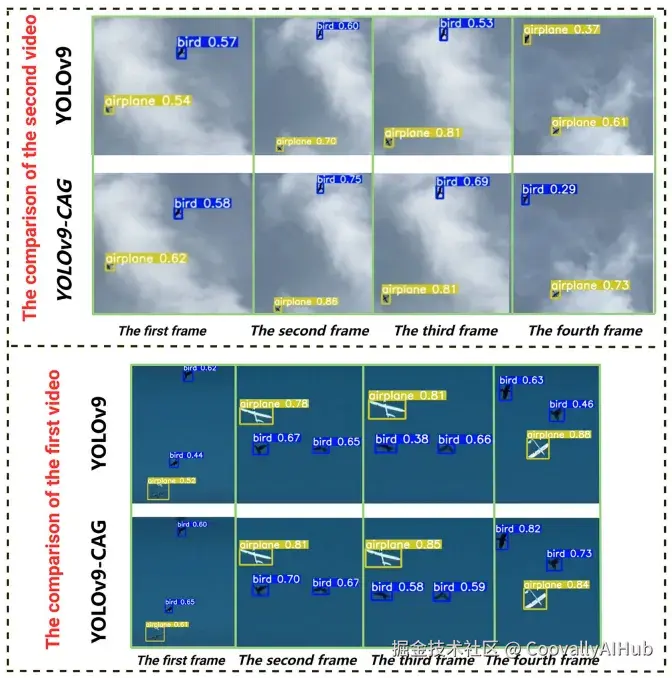

为了验证实际应用效果,研究团队在真实拍摄的可见光与红外视频上进行了测试。视频中的无人机和鸟类目标尺寸很小(40x40至80x80像素)。

结果显示,YOLOv9-CAG模型在可见光和红外场景下的整体平均精度,分别比原版模型提升了6.8%和3.8%。

与YOLO系列其他先进模型(如YOLOv10、YOLO11)在混合数据集上对比,YOLOv9-CAG在固定翼无人机和全类别的识别指标上均保持领先。

总结

该研究提出的YOLOv9-CAG算法,通过创新的模块设计与多模态数据融合,为复杂环境下的无人机精准识别提供了有效的技术方案。

它不仅有助于提升敏感空域的安全监控能力,减少非法入侵带来的风险,也能为鸟类保护和生态研究提供技术支撑,区分无人机与鸟类活动。

当然,研究也指出了未来方向:例如,进一步探索雷达、激光雷达等多模态数据的融合,以应对更极端天气;研究更先进的超分辨率和小目标检测框架,以解决极小目标特征丢失的问题;优化模型对遮挡、重叠目标的检测能力。

随着技术的不断演进,一个全天候、全天时、高精度的无人机智能感知与监管网络正逐渐成为可能,为空域安全和公共安全筑起一道坚实的技术防线。