简介

Ollama是时下最容易部署本地大模型的工具了,可以把Ollama比做成docker,用户管理容器,而它是管理大模型

下载安装

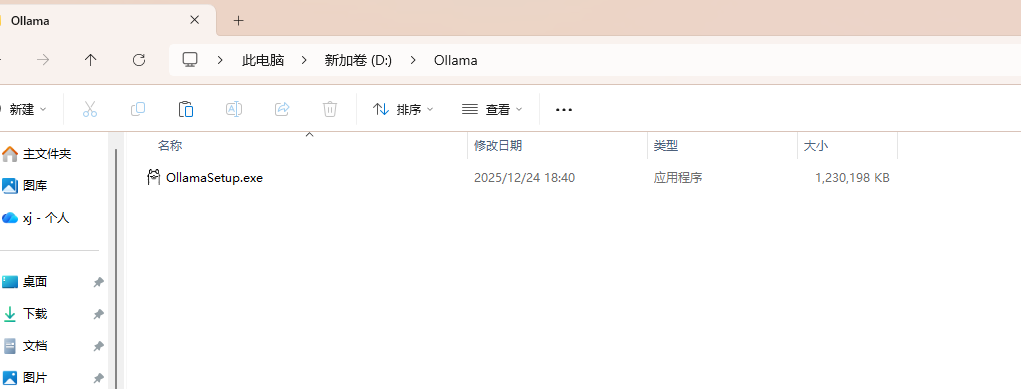

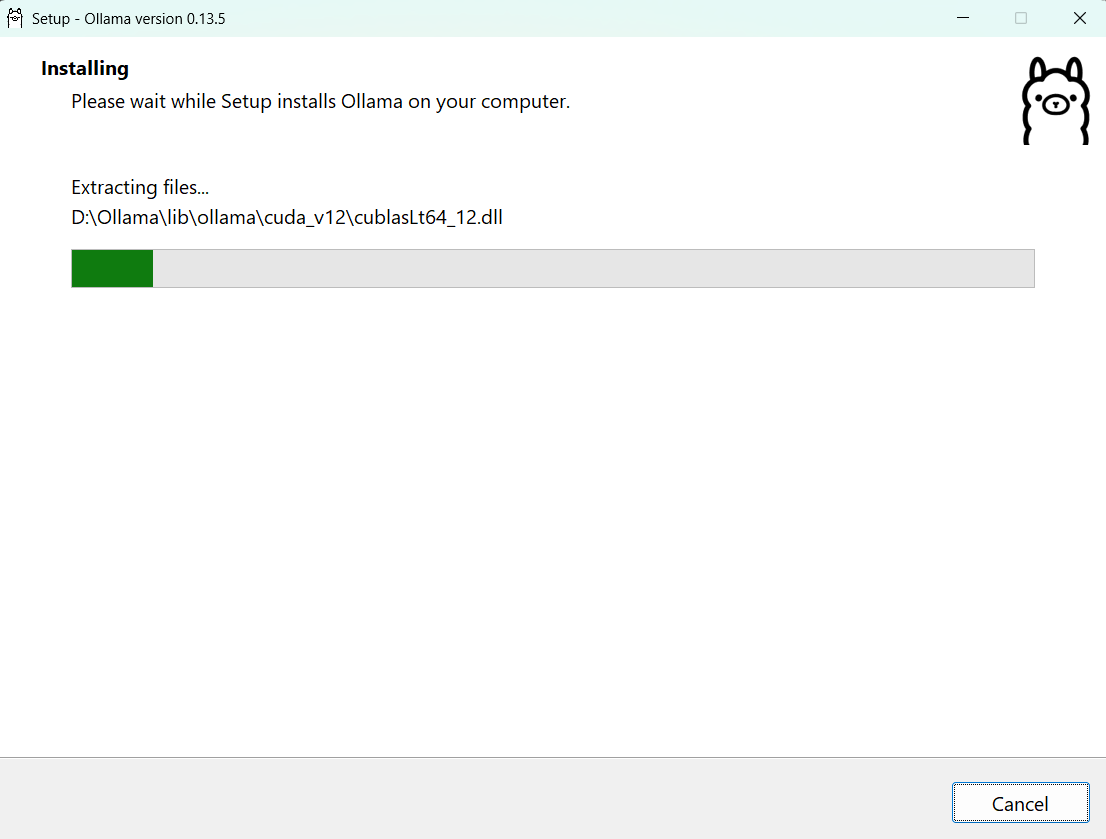

点击访问https://ollama.com/download,下载windows版本,下载好后,不要直接点击安装,默认路径是在c盘,占空间,需要自定义安装,将exe文件复制到自定义路径。

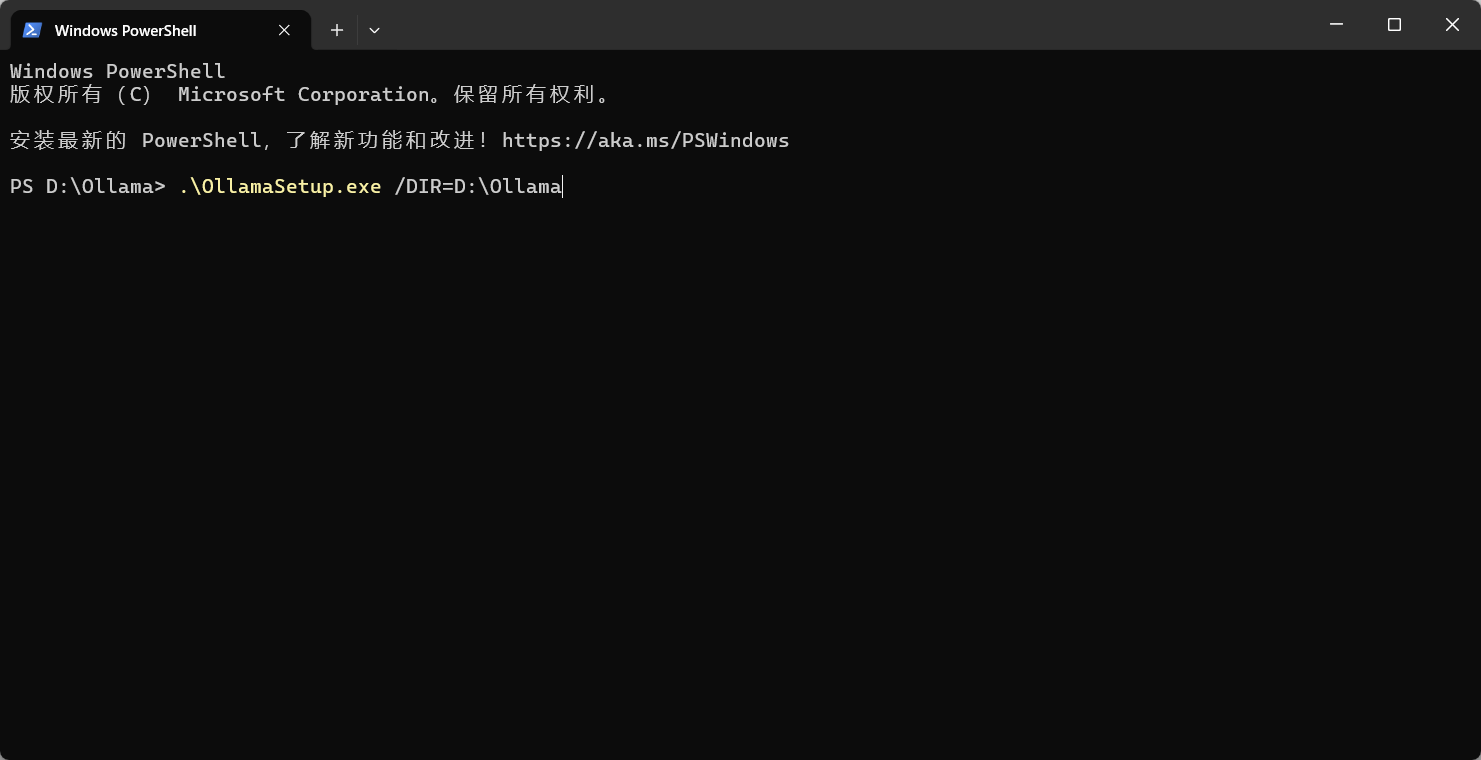

打开终端输入

.\OllamaSetup.exe /DIR=D:\Ollama

配置model环境变量

打开C:\Users\用户名.ollama目录,复制models目录到自定义安装的目录里,然后删除掉

新建环境变量OLLAMA_MODELS=D:\Ollama\models

环境变量Path里配置Ollama安装路径D:\Ollama

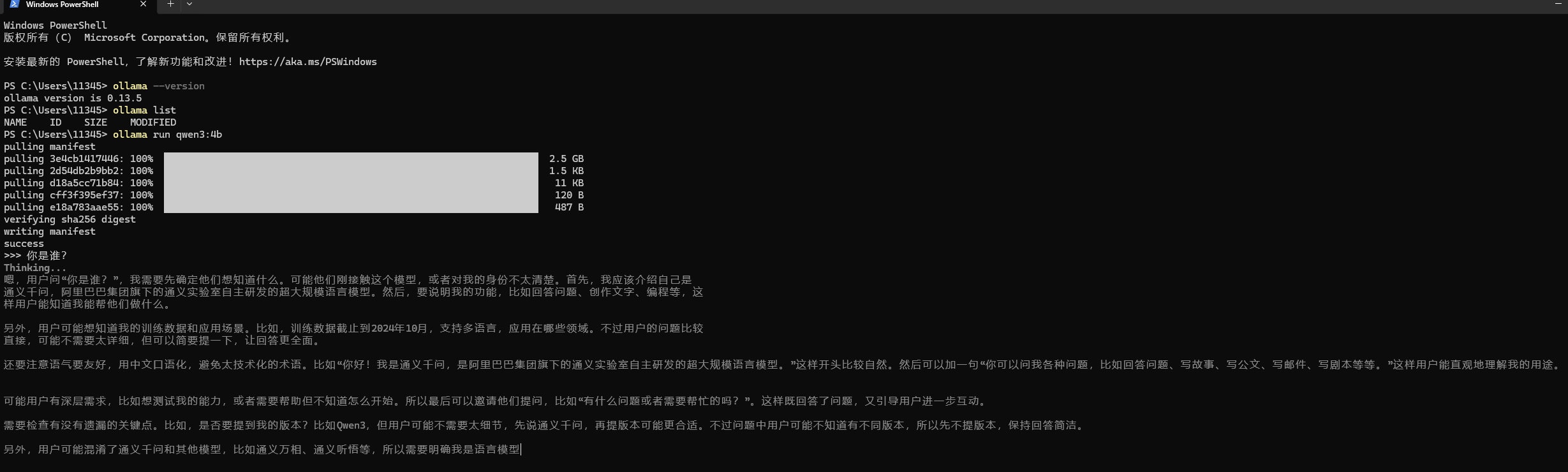

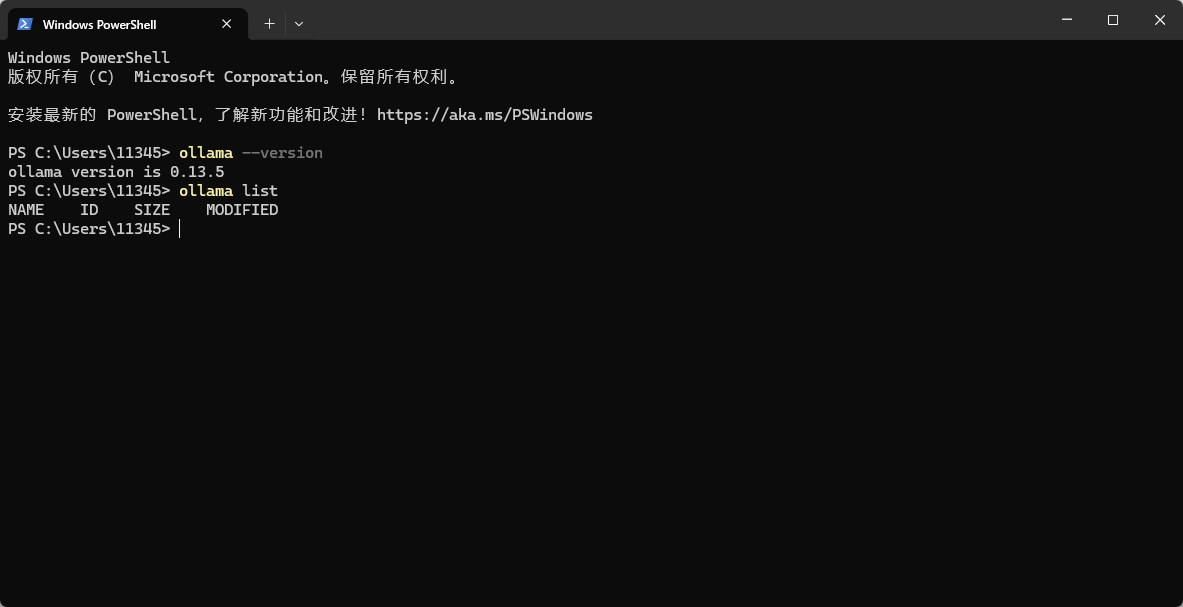

验证

重启Ollama,打开终端输入ollama list,查看大模型资源包是否正常展示。ollama默认安装端口是11434

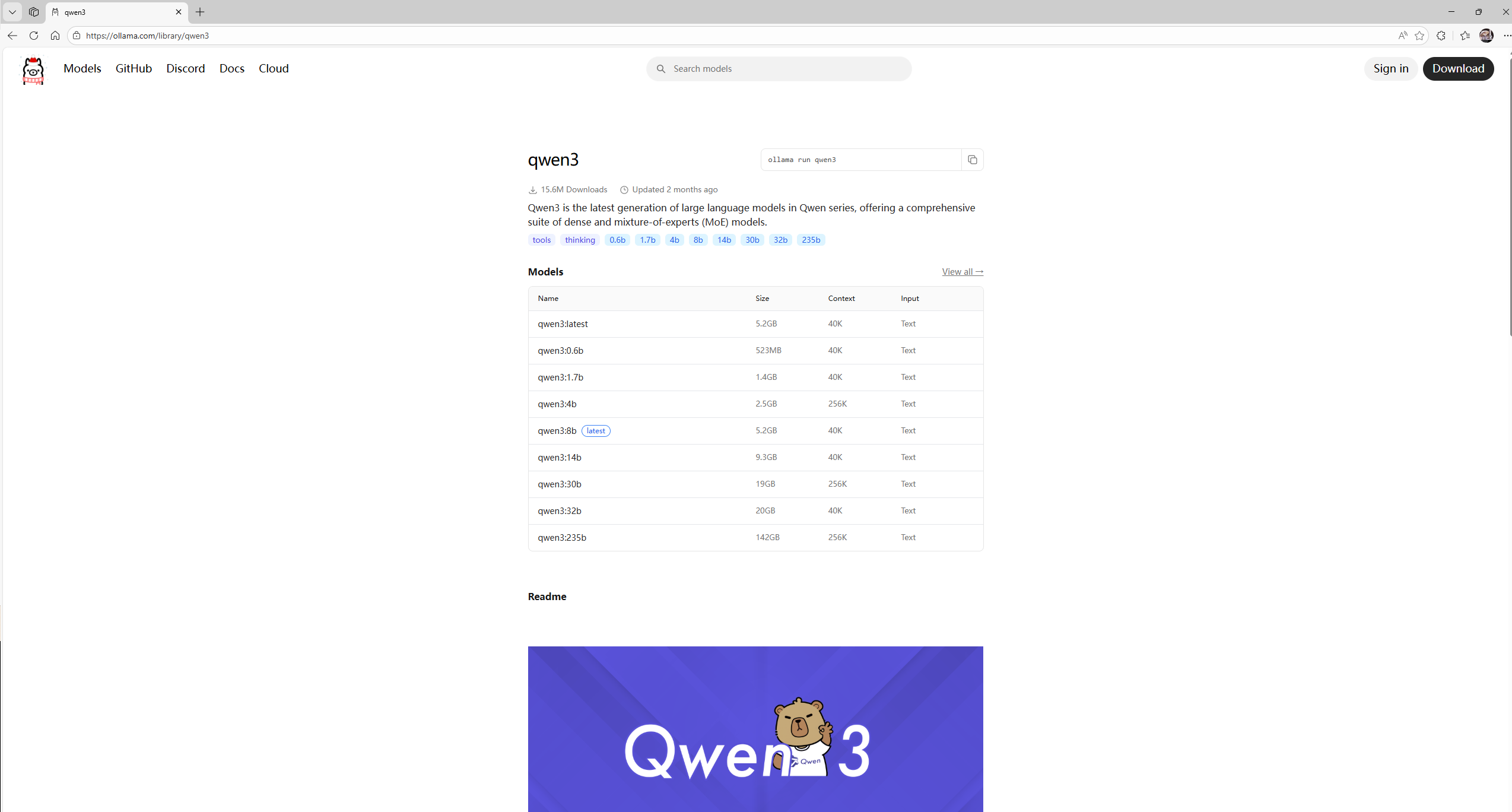

安装大模型

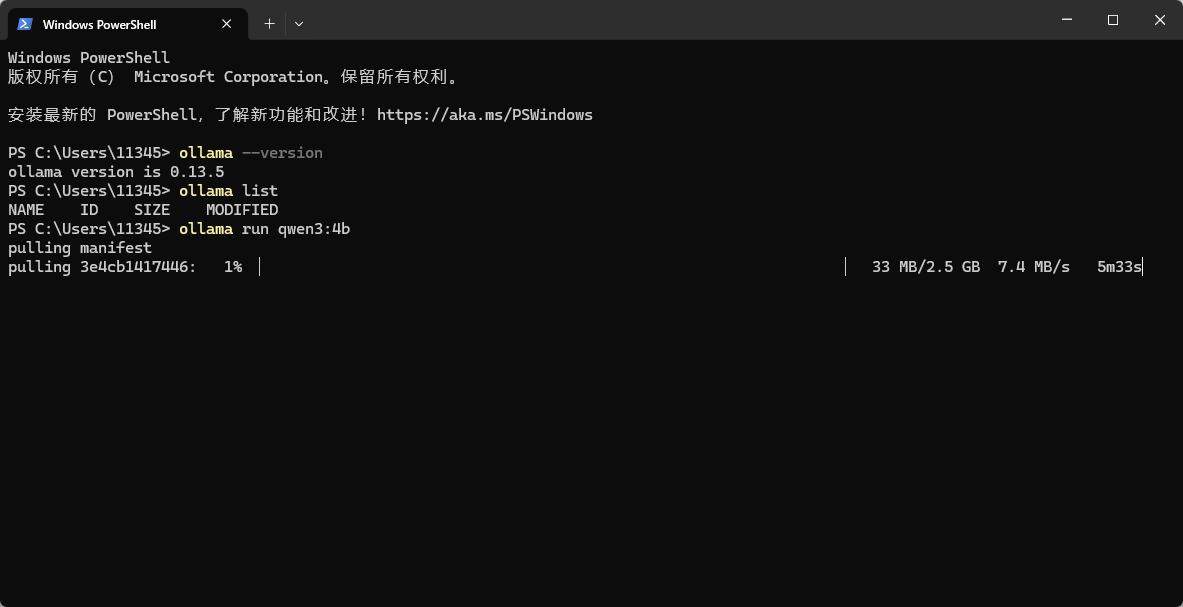

安装qwen3:4b试试水,终端里输入ollama run qwen3:4b

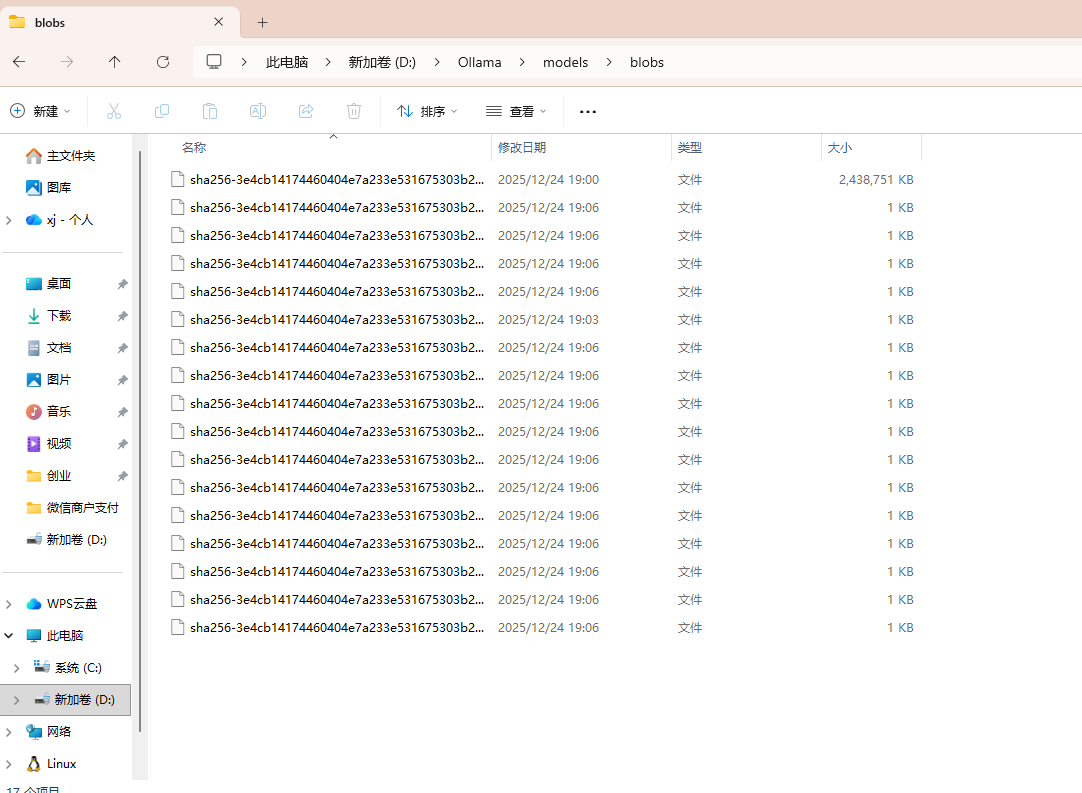

打开自定义的models文件夹里的blobs,里面就是安装下载的大模型

模型安装成功