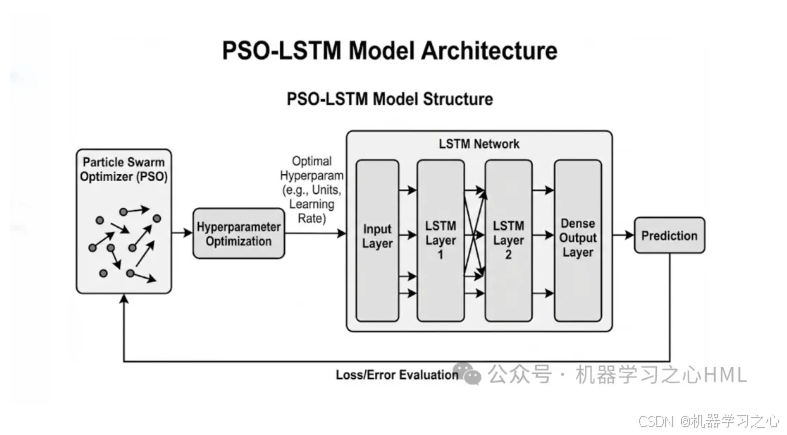

PSO-LSTM 模型是将 粒子群算法 (Particle Swarm Optimization, PSO) 与 长短期记忆网络 (Long Short-Term Memory, LSTM) 相结合的优化架构。

1. 核心组成部分

LSTM (预测器)

LSTM 是一种特殊的循环神经网络,擅长处理和预测时间序列中间隔较长的重要事件。但 LSTM 的性能高度依赖于超参数(如:隐藏层神经元数量、学习率、迭代次数、正则化系数等)。手动调优这些参数非常耗时且难以达到最优。

PSO (优化器)

PSO 是一种受鸟类觅食行为启发的进化计算技术。

- 粒子 (Particle) :每个粒子代表一组潜在的 LSTM 超参数组合(例如:

{神经元: 64, 学习率: 0.01, Batch: 32})。 - 群体 (Swarm):多个粒子在参数空间中搜索。

- 适应度函数 (Fitness Function):通常使用 LSTM 在验证集上的误差(如 RMSE 或 MAE)。误差越小,粒子的"位置"越好。

2. 模型工作流程

PSO-LSTM 的执行逻辑遵循以下四个主要阶段:

- 初始化粒子群:随机生成一群粒子,每个粒子携带一组初始的 LSTM 超参数。

- 适应度评估:

- 将每个粒子的参数代入 LSTM 模型。

- 训练模型并计算其在验证集上的损失(Loss)。这个损失值就是该粒子的"适应度"。

- 速度与位置更新:

- 个体极值 ():粒子记住自己历史上最好的位置。

- 全局极值 ():粒子群记住全队目前发现的最佳位置。

- 粒子根据这两个极值调整自己的"飞行速度"和"方向",向最优区域靠拢。

- 循环迭代:重复步骤 2 和 3,直到达到最大迭代次数或误差收敛。

- 最终预测 :使用 PSO 找到的全局最优超参数重新构建并训练 LSTM,进行最终的数据预测。

3. 为什么使用 PSO 优化 LSTM?

| 维度 | 单一 LSTM | PSO-LSTM |

|---|---|---|

| 参数确定 | 依赖经验或网格搜索,效率低 | 自动搜索,具有全局寻优能力 |

| 收敛速度 | 易陷入局部最优 | 通过群体协作,更容易跳出局部最优 |

| 模型精度 | 一般 | 通常更高,因为超参数更加匹配数据特征 |

| 计算开销 | 较低 | 较高(因为需要多次训练以评估适应度) |

4. PSO 与 贝叶斯优化 (BO) 的区别

虽然两者都用于优化,但逻辑不同:

- 贝叶斯优化:基于概率模型(高斯过程),它会"思考"后再尝试,适合评估代价极其昂贵的函数。

- PSO:基于群体智能和演化,它通过"模仿"最优者来搜索,更适合参数空间复杂、非凸的优化问题,且易于并行化。

总结:

PSO-LSTM 是解决时间序列预测(如股票、天气、工业负荷)的一把利器,它解决了"LSTM 参数怎么调"的痛点,将人工调参转变为自动化的演化搜索。