**第 29 届中国计算机系统研讨会(ChinaSys 2025)**将于 12 月 27 日- 12 月 28 日,在吉林长春举办。ChinaSys 是中国计算机系统及相关领域的学术团体,宗旨是为本领域的研究者和从业者提供资源共享、交换思想和会晤的平台,交流和探讨系统领域的最新研究成果,促进中国计算机系统行业的发展。

阿里云大数据 AI 团队将深度参与ChinaSys 2025。PAI 团队将在 ChinaSys 2025 带来演讲,与参会者分享大模型长上下文微调中的高效动态数据调度方案 Skrull。 同时将在阿里云展台为大家揭秘 Qwen3 训练端到端加速比提效 3 倍 的核心技术、分享阿里云大数据 AI 平台的最新研究成果和技术思考,更有核心研发团队面对面交流的机会!

大模型长上下文微调中的高效动态数据调度 Skrull 技术揭秘

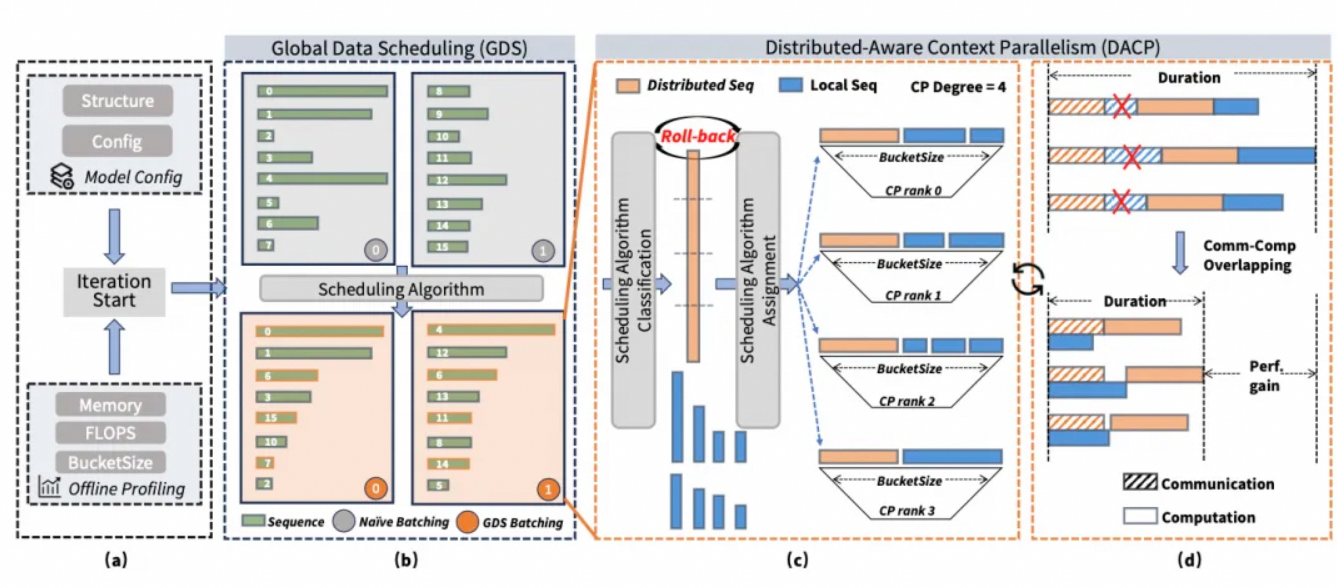

长文本处理能力是大语言模型的一项核心技能,直接影响很多下游任务的效果。目前,业界主要通过继续预训练和长上下文微调来提升模型在这方面的表现。这类训练通常使用精心构造的数据集,而数据集在序列长度上往往有着极度长尾或双峰分布的特点,对现有训练系统提出了很大挑战,系统很难在长短样本之间高效调度资源,常常导致整体训练效率低下。

PAI 团队在ICML 2025 上发表长序列训练优化 ChunkFlow工作后,再度提出高效动态数据调度方案 Skrull ,进一步从上下文并行和负载均衡的角度,优化系统训练性能。Skrull 研究成果被 NeurIPS 2025 收录 ,《Skrull: Towards Efficient Long Context Fine-tuning through Dynamic Data Scheduling》(https://arxiv.org/abs/2505.19609),同时获邀在 ChinaSys 2025 与参会者分享其技术原理。

大模型长上下文微调中的高效动态数据调度 Skrull 设计思路

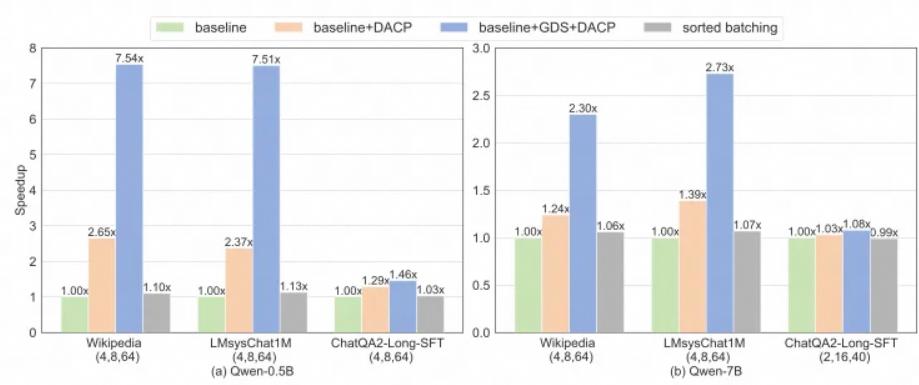

实测表明,Skrull 相比基线平均提速 3.76 倍,最高达 7.54 倍,为高效长上下文训练提供了实用的系统优化思路, 充分验证了 Skrull 在长上下文微调中的性能与价值**。**

Skrull 在不同 Qwen 模型尺寸和数据集上的系统性能收益

如需了解 Skrull 相关的的更多技术细节,欢迎您关注 ChinaSys 2025 - 产业论坛演讲,或阅读往期文章https://blog.csdn.net/weixin_48534929/article/details/156237027。

ChinaSys 现场交流

1. 阿里云展台

会议期间,阿里云大数据 AI 团队将在阿里云展台与大家共同探讨系统领域研究创新,为大家揭秘 Qwen3 训练端到端加速比提效 3 倍的核心技术,以及分享阿里云大数据 AI 平台的最新研究成果和技术思考,期待您前往交流、体验!

-

时间:12月27日-12月28日,会议期间全天

-

地点:吉林大学 前卫南区 --- 敬信报告厅

2. 产业论坛演讲

阿里云 PAI 团队受邀,将为参会者带来大模型长上下文微调中的高效动态数据调度方案 Skrull 技术分享。

-

时间:12月27日 下午 17:15

-

地点:吉林大学 前卫南区 --- 敬信报告厅