在机器人操纵与视觉 - 语言 - 动作(VLA)模型研究领域,人类凭借对历史信息的连贯理解与多步动作规划,能轻松完成复杂长时程任务(如制作披萨)。但现有技术多聚焦于短时任务,在长时程场景中面临时序上下文缺失、状态漂移、资源消耗过大等挑战。

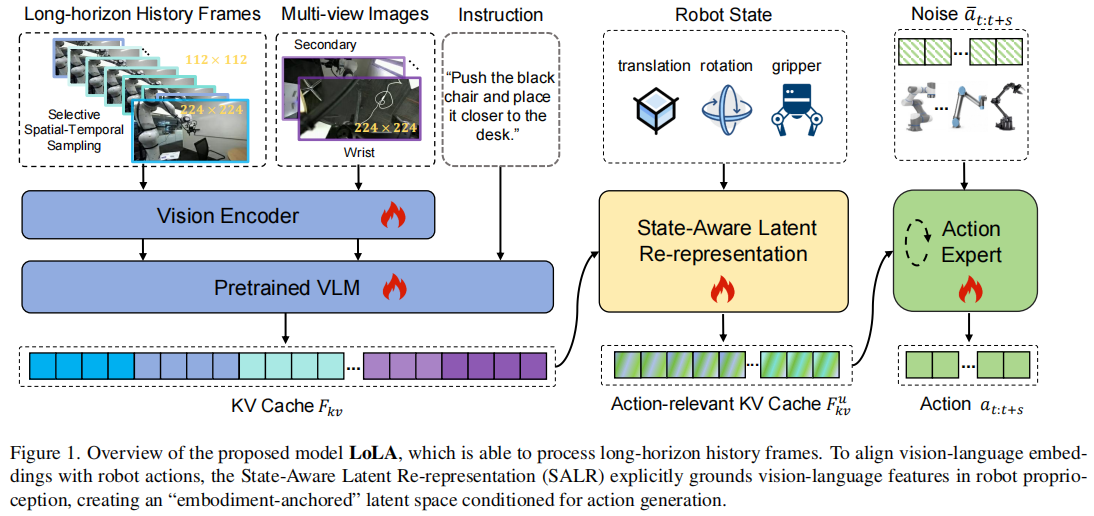

中科院、国科大与微软研究院联合团队提出的 LoLA 框架,以 "长时程潜动作学习" 为核心,通过 "多模态编码 - 状态感知融合 - 动作生成" 的三层架构,首次实现了长时程语言引导机器人操纵的高效执行,为通用机器人在真实场景的落地提供了全新解决方案。

论文题目:LoLA: Long Horizon Latent Action Learning for General Robot Manipulation

核心亮点:长时程多模态融合编码、状态感知潜表征模块、跨平台泛化能力、仿真与真实场景双重验证

问题根源:长时程机器人操纵的三大核心挑战

LoLA 的设计逻辑源于对现有 VLA 模型在长时程任务中痛点的精准洞察,三大核心挑战构成技术突破的起点:

时序上下文理解缺失

传统单帧模型忽视历史信息关联,难以追踪多步任务状态(如多次倒水),导致动作连贯性不足,易出现重复错误。

真实场景状态漂移风险

机器人与环境的长时间交互中,微小扰动(如物体被碰撞)会逐渐累积,使系统脱离训练分布,引发任务失败。

资源消耗与泛化矛盾

长时程数据的采集、标注与训练成本呈指数级增长,且模型处理长序列时计算开销巨大,同时难以泛化到不同机器人平台与任务场景。

方案设计:LoLA 的三层技术架构

针对上述挑战,LoLA 构建了 "多模态编码 - 状态感知融合 - 动作生成" 的完整技术架构,层层递进实现长时程精准操纵:

第一层:多模态编码 ------ 高效长时程上下文捕捉

为平衡长序列信息保留与计算效率,设计了双分支编码策略,兼顾当前精准感知与历史动态捕捉:

- 当前观测编码(Current Observation Encoding):处理高保真多视角图像(主视角、辅助视角、手腕视角),主视角提供全局任务场景,辅助视角解决遮挡歧义,手腕视角聚焦末端执行器与物体的精细交互,提取高分辨率空间特征,形成当前场景的静态快照。

- 历史运动编码(Historical Motion Encoding):采用时空选择性采样策略,将长时程历史帧下采样(如 224×224→112×112),在降低计算与内存负担的同时,保留物体运动轨迹、任务进度等关键时序信息,通过视觉编码器提取动态上下文特征。

- 语言指令融合:将当前观测特征、历史运动特征与语言指令嵌入拼接,形成多模态输入张量,输入预训练视觉 - 语言模型(VLM),生成层间键值(KV)缓存,为后续融合提供基础表征。

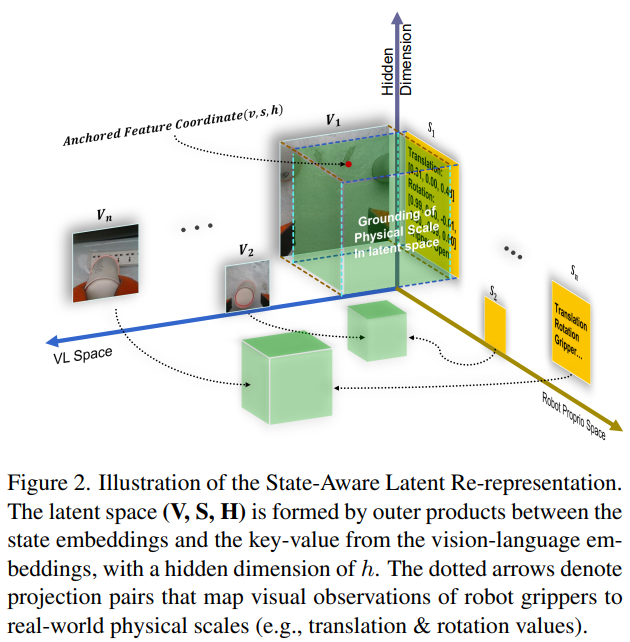

第二层:状态感知潜表征(SALR)------ 模态鸿沟桥梁构建

为解决视觉 - 语言表征与机器人物理动作空间的对齐问题,设计了核心融合模块:

- 状态 transformer 并行架构:与 VLM 共享 28 层深度,将机器人本体感受(关节角度、末端执行器姿态等)投影为状态嵌入,通过自注意力机制优化表征。

- 乘性融合接地机制:采用外积融合策略,将状态查询向量与 VLM 的层间 KV 缓存逐元素相乘,构建 "具象化锚定" 潜空间,使抽象视觉 - 语言特征与物理动作空间精准对齐。

- 可学习掩码与压缩:通过可学习掩码过滤背景干扰等无关信息,再经潜空间压缩得到紧凑的动作相关表征,提升后续动作生成效率。

第三层:动作生成 ------ 条件流匹配多步预测

基于条件流匹配(CFM)构建动作专家(Action Expert),将接地后的多模态表征转化为平滑连贯的动作序列:

- ** transformer 解码器架构 **:包含 28 层 transformer 解码器,以 SALR 输出的键值对为条件,结合带噪声的动作轨迹与时间步嵌入,建模动作时序结构。

- 端到端训练与推理:训练阶段通过 CFM 目标优化噪声预测,推理阶段通过多步去噪,从纯噪声中逐步解码出精准、连续的多步动作序列(平移、旋转、夹爪控制)。

验证逻辑:从仿真到真实的全面性能验证

LoLA 通过 "仿真基准 - 真实场景 - 消融实验" 的三级验证体系,充分证明技术有效性,涵盖不同机器人平台与任务类型:

仿真基准性能突破

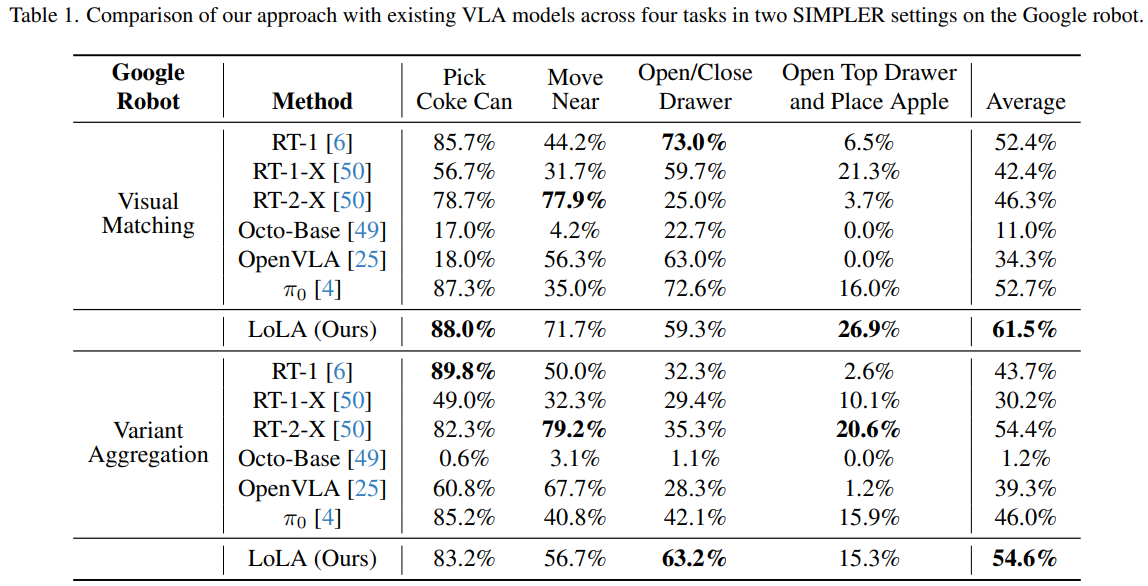

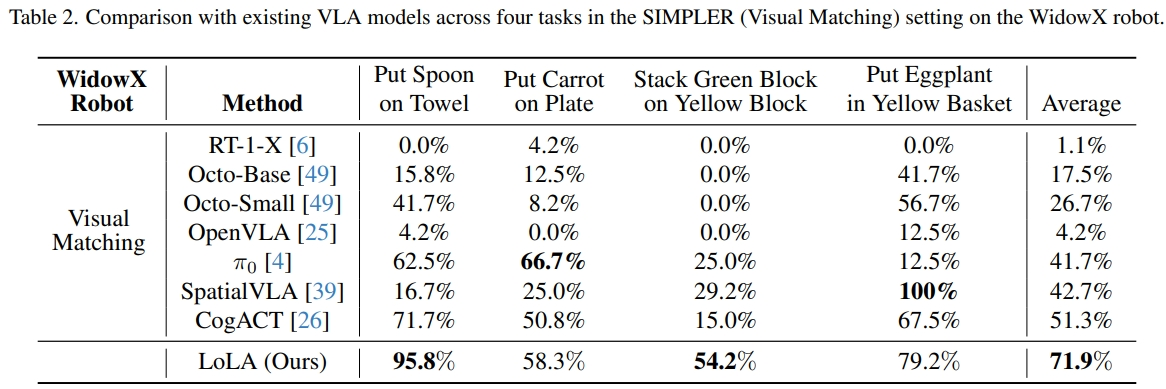

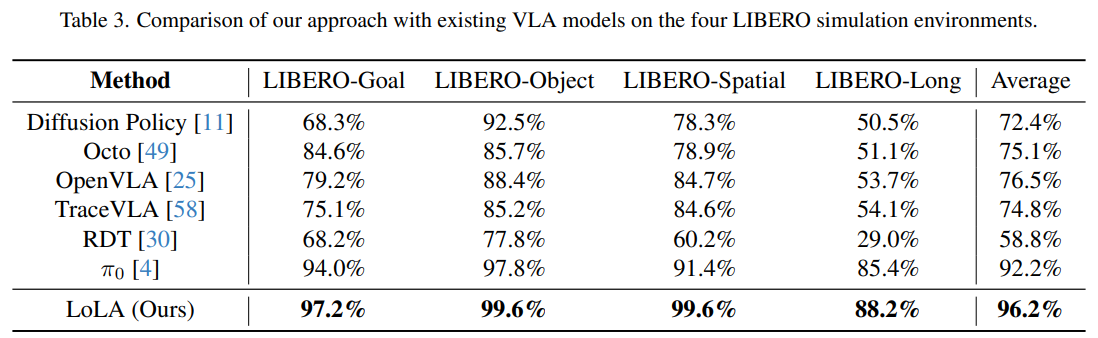

在 SIMPLER 和 LIBERO 两大权威基准测试中,显著超越现有 SOTA 模型:

SIMPLER 基准:在 Google Robot 任务中,视觉匹配与变体聚合设置下平均成功率分别达 61.5% 和 54.6%,超越 π₀、RT-2-X 等模型;在 WidowX Robot 的多步任务中,平均成功率 71.9%,较 π₀ 相对提升 20.6%。

LIBERO 基准:覆盖目标、物体、空间、长时程四大任务套件,平均成功率 96.2%,其中长时程任务套件(LIBERO-Long)成功率 88.2%,展现出强大的多步推理能力。

真实场景跨平台泛化

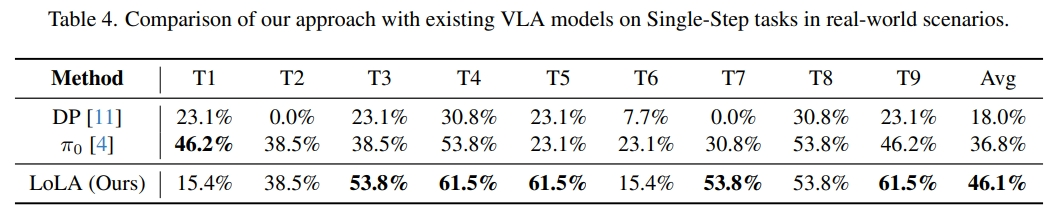

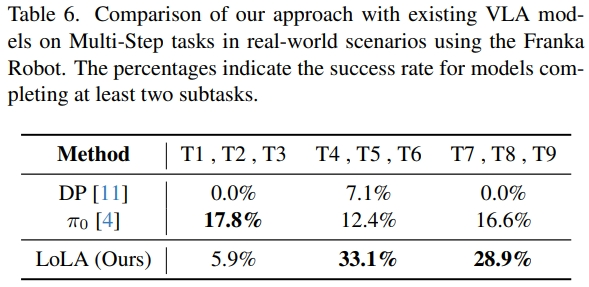

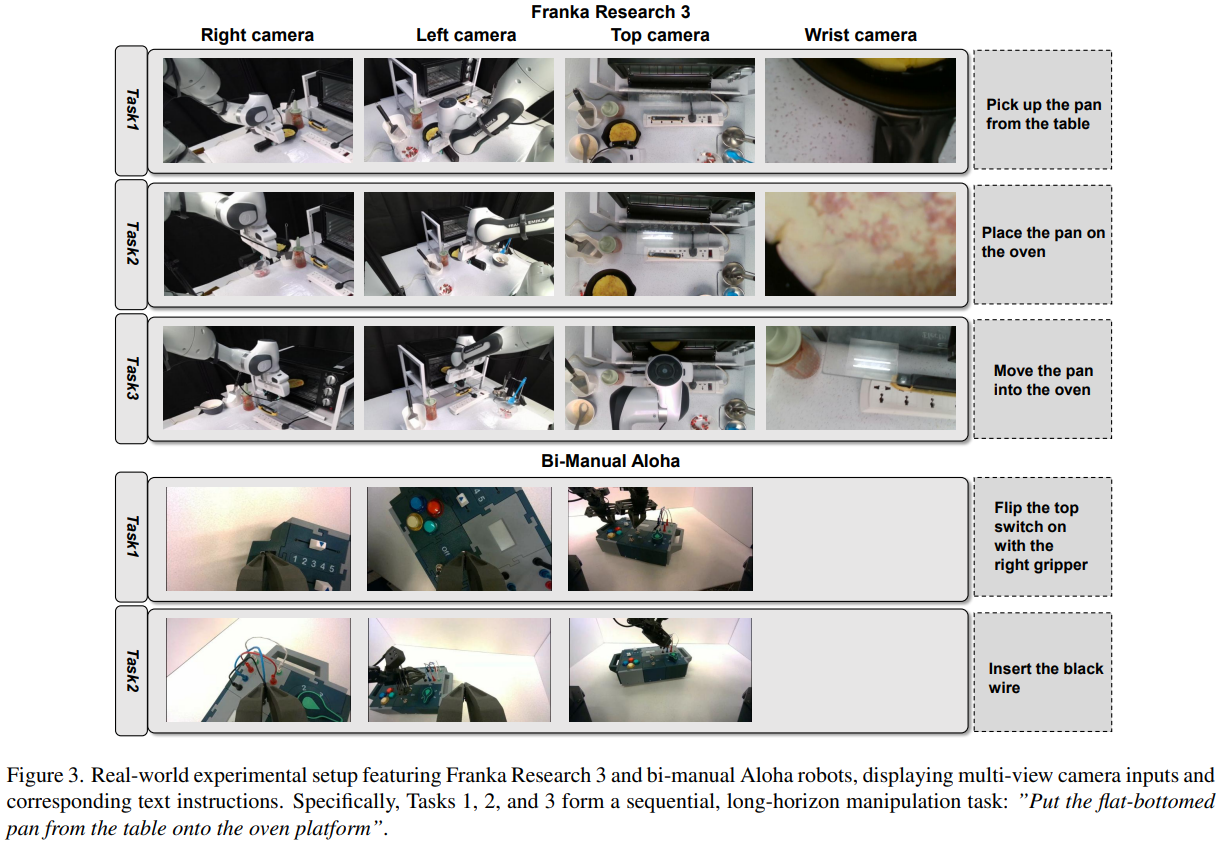

在 Franka Research 3 单臂机器人上完成真实世界验证:

Franka 平台:设计 28 个任务(含 7 组序列长时程任务与 6 个端到端任务),单步任务平均成功率 46.1%,长时程任务中完成至少两个子任务的成功率最高达 33.1%,是 π₀ 模型的 2.67 倍。

核心组件消融验证

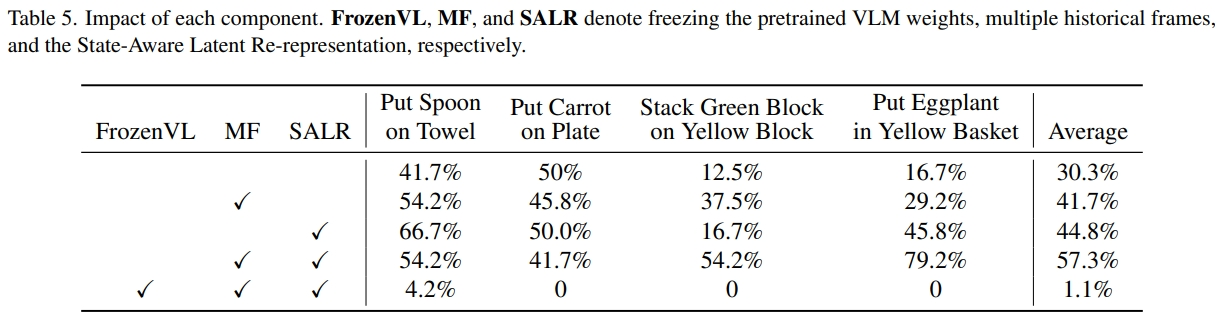

通过控制变量实验验证关键模块的必要性:

- 引入多历史帧(MF)使平均成功率提升 11.4%,证明时序上下文的重要性;

- 状态感知潜表征(SALR)模块单独贡献 14.5% 的性能提升,验证了模态对齐的核心价值;

- 多历史帧与 SALR 联合使用时,模型达到最优性能(57.3%),凸显架构协同效应。

局限与未来方向

LoLA 作为长时程机器人操纵的突破性框架,仍存在可优化空间:

- 复杂扰动场景的鲁棒性不足,面对突发故障(如物体掉落)的恢复能力有限;

- 端到端长时程任务的绝对成功率仍有提升空间,需进一步降低误差累积;

- 未来可探索动态闭环恢复机制,结合在线自适应调整策略,增强模型在真实复杂环境中的容错能力;同时优化模型轻量化设计,提升推理速度与部署灵活性。

总结:LoLA 的范式价值与行业影响

LoLA 的核心贡献不仅在于提出了长时程潜动作学习框架,更在于构建了 "高效编码 - 精准接地 - 连贯生成" 的技术范式:通过时空选择性采样解决长序列处理效率问题,通过 SALR 模块破解模态鸿沟难题,通过跨平台、跨场景的大规模验证证明了泛化能力。其 100 亿参数规模的模型架构、1100 万条真实机器人轨迹的预训练数据,以及开源的技术方案,为机器人学、计算机视觉、多模态学习等领域提供了统一研究平台,推动通用机器人从短时简单任务向长时复杂任务跨越,加速自主机器人在家庭服务、工业生产等真实场景的落地进程。

具身求职内推来啦

国内最大的具身智能全栈学习社区来啦!

推荐阅读

从零部署π0,π0.5!好用,高性价比!面向具身科研领域打造的轻量级机械臂

工业级真机教程+VLA算法实战(pi0/pi0.5/GR00T/世界模型等)

具身智能算法与落地平台来啦!国内首个面向科研及工业的全栈具身智能机械臂

VLA/VLA+触觉/VLA+RL/具身世界模型等!具身大脑+小脑算法与实战全栈路线来啦~

MuJoCo具身智能实战:从零基础到强化学习与Sim2Real

Diffusion Policy在具身智能领域是怎么应用的?为什么如此重要?