一、政策背景与监管框架

自2023年起,我国逐步构建起全球首个覆盖生成式人工智能(Generative AI)全生命周期的监管体系。以《生成式人工智能服务管理暂行办法》(2023年8月15日实施)为核心,辅以《网络安全法》《数据安全法》《个人信息保护法》《深度合成管理规定》《算法推荐管理规定》等上位法及配套规范,形成了"政策规范---技术防御---备案准入"三位一体的治理机制。

2024年2月发布的《生成式人工智能服务安全基本要求》于2025年4月正式升级为国家标准《GB/T 45654-2025》,标志着生成式AI的安全合规要求已进入标准化阶段。国家互联网信息办公室作为主导机构,联合工信部、科技部、发改委等部门,统筹中央与地方两级监管,对具备舆论属性或社会动员能力的大模型服务实施强制备案。

截至2025年7月,全国已有491款大模型完成备案,其中北京市以144款居首,占总量33%,形成"单城百模"的集聚效应。上海、广东、浙江等地亦积极跟进,推动区域AI产业生态建设。

二、大模型备案适用范围与判定标准

并非所有生成式AI服务均需备案。根据现行监管口径,以下三类情形构成备案义务:

- 服务对象:面向中国境内公众提供服务(如To C端对话产品、文生图工具等);

- 服务内容:具备生成文本、图像、音频、视频等多模态内容的能力,且具有"舆论属性或社会动员能力";

- 模型类型:无论自研、微调或预训练模型,只要满足上述两点,即需备案。

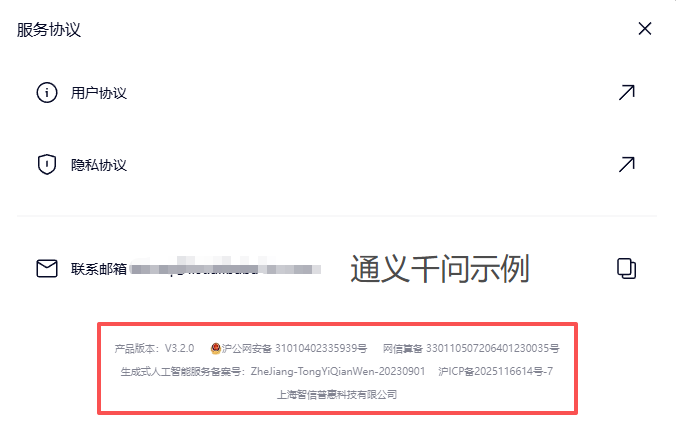

若企业仅调用已备案第三方模型API,未进行任何微调且不引入自有语料,则通常只需完成大模型登记 ,而非完整备案。需特别注意:大模型备案与算法备案为两项独立义务。若服务涉及深度合成、个性化推荐、排序精选、检索过滤、调度决策等五类特定算法,须另行完成算法备案,并在产品显眼处悬挂备案编号。

三、大模型备案核心要求

备案审查聚焦四大维度,构成"一票否决"与持续合规的基础:

(1)备案主体资质合规

申请主体须为依法设立、具备独立法人资格的企业或科研机构,拥有健全的网络安全与数据安全管理制度,并指定专职安全负责人。

(2)数据合规与语料安全(根基性要求)

- 来源合法:自采语料需保留采集日志与授权证明;商业语料须提供采购合同及来源合法性声明;含个人信息的语料需取得用户同意(敏感信息需单独同意)。

- 境外语料限制:境外数据占比不得超过30%。

- 双重筛查机制:采集前与入库前均需进行不良信息筛查,违法或低俗内容占比超5%的语料不得使用。

- 标注规范:需制定《语料标注规则》,明确标注人员资质、培训流程、功能性与安全性标注标准,并建立质量核验机制。

(3)内容安全与技术防控

- 拒答能力 :对附录A所列31类安全风险(如政治敏感、暴力恐怖、色情低俗、虚假谣言等),模型需具备高精度识别与拒绝能力。官方要求:敏感问题拒答率不低于95%,同时控制良性请求误拒率。

- 拦截关键词库:需提供不少于10,000个关键词,覆盖17类风险,每类不少于200个。

- 评估测试题集:包含≥2000条生成内容测试题与≥500条拒答测试题,以及≥500条非拒答测试题库抽检合格率≥90%。

(4)安全评估与材料清单

核心材料包括:

- 《生成式人工智能上线备案表》

- 《安全评估报告》(建议≥30页,逐条对照GB/T 45654-2025)

- 《语料标注规则》

- 《拦截关键词列表》

- 《评估测试题集》

- 营业执照、法人及安全负责人身份证明

- 第三方授权/采购合同(如适用

四、大模型备案流程与时效

备案流程分为六步,周期通常为6--10个月:

- 属地对接:向注册地或实际经营地省级/市级网信办报备并领取上线备案表;

- 材料准备与自评:完成全套申报材料及内部安全评估;

- 材料递交与技术测试:配合官方测试产品,提供5个测试账号,接受数万题规模的技术测评;

- 属地公安安全检查:核查网络安全制度与数据保护措施落地情况;

- 中央终审:由中央网信办组织专家评审与合规性复核;

- 公示与上线:获颁备案编号后,在服务显著位置公示备案信息。

五、地方激励政策与产业协同

在中央统一监管下,地方政府结合本地产业基础出台差异化支持政策。以杭州市钱塘区2025年12月发布的《支持人工智能产业高质量发展若干政策(2025年版)》为例:

- 对获得中央网信办备案的大模型企业,分档给予最高100万元一次性奖励;

- 对基于备案模型开展智能体开发并达到服务规模的企业,按上一年度交易结算费用最高30%资助,单企年度上限300万元;

- 支持建设AI社区、概念验证中心、中试基地,提供房租补贴、开办补助及最高2000万元平台奖励;

- 鼓励"人工智能+"场景应用,对入选省市级示范项目给予最高500万元补助。

类似政策亦见于北京、上海、深圳等地,体现"监管合规"与"产业扶持"双轮驱动的治理逻辑。

六、大模型备案后持续合规义务

备案并非终点,而是常态化监管起点。企业需建立"事前---事中---事后"全周期安全管理体系:

- 事前:对新上线功能或微调版本开展内部合规审查;

- 事中:接受中央与属地监管部门的动态技术测评,覆盖意识形态、违法犯罪、隐私泄露、偏见歧视四大类风险;

- 事后:建立应急响应机制,对违规生成内容及时处置、溯源并整改。

常态化测评方法包括思维链攻击、越狱提示、反面诱导、指令泄露等,要求企业持续优化拒答策略与关键词库。

未来,随着国家标准细化、地方政策深化及技术测评常态化,生成式AI的合规门槛将进一步提高,合规能力将成为核心竞争力之一。