在AI模型能力飞驰的今天,Anthropic的Claude选择了一条与众不同的发展道路------将安全与责任作为核心优势,成为AI领域的"安全优等生"。

1. Claude是什么?------以安全为基石的AI助手

Claude是Anthropic公司开发的大型语言模型系列,其最显著的特征是将安全性融入模型设计的每个环节 。与单纯追求性能指标的其他AI模型不同,Claude在**Constitutional AI(宪法AI)** 框架的指导下,确保其行为符合预设的道德准则和安全标准。

1.1 核心架构与版本演进

Claude模型系列包含三个主要产品线:Claude Opus(旗舰版)、Claude Sonnet(平衡版)和Claude Haiku(高效版)。最新的Claude 4系列于2025年5月发布,在保持强大性能的同时,进一步强化了安全特性。

模型架构对比表:

| 特性 | Claude Opus 4 | Claude Sonnet 4 | 关键技术 |

|---|---|---|---|

| 定位 | 顶级性能,复杂任务 | 平衡性能与成本 | 混合专家系统 |

| 上下文长度 | 200,000 tokens | 200,000 tokens | 长序列优化注意力机制 |

| 安全特性 | 多层级安全过滤 | 宪法AI集成 | 红队测试与RLHF |

1.2 Constitutional AI:安全内置的核心理念

Constitutional AI是Claude区别于其他AI模型的本质特征。这一创新框架通过预设的"宪法"原则引导AI行为,而不是依赖事后过滤。

python

# Constitutional AI 的简化工作流程示意

def constitutional_ai_workflow(user_input):

# 第一阶段:原则检测

principles = detect_applicable_principles(user_input)

# 第二阶段:基于原则的响应生成

raw_response = generate_response_using_principles(user_input, principles)

# 第三阶段:安全对齐验证

if violates_safety_principles(raw_response):

return apply_correction_protocol(raw_response)

else:

return raw_response2. 为什么需要"安全优等生"?------AI发展的必然选择

2.1 传统AI模型的安全隐患

传统AI模型主要面临三大安全挑战:隐私泄露风险、偏见放大问题、恶意使用可能性。这些隐患在金融、医疗、法律等高风险领域尤为突出。

Claude通过多层次安全机制应对这些挑战,其安全性能指标显著优于行业标准:

安全性能对比数据:

-

无害响应率:Claude 4系列达到98.76%,比前代提升显著

-

误拒率:低至0.08%,在安全性和实用性间取得更好平衡

-

抗越狱能力:即使面对针对性攻击,也能保持稳定安全输出

2.2 企业级应用的安全需求

在企业环境中,AI模型需要满足严格的合规性和安全性要求。Claude在这方面表现出色,已在美国劳伦斯利弗莫尔国家实验室(LLNL)等敏感环境中部署使用。

java

// 企业级API集成示例,展示安全特性

public class SecureClaudeIntegration {

private Anthropic client;

private SecurityValidator validator;

public SecureClaudeIntegration(String apiKey) {

this.client = new Anthropic(apiKey);

this.validator = new SecurityValidator();

}

public Response generateSecureResponse(String userInput) {

// 输入安全检查

if (!validator.isInputSafe(userInput)) {

return SecurityProtocols.getRejectionResponse();

}

// 安全上下文设置

SecureContext context = new SecureContext()

.setPrivacyLevel(PrivacyLevel.HIGH)

.setAuditTrail(true);

// 安全调用

return client.messages.create(

model: "claude-3-5-sonnet-20241022",

messages: [{role: "user", content: userInput}],

security_context: context

);

}

}3. 如何使用Claude的安全能力?------实战指南

3.1 基础安全配置

Claude的安全特性可以通过API进行精细配置,满足不同场景的安全需求。

javascript

// Claude API安全配置示例

const anthropic = require('@anthropic-ai/sdk');

const client = new anthropic.Anthropic({

apiKey: process.env.ANTHROPIC_API_KEY,

defaultHeaders: {

'X-Anthropic-Safety-Version': '2024-01-01', // 使用最新安全协议

},

});

// 创建安全对话

const message = await client.messages.create({

model: "claude-3-5-sonnet-20241022",

max_tokens: 1000,

temperature: 0.3, // 较低温度提高确定性,增强安全性

system: "你是一个安全导向的AI助手,遵循负责任AI原则。",

messages: [{ role: "user", content: userInput }],

safety_settings: {

harmful_content_filter: "strict",

privacy_protection: true,

audit_logging: true

}

});3.2 高级安全特性应用

Claude提供了多种高级安全特性,适用于敏感数据处理场景。

企业级安全特性对比表:

| 安全特性 | 功能描述 | 适用场景 |

|---|---|---|

| 数据脱敏 | 自动识别并保护敏感信息 | 医疗记录处理、财务数据分析 |

| 内容过滤 | 多层级有害内容检测 | 用户生成内容审核、教育平台 |

| 审计日志 | 完整对话记录与追溯 | 合规要求严格的行业 |

| 访问控制 | 基于角色的权限管理 | 企业多部门协作 |

3.3 安全编程实践

Claude在代码生成方面也融入了安全考量,能够识别并避免常见的安全漏洞。

python

# Claude生成的安全代码示例(密码处理)

def safe_password_handling(user_input_password):

"""

Claude生成的安全密码处理函数

体现了安全编程最佳实践

"""

import hashlib

import secrets

from typing import Tuple

# 生成安全盐值

salt = secrets.token_bytes(32)

# 使用抗ASIC/GPU的哈希算法

password_hash = hashlib.scrypt(

user_input_password.encode('utf-8'),

salt=salt,

n=2**14, # 计算成本参数

r=8,

p=1,

dklen=32

)

# 安全清理敏感数据

del user_input_password

return salt + password_hash

# 使用示例

try:

stored_hash = safe_password_handling("user_password_123")

print("密码安全处理完成")

except SecurityError as e:

print(f"安全处理失败: {e}")4. 技术原理深度解析

4.1 Constitutional AI的技术架构

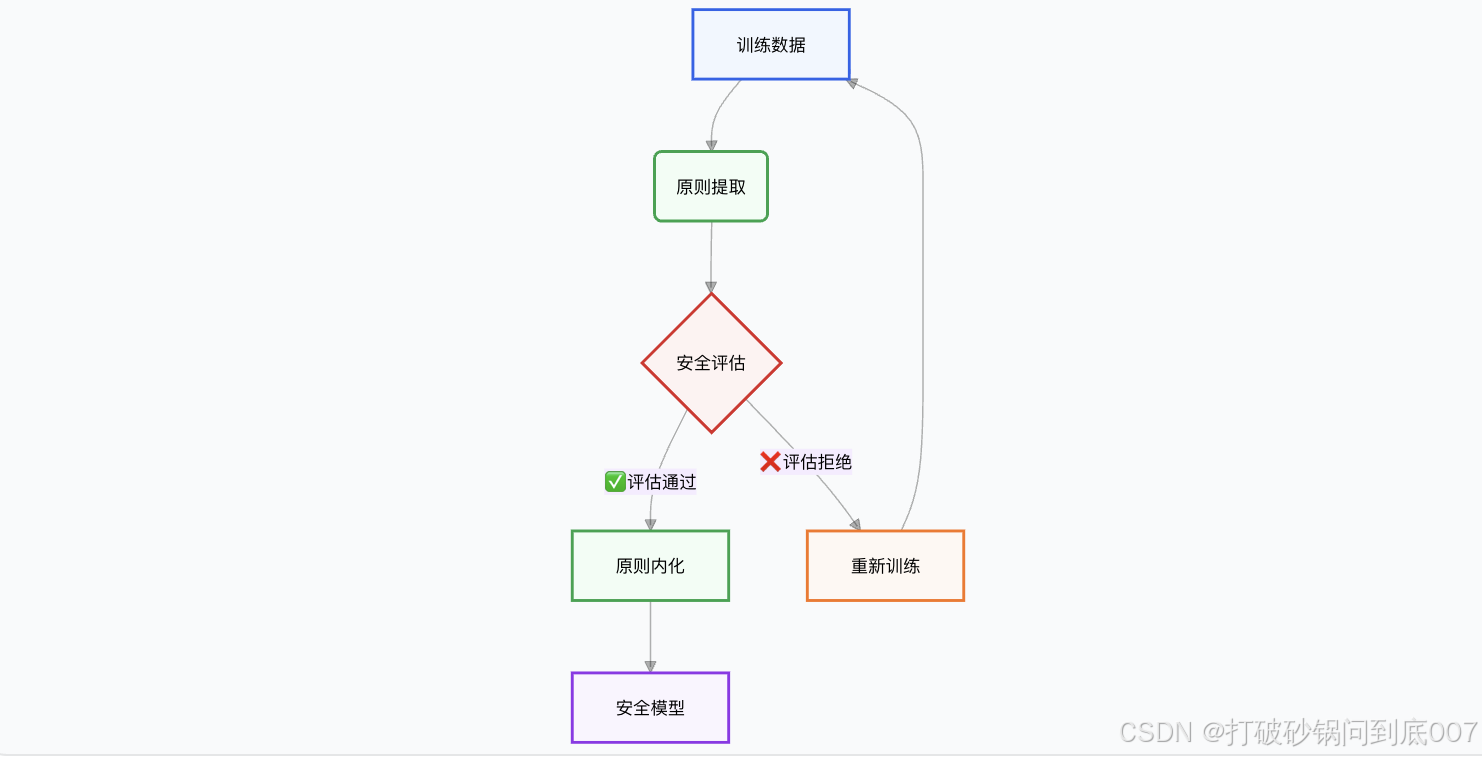

Constitutional AI的实现基于三个核心阶段,确保安全原则的内化而非表面服从。

第一阶段:原则学习

第二阶段:自我批判改进

模型通过自我监督机制识别潜在安全问题,并主动修正:

-

响应生成:基于初始原则生成回应

-

安全评估:使用宪法原则评估自身输出

-

迭代优化:根据评估结果改进响应

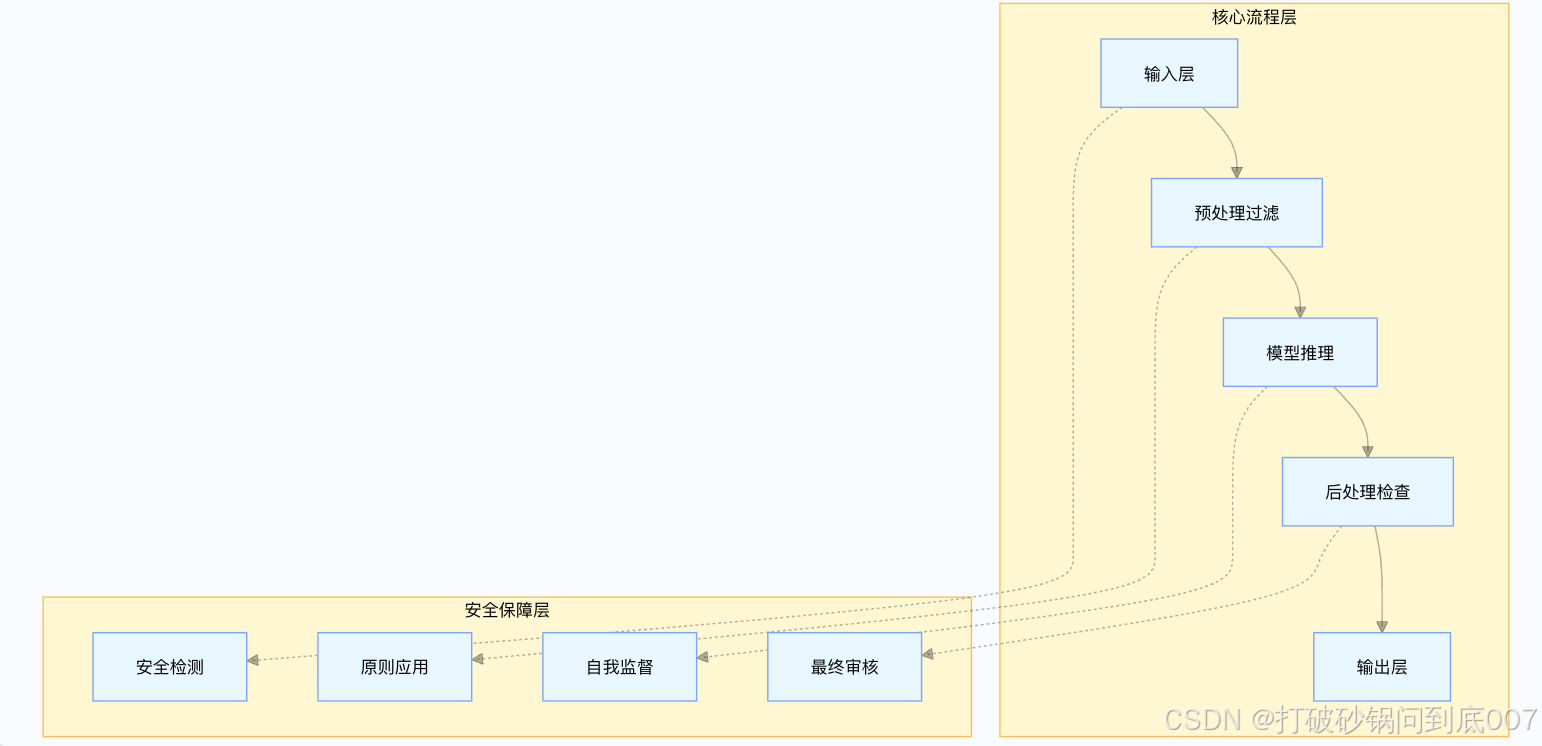

4.2 安全对齐机制

Claude的安全对齐采用多层级架构,确保从输入到输出的全过程安全。

安全对齐架构图:

5. 未来发展方向与启示

5.1 技术演进趋势

基于当前发展轨迹,Claude的安全技术将向以下方向演进:

-

自适应安全机制:根据上下文动态调整安全策略

-

跨文化安全理解:适应不同文化背景的安全标准

-

实时威胁响应:对新型安全威胁的快速适应能力

5.2 对AI行业的启示

Claude的"安全优等生"定位为整个AI行业提供了重要参考:

-

安全不是负担而是优势:企业级客户更愿意为可靠性和安全性付费

-

长期主义导向:在AI竞赛中,可持续发展比短期性能提升更重要

-

行业标准建设:推动建立统一的AI安全标准和评估体系

5.3 对社会的影响

Claude的安全优先策略对社会产生深远影响:

python

# 未来AI安全生态的简化模型

class FutureAISafety:

def __init__(self):

self.transparency = True

self.accountability = True

self.human_oversight = True

def societal_impact_assessment(self, ai_system):

"""评估AI系统对社会的影响"""

safety_score = ai_system.safety_metrics()

trust_level = self.calculate_public_trust(safety_score)

return {

'economic_impact': self.assess_economic_impact(ai_system),

'ethical_considerations': self.identify_ethical_issues(ai_system),

'regulatory_compliance': self.check_compliance(ai_system)

}6. 结论

Claude作为AI领域的"安全优等生",不仅展示了技术可行性,更重新定义了AI发展的价值取向。通过Constitutional AI等创新技术,Claude证明了性能与安全可以协同发展,而非此消彼长的对立关系。

随着AI技术渗透到社会各个角落,Claude的安全优先策略将为行业树立重要标杆。未来的AI发展必将更加注重安全性、可靠性和责任性,而Claude已经在这一道路上取得了领先优势。

对于AI技术爱好者而言,理解Claude的安全理念和技术实现,不仅有助于更好地应用这一工具,更能深刻把握AI技术的未来发展方向------在追求能力突破的同时,始终将人类价值观和社会责任放在首位。