原文:Point-Cloud Completion with Pretrained Text-to-image Diffusion Models

论文地址:2306.10533

代码地址:Point-Cloud Completion with Pretrained Text-to-image Diffusion Models

一、引言

现实世界中的点云数据往往是不完整的。这种不完整性主要源于数据采集过程中的物理限制,例如单一视角的扫描、物体间的相互遮挡以及传感器分辨率的不足。点云的不完整性会严重降低下游任务(如3D物体检测、分类和机器人导航)的性能,因此点云补全成为了3D计算机视觉领域一个至关重要的问题。现有的点云补全方法大多采用数据驱动的策略,依赖于在大规模的"不完整-完整"点云配对数据集上训练深度神经网络。

然而,这些数据驱动的方法面临着显著的局限性。首先,获取高质量的配对3D训练数据极其昂贵且费时,这导致现有的3D数据集在类别丰富度和规模上远不如2D图像数据集。其次,在有限类别上训练的模型往往难以泛化到分布外(Out-of-Distribution, OOD)的物体或从未见过的类别。这意味着,当模型在实际应用中遇到训练集中没有的物体形状时,其补全效果往往不尽如人意。为了解决这些问题,迫切需要一种能够利用更通用、更强大的先验知识,且不依赖于特定3D训练数据的补全方法。

近年来,大规模文本到图像(Text-to-Image)扩散模型(如Stable Diffusion)取得了巨大的成功。这些模型在数十亿的图像-文本对上进行了预训练,从而学习到了关于视觉世界的丰富语义和几何先验知识。受此启发,研究人员开始探索如何将这些强大的2D先验知识应用到3D生成任务中。最近提出的分数蒸馏采样(Score Distillation Sampling, SDS)使得通过优化过程从预训练的2D扩散模型中提取3D结构成为可能,这为解决点云补全中的数据稀缺和泛化问题提供了新的思路。

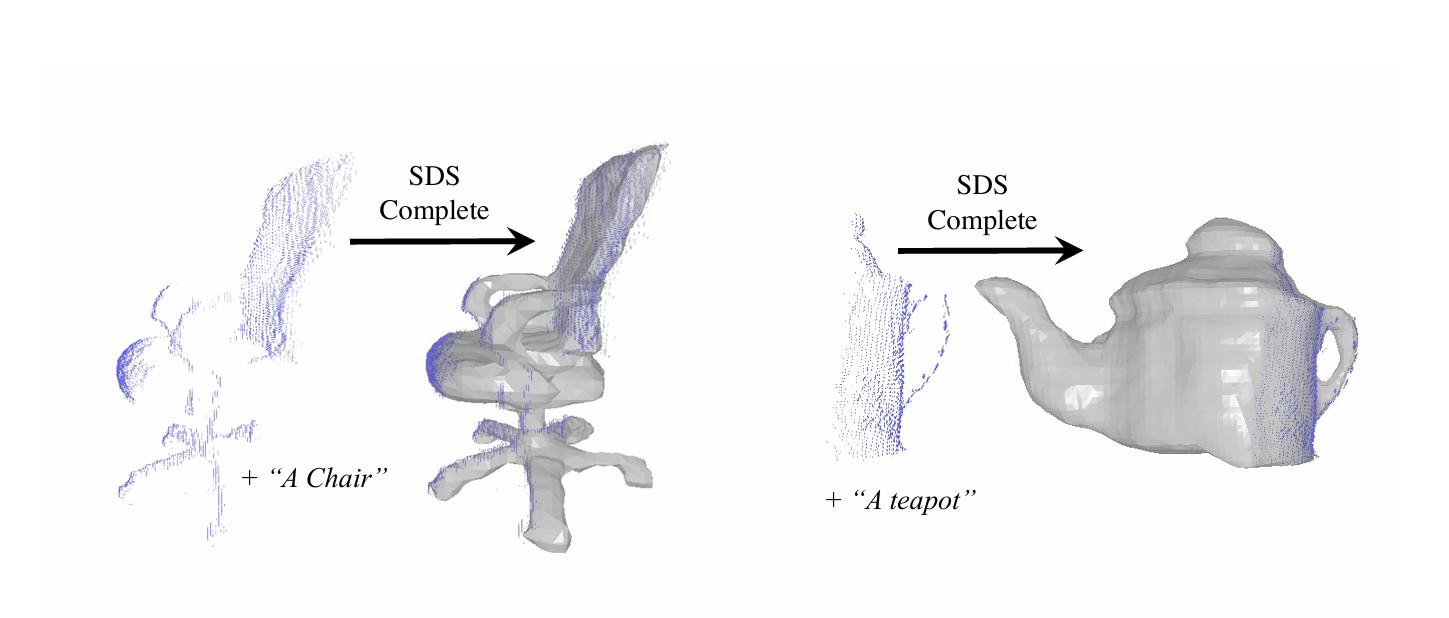

在本文中,我们提出了SDS-Complete,这是一种全新的、无需训练的点云补全方法。与传统方法不同,我们不依赖于任何3D数据集进行训练,而是直接利用预训练的文本到图像扩散模型作为先验。具体而言,我们将点云补全问题建模为一个测试时优化(Test-Time Optimization)问题。给定一个不完整的点云和描述该物体的文本提示,我们利用SDS损失函数来优化缺失部分的点云,使得补全后的物体在从不同视角渲染时,符合预训练2D扩散模型所定义的图像分布。为了保证补全结果与原始观测数据的一致性,我们还引入了特定的约束,确保生成的点云不仅在视觉上合理,而且能够平滑地融合到已知的不完整点云中。

我们在多个具有挑战性的数据集上对SDS-Complete进行了广泛的评估,包括真实扫描的Redwood数据集和室外场景的KITTI数据集。实验结果表明,我们的方法在处理各种未见过的物体类别时展现出了卓越的泛化能力。与当前最先进的数据驱动方法相比,SDS-Complete在没有任何3D监督的情况下,成功地恢复了物体的完整形状和细节,并且在倒角距离(Chamfer Distance)等定量指标上取得了显著的提升,平均误差降低了约50%。这证明了利用2D扩散模型先验来解决3D点云补全问题的有效性和巨大潜力。

二、模型结构

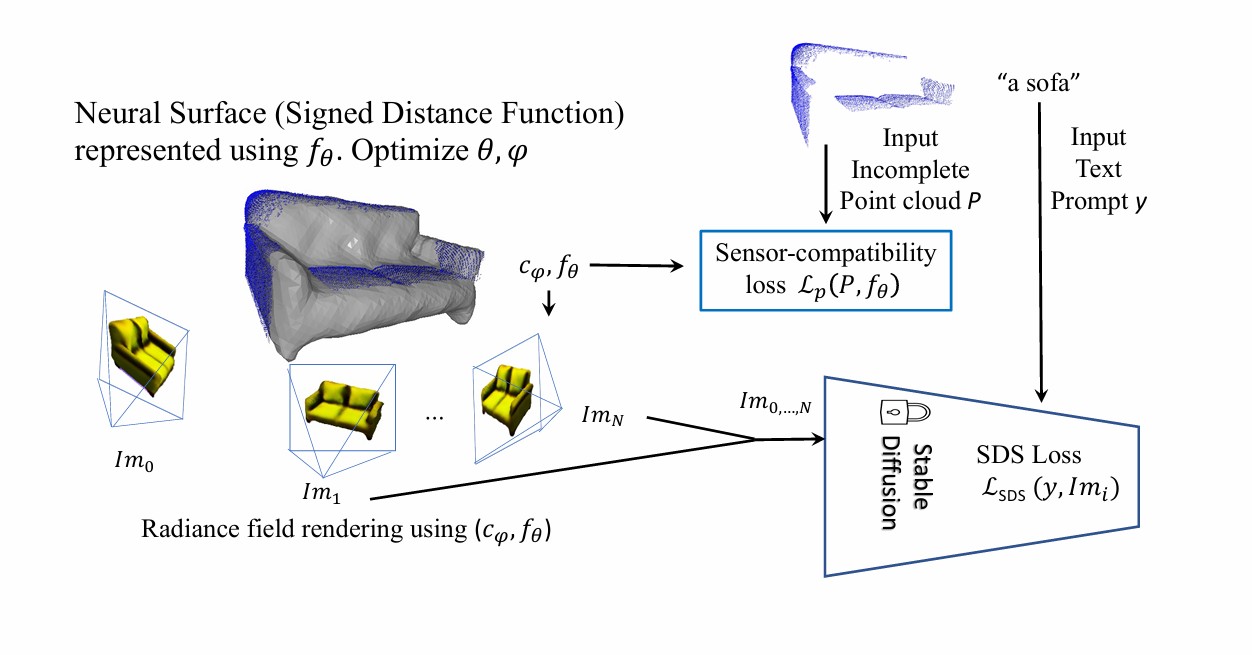

为了实现无需3D训练数据的点云补全,我们将该任务建模为一个测试时优化问题,利用预训练的文本到图像扩散模型作为强大的先验知识来源。给定一个不完整或稀疏的输入点云以及描述该物体的文本提示,我们的目标是寻找一个完整的3D形状表示,使其在几何上与输入点云保持一致,同时在视觉语义上符合文本描述。为了实现这一目标,我们并没有直接在离散的点云空间进行优化,而是选择了一种连续的神经隐式表示------符号距离函数(SDF),由一个多层感知机(MLP)网络进行参数化。SDF能够表示具有任意拓扑结构的连续表面,并且支持通过可微渲染技术与2D扩散模型进行交互,这为我们将2D先验引入3D任务奠定了基础。

核心的优化过程依赖于分数蒸馏采样(SDS)机制,这是连接3D几何与2D文本到图像扩散模型的桥梁。在每次迭代中,我们将当前的SDF隐式表面通过可微渲染器从随机采样的相机视角渲染成2D图像。然后,我们将这些渲染图像作为输入,送入预训练且参数冻结的Stable Diffusion模型中,并根据给定的文本提示计算SDS损失。SDS损失通过计算扩散模型预测的噪声残差,为SDF网络的参数提供了更新梯度。直观地说,这个过程会不断地"推动"3D表面的形变,直到其在各个视角下渲染出的图像看起来都像是符合文本描述的高质量2D图像,从而"蒸馏"出合理的缺失部分几何结构。

然而,仅仅依靠SDS损失来生成物体可能会导致结果偏离原始的输入数据,或者产生"幻觉"出与观测事实不符的形状。为了解决这个问题,我们在优化过程中引入了严格的数据一致性约束。具体而言,我们设计了一个距离损失函数,强制SDF网络在原始输入点云坐标处的预测值趋近于零。这意味着生成的隐式表面必须经过或极度接近已知的观测点。此外,为了保证SDF数学性质的正确性,我们还加入了一个Eikonal正则化项,约束SDF梯度的范数处处为1,从而确保生成的几何表面平滑且物理上合理,避免产生各种伪影或不自然的结构。

最终的完整点云是通过融合原始观测数据和生成的缺失部分得到的。在优化收敛后,我们得到了一个表示完整物体几何的隐式SDF场。为了将其转换回点云格式,我们利用移动立方体(Marching Cubes)算法从SDF中提取出高分辨率的等值面网格。随后,我们在该网格表面上进行均匀采样,生成稠密且均匀分布的点云数据。这种方法不仅填补了缺失的区域,还有效地对原始稀疏部分进行了上采样和平滑处理。通过这种结合了SDS引导生成与几何一致性约束的联合优化策略,我们的方法能够在完全没有任何3D监督信号的情况下,高质量地完成点云补全任务。

三、实验

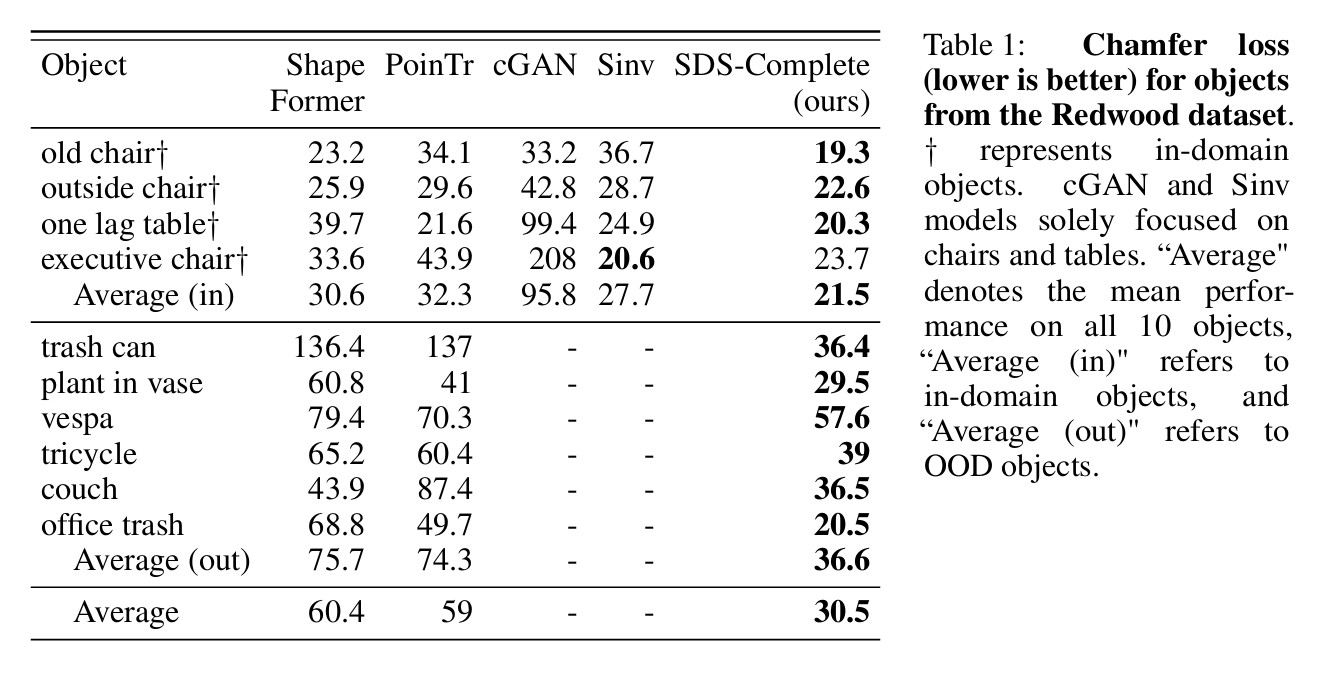

为了全面评估SDS-Complete的有效性,我们在具有挑战性的真实世界场景数据集上进行了广泛的实验,重点考察模型在面对训练分布之外(Out-of-Distribution, OOD)物体时的泛化能力。我们主要选用了Redwood数据集和KITTI数据集作为测试基准。Redwood数据集包含了从不同角度拍摄的多种类别的真实RGB-D扫描,这些数据由于遮挡和视角限制往往存在严重的缺失;而KITTI数据集则提供了自动驾驶场景下稀疏的LiDAR扫描点云,主要用于评估车辆等类别的补全效果。我们将本方法与当前最先进的监督学习点云补全方法进行了对比,包括PoinTr、SnowflakesNet等,这些基线模型均在标准的ShapeNet数据集上进行了全监督训练。我们的目标是验证在完全没有接触过目标领域3D数据的情况下,利用2D先验知识是否能实现更优越的补全性能。

定量评估的结果显示,SDS-Complete在各项关键指标上均取得了显著的优势。具体而言,在Redwood数据集的测试中,我们的方法在倒角距离(Chamfer Distance, CD)和F-Score这两个核心度量标准上均大幅超越了所有对比的基线方法。传统的监督学习方法虽然在与其训练数据相似的物体上表现尚可,但在面对真实世界中复杂且多样的未见物体时,其性能出现了急剧下降,表现出明显的泛化能力不足。相比之下,我们的方法无需任何3D训练数据,仅凭借预训练文本到图像扩散模型中蕴含的通用视觉知识,就将平均倒角距离误差显著降低了约50%。这一结果强有力地证明了,将2D生成式大模型的先验迁移到3D任务中,是解决3D数据稀缺和模型泛化问题的有效途径。

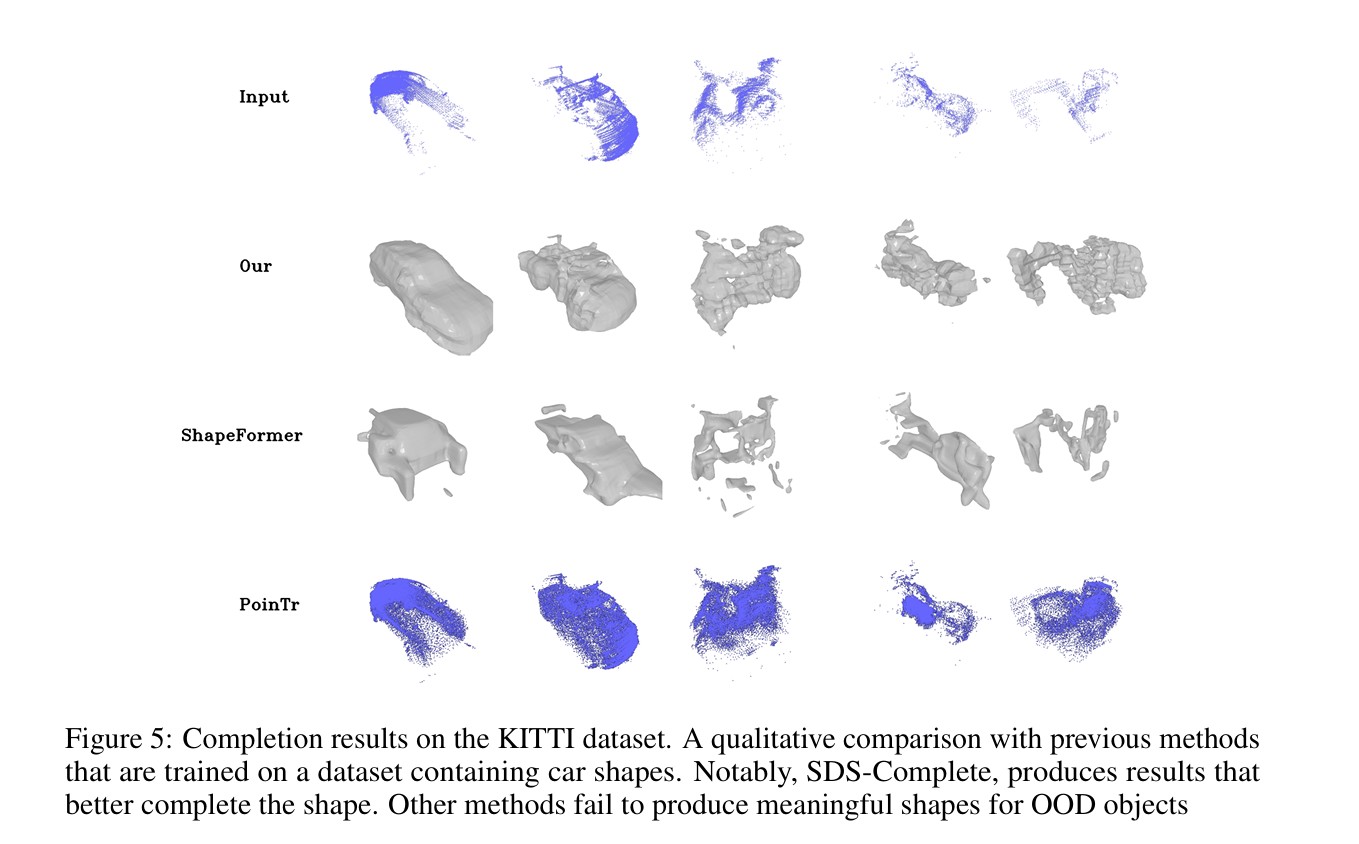

除了数值上的优越性,定性可视化结果进一步展示了SDS-Complete在恢复几何细节和保持语义合理性方面的强大能力。在对比实验的视觉呈现中可以清晰地看到,对于严重缺失的输入(例如仅有部分视角的椅子或残缺的汽车),监督学习方法往往倾向于生成模糊、过度平滑甚至结构扭曲的形状,难以推断出合理的缺失部分。相反,SDS-Complete生成的点云不仅在已观测区域与原始输入保持了高度的一致性,而且在未观测到的遮挡区域(如物体的背面或底部)成功"脑补"出了逼真且细节丰富的几何结构。无论是复杂的家具轮廓还是车辆的精细部件,我们的方法都能生成视觉上自然且符合物理逻辑的完整形状,极大地提升了补全结果的真实感。

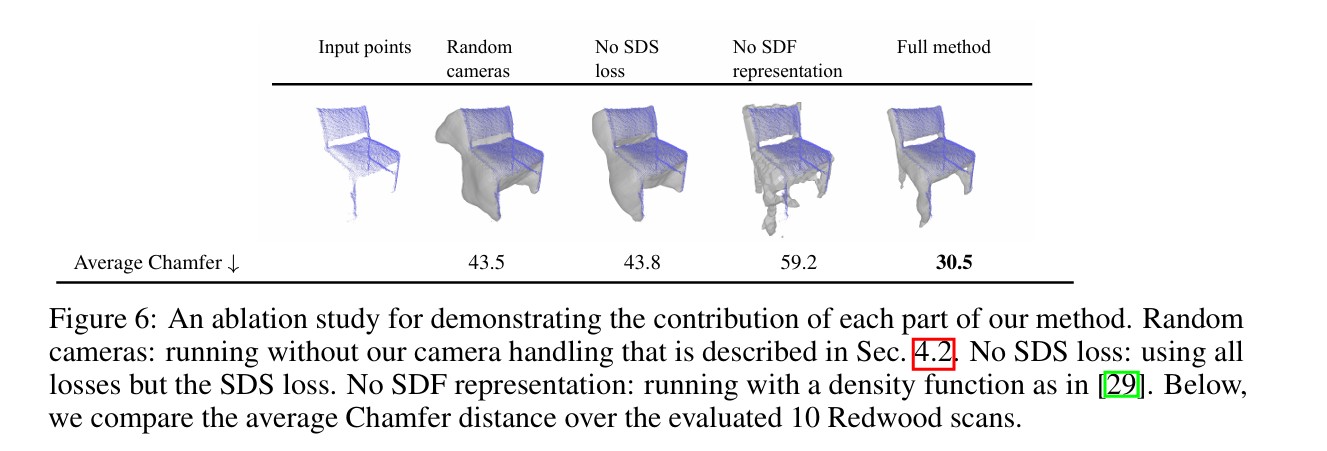

最后,我们通过一系列消融实验进一步验证了所提出框架中各个组件的必要性。实验分析表明,文本提示在指导补全过程中起到了关键的语义引导作用,准确的文本描述能够帮助模型更好地理解物体的类别特征,从而生成更符合预期的形状。同时,针对SDF表示引入的Eikonal正则化项和数据一致性约束也被证明是至关重要的;去除这些约束会导致生成的几何表面出现伪影、不平滑,或者偏离原始的输入点云。综合来看,这些实验结果不仅确认了SDS-Complete在跨域点云补全任务上的领先地位,也验证了我们所提出的测试时优化策略的鲁棒性和可靠性,为未来的3D生成与补全研究提供了坚实的实证基础。

四、总结

本文提出了SDS-Complete,这是一种利用预训练文本到图像扩散模型解决点云补全任务的新颖方法。与传统依赖大规模3D数据集进行监督训练的方法不同,我们开创性地提出了一种无需训练的范式,通过测试时优化策略,将2D扩散模型中丰富的生成先验成功迁移到了3D几何重建中。这种方法不仅避免了昂贵的3D数据采集和标注成本,还从根本上解决了传统模型在面对分布外物体时泛化能力差的难题,为解决3D数据稀缺问题提供了一个全新的视角。

实验结果表明,SDS-Complete在处理真实世界扫描数据时展现出了卓越的性能。在Redwood和KITTI等具有挑战性的数据集上,我们的方法在定量指标和定性视觉效果上均优于现有的最先进基线模型。通过结合符号距离函数的隐式表示与分数蒸馏采样,我们不仅实现了高质量的几何细节恢复,还有效保证了补全结果与原始观测点云的一致性,证明了利用2D跨模态先验解决3D视觉问题的巨大潜力。