在前面的博文中我们学习了YOLO26的论文,感兴趣的话可以自行移步阅读:

YOLO26 的关键架构改进

1、移除分布焦点损失(DFL):DFL 虽然在早期模型中提高了准确性,但增加了计算开销和导出复杂性。YOLO26 通过移除 DFL,简化了边界框回归,提高了效率和跨平台兼容性。

2、端到端无 NMS 推理:传统的 YOLO 模型依赖于非最大抑制(NMS)作为后处理步骤,这增加了延迟并需要手动调整超参数。YOLO26 实现了端到端的无 NMS 推理,直接输出最终检测结果,减少了延迟并简化了部署流程。

3、渐进式损失平衡(ProgLoss)和小目标感知标签分配(STAL):这两种新策略提高了训练的稳定性和小目标的检测准确性。ProgLoss 动态调整损失权重,防止模型过度拟合于主导类别;STAL 优先为小目标分配标签,提高了在复杂环境下的检测性能。

4、MuSGD 优化器:结合了 SGD 和 Muon 优化器的优势,实现了更快、更稳定的收敛,提高了训练效率。性能基准测试与比较分析

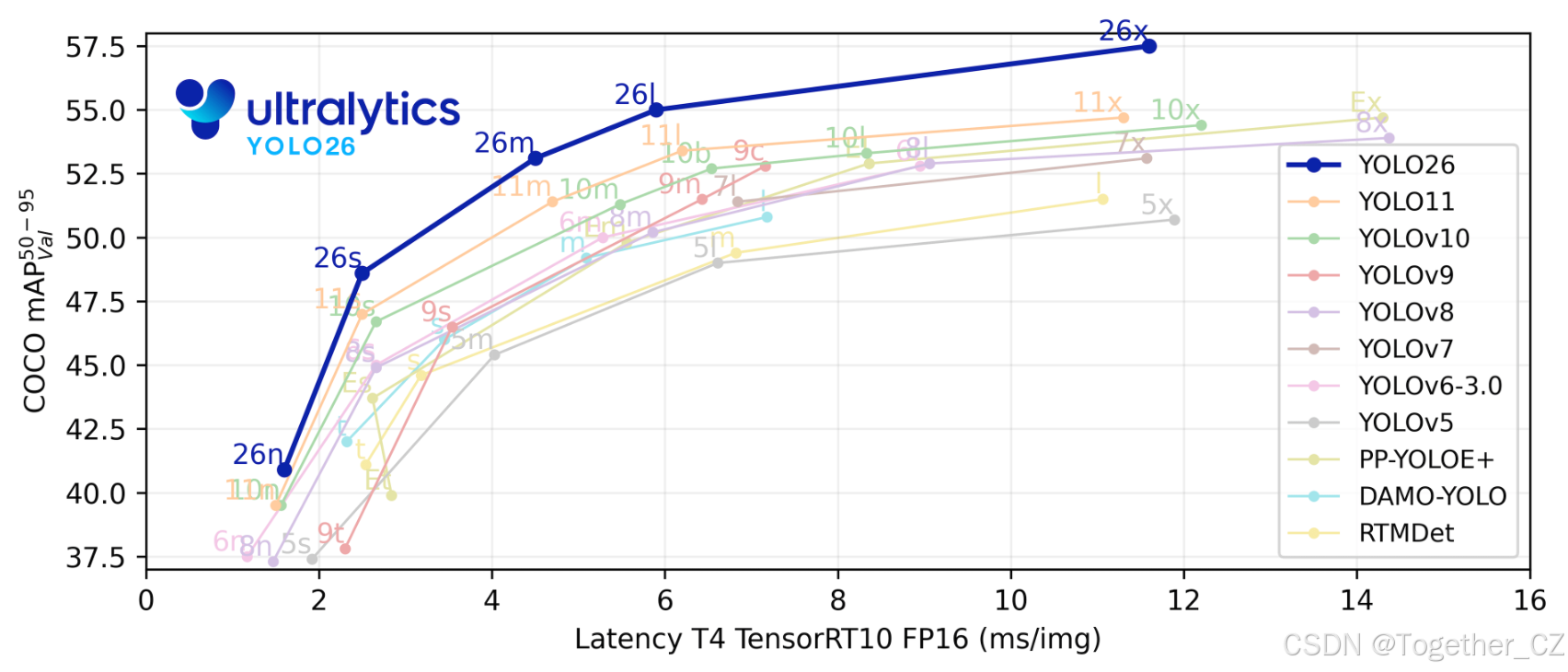

1、与 YOLO 前代产品的比较:YOLO26 在准确性与速度之间取得了更好的平衡。与 YOLOv10、YOLOv11、YOLOv12 和 YOLOv13 相比,YOLO26 在保持高准确性的同时,显著降低了推理延迟,特别是在 CPU 上的推理速度提高了多达 43%。

2、与基于变换器的检测器比较:YOLO26 在实时性能上优于基于变换器的检测器(如 RT-DETRv3),同时在准确性上与之相当。YOLO26 的无 NMS 设计和简化的架构使其在资源受限的环境中更具优势。

3、跨行业应用:YOLO26 在机器人技术、制造业和物联网中的实际应用展示了其跨行业适应性。例如,在机器人技术中,YOLO26 提供了更快的感知能力;在制造业中,YOLO26 使得实时缺陷检测系统更加高效。实时部署的优势

1、灵活的导出和集成路径:YOLO26 支持多种导出格式,包括 TensorRT、ONNX、CoreML、TFLite 和 OpenVINO,使得模型能够轻松集成到不同的硬件和软件平台中。

2、量化和资源受限设备:YOLO26 在半精度(FP16)和整数(INT8)量化下表现出色,显著降低了模型大小和能耗,同时保持了高准确性。这使得 YOLO26 特别适合在边缘设备和移动设备上部署。YOLO26 通过简化架构和提高部署效率,弥合了研究与实际应用之间的差距。它不仅在基准测试中表现出色,而且在实际部署中也展现了强大的性能。未来的研究可能会集中在进一步统一多任务视觉模型、探索半监督和自监督学习、融合变换器和 CNN 设计原则,以及开发针对边缘设备优化的训练和优化策略。

官方最新项目地址在这里,如下所示:

从更新时间可以看到:3个小时前刚刚更新发布的,可以说是非常新鲜的了。

官方发布的评测结果如下:

官方发布的检测任务的预训练权重如下:

| Model | size (pixels) | mAPval 50-95 | Speed CPU ONNX (ms) | Speed T4 TensorRT10 (ms) | params (M) | FLOPs (B) |

|---|---|---|---|---|---|---|

| YOLO26n | 640 | 40.9 | 38.9 ± 0.7 | 1.7 ± 0.0 | 2.4 | 5.4 |

| YOLO26s | 640 | 48.6 | 87.2 ± 0.9 | 2.5 ± 0.0 | 9.5 | 20.7 |

| YOLO26m | 640 | 53.1 | 220.0 ± 1.4 | 4.7 ± 0.1 | 20.4 | 68.2 |

| YOLO26l | 640 | 55.0 | 286.2 ± 2.0 | 6.2 ± 0.2 | 24.8 | 86.4 |

| YOLO26x | 640 | 57.5 | 525.8 ± 4.0 | 11.8 ± 0.2 | 55.7 | 193.9 |

是基于COCO数据集训练得到的。

分割模型权重如下:

| Model | size (pixels) | mAPbox 50-95 | mAPmask 50-95 | Speed CPU ONNX (ms) | Speed T4 TensorRT10 (ms) | params (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52.5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54.4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

也是基于COCO数据集训练得到的。

分类模型权重如下:

| Model | size (pixels) | acc top1 | acc top5 | Speed CPU ONNX (ms) | Speed T4 TensorRT10 (ms) | params (M) | FLOPs (B) at 224 |

|---|---|---|---|---|---|---|---|

| YOLO26n-cls | 224 | 71.4 | 90.1 | 5.0 ± 0.3 | 1.1 ± 0.0 | 2.8 | 0.5 |

| YOLO26s-cls | 224 | 76.0 | 92.9 | 7.9 ± 0.2 | 1.3 ± 0.0 | 6.7 | 1.6 |

| YOLO26m-cls | 224 | 78.1 | 94.2 | 17.2 ± 0.4 | 2.0 ± 0.0 | 11.6 | 4.9 |

| YOLO26l-cls | 224 | 79.0 | 94.6 | 23.2 ± 0.3 | 2.8 ± 0.0 | 14.1 | 6.2 |

| YOLO26x-cls | 224 | 79.9 | 95.0 | 41.4 ± 0.9 | 3.8 ± 0.0 | 29.6 | 13.6 |

是基于ImageNet数据集训练得到的

姿态估计模型权重如下:

| Model | size (pixels) | mAPpose 50-95 | mAPpose 50 | Speed CPU ONNX (ms) | Speed T4 TensorRT10 (ms) | params (M) | FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO26n-pose | 640 | 57.2 | 83.3 | 40.3 ± 0.5 | 1.8 ± 0.0 | 2.9 | 7.5 |

| YOLO26s-pose | 640 | 63.0 | 86.6 | 85.3 ± 0.9 | 2.7 ± 0.0 | 10.4 | 23.9 |

| YOLO26m-pose | 640 | 68.8 | 89.6 | 218.0 ± 1.5 | 5.0 ± 0.1 | 21.5 | 73.1 |

| YOLO26l-pose | 640 | 70.4 | 90.5 | 275.4 ± 2.4 | 6.5 ± 0.1 | 25.9 | 91.3 |

| YOLO26x-pose | 640 | 71.7 | 91.6 | 565.4 ± 3.0 | 12.2 ± 0.2 | 57.6 | 201.7 |

也是基于COCO数据集训练得到的。

OBB旋转目标检测模型权重如下:

| Model | size (pixels) | mAPtest 50 | Speed CPU ONNX (ms) | Speed T4 TensorRT10 (ms) | params (M) | FLOPs (B) |

|---|---|---|---|---|---|---|

| YOLO26n-obb | 1024 | 78.9 | 97.7 ± 0.9 | 2.8 ± 0.0 | 2.5 | 14.0 |

| YOLO26s-obb | 1024 | 80.9 | 218.0 ± 1.4 | 4.9 ± 0.1 | 9.8 | 55.1 |

| YOLO26m-obb | 1024 | 81.0 | 579.2 ± 3.8 | 10.2 ± 0.3 | 21.2 | 183.3 |

| YOLO26l-obb | 1024 | 81.6 | 735.6 ± 3.1 | 13.0 ± 0.2 | 25.6 | 230.0 |

| YOLO26x-obb | 1024 | 81.7 | 1485.7 ± 11.5 | 30.5 ± 0.9 | 57.6 | 516.5 |

是基于DOTAv1数据集训练得到的。

YOLO26模型的使用方式与YOLOv11完全一致,简单的检测Demo实例实现如下:

python

from ultralytics import YOLO

import time

if __name__ == '__main__':

sDir = "runs/detect/"

dID = [2]

eN = 100

# yolo26n

model = YOLO("weights/yolo26n.pt")

results = model.train(data="self.yaml", batch=16, name="yolo26n",save_dir=sDir,epochs=400, device=dID)

# yolo26s

model = YOLO("weights/yolo26s.pt")

results = model.train(data="self.yaml", batch=16, name="yolo26s",save_dir=sDir,epochs=eN,device=dID)

# yolo26m

model = YOLO("weights/yolo26m.pt")

results = model.train(data="self.yaml",batch=16,name="yolo26m",save_dir=sDir,epochs=eN,device=dID)

# yolo26l

model = YOLO("weights/yolo26l.pt")

results = model.train(data="self.yaml",batch=8,name="yolo26l", save_dir=sDir,epochs=eN,device=dID)

# yolo26x

model = YOLO("weights/yolo26x.pt")

results = model.train(data="self.yaml",batch=8,name="yolo26x",save_dir=sDir,epochs=eN,device=dID)明天再抽点时间来应用YOLO26模型来完成第一个项目的开发实践。