YOLOP 是一种全景驾驶感知的实时多任务网络,其车道检测以单阶段端到端方式,通过共享特征提取与多任务联合优化,实现对车道线的高效分割与定位,核心依赖卷积神经网络、特征融合、损失函数设计等 AI 技术,以及矩阵运算、概率统计、最优化理论等数学方法。以下从原理、AI 知识、数学知识三方面详解。

开源项目来源

https://gitee.com/faye-spike/yolop/tree/master

代码:

python

import torch

import cv2

import numpy as np

from pathlib import Path

import time

class YOLOPInference:

def __init__(self, weights_path='weights\End-to-end.pth', device='cuda:0'):

"""

初始化YOLOP模型

:param weights_path: 预训练权重路径

:param device: 推理设备,'cuda:0' 或 'cpu'

"""

from lib.config.default import _C as cfg

from lib.models import get_net

self.device = torch.device(device)

self.cfg = cfg

# 加载模型

self.model = get_net(cfg)

checkpoint = torch.load(weights_path, map_location=self.device)

self.model.load_state_dict(checkpoint['state_dict'])

self.model = self.model.to(self.device)

self.model.eval()

# 图像预处理参数

self.img_size = (640, 640) # 模型固定输入尺寸

def preprocess(self, img):

"""预处理:调整大小、归一化、转换Tensor"""

# 直接调整到模型输入尺寸,避免letterbox导致的尺寸不匹配问题

img = cv2.resize(img, self.img_size, interpolation=cv2.INTER_LINEAR)

# 转换

img = img[:, :, ::-1].transpose(2, 0, 1) # BGR to RGB, HWC to CHW

img = np.ascontiguousarray(img)

img = torch.from_numpy(img).to(self.device).float()

img /= 255.0

img = img.unsqueeze(0) # 增加批次维度 [1, 3, 640, 640]

return img, None, img.shape[:2]

def detect(self, img):

"""

对单帧图像进行推理

:param img: 原始BGR图像 (numpy数组)

:return: 绘制了结果的图像, 以及原始输出

"""

# 预处理

input_tensor, _, original_shape = self.preprocess(img)

# 推理

with torch.no_grad():

det_out, da_seg_out, ll_seg_out = self.model(input_tensor)

# --- 后处理示例:这里需要你根据任务自定义 ---

# 1. 处理目标检测结果 det_out (需要非极大值抑制NMS)

# 2. 处理可行驶区域分割 da_seg_out (取argmax得到类别图)

# 3. 处理车道线分割 ll_seg_out (取argmax,然后可能进行曲线拟合)

# 以下是一个简化的可视化示例(实际需要更完整的后处理)

result_img = img.copy()

# 示例:将车道线分割热图叠加到原图

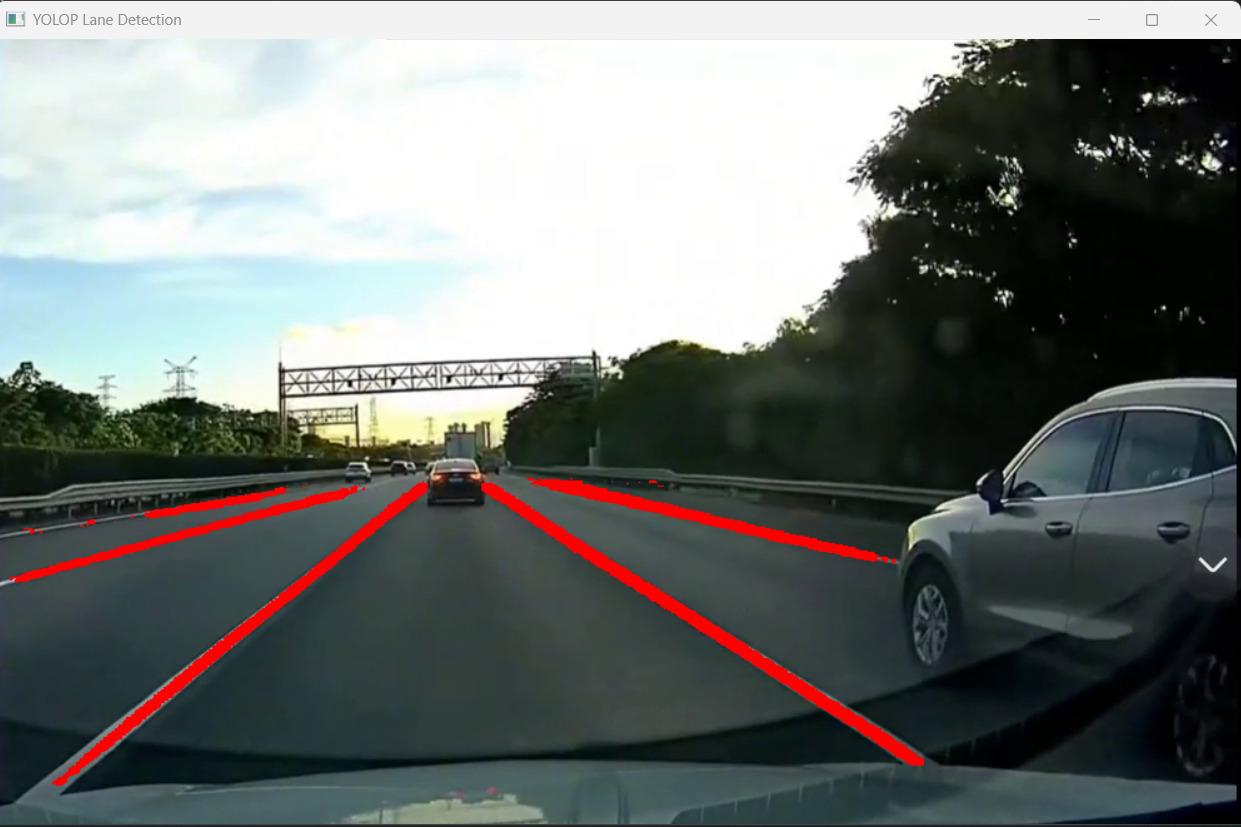

lane_mask = torch.argmax(ll_seg_out[0], dim=0).byte().cpu().numpy() # [640, 640]

lane_mask_resized = cv2.resize(lane_mask, (result_img.shape[1], result_img.shape[0]))

result_img[lane_mask_resized == 1] = [0, 0, 255] # 红色标记车道线

return result_img, (det_out, da_seg_out, ll_seg_out)

def process_video(video_path, output_path='output_video.mp4'):

"""

处理视频的主函数

"""

detector = YOLOPInference(device='cuda:0' if torch.cuda.is_available() else 'cpu')

cap = cv2.VideoCapture(video_path)

fps = int(cap.get(cv2.CAP_PROP_FPS))

width = int(cap.get(cv2.CAP_PROP_FRAME_WIDTH))

height = int(cap.get(cv2.CAP_PROP_FRAME_HEIGHT))

fourcc = cv2.VideoWriter_fourcc(*'mp4v')

out = cv2.VideoWriter(output_path, fourcc, fps, (width, height))

frame_count = 0

print(f"开始处理视频: {video_path}")

while cap.isOpened():

ret, frame = cap.read()

if not ret:

break

frame_count += 1

print(f"处理第 {frame_count} 帧...")

# 检测

result_frame, _ = detector.detect(frame)

# 写入输出视频

out.write(result_frame)

# 实时显示(可选)

cv2.imshow('YOLOP Lane Detection', result_frame)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

cap.release()

out.release()

cv2.destroyAllWindows()

print(f"视频处理完成!保存至: {output_path}")

# 使用示例

if __name__ == "__main__":

# 处理单个视频文件

process_video("test_video.mp4", "output_video.mp4")

# 或者处理摄像头实时流(source改为0)

# process_video(0, "摄像头录制.mp4")一、YOLOP 车道检测原理

YOLOP 的车道检测是其三大任务(目标检测、可行驶区域分割、车道线检测)之一,整体流程如下:

- 网络架构

- 骨干网络:采用 CSPDarknet,通过卷积、残差连接、跨阶段局部连接(CSP)等操作,提取多尺度图像特征,生成不同层级的特征图。

- 颈部网络:使用 PANet(路径聚合网络)结合 FPN(特征金字塔网络),实现自上而下的语义特征与自下而上的定位特征融合,增强多尺度特征表达能力。

- 头部网络:车道线分割头接收颈部输出的特征图,经上采样恢复至输入图像尺寸,输出每个像素属于车道线或背景的概率掩码。

- 车道线分割流程

- 输入图像经骨干网络提取特征,颈部网络融合多尺度特征后传入车道线分割头。

- 分割头通过多次上采样,将特征图从低分辨率恢复至原始图像大小,最终输出二值化的车道线分割结果。

- 训练时,采用多任务损失函数,联合优化目标检测、可行驶区域分割和车道线检测三个任务,平衡各任务权重,提升整体性能。

- 核心特点

- 共享特征提取层,减少计算量,提高推理速度,满足实时性要求。

- 多任务联合训练,利用任务间的相关性提升车道线检测精度,尤其在复杂路况下表现更优。

二、包含的人工智能知识

- 卷积神经网络(CNN)

- 卷积层:通过卷积核提取图像局部特征,如边缘、纹理等,是车道线特征提取的基础。

- 池化层:降低特征图维度,保留关键信息,减少计算量,同时增强特征的平移不变性。

- 激活函数:如 Mish、Leaky ReLU,引入非线性,提升网络对复杂特征的拟合能力。

- 残差连接:解决深层网络梯度消失问题,帮助网络学习车道线的细微特征。

- 特征融合技术

- FPN:构建特征金字塔,融合不同层级的特征,使网络能同时捕捉车道线的细节与全局语义信息。

- PANet:补充自下而上的特征传递路径,增强定位特征,提升车道线的位置精度。

- 多任务学习

- 将车道线检测与目标检测、可行驶区域分割联合训练,通过共享特征与联合损失函数,实现多个任务的协同优化,提高模型的泛化能力与效率。

- 损失函数设计

- 车道线分割损失通常采用 Tversky 损失、BCE 损失、Dice 损失等组合,解决类别不平衡问题,提高对车道线边缘和细小车道线的检测精度。

- 多任务损失通过加权求和,平衡各任务的训练优先级,避免某一任务主导训练过程。

- 数据增强

- 采用随机裁剪、旋转、翻转、亮度调整等方法扩充数据集,增强模型对不同光照、天气、路况的适应能力,提升车道线检测的鲁棒性。

三、包含的数学知识

- 线性代数

- 矩阵运算:卷积操作本质是矩阵乘法,特征图的生成、变换均依赖矩阵运算,包括卷积核与特征图的互相关计算、批量归一化中的均值和方差计算等。

- 张量操作:网络中数据以张量形式存在,涉及张量的形状变换、拼接、切片等操作,是特征处理的基础。

- 特征空间映射:通过线性变换与非线性激活,将图像像素空间映射到高维特征空间,便于车道线特征的提取与区分。

- 概率与统计

- 概率分布:输出的车道线概率掩码基于概率分布,通过 Softmax 或 Sigmoid 函数将网络输出转化为概率,用于判断像素类别。

- 最大似然估计:训练过程中,通过最小化损失函数,等价于最大化样本的对数似然,使模型输出尽可能接近真实标签的概率分布。

- 置信度计算:车道线分割结果的置信度基于概率统计,用于筛选可靠的检测结果。

- 最优化理论

- 梯度下降法:采用随机梯度下降(SGD)、Adam 等优化器,通过计算损失函数对网络参数的梯度,迭代更新参数,最小化损失函数,实现模型训练。

- 损失函数优化:多任务损失函数的加权系数通过交叉验证等方法确定,属于超参数优化问题,以达到最优的模型性能。

- 正则化:通过 L1、L2 正则化或 Dropout 等方法,防止过拟合,提高模型的泛化能力,其本质是在目标函数中加入惩罚项,约束参数空间。

- 几何学

- 透视变换:处理车道线的透视畸变,将图像中的车道线从透视视角转换为鸟瞰视角,便于车道线的检测与拟合。

- 像素坐标映射:上采样过程中,通过插值算法(如双线性插值)实现像素坐标的映射,恢复特征图的空间分辨率,保证车道线位置的准确性。

四、总结

YOLOP 车道检测是 AI 与数学知识深度融合的典型应用。其以 CNN 为基础,借助特征融合、多任务学习等 AI 技术,结合矩阵运算、概率统计、最优化等数学方法,实现高效、精准的车道线检测,为自动驾驶等场景提供关键的环境感知能力。