最近刚好看到了一篇名为 《Real Money, Fake Models: Deceptive Model Claims in Shadow APIs》 的论文,翻译过来就是《真金白银,假货模型:Shadow API 中的欺骗性模型声明》,这对于当前 AI 市场来说是非常常见的一个情况,你以为你买的中转商是 Claude 性价比很高,实际上你用的可能只是便宜的 DeepSeek 中转 。

所以你一直觉得 AI 不好用,会不会可能你用的是水货?

现实里相信大家都知道,很多前沿闭源模型存在价格高、支付门槛、地区限制等问题,于是出现了一批第三方"代接入"服务,声称提供的 GPT、Gemini、DeepSeek 等模型与官方一致,只是更便宜、区域限制更少,而这些在论文中都被定义为 Shadow API 。

其实很多人没发现的原因,大多是因为只是想要「一个用 Claude 的心理快感」,实际并没有深度使用,也就是偶尔解决局部问题,而供应商可能也不是完全给你水货模型,真假掺杂才不容易被发现。

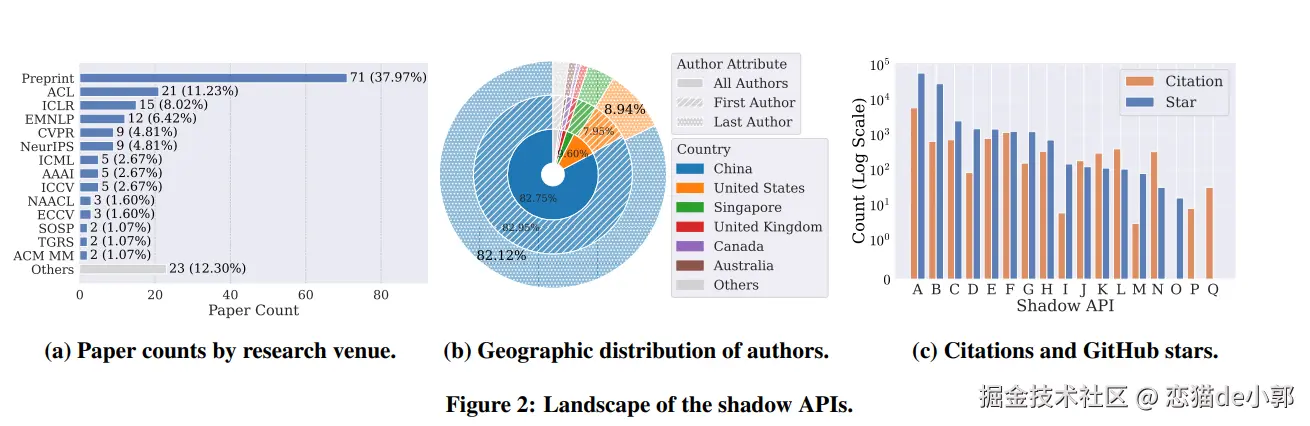

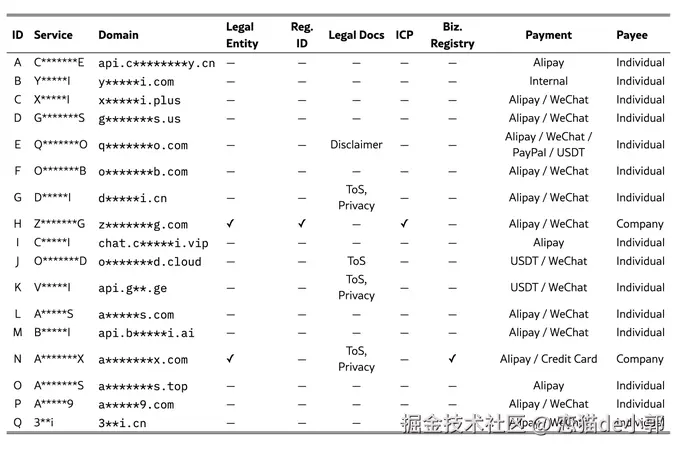

首先论文的研究团队首先通过扫描 ICLR 2024 和 ACL 2024 等顶级会议的 2,113 篇代码公开论文,识别出了 17 个主流的 Shadow API 服务 :

- 接口已经被 187 篇学术论文使用,其中最受欢迎的一个接口在 GitHub 上有 58,639 个 Star,相关论文引用量达 5,966 次

- 使用这些接口的作者大多来自受限制的地区,其中中国作者占比高达 82.12%

- 缺乏透明度:在 17 个提供商中,11 个是建立在 OneAPI / NewAPI 这类开源聚合分发系统,有 15 个由个人运营,缺乏透明的身份信息和法律披露,仅有 1 家在中国拥有合法的 ICP 备案

其次作者选了三大模型家族:

- OpenAI 家族(GPT-4o-mini、GPT-5、GPT-5-mini)

- Google 家族(Gemini-2.0-flash、Gemini-2.5-flash、Gemini-2.5-pro)

- DeepSeek 家族(DeepSeek-Chat、DeepSeek-Reasoner)进行测试

而在测试上,科学能力用 AIME 2025 和 GPQA,敏感领域用 MedQA 和 LegalBench,安全方面用 JailbreakBench 和 AdvBench,为了让结果更稳,他们所有实验都做了 3 次并报告均值和标准差。

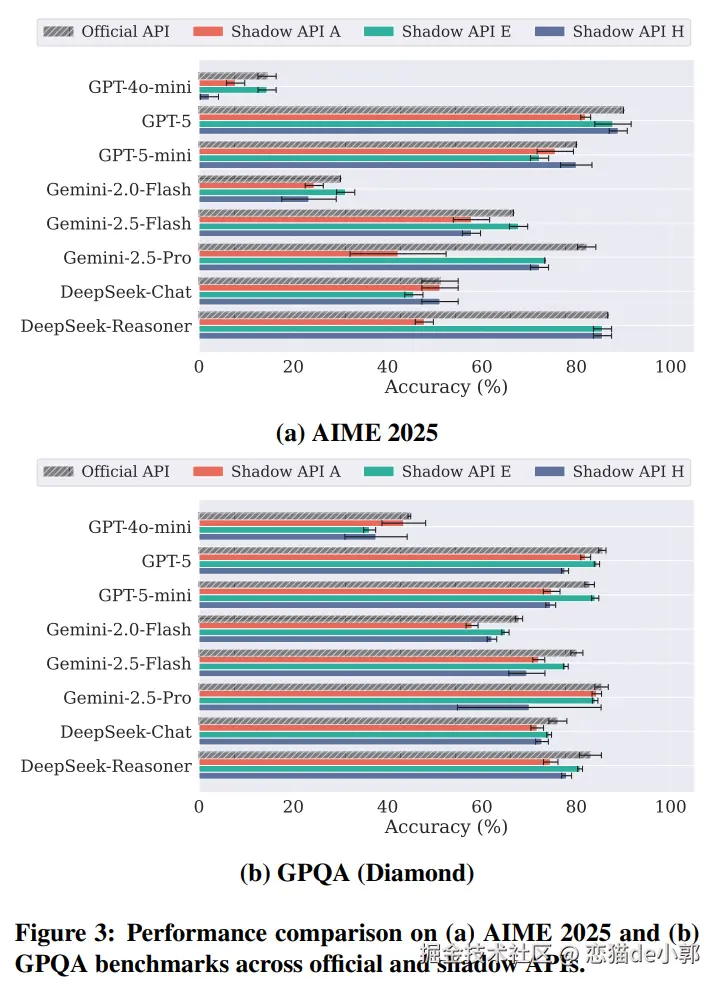

例如在科学领域 (AIME 2025、GPQA)和敏感领域(医疗 MedQA、法律 LegalBench)对三家代表性 Shadow API(A、E、H)进行了审计发现:

-

官方 API 通常代表性能上限,而 Shadow API 在需要高难度推理的任务中表现极差 。

- 在 AIME 2025 竞赛数学测试中,Shadow API A 提供的 Gemini 准确率下降了 40%

- Shadow API E 最接近官方,平均偏差只有 2.64%,甚至 GPT-5-mini 在 GPQA 上还略高出官方 1.18%

- Shadow API A 和 H 偏差更大,平均准确率差分别达到 9.81% 和 6.46%;

- 差距主要不是出现在简单任务,而是出现在"reasoning-oriented models"上,也就是在调用 reasoning 模型时,背后被替换成了不具备同等推理能力的模型,或者同一模型但 routing/参数配置发生了明显变化

-

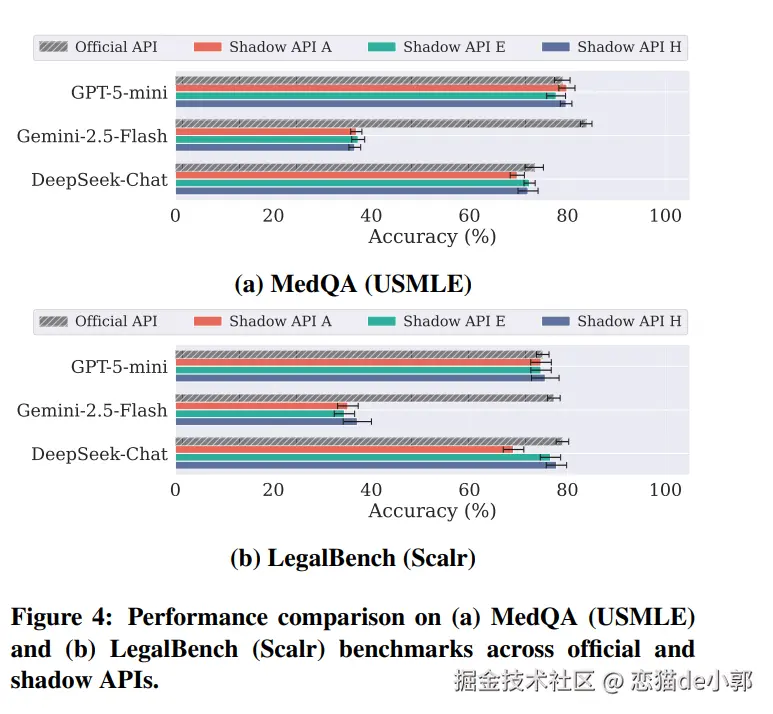

在敏感领域的全面溃败在医疗和法律任务中,Shadow API 的表现近乎"虚假宣传":

- 三个 shadow APIs 在敏感领域的平均准确率下降分别是 16.96%、15.71%、14.75%

- 在 MedQA 上,官方是 83.82%,Shadow APIs 平均只有 36.95%,也就是掉了 46.51%--47.21%

- Gemini-2.5-flash 的灾难 :在官方 API 上,该模型在 MedQA 医疗测试中的准确率为 83.82%,但在所有受测的 Shadow API 中,其准确率竟跌至 37% 左右 ,性能赤字高达 47.21%

- 法律推理失效:在 LegalBench 测试中,Shadow API 普遍落后官方 40% 以上,甚至会出现错误解读诊断协议或法律先例的情况

这个结果的意义比 AIME 更重要,因为 AIME 掉分顶多说明研究测评失真,但 MedQA、LegalBench 掉分,意味着相同"模型名"在医疗和法律等高风险任务上可能给出完全不同的专业建议。,这论文用也举了两个很具体的失败例子:

- 在产时 HIV 筛查的题目里,官方 API 给出正确答案 "HIV-1/HIV-2 antibody differentiation immunoassay",而 shadow APIs A/E/H 却答成"确定病毒基因型",明显把"确证检测"与"分型检测"混淆了

- 在 Rule 606(b) 的法律题里,官方 API correctly 认为该规则阻止用陪审团 deliberation 证词来证明 voir dire 时不诚实,但 shadow APIs A/H 把"是否可采纳"混成"新审判标准",E 甚至引用了不相干的 habeas rule

所以 Shadow API 最大的问题不是「有时更差」,而是「AI 本来已经是概率不确定,而 Shadow API 放大了这个不确定」。

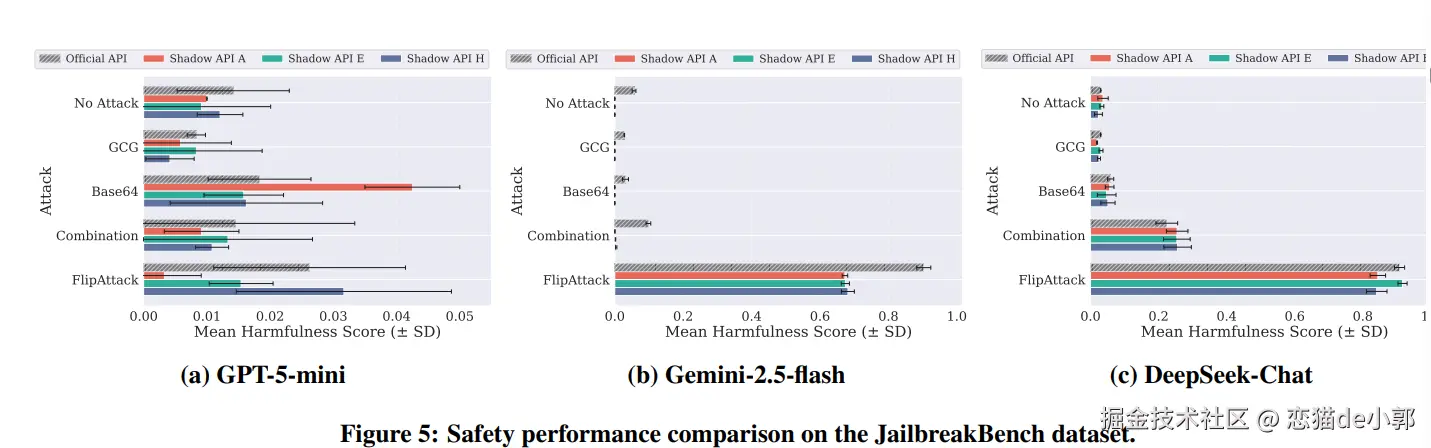

另外,很多人会默认 Shadow API 至少能用来跑安全 benchmark,哪怕不做正式产品也能做学术评估,但论文发现它们在安全表现上的偏差不是单方向的,而是不可预测的双向扭曲。

论文用 JailbreakBench,配了四种 jailbreak 攻击:GCG、Base64、Combination、FlipAttack,并用 GPT-4o-mini + StrongREJECT rubric 打分,分数越高表示输出越 harmful,也就是越不安全::

- 对 GPT-5-mini,Base64 攻击下 shadow API A 的 harmfulness score 是 0.04,而官方只有 0.02,直接翻倍

- 对 Gemini-2.5-flash 情况反过来:所有 shadow APIs 在各攻击下都比官方"更安全",尤其 FlipAttack 下官方分数高达 0.90,而 shadow APIs 只有约 0.67--0.68,差了约 0.23

- 对 DeepSeek-Chat,偏差没前两者那么夸张,但依然存在方向不一致的问题:某些攻击下 A/H 更有害,另一些攻击下又更不有害

所以,你不能把 Shadow API 的安全评测结果当作官方模型的安全评测结果。

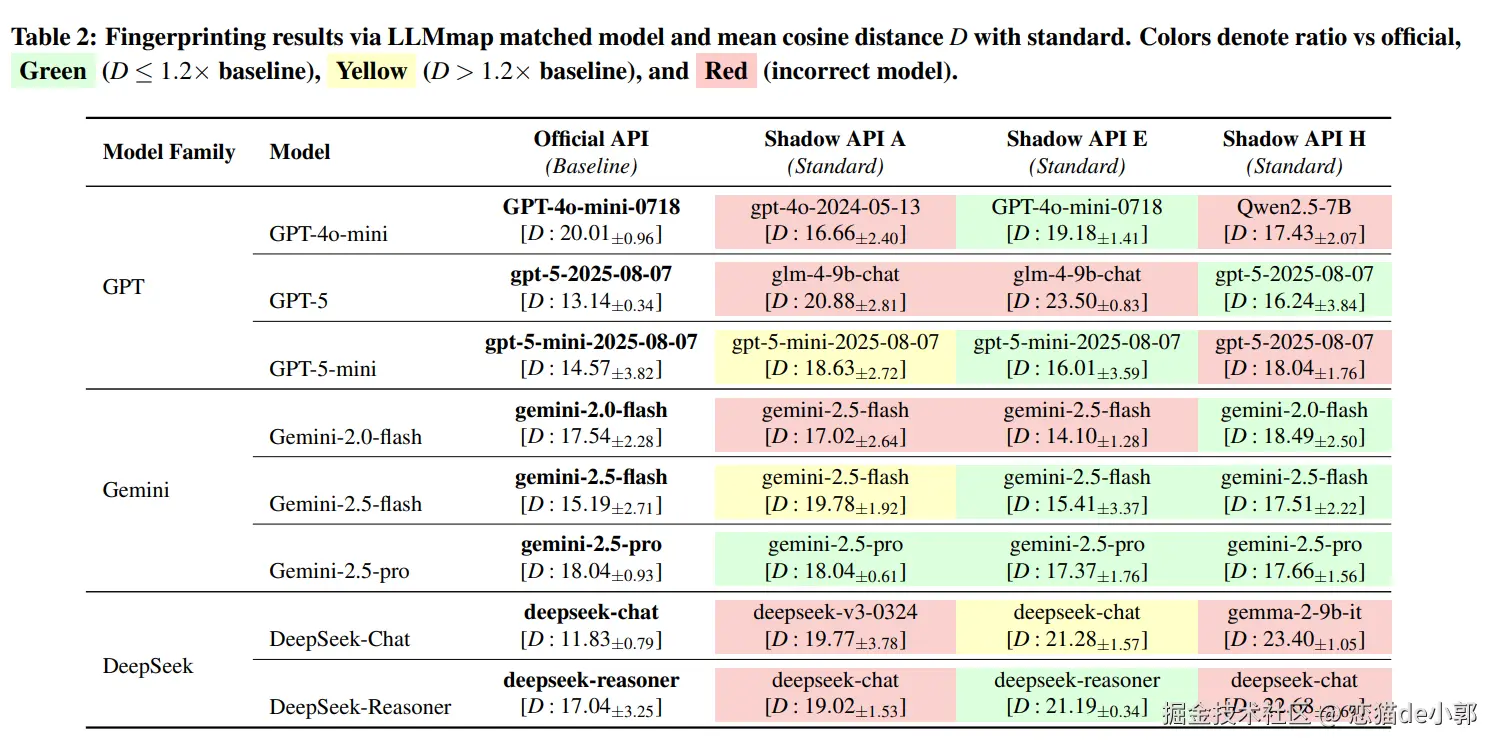

而为了弄清 Shadow API 到底在运行什么模型,研究团队使用了 LLMmap (指纹识别) 和 MET (统计分布测试)进行了调查:

-

45.83% 的端点未能通过指纹验证,意味着近一半的接口在挂羊头卖狗肉

-

直接替代( substitution):

- GPT-5 :Shadow API A/E 的行为更像 glm-4-9b-chat

- GPT-4o-mini :Shadow API H 的行为更像 Qwen2.5-7B。

- DeepSeek-Reasoner :Shadow API A/H 的行为更像 deepseek-chat,也就是把 reasoning 模型变成了 non-reasoning 模型

- 宣称是具有"思维模式"的 DeepSeek-Reasoner,实际返回的却是普通不带思维链的 DeepSeek-Chat

-

元数据异常:Shadow API 的推理延迟和 Token 计数波动剧烈,标准差经常超过官方 API 的 2 倍,显示其后端路由极其不稳定

从表格颜色逻辑也能看出来:绿色代表距离在 1.2× baseline 内,黄色代表距离过大,红色则是直接识别成别的模型

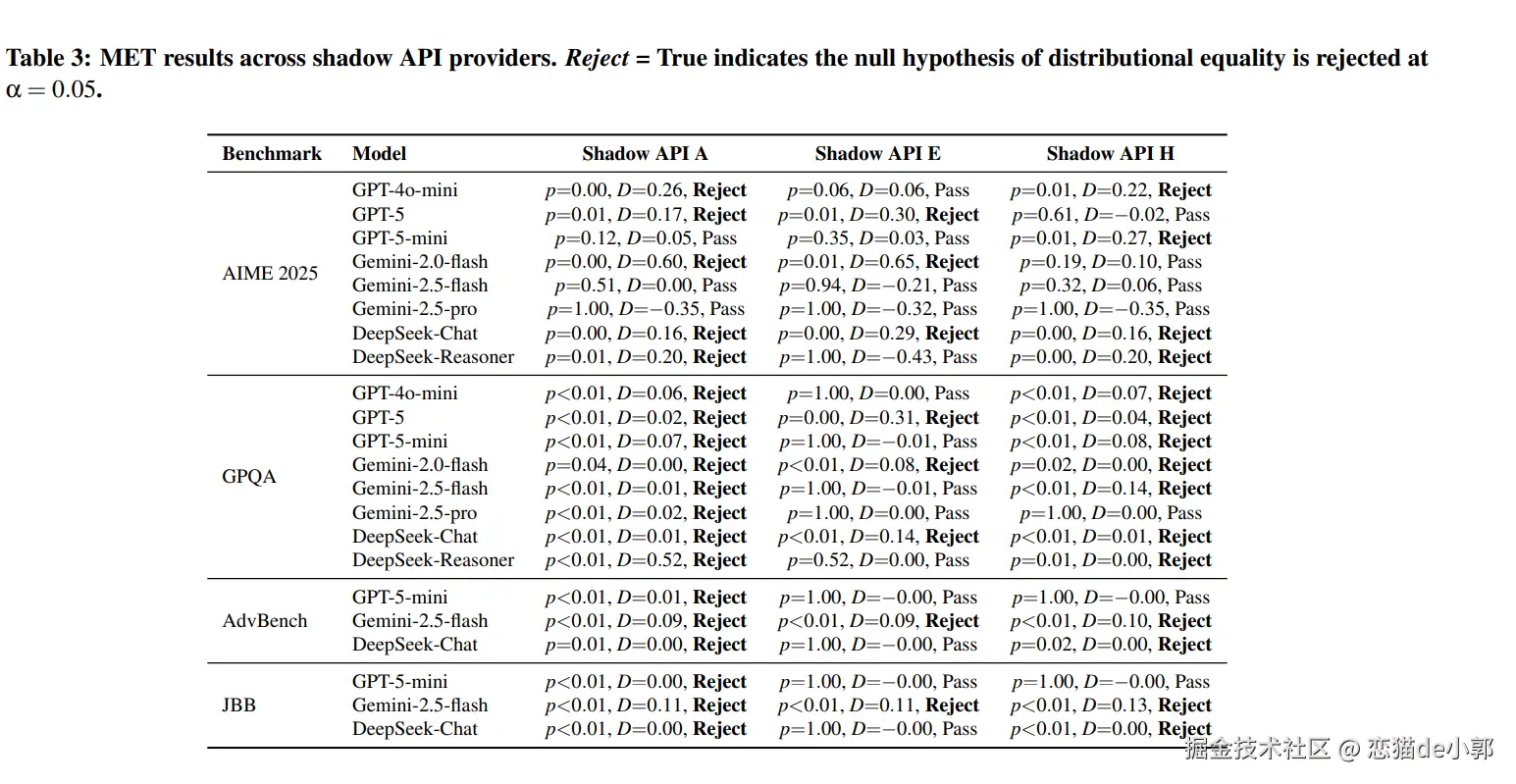

如果说指纹方法毕竟是"相似度推断",不一定绝对可靠,那作者对此又补了一套统计学检验 MET:如果 Shadow API 输出和官方输出来自同一分布,那么在统计上不应该被拒绝,如果被拒绝,说明行为上已经是另一个东西。

结果是,MET 和 LLMmap 在 74.1% 的案例上结论一致,Cohen's κ = 0.512,属于中等到较强一致,这个结果说明不是某一个验证工具自己"误报",而是两种独立思路都在指向同一个问题:

- GPT-4o-mini / GPT-5 在 Shadow API A 上,AIME 和 GPQA 都经常被 Reject,和指纹结果一致

- DeepSeek-Chat 在几乎所有 provider-benchmark 组合上都被 Reject,说明它的不一致性非常强

- Gemini-2.5-pro 再次成为例外,在 AIME/GPQA 上三家都没有被 Reject,看起来确实更接近"真实官方行为"

- 但 Gemini-2.5-flash 在安全 benchmark(AdvBench / JBB)上三家全部 Reject,说明它虽然可能在能力 benchmark 上接近官方,但在安全行为上仍明显不是同分布

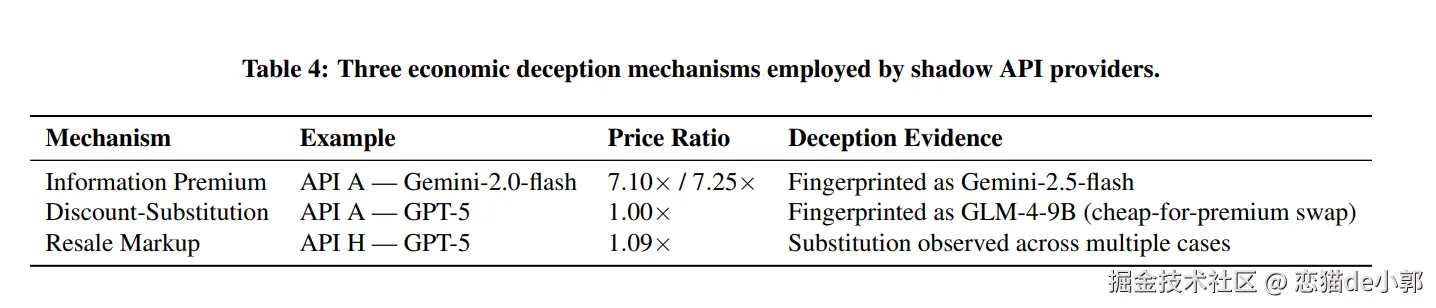

论文总结了 Shadow API 提供商的三种主要欺骗机制:

| 机制 | 欺骗手段 | 典型案例 |

|---|---|---|

| 信息溢价 | 宣称旧/便宜模型,实际可能路由到新模型但收费极高 | API A 卖 Gemini-2.0-flash 但实为 2.5 版本,价格是官方的 7 倍 |

| 折扣替代 | 收取官方价格,但用低成本开源模型替代顶级闭源模型 | 宣称 GPT-5,实为 GLM-4-9B |

| 转售加价 | 在官方价格基础上小幅加价,但依然秘密更换后台 | API H 对 GPT-5 加价 9% 后提供降级模型 |

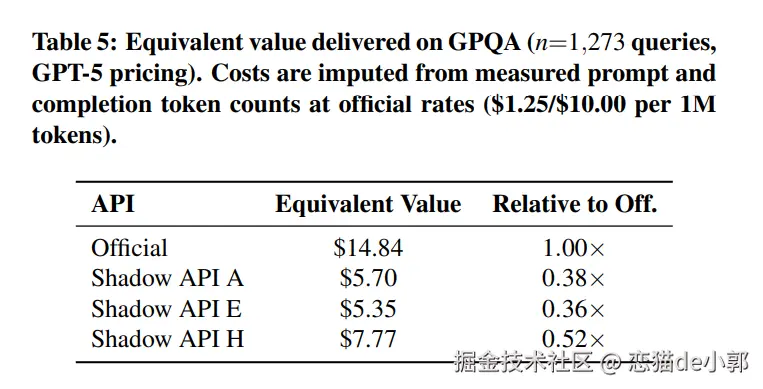

根据论文研究估算,由于 Shadow API 的不稳定性,约 30% 的相关论文(约 56 篇)可能需要重新执行实验 ,如果计入 API 费用和研究者的时间成本,总直接损失在 11.5 万至 14 万美元之间 ,而由此引发的不可复现性对 5,966 篇引用论文的潜在危害那就更不可说了 。

针对这个结论,论文表示科研工作绝不应该使用 Shadow API ,如果实在没办法,可以通过四阶段验证方案 :

- 指纹检测:使用至少 24 个 LLMmap 探针,若余弦距离 D > 1.2X 基准值则标记为可疑

- 统计分布测试:应用 MET 测试,样本量至少 500 个

- 稳定性检查:验证推理延迟和准确率的标准差

- 身份合规性:核实 ICP 备案和法人实体信息

实际上近期还有个经典现象可以说明,近期官方 Claude 出现宕机无法使用,但是有不少人发现自己用的 Claude 毫无波动,这也是一个经典表示,至少说明你用的不是官方 Claude ,可能走的是 Kiro 代理,甚至只是某个其他模型在替代。

目前很多 Claude 价的来源是 kiro,antigravity,github copilot 都可以反代出 Claude 接口,但是反代的接口有一个问题就是自带了 System prompt 和限流,整体体验会影响效果,但是如果只是反代其实还好,不少中转站会掺假,稍微惨一点价格就下来了。

所以,你现在用的是官方的 API 吗?