AI幻觉:「一本正经胡说八道」

为什么AI总爱一本正经地胡说八道?

你们有没有遇到过这种情况:问AI一个问题,它一本正经地给你讲了一堆,结果你一查,全是瞎编的?这就是AI幻觉,AI界的「一本正经胡说八道」。

为什么这玩意儿就是治不好呢?让我们来扒一扒AI的「小秘密」:

-

训练数据是个大杂烩:AI学的东西都是从网上爬的,就像一个小孩在垃圾堆里捡东西吃,啥都有,有营养的、过期的、发霉的,它可分不清好坏。

-

概率游戏玩得溜:现代AI就是个概率大师,遇到不知道的问题,它就开始「瞎蒙」,蒙得还挺像那么回事儿,你还真难分辨。

-

理解能力有待提高:人类说话多复杂啊,一句话能有八百个意思,AI有时候就像个刚学说话的孩子,听错了还自信满满地回答。

-

记性不好:聊得时间长了,AI自己说过啥都记不住,前后矛盾是常事儿,跟咱上了年纪的爷爷似的。

-

消息滞后:AI的知识库就像过期的报纸,你问它昨天发生的事儿,它可能给你扯去年的新闻。

真实案例:被AI坑到吃泡面的投资者

2024年,有股民遇到了真实的AI幻觉陷阱:某AI助手自信地推荐了一只股票,声称该公司是DeepSeek创始人梁文锋的子公司,马上要发布重磅产品,股价必定大涨。

投资者信以为真,大量买入,结果发现这完全是AI编造的虚假信息,所谓的子公司关系根本不存在,最终损失惨重。

这种AI幻觉现象在投资领域特别常见,AI会一本正经地编造公司信息、财务数据,让投资者防不胜防。

程序员的好帮手:AI在编程中的得与失

作为一名写了十年代码的「老油条」,我得说句公道话:AI在编程和bug修复上,大部分情况还是挺靠谱的:

- 代码生成效率高:普通功能的代码,AI能分分钟给你写好,质量还不错,省了我不少时间

- bug分析有一套:常见bug的根因分析,AI说得头头是道,比我自己瞎琢磨强多了

- 解决方案多样:遇到问题,AI能给你好几种解决思路,拓宽了我的思路

不过,AI偶尔也会犯迷糊,出现幻觉问题:比如编个不存在的API,或者给个逻辑有问题的代码。这时候,同时问多个AI就派上用场了------不同AI的回答一对比,你就能发现哪个在瞎扯淡,哪个是真有料。

现在用AI的小伙伴,基本都被这些问题折磨过:

- AI幻觉问题:单个AI就是个「一本正经的骗子」,你根本不知道它哪句是真哪句是假

- 信息孤岛:不同AI的回答散在各个平台,对比起来跟找对象似的,累死人

- 切换成本高:一会儿开ChatGPT,一会儿开豆包,一会儿开千问,跟个救火队员似的到处跑

- 管理混乱:对话记录东一个西一个,想找的时候跟找袜子似的,永远找不到配对的

我的解决办法

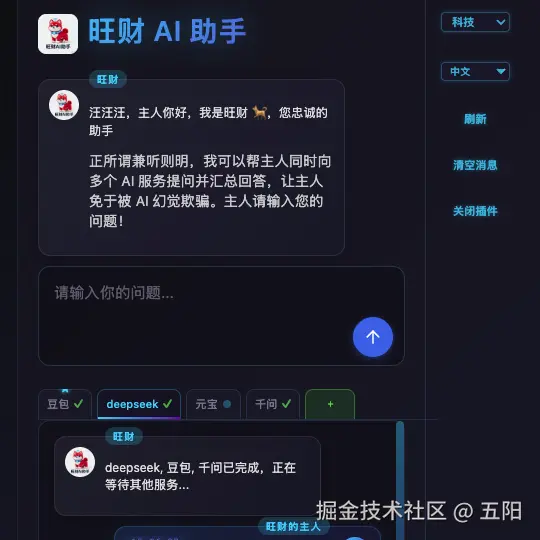

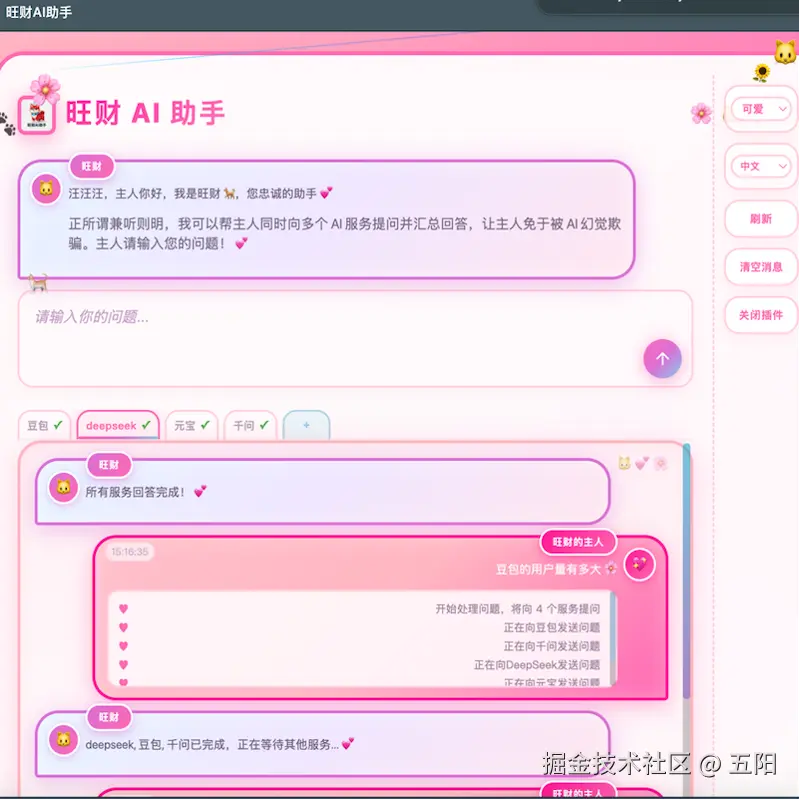

就在我被这些问题搞得要崩溃的时候,突然发现了AIChatProxy这个「救星」。这玩意儿是个Chrome扩展,能把多个AI服务聚到一起用,虽然不完美,但至少能让我少掉点头发。

核心功能:这玩意儿还挺能打

聚合主流AI服务

- 能同时问ChatGPT、豆包、千问、DeepSeek、元宝、Gemini这些「AI工具」

- 统一界面管理标签页,还能拖拽排序

- 实时查询显示状态

缺点:人无完人,AI工具也一样

- 偶尔抽风:偶尔有bug

- 界面有点简单:

- 功能有点单一:就聚合个AI服务,没什么花里胡哨的功能

- 只支持主流大模型:那些小众的AI服务根本不支持

这玩意儿能干嘛?

- 内容创作:同时问多个AI要创意,挑最好的用,就像请了一堆编剧给你写剧本

- 知识验证:多个AI交叉验证,看谁在瞎扯淡,就像找了一堆专家给你鉴定古董

- 多语言翻译:不同AI翻译水平不一样,对比着用更准,就像找了多个翻译给你翻同一篇文章

- 技术研究:看看不同AI的能力边界,了解谁最能瞎编,就像做个实验,看看哪个AI最会吹牛

- 用户规模:目前100多个小伙伴在用

AIChatProxy这玩意儿,虽然不是完美的,但至少能解决多平台切换的问题,更重要的是,通过对比多个AI的回答,总算能看出谁在瞎扯淡了。

单个AI根本靠不住,用这玩意儿至少能多个参考,不至于被坑得太惨。反正我现在是离不开它了,谁用谁知道。

官网地址:aichatproxy.com