问境AIST首发|以AI治理AI,悬镜原创多模态AIST新品发布

随着大模型(LLM)加速从技术探索走向规模化应用,企业安全体系正面临一轮全新的挑战:AI 生成代码是否可能埋藏未知缺陷甚至潜在后门?第三方引入的基础模型、开源组件和数据集,是否存在投毒、篡改或供应链风险?而在智能体(Agent)逐步参与业务执行的背景下,一次提示词注入、一次插件滥用,甚至一次越权调用,都可能引发敏感信息泄露、业务逻辑失控等安全问题。

在这样的背景下,悬镜安全正式推出问境 AIST(AI Security Testing),**基于原创多模态 AIST 技术,**直击 Agentic AI 全生命周期过程中的原生安全风险,提供覆盖 AI 模型扫描、AI 代码安全护栏、AI 智能红队渗透与 AI 供应链安全情报预警一体化能力,赋能企业从传统软件供应链安全平滑迈向 AI 原生安全治理。

子芽:以AI治理AI,从传统软件供应链安全到AI原生安全

Gartner 最新研究指出,随着生成式 AI、智能体和第三方模型能力加速进入企业生产环境,企业需要将 AI TRiSM(AI Trust, Risk and Security Management) 应用于 AI 应用,覆盖第一方与第三方攻击面,并持续推进治理、监测、验证测试与合规能力建设。这意味着,AI 原生安全正在从传统软件供应链安全体系中的新增项,快速演进为企业数字化治理体系中的技术底座。

尤其在金融、泛互联网、能源、电信运营商及大制造等行业,AI 智能体(Agent)正日益嵌入核心流程,新增的攻击面(AI模型、智能体、MCP、Skills、AI供应链生态等)正给传统安全工具(AST/SCA/RASP等)带来新挑战,主要体现在:

- 黑盒化与不可观测性: 模型决策过程的"黑盒"属性打破了传统的代码逻辑和日志审计模式,导致风险极具隐匿性。

- 交互范式的彻底变革: 随着多模态、MCP(Model Context Protocol)、Skills 及 A2A(Agent to Agent)等新模式的涌现,提示词注入与插件滥用催生了更复杂的攻击面。

- 传统防护模型的瓦解: AI 应用重构了 IT 架构,使得基于固定规则的传统检测响应模型在动态生成的 AI 逻辑面前难以为继。

- 供应链风险的指数级传递: 开源生态与智能体架构加剧了对第三方模型和组件的依赖,任何底层的细微缺陷都可能引发系统性的安全崩塌。

- 数据安全敞口的全面放大: 从训练数据到 RAG(检索增强生成)私有库,数据全链路的深度介入放大了隐私泄露的风险。

"攻以守本,唯快不破"。悬镜首创基于"AI原生安全+ DevSecOps敏捷安全+多模态SCA+AI供应链安全情报预警"技术的新一代 AI 数字供应链安全治理体系,以 AI 治理 AI,从源头治理大模型开发、训练、部署到智能体运营等关键环节面临的 AI 原生安全风险,帮助企业用户构筑一套从传统软件供应链到 AI 原生供应链全生命周期的内生安全治理体系。

核心能力:全生命周期覆盖,构建 AI 原生安全治理体系

作为业内原创专利级新一代的多模态 AIST 治理平台,问境 AIST 秉持 "安全左移" 和 "敏捷右移" 的核心理念,通过五大核心能力,为企业构建起覆盖 AI 应用全生命周期的原生安全屏障:基于 原创 多模态 AIST 技术,通过 AI 模型扫描技术、AI 代码安全护栏、AI 智能红队渗透与 AI 供应链安全情报预警实现协同工作,为企业构建端到端的 AI 安全屏障,在享受 Agentic AI 的同时,从容应对新型安全风险。

1► 穿透"数字黑盒": 让模型血缘与资产清单颗粒度可见

在 AI 应用的构建初期,最危险的风险往往源于对底层成分的"盲目信任"。传统的安全扫描通常止步于开源组件,却对Jupyter Notebook 等开发环境及其中嵌套调用的模型接口视而不见。

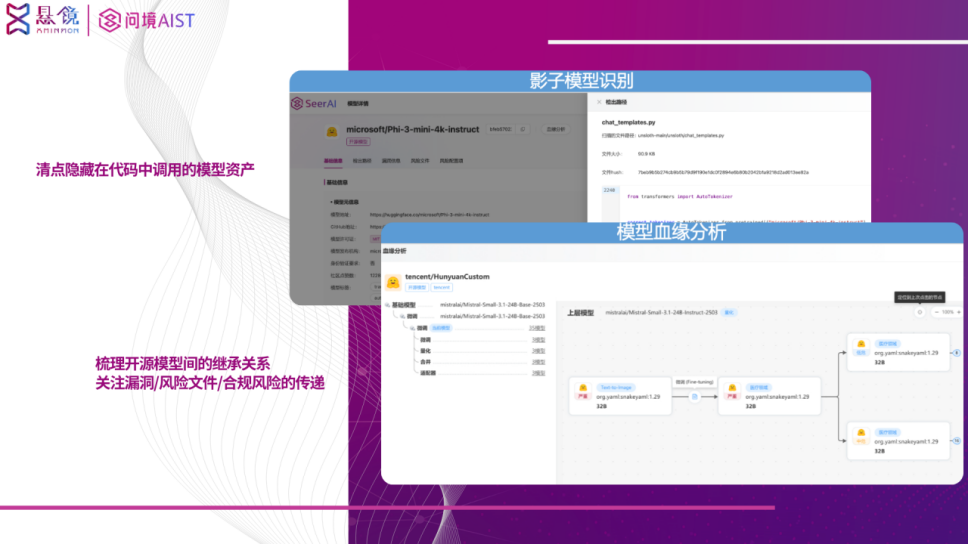

问境 AIST 引入了全要素资产指纹识别技术,如同为 AI 应用进行深度"CT扫描",不仅审计代码逻辑,更能精准捕捉隐藏在项目中的本地或远程模型调用。基于此,问境 AIST 平台构建了 AI-SBOM(AI 软件物料清单)生成与分析能力。借助模型血缘分析技术,平台可自动化梳理出开源模型间的微调、量化及继承关系。

影子模型识别&模型血缘分析

针对 PyTorch、Pickle、Transformers 等 11 种以上主流模型格式,问境 AIST 提供反序列化代码执行及风险配置的深度探测。这种深度的透明化治理,让安全官能够像审视账单一样掌控 AI 资产,使企业在面对基础模型或第三方组件爆出高危后门时,能秒级定位受影响的应用链路,实现风险的全路径追溯。

2 ► 筑牢"Vibe Coding 安全边界": 让AI代码安全护栏成为第一道防线

AI 应用的很多风险,并不是上线后才暴露,而是在代码生成、依赖引入、提交构建乃至发布过程中就已埋下。提示词拼接不当、模型调用失控、插件接入过宽、密钥硬编码、影子模型混入项目,都会随着研发流程持续传递和放大,也让开发阶段成为 AI 原生安全治理最关键的起点。

问境 AIST 面向 AI 辅助开发与 AI 数字供应链,构建覆盖代码生成、引入、提交、构建、发布等关键环节的代码安全护栏体系。依托大模型能力,并结合静态分析、软件成分分析与供应链安全检测技术,平台不仅可识别传统漏洞与敏感信息泄露,还可针对提示词注入、提示词泄漏、不安全工具调用、影子模型接入、外部 API 滥用等 AI 特有风险进行精准检测,实现对风险代码的事前识别、事中拦截与事后修复。