Qwen-VL-Narrator是阿里巴巴云Data to Intelligence Lab基于Qwen2-VL-7B模型微调的视频理解专家模型,专门用于影视剧视频片段的理解和生成细粒度描述。

一、项目背景与技术基础

Qwen-VL-Narrator建立在Qwen-VL系列多模态大模型的技术积累之上。Qwen-VL系列经历了三代技术演进:

- Qwen-VL:采用ViT-bigG视觉编码器+Qwen-7B语言模型架构,支持448×448固定分辨率输入,通过位置感知VL Adapter实现视觉-语言对齐。

- Qwen2-VL:引入动态分辨率支持(Naive Dynamic Resolution)、2D-RoPE位置编码和多模态旋转位置嵌入(M-RoPE),支持视频理解和代理任务。

- Qwen2.5-VL:重构视觉编码器,支持原生分辨率、窗口注意力机制和3D patch视频处理,全面升级长视频分析和复杂文档解析能力。

Qwen-VL-Narrator基于Qwen2-VL-7B进行微调,继承了该系列的核心技术优势。

二、核心能力与特点

1. 四大核心理解能力

- 角色理解:详细描述角色的外貌、体型、服装、动作和表情,包括种族/肤色分析

- 场景理解:详细分析环境、布景、道具和氛围

- 故事讲述:基于字幕辅助推理,客观准确地呈现视频情节和叙事

- 技术分析:分析专业影视制作技术,包括镜头语言、构图、色彩、场面调度和转场

2. 技术优势

- 小模型尺寸:基于Qwen2-VL 7B微调,可在单张H20、L20甚至5090 GPU上轻松部署

- 高质量视频描述:得益于训练样本的多样性,相比先前模型能提供更详细的视频描述

- 工作流集成:可集成到影视制作工作流中,为视频片段提供摘要信息给其他模块,实现长视频整合和结构化输出

三、应用场景

- 内容检索与索引:为大型视频档案库创建详细、可搜索的元数据,方便用户查找特定场景、角色或镜头

- 前期制作与脚本:分析原始素材,快速生成视频摘要或影视制作脚本

- 自动口述影像:为视障观众自动生成口述影像,提供无障碍内容访问

- 视频生成数据标注:为视频生成模型提供视频-文本标注数据,实现高质量视频-文本对齐,提升指令遵循能力

- 视频克隆:通过生成准确提示来"克隆"视频,支持视频生成应用

四、技术实现与使用

模型架构

Qwen-VL-Narrator采用Qwen2-VL的标准架构:

- 视觉编码器:基于Vision Transformer(ViT)架构,支持动态分辨率处理

- 语言模型:Qwen-7B作为基础语言模型

- 跨模态连接:通过位置感知的视觉语言适配器实现高效特征压缩

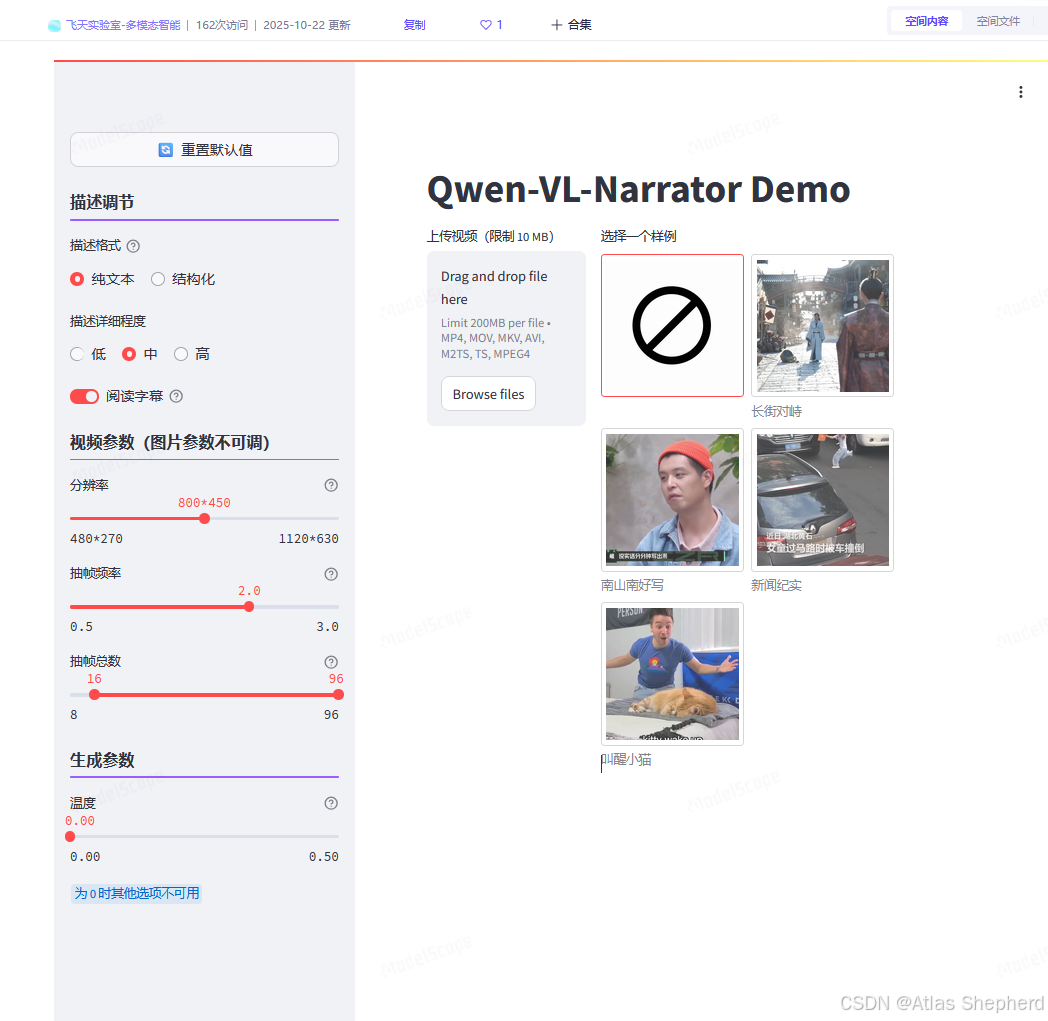

推荐视频参数

json

{

"max_pixels": 784 * 441,

"fps": 2.0,

"max_frames": 96,

"min_frames": 16

}推荐视频长度在1分钟以内。

使用方式

支持三种视频输入方式:

- 图像帧列表:提供视频帧序列

- 本地视频路径:直接处理本地视频文件

- 视频URL:处理在线视频资源

部署要求

- 支持通过vllm或sglang部署以获得更好的推理性能

- 基础依赖包括transformers>=4.45.0、accelerate、qwen-vl-utilsdecord

五、局限

- 音频处理:由于Qwen2-VL架构限制,模型无法处理或描述音频

- 视频时长:输入视频时长超过1分钟时,描述质量可能下降,建议根据工作流对视频进行分段预处理

- 准确性限制:与所有视觉-语言模型一样,由于训练数据的偏好与质量问题,模型输出可能不完全准确,可能存在幻觉

- 内容依赖性:描述质量可能随视频类型、风格和内容复杂性而有所差异