摘要 :本文面向从事数字前端综合的 IC 工程师,系统介绍如何在物理隔离的 EDA 环境中, 借助 Docker 容器化技术部署 OpenCode + Ollama 本地大模型,构建一套零数据外泄、多用户隔离、 开箱即用 的 AI 辅助综合工作站。文章分为两部分:第一部分 聚焦架构设计与环境部署; 第二部分深入业务实战,覆盖 SDC 自动生成、timing 违例诊断与团队知识共享。

一、引言:EDA 环境下的 AI "破局"困境

在数字前端综合日常工作中,工程师面临一个极端矛盾:

一边是企业对核心 RTL 资产近乎偏执的保护需求------任何一行代码都不允许上传到公网 AI 服务;

另一边 是老旧的宿主机系统(CentOS 7/8、RHEL 7)既无法升级(担心破坏经过严格验证的 EDA License 环境),又与现代 AI 开发工具存在严重的库版本冲突(典型错误:GLIBC_2.28 not found)。

面对这一困境,市面上常见的解决思路有三种:

| 方案 | 做法 | 问题 |

|---|---|---|

| 直接用 ChatGPT/Claude | 把代码贴给公网 AI | 数据安全红线,企业明令禁止 |

| 升级宿主机 | 更新系统库到新版本 | 破坏 EDA 授权环境,风险极高 |

| Docker 容器化部署 | 在容器内运行新环境 | ✅ 两全其美 |

本文将详细展开第三种方案:用 Docker 把现代 AI 工具链"套进"老旧 EDA 宿主机,同时用 Ollama 在本地跑大模型,做到数据完全不出内网。

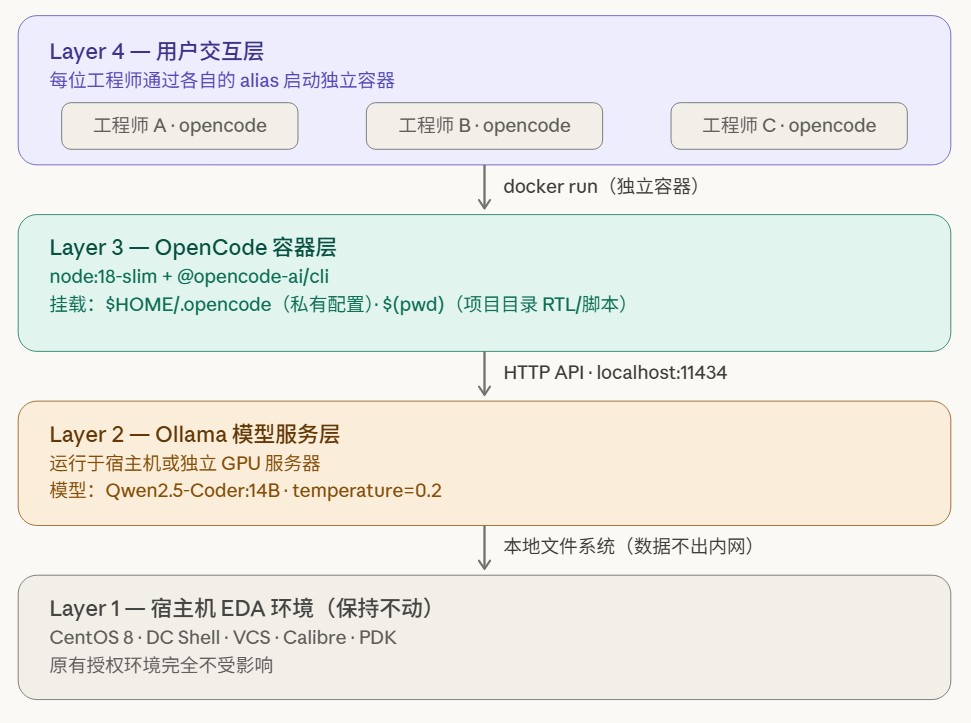

二、整体架构:四层解耦设计

在动手之前,先理解整个方案的层次结构,这有助于在出问题时快速定位:

核心设计原则:EDA 环境完全不受影响,AI 工具链运行在隔离容器中,数据通过卷挂载双向流通,模型推理留在内网。

三、基础设施部署

3.1 Ollama 模型服务(一次性配置)

Ollama 直接安装在宿主机(或团队 GPU 服务器),为所有工程师提供统一的模型推理服务。

# 安装 Ollama(宿主机执行,仅需一次)

curl -fsSL https://ollama.com/install.sh | sh

# 拉取 Qwen2.5-Coder 14B(IC 场景首选,代码能力强,中文支持好)

ollama pull qwen2.5-coder:14b

# 验证服务正常

curl http://localhost:11434/api/tags为什么选 Qwen2.5-Coder:14B?

在数字前端场景中,模型需要同时具备:TCL/SDC 语法理解、Verilog/SV 代码分析、中文注释读写能力。经过对比测试,Qwen2.5-Coder 系列在这三项上的综合表现明显优于同等参数规模的 LLaMA/Mistral 系列。14B 版本在 32GB 内存的工作站上可流畅运行,响应速度满足日常使用。

💡 显存参考:7B ≈ 8GB VRAM,14B ≈ 16GB VRAM,仅 CPU 推理也可运行但速度较慢。

提醒:实际测试中Ollama+Qwen的tools 并不适合Opencode ,导致无法调用本地命令包括文件读写,最终采用的是其他的模型。

3.2 构建 OpenCode Docker 镜像

直接在 CentOS 8 运行 OpenCode 会触发 GLIBC_2.28 not found 错误。解决方案是用 Node 18 官方镜像作为基础,在容器内构建完整的运行环境。

# Dockerfile

# 使用 Node 18 镜像,彻底绕开宿主机 GLIBC 版本限制

FROM node:18-slim

# 安装 OpenCode CLI

RUN npm install -g @opencode-ai/cli

# 设置工作目录(运行时会被 -w 参数覆盖为实际项目路径)

WORKDIR /app

# 预建配置目录,避免首次运行时的权限问题

RUN mkdir -p /root/.opencode

ENTRYPOINT ["opencode"]

# 构建镜像(建议由管理员统一构建后推送到内网 Registry)

docker build -t opencode-v1.2.22 .

# 验证镜像

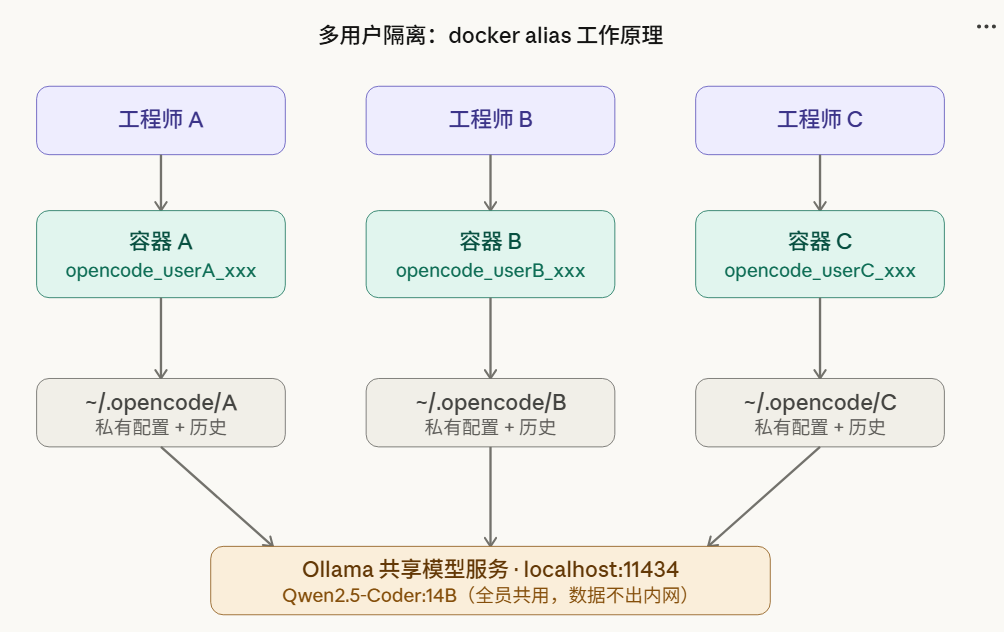

docker run --rm opencode-v1.2.22 --version3.3 多用户隔离:动态 Alias 方案

多用户服务器上最忌讳两件事:root 权限污染 和配置文件互相覆盖。

以下 alias 利用宿主机的 $HOME 和 $(whoami) 变量,为每位工程师创建完全隔离的容器实例:

# 建议由管理员写入 /etc/profile.d/opencode.sh,全员自动生效

alias opencode='docker run -it --rm \

--name opencode_$(whoami)_$(date +%s) \

--network host \

--user $(id -u):$(id -g) \

-v $HOME/.opencode:/root/.opencode \

-v $HOME/.opencode/cache:/root/.cache \

-v $(pwd):/app \

-w /app \

opencode-v1.2.22'四个关键参数逐一解析:

| 参数 | 作用 | 不加会怎样 |

|---|---|---|

--name opencode_$(whoami)_$(date +%s) |

容器名包含用户名+时间戳,避免多人同时运行时命名冲突 | docker: Error: name already in use |

--network host |

容器直接使用宿主机网络,可访问 localhost:11434 的 Ollama 服务 |

无法连接模型,延迟也更高 |

--user $(id -u):$(id -g) |

容器内进程以当前用户身份运行 | 生成的 .opencode 目录被 root 锁死,无法删改 |

-v $HOME/.opencode:/root/.opencode |

用户私有配置和对话历史持久化到宿主机家目录 | 每次启动都是全新会话,历史丢失 |

3.4 针对 IC 业务的 JSON 精细化配置

OpenCode 1.2.22 采用分层配置结构。为充分发挥 Qwen2.5-Coder 在综合场景下的能力,需要对参数进行定向调优:

{

"$schema": "https://opencode.ai/config.json",

"provider": {

"ollama": {

"npm": "@ai-sdk/openai-compatible",

"name": "Ollama-Synthesis-Server",

"options": {

"baseURL": "http://127.0.0.1:11434/v1"

},

"models": {

"qwen2.5-coder": {

"name": "qwen2.5-coder:14b",

"parameters": {

"temperature": 0.2,

"top_p": 0.95

}

}

}

}

},

"defaultModel": "qwen2.5-coder"

}提示:这里仅用Qwen做例子,实际自己选择适用的模型。

为什么把 temperature 设为 0.2?

temperature 控制模型输出的"创造性":值越高越发散,值越低越确定。在处理 SDC 语法和 RTL 逻辑时,我们需要的是高确定性的正确答案,而不是"有创意的猜测"。0.2 是 IC 代码生成场景的经验最优值------既能保持一定灵活性,又不会产生随机的语法错误。

将此 JSON 保存到 ~/.opencode/config.json,即为个人默认配置。新员工入职后直接从配置模板拷贝,无需重新配置:

cp /team/shared/opencode.json.template ~/.opencode/config.json四、排除噪音:.opencodeignore 配置

EDA 项目目录中充斥着大量对 AI 无用甚至有害的文件:.vcd 波形文件动辄 GB 级,/work 综合中间目录包含数万个临时文件。如不配置忽略规则,OpenCode 的上下文索引会因为解析这些文件而崩溃或严重变慢。

在项目根目录创建 .opencodeignore:

# 综合中间产物

/work/

/results/

*.ddc

*.syn.v

# 仿真文件(体积大,对综合分析无帮助)

/sim/

*.vcd

*.fsdb

*.vpd

*.shm/

# 临时脚本

/scripts/temp/

*.tmp

# PDK 工艺库(只读参考,不需要索引)

/pdk/

*.db

*.lef

*.tf💡 规则与

.gitignore语法完全相同,已有.gitignore的项目可以直接复用大部分规则。

五、运维避坑指南

在实际多用户生产环境中,以下两个问题出现频率最高:

问题一:启动时 Database migration 长时间卡住

通常是由于 .opencode 目录挂载在 NFS 共享盘上,NFS 的 I/O 延迟导致 SQLite 数据库初始化超时。

# 解决方案:把 .opencode 迁移到本地 SSD

mv ~/.opencode /local_ssd/$USER/.opencode

ln -s /local_ssd/$USER/.opencode ~/.opencode问题二:退出后配置文件被文件系统死锁

通过 kill -9 强制终止容器进程后,宿主机上可能残留对配置文件持有锁的 vi 进程:

# 清理残留进程

kill -9 $(jobs -p)

# 或通过 Docker 强制清理

docker rm -f $(docker ps -aq --filter "name=opencode_$(whoami)")六、小结:第一部分核心交付物

完成本文第一部分的配置后,你将拥有:

✅ Ollama 本地模型服务(Qwen2.5-Coder:14B)

✅ OpenCode Docker 镜像(绕开 GLIBC 冲突)

✅ 多用户隔离 Alias(配置/历史互不干扰)

✅ IC 业务专属 JSON 配置(低 temperature,确定性输出)

✅ .opencodeignore(索引噪音清除)参考资源

- OpenCode 官方文档:https://opencode.ai/docs

- Ollama 模型库:https://ollama.com/library

- Qwen2.5-Coder 技术报告:https://arxiv.org/abs/2409.12186

如有问题欢迎评论区交流,也欢迎关注后续的 Prompt 模板专题文章。