文章目录

-

- 开篇:当Unity遇见"世界模型"

- 架构设计:三层解耦的"数字沙盒"

- 技术选型清单

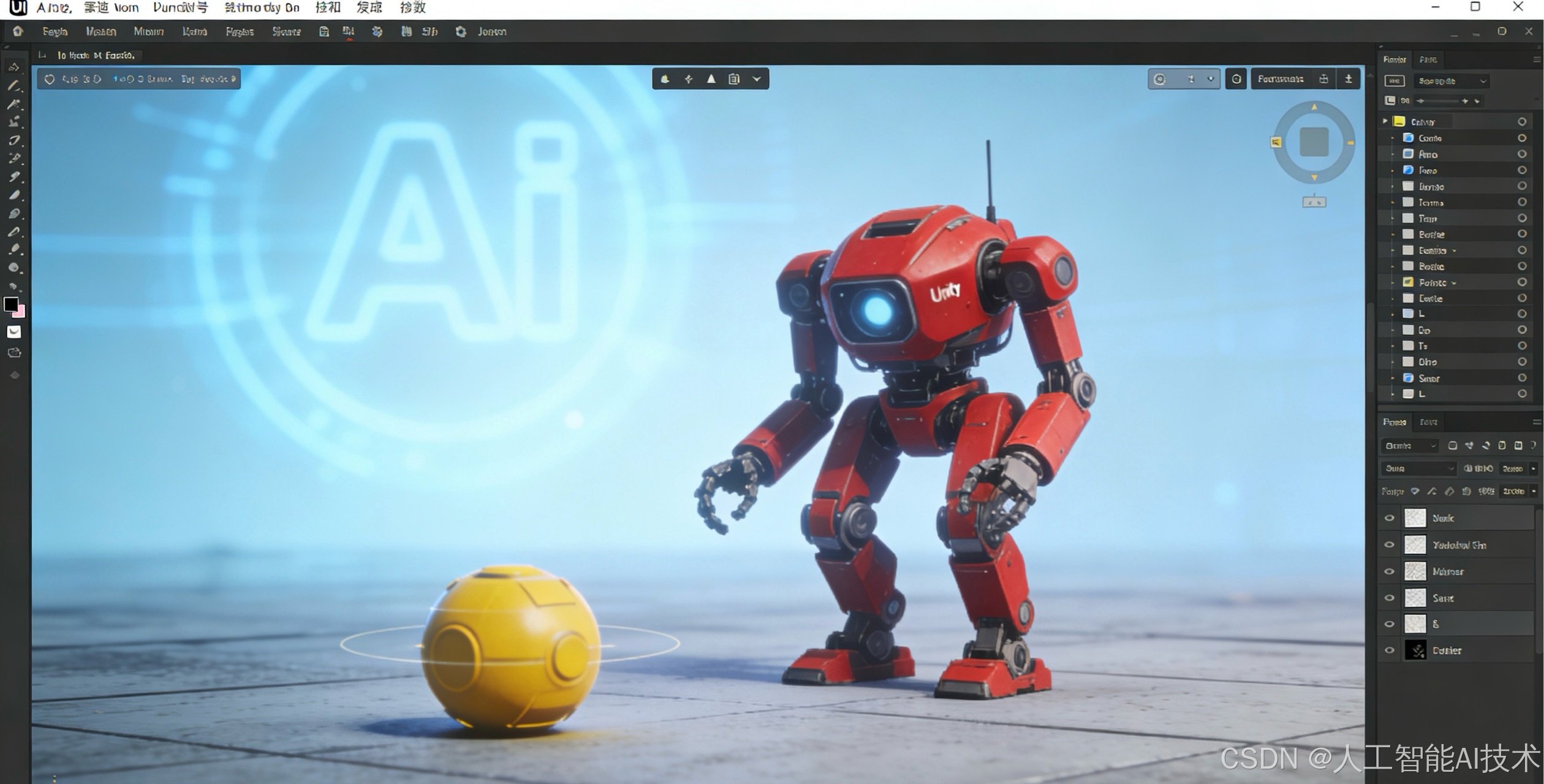

- 实战:搭建"寻物机器人"训练场景

-

- 第一步:场景搭建与摄像头配置

- [第二步:C#客户端封装OpenAI API](#客户端封装OpenAI API)

- 第三步:闭环训练循环

- 进阶玩法:混合智能体训练

- 避坑指南:过来人的血泪史

- 总结:从模拟到现实的"最后一步"

目前国内还是很缺AI人才的,希望更多人能真正加入到AI行业,共同促进行业进步,增强我国的AI竞争力。想要系统学习AI知识的朋友可以看看我精心打磨的教程 http://blog.csdn.net/jiangjunshow,教程通俗易懂,高中生都能看懂,还有各种段子风趣幽默,从深度学习基础原理到各领域实战应用都有讲解,我22年的AI积累全在里面了。注意,教程仅限真正想入门AI的朋友,否则看看零散的博文就够了。

开篇:当Unity遇见"世界模型"

想象一下,你正在Unity里搭建一个仓库机器人。传统的做法是为每条路径写死if-else逻辑:遇到障碍物就左转,看到货架就停下。这种方式就像教鹦鹉学舌------机器人只会死记硬背,换个新仓库布局就当场罢工。

2026年的新玩法是世界模型(World Model)。OpenAI的GPT-4o with Vision就像给机器人装上了"眼睛"和"大脑":它看截图、想策略、发指令,在Unity模拟器里试错学习。本文要手搓的"WorldSim"客户端,本质上是把Unity的物理引擎变成OpenAI的" gym 环境",让大模型在虚拟世界里肆意撒欢,练出一身本事再部署到实体机器人上。

这套方案的核心逻辑类似"云端大脑+本地肌肉"。Unity负责物理模拟和渲染(肌肉),OpenAI API负责高层决策(大脑),C#写的客户端就是两者之间的神经脊髓。

架构设计:三层解耦的"数字沙盒"

为什么要折腾分层?

别急着贴代码,先聊聊架构。我见过太多Unity AI项目把网络请求、业务逻辑、可视化全塞在Update()方法里,最后变成一坨 spaghetti code。

我们的"WorldSim"客户端采用三层架构:

- 感知层(Perception):负责截图、传感器数据打包

- 决策层(Cognition):封装OpenAI API调用,把图像和提示词变成动作指令

- 执行层(Actuation):在Unity里移动机器人、碰撞检测、奖励计算

这种解耦让你未来换模型(比如从GPT-4o切到Gemini)时,只需改决策层的几行代码,感知层和执行层完全无感知。

技术选型清单

| 模块 | 技术方案 | 2026年状态 |

|---|---|---|

| HTTP通信 | UnityWebRequest | Unity 2023 LTS+原生支持,比旧版WWW类更稳定 |

| 多模态输入 | Base64编码PNG + JSON序列化 | GPT-4o/4.1 Vision支持高/低两种细节模式 |

| 动作协议 | 自定义JSON Schema | 使用OpenAI Structured Outputs确保返回格式严格可控 |

| 训练框架 | Unity ML-Agents + 自定义GPT Agent | 利用ML-Agents的Gym Wrapper对接OpenAI Baselines |

实战:搭建"寻物机器人"训练场景

第一步:场景搭建与摄像头配置

先在Unity里搭个简单场景:地面是10x10的网格,随机放几个立方体当障碍物,黄色胶囊体是目标(比如"黄油"),红色球体是机器人。

关键组件是双摄像头系统:

- 俯视摄像头(God View):挂在场景上方,拍全景图给GPT看大局

- 第一人称摄像头(FPV):装在机器人面前,模拟真实机器人视角

csharp

using UnityEngine;

public class RobotAgent : MonoBehaviour

{

public Camera godViewCamera; // 上帝视角

public Camera fpvCamera; // 机器人第一视角

public Transform targetObject; // 目标物体

[Header("感知参数")]

public int captureWidth = 512; // 截图尺寸,平衡清晰度与Token成本

public int captureHeight = 512;

// 将摄像头画面转为Base64字符串,准备喂给OpenAI

public string CaptureCameraView(Camera cam)

{

RenderTexture rt = new RenderTexture(captureWidth, captureHeight, 24);

cam.targetTexture = rt;

Texture2D screenShot = new Texture2D(captureWidth, captureHeight, TextureFormat.RGB24, false);

cam.Render();

RenderTexture.active = rt;

screenShot.ReadPixels(new Rect(0, 0, captureWidth, captureHeight), 0, 0);

byte[] imageBytes = screenShot.EncodeToPNG();

string base64String = System.Convert.ToBase64String(imageBytes);

cam.targetTexture = null;

RenderTexture.active = null;

Destroy(rt);

return base64String;

}

}这里有个成本优化的门道:GPT-4o Vision按图片尺寸收费。低细节模式(low detail)把图片压缩到512x512,约等于65个Token;高细节模式(high detail)会切成多个小块分析,Token消耗可能飙到上千。训练阶段建议先用低细节模式让机器人学会大局观,精调时再开高细节模式抠像素级操作。

第二步:C#客户端封装OpenAI API

接下来封装决策层。OpenAI 2025年底发布的Responses API比传统的Chat Completions更适合Agent场景,原生支持多轮工具调用和视觉输入。

创建WorldSimClient.cs:

csharp

using System.Collections;

using System.Collections.Generic;

using UnityEngine;

using UnityEngine.Networking;

using System.Text;

[System.Serializable]

public class RobotAction

{

public string explanation; // GPT的决策解释(用于调试)

public string[] movements; // 动作序列,如 ["n","n","w"]

}

public class WorldSimClient : MonoBehaviour

{

private string apiKey = "your-openai-api-key"; // 从环境变量或配置读取

private string apiUrl = "https://api.openai.com/v1/responses";

[Header("模型配置")]

public string model = "gpt-4o-mini"; // 2025年性价比之选,视觉能力在线

public string systemPrompt = @"你是一台仓库机器人的视觉导航系统。

观察提供的摄像头图像,识别机器人(红色球体)与目标物体(黄色胶囊)的相对位置。

以网格坐标系输出移动指令:n=北(上), s=南(下), w=西(左), e=东(右)。

只能返回JSON格式:{""explanation"": ""..."" , ""movements"": [""n"",""n"",""w""]}";

public IEnumerator RequestMoveDecision(string base64Image, System.Action<RobotAction> callback)

{

// 构建多模态请求体

var payload = new

{

model = model,

input = new[]

{

new { type = "text", text = systemPrompt },

new

{

type = "image_url",

image_url = new { url = $"data:image/png;base64,{base64Image}", detail = "low" }

}

},

text = new { format = new { type = "json_object" } }, // 强制JSON输出

max_output_tokens = 256

};

string jsonPayload = JsonUtility.ToJson(payload);

using (UnityWebRequest request = new UnityWebRequest(apiUrl, "POST"))

{

byte[] bodyRaw = Encoding.UTF8.GetBytes(jsonPayload);

request.uploadHandler = new UploadHandlerRaw(bodyRaw);

request.downloadHandler = new DownloadHandlerBuffer();

request.SetRequestHeader("Authorization", "Bearer " + apiKey);

request.SetRequestHeader("Content-Type", "application/json");

yield return request.SendWebRequest();

if (request.result == UnityWebRequest.Result.Success)

{

string responseText = request.downloadHandler.text;

// 解析OpenAI Responses API的返回结构

var response = JsonUtility.FromJson<OpenAIResponse>(responseText);

string content = response.output[0].content[0].text;

RobotAction action = JsonUtility.FromJson<RobotAction>(content);

callback?.Invoke(action);

}

else

{

Debug.LogError($"API调用失败: {request.error}");

callback?.Invoke(null);

}

}

}

[System.Serializable]

private class OpenAIResponse

{

public OutputItem[] output;

}

[System.Serializable]

private class OutputItem

{

public ContentItem[] content;

}

[System.Serializable]

private class ContentItem

{

public string text;

}

}关键技巧:通过text.format.type = "json_object"启用Structured Outputs,这比传统的Prompt工程"求GPT一定给我返回JSON"靠谱得多,能100%保证返回格式合法,避免解析报错。

第三步:闭环训练循环

现在把感知层、决策层、执行层串起来。在RobotAgent.cs里补充训练逻辑:

csharp

using Unity.MLAgents;

using Unity.MLAgents.Sensors;

using Unity.MLAgents.Actuators;

public class RobotAgent : Agent

{

private WorldSimClient openAIClient;

private bool isWaitingForDecision = false;

private Vector3 startPosition;

public override void Initialize()

{

openAIClient = GetComponent<WorldSimClient>();

startPosition = transform.position;

}

public override void OnEpisodeBegin()

{

// 每轮训练重置位置

transform.position = startPosition;

transform.rotation = Quaternion.identity;

// 随机打乱障碍物和目标位置,增加泛化性

// ... 随机化代码 ...

}

public override void CollectObservations(VectorSensor sensor)

{

// 虽然我们用GPT做高层决策,但仍可把坐标作为辅助观测值

sensor.AddObservation(transform.position);

sensor.AddObservation(targetObject.position);

}

// 改为手动决策模式,而非传统的神经网络

public void RequestGPTDecision()

{

if (isWaitingForDecision) return;

isWaitingForDecision = true;

string imageData = CaptureCameraView(godViewCamera);

StartCoroutine(openAIClient.RequestMoveDecision(imageData, OnDecisionReceived));

}

private void OnDecisionReceived(RobotAction action)

{

isWaitingForDecision = false;

if (action?.movements != null)

{

Debug.Log($"GPT决策理由: {action.explanation}");

StartCoroutine(ExecuteMovements(action.movements));

}

}

private IEnumerator ExecuteMovements(string[] moves)

{

foreach (var move in moves)

{

Vector3 direction = move switch

{

"n" => Vector3.forward,

"s" => Vector3.back,

"w" => Vector3.left,

"e" => Vector3.right,

_ => Vector3.zero

};

// 移动一格

Vector3 targetPos = transform.position + direction;

float elapsed = 0;

while (elapsed < 1f)

{

transform.position = Vector3.Lerp(transform.position, targetPos, elapsed);

elapsed += Time.deltaTime;

yield return null;

}

// 检查碰撞或到达目标

CheckReward();

}

// 动作执行完后请求下一步决策

RequestGPTDecision();

}

private void CheckReward()

{

float distanceToTarget = Vector3.Distance(transform.position, targetObject.position);

if (distanceToTarget < 1.5f)

{

SetReward(1.0f); // 找到目标,奖励

EndEpisode();

}

else if (IsCollidingWithObstacle())

{

SetReward(-0.5f); // 撞墙,惩罚

EndEpisode();

}

else

{

AddReward(-0.01f); // 每步轻微惩罚,鼓励效率

}

}

}进阶玩法:混合智能体训练

纯GPT驱动决策虽然智能,但Token成本感人(每步都要调API)。2025年的主流做法是"大小脑混合架构":

- GPT-4o当"大脑":负责场景理解、路径规划,每10步调用一次

- 本地ML-Agents神经网络当"小脑":负责实时避障、平滑移动,每帧运行

这种分层让高频控制留在本地(零延迟、零API成本),低频策略上云(强推理能力)。

实现也很简单:用GPT生成子目标(比如"先去A点,再去B点"),ML-Agents负责执行子目标的具体移动。两者通过共享Vector3 targetPosition变量通信。

避坑指南:过来人的血泪史

Token成本爆炸问题

一开始我就踩过坑:随手拍1920x1080的高清图喂给GPT,结果一天的调试就把免费额度烧光。记住这个公式:低细节模式下,图片Token数 ≈ (宽度/512) × (高度/512) × 85。训练时请务必压缩图片到512x512以下。

幻觉与位置误判

GPT-4o Vision对深度估计和精确坐标的判断经常抽风。你可能看到它信誓旦旦地说"机器人在货架左侧",实际上机器人在右侧。缓解方案:

- 在图像上叠加坐标网格线(画个5x5的透明网格再截图),给GPT提供参考系

- 低细节模式下,避免场景过于杂乱,物体间保持足够间距

API延迟与实时性

GPT-4o的平均响应延迟约500ms-2s,这决定了你的机器人最快只能每半秒决策一次。如果需要毫秒级反应(比如避障),必须结合本地传感器,不能用纯云端方案。

总结:从模拟到现实的"最后一步"

这套C# WorldSim客户端的真正价值在于"Sim-to-Real Transfer"(从模拟到现实迁移)。在Unity里,你可以让GPT驱动的机器人一晚上狂练10万次寻物任务,把各种奇葩场景(灯光昏暗、障碍物随机、甚至模拟摄像头噪点)都经历一遍。

练好的策略(Policy)可以固化下来:如果你发现GPT在某种场景下总是输出"先往北三步",你可以把这些成功案例做成数据集,蒸馏训练一个本地的小模型(比如用Unity Sentis跑ONNX模型),最终部署到实体机器人上时就不需要联网调API了。

2026年的机器人开发范式正在转向这种"云端练脑、本地执行"的混合架构。Unity + OpenAI的组合让个人开发者也能搭建以前只有Boston Dynamics才玩得起的训练流水线。下一步,你可以尝试加入语音指令(用OpenAI Realtime API),让机器人听懂"去厨房拿瓶水"这种自然语言------那又是另一个故事了。

关键引用:本文技术方案基于OpenAI 2025年Responses API文档、Unity ML-Agents Gym Wrapper实现、以及Andrew Mayne的GPT-4 Vision机器人模拟器实践。代码示例遵循MIT协议,可直接用于商业项目。

目前国内还是很缺AI人才的,希望更多人能真正加入到AI行业,共同促进行业进步,增强我国的AI竞争力。想要系统学习AI知识的朋友可以看看我精心打磨的教程 http://blog.csdn.net/jiangjunshow,教程通俗易懂,高中生都能看懂,还有各种段子风趣幽默,从深度学习基础原理到各领域实战应用都有讲解,我22年的AI积累全在里面了。注意,教程仅限真正想入门AI的朋友,否则看看零散的博文就够了。