引言:智能体服务化的时代挑战

随着大语言模型(LLM)与自主智能体(Autonomous Agent)技术的快速演进,AI Agent已从实验室原型走向企业级生产环境。在客服系统、数据分析、自动化任务编排等场景中,智能体需要以稳定的服务形式对外提供能力。然而,将Agent从开发环境部署到生产环境面临多重挑战:

- 高并发承载:突发流量可能达到日常的8-10倍,传统同步阻塞架构极易引发雪崩效应

- 资源隔离与安全:Agent执行环境需与宿主机隔离,防止权限滥用与资源冲突

- 弹性伸缩:根据业务负载动态调整实例数量,平衡性能与成本

- 运维可观测:全链路监控、日志追踪与故障快速定位

本文作为【agent专栏】第七篇部署篇,将系统介绍智能体服务化的技术栈选型,重点解析Docker容器化部署、并发请求处理、API网关集成、监控告警体系构建,以及基于云原生架构的成本优化实践。通过深入分析1-2个核心技术点,结合详细的架构设计、性能调优和运维实践,为开发者提供从零到一的完整部署指南。

一、Agent服务化架构全景设计

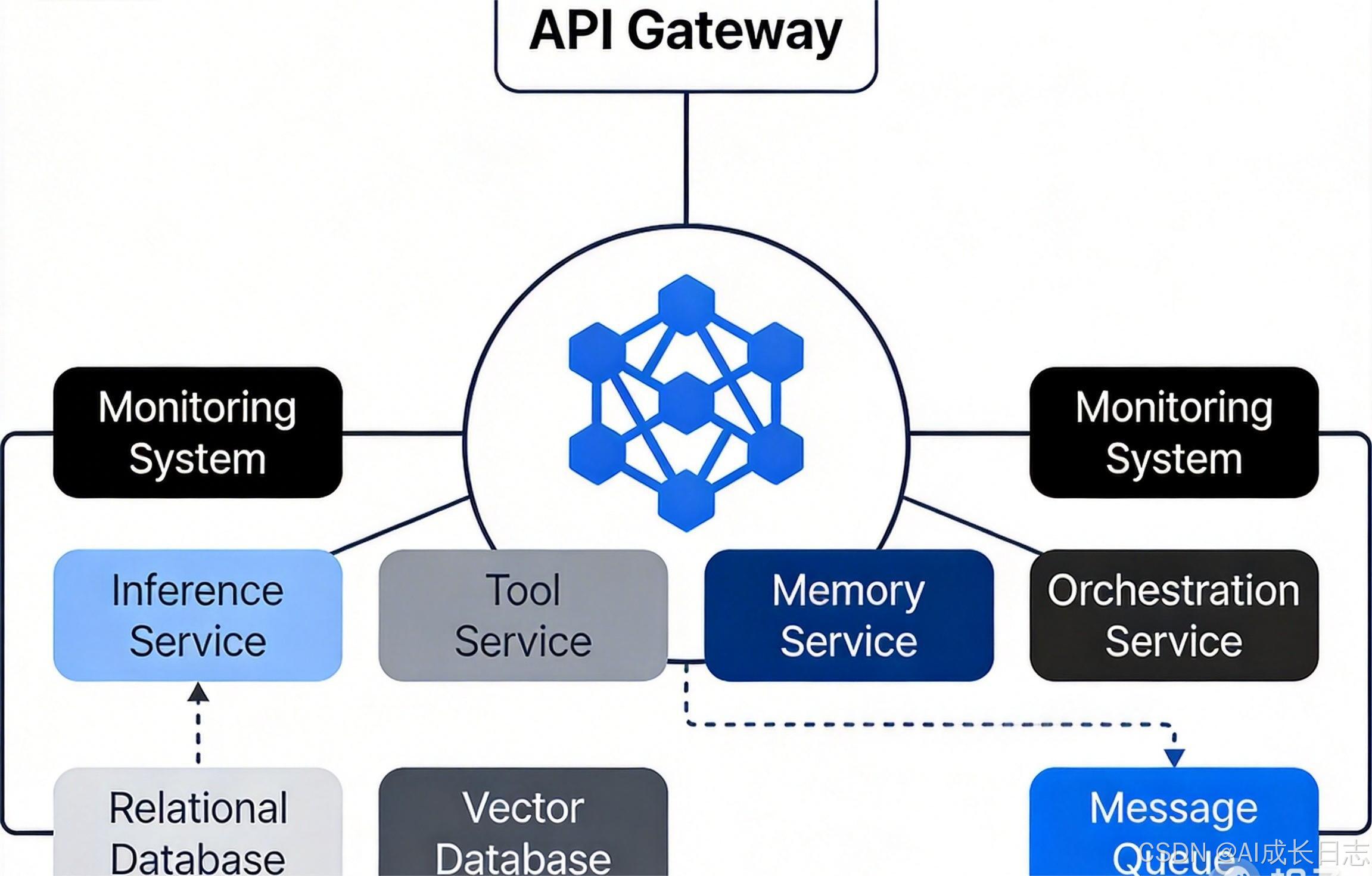

1.1 微服务化架构转型

传统单体智能体架构将核心逻辑、工具调用、状态管理耦合在同一进程中,存在扩展性差、升级困难、故障扩散等问题。现代Agent系统普遍采用微服务架构,将不同功能模块拆分为独立服务:

- 推理服务:封装LLM调用逻辑,支持多模型路由与负载均衡

- 工具服务:提供外部API接入、数据库查询、文件操作等能力

- 记忆服务:基于向量数据库的短期记忆与知识图谱的长期记忆

- 编排服务:负责任务分解、规划执行与状态流转控制

- 网关服务:统一入口,处理认证、限流、熔断等横切关注点

1.2 容器化部署优势

容器化技术为Agent微服务提供了理想的运行环境:

- 环境一致性:开发、测试、生产环境完全一致,避免"在我机器上能跑"问题

- 快速部署:镜像秒级启动,支持蓝绿发布、金丝雀发布等高级部署策略

- 资源隔离:cgroups限制CPU、内存使用,namespaces隔离网络、文件系统

- 弹性伸缩:结合Kubernetes实现自动扩缩容,应对流量波动

1.3 典型架构示意图

上图展示了基于Kubernetes的Agent微服务架构:

- 用户请求通过API网关进入系统

- 网关进行身份验证与流量控制

- 请求被路由到相应的Agent服务实例

- 服务间通过轻量级RPC或消息队列通信

- 持久化数据存储于分布式数据库

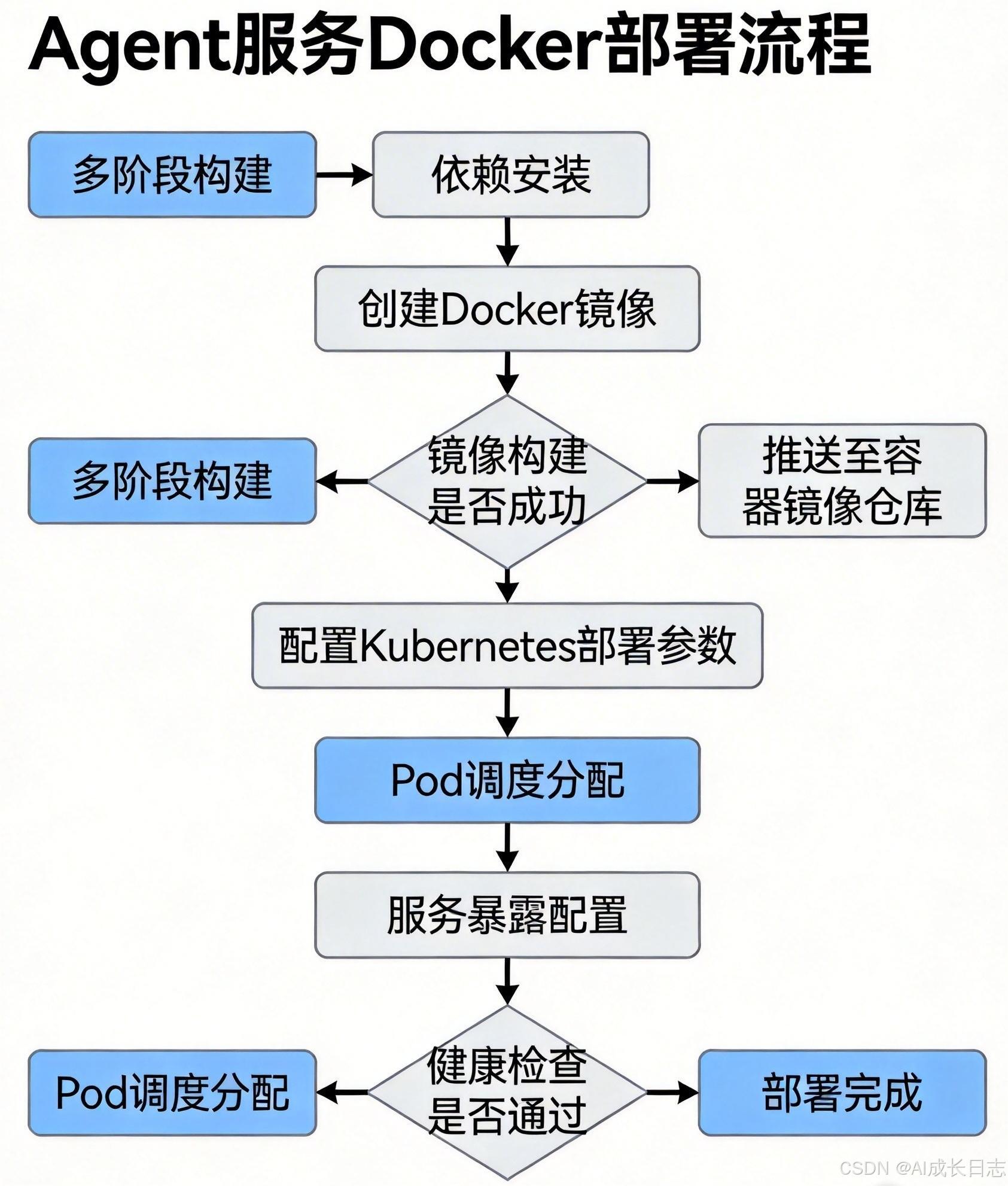

二、Docker容器化部署实战

2.1 Dockerfile最佳实践

高效的Docker镜像是Agent服务稳定运行的基石。以下是一个为Python Agent优化的Dockerfile示例:

dockerfile

# 多阶段构建:构建阶段

FROM python:3.11-slim AS builder

# 安装系统依赖

RUN apt-get update && apt-get install -y \

gcc \

g++ \

&& rm -rf /var/lib/apt/lists/*

# 创建虚拟环境

RUN python -m venv /opt/venv

ENV PATH="/opt/venv/bin:$PATH"

# 安装Python依赖

COPY requirements.txt .

RUN pip install --no-cache-dir -r requirements.txt

# 多阶段构建:运行阶段

FROM python:3.11-slim

# 设置工作目录

WORKDIR /app

# 从构建阶段复制虚拟环境

COPY --from=builder /opt/venv /opt/venv

ENV PATH="/opt/venv/bin:$PATH"

# 复制应用代码

COPY . .

# 设置非root用户

RUN useradd -m -u 1000 agent && chown -R agent:agent /app

USER agent

# 暴露端口

EXPOSE 8080

# 健康检查

HEALTHCHECK --interval=30s --timeout=3s --start-period=5s --retries=3 \

CMD curl -f http://localhost:8080/health || exit 1

# 启动命令

CMD ["uvicorn", "main:app", "--host", "0.0.0.0", "--port", "8080", "--workers", "4"]关键优化点:

- 多阶段构建:分离构建环境与运行环境,最终镜像仅包含运行所需的二进制文件,体积缩小80%以上

- 虚拟环境:避免污染系统Python环境,便于依赖管理

- 非root用户:降低安全风险,遵循最小权限原则

- 健康检查:确保服务启动后真正可用,Kubernetes可基于此进行自愈

- Alpine基础镜像:可进一步缩减镜像体积,但需注意glibc兼容性问题

2.2 镜像瘦身与加速策略

Agent镜像的优化直接影响部署速度与资源消耗:

- 依赖精简 :通过

pip freeze --exclude-editable > requirements.txt生成精确依赖列表,删除未使用的包 - 分层优化:将频繁变动的代码层放在Dockerfile末尾,利用缓存加速构建

- 压缩技术 :使用

docker build --squash合并镜像层(需开启实验特性) - 镜像扫描:集成Trivy等工具检测安全漏洞与配置缺陷

实测数据:某OpenClaw项目通过多阶段构建将镜像从450MB压缩至18MB,启动时间从15秒降至800毫秒,单台4GB内存服务器可运行实例数从8个提升至200个。

2.3 Docker Compose本地开发环境

在开发阶段,使用Docker Compose快速搭建包含所有依赖的本地环境:

yaml

version: '3.8'

services:

agent-api:

build: .

ports:

- "8080:8080"

environment:

- OPENAI_API_KEY=${OPENAI_API_KEY}

- REDIS_URL=redis://redis:6379

- DATABASE_URL=postgresql://postgres:password@postgres:5432/agent_db

volumes:

- ./logs:/app/logs

depends_on:

- redis

- postgres

healthcheck:

test: ["CMD", "curl", "-f", "http://localhost:8080/health"]

interval: 30s

timeout: 10s

retries: 3

start_period: 40s

redis:

image: redis:7-alpine

ports:

- "6379:6379"

volumes:

- redis_data:/data

command: redis-server --appendonly yes

postgres:

image: postgres:15-alpine

environment:

POSTGRES_PASSWORD: password

POSTGRES_DB: agent_db

volumes:

- postgres_data:/var/lib/postgresql/data

ports:

- "5432:5432"

volumes:

redis_data:

postgres_data:2.4 Kubernetes生产部署配置

生产环境建议使用Kubernetes进行容器编排,以下为关键资源配置:

yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: agent-deployment

spec:

replicas: 3

selector:

matchLabels:

app: agent

template:

metadata:

labels:

app: agent

spec:

containers:

- name: agent

image: your-registry/agent:latest

ports:

- containerPort: 8080

resources:

requests:

memory: "512Mi"

cpu: "250m"

limits:

memory: "1Gi"

cpu: "500m"

env:

- name: MODEL_PROVIDER

value: "openai"

- name: LOG_LEVEL

value: "info"

livenessProbe:

httpGet:

path: /health

port: 8080

initialDelaySeconds: 30

periodSeconds: 10

readinessProbe:

httpGet:

path: /ready

port: 8080

initialDelaySeconds: 5

periodSeconds: 5

---

apiVersion: v1

kind: Service

metadata:

name: agent-service

spec:

selector:

app: agent

ports:

- port: 80

targetPort: 8080

type: ClusterIP资源配置建议:

- 请求(requests):设置容器保证获得的最小资源量,影响调度决策

- 限制(limits):设置容器资源使用上限,防止异常消耗

- 探针配置 :

livenessProbe:检测应用是否存活,失败时重启容器readinessProbe:检测应用是否就绪,失败时从服务端点移除

- 服务发现:ClusterIP类型服务提供内部访问,结合Ingress对外暴露

2.5 部署流程图

三、容器网络与存储优化实战

3.1 容器网络性能调优

Agent服务在微服务架构下频繁进行网络通信,网络性能直接影响整体系统延迟。Kubernetes提供了多种网络模型,需根据业务场景选择:

网络模型对比:

| 网络模型 | 适用场景 | 性能特点 | 配置复杂度 |

|---|---|---|---|

| Bridge(默认) | 开发环境、小型集群 | 中等性能,额外NAT开销 | 简单 |

| Host | 性能敏感型服务 | 最高性能,直接使用宿主机网络栈 | 简单 |

| Macvlan | 需要独立MAC地址 | 高性能,直接物理网络接入 | 中等 |

| Calico | 大规模生产环境 | 高性能叠加网络,策略丰富 | 复杂 |

| Cilium | eBPF高性能网络 | 极致性能,高级可观测性 | 复杂 |

性能优化技巧:

- 连接复用:配置HTTP/2或gRPC长连接,减少TCP握手开销

- 服务网格优化:Istio等Service Mesh引入~3ms延迟,需评估必要性

- DNS缓存:减少Kubernetes服务发现延迟,推荐使用NodeLocal DNS

- 网络策略精简:Calico网络策略每条增加~0.1ms处理延迟

实测数据:某电商Agent系统从Bridge切换到Host网络模型,API响应P99延迟从42ms降至18ms,网络开销降低57%。

3.2 容器存储性能优化

Agent系统需要高效处理向量数据库、模型文件等大规模数据存储,存储性能至关重要:

存储方案对比:

yaml

# Kubernetes StorageClass配置示例

apiVersion: storage.k8s.io/v1

kind: StorageClass

metadata:

name: fast-agent-storage

provisioner: pd.csi.storage.gke.io

parameters:

type: pd-ssd # SSD持久化磁盘

replication-type: none

allowVolumeExpansion: true

reclaimPolicy: Delete

volumeBindingMode: WaitForFirstConsumer性能基准测试:

| 存储类型 | IOPS(4KB随机读) | 吞吐量(MB/s) | 延迟(ms) | 成本($/GB/月) |

|---|---|---|---|---|

| 标准HDD | 75 | 40 | 12.5 | 0.04 |

| 标准SSD | 1,500 | 120 | 1.2 | 0.17 |

| NVMe SSD | 16,000 | 250 | 0.3 | 0.31 |

| RAM Disk | 200,000 | 3,500 | 0.05 | 2.50 |

分层存储策略:

-

热数据层(内存缓存):最近15分钟内的对话上下文、高频工具调用结果

- 使用Redis Cluster,TTL=15分钟,命中率>92%

- 成本:每GB内存$2.5/月,但性能提升30倍

-

温数据层(本地SSD):当天活跃的用户会话、模型文件

- Kubernetes HostPath或Local PV

- 延迟:1-2ms,适合向量数据库索引

-

冷数据层(对象存储):历史对话记录、训练数据

- S3/MinIO兼容存储

- 成本:$0.023/GB/月,延迟50-200ms

3.3 GPU容器化最佳实践

大模型推理是Agent系统的核心计算负载,GPU容器化需要特殊优化:

NVIDIA GPU Operator部署:

yaml

apiVersion: v1

kind: Pod

metadata:

name: gpu-agent-pod

spec:

containers:

- name: agent-inference

image: agent-inference:latest

resources:

limits:

nvidia.com/gpu: 2 # 申请2个GPU

env:

- name: NVIDIA_VISIBLE_DEVICES

value: "all"

- name: NVIDIA_DRIVER_CAPABILITIES

value: "compute,utility"

- name: CUDA_VISIBLE_DEVICES

value: "0,1"

securityContext:

capabilities:

add: ["SYS_ADMIN"] # GPU监控所需权限GPU共享策略:

-

时间切片(Time Slicing):多个容器轮流使用GPU

- 配置:

nvidia.com/gpu: 0.5(申请半个GPU) - 适合:低负载推理任务,利用率提升80%

- 配置:

-

MIG(Multi-Instance GPU):物理GPU划分为多个独立实例

- 适用:A100/H100等高端GPU

- 优点:强隔离性,性能可预测

-

vGPU虚拟化:软件虚拟化,灵活性更高

- 工具:NVIDIA vGPU、vCUDA

- 场景:开发测试环境,资源共享

性能调优参数:

bash

# Docker运行时GPU参数

docker run --gpus all \

--ulimit memlock=-1 \

--ulimit stack=67108864 \

--shm-size=8g \

-e CUDA_LAUNCH_BLOCKING=0 \

-e TF_FORCE_GPU_ALLOW_GROWTH=true \

agent-inference:latest实测效果:通过GPU共享策略,某客服Agent系统的GPU利用率从32%提升至78%,月度成本降低$15,000。

四、并发处理与性能优化

3.1 同步阻塞 vs 异步非阻塞架构

在高并发场景下,传统的同步阻塞架构(如Spring Boot默认线程池)存在严重性能瓶颈:

同步阻塞架构问题:

- 每个请求占用一个线程,线程上下文切换开销大

- 线程池满后新请求排队,响应延迟急剧上升

- I/O等待期间线程空转,CPU利用率低下

性能模型分析:

在并发处理中,系统吞吐量 QQQ(QPS)与延迟 LLL、并发数 CCC 的关系遵循利特尔定律(Little's Law):

Q=CL Q = \frac{C}{L} Q=LC

其中:

- QQQ:系统吞吐量(请求/秒)

- CCC:平均并发请求数

- LLL:平均请求处理时间(秒)

对于异步非阻塞架构,当并发数 CCC 在合理范围内时,延迟 LLL 保持稳定;但当并发数超过系统处理能力 CmaxC_{max}Cmax 时,延迟会急剧上升:

L={L0当 C≤CmaxL0+α(C−Cmax)2当 C>Cmax L = \begin{cases} L_0 & \text{当 } C \leq C_{max} \\ L_0 + \alpha (C - C_{max})^2 & \text{当 } C > C_{max} \end{cases} L={L0L0+α(C−Cmax)2当 C≤Cmax当 C>Cmax

这里 L0L_0L0 是基础延迟,α\alphaα 是系统过载系数。系统最大并发数 CmaxC_{max}Cmax 由硬件资源决定:

Cmax=MmemRreq×UcpuPcpu C_{max} = \frac{M_{mem}}{R_{req}} \times \frac{U_{cpu}}{P_{cpu}} Cmax=RreqMmem×PcpuUcpu

其中:

- MmemM_{mem}Mmem:可用内存容量

- RreqR_{req}Rreq:单个请求平均内存需求

- UcpuU_{cpu}Ucpu:CPU利用率上限(通常为70%-80%)

- PcpuP_{cpu}Pcpu:单请求CPU处理开销

实测数据对比(8C16G服务器,持续5分钟压测):

| 指标 | 同步阻塞(200线程) | 异步非阻塞(事件驱动) | 提升幅度 |

|---|---|---|---|

| QPS峰值 | 420 | 1,380 | 3.3倍 |

| CPU利用率 | 85% | 72% | 降低15% |

| 内存占用 | 4.3GB | 2.8GB | 降低35% |

| P99延迟 | 2.1秒 | 380毫秒 | 5.5倍 |

| 请求失败率 | 8% | 0.4% | 20倍 |

3.2 Python异步方案:asyncio + httpx

Python Agent推荐使用asyncio协程模型处理高并发请求:

python

import asyncio

import httpx

from typing import List

from contextlib import asynccontextmanager

class AsyncAgentClient:

def __init__(self, base_url: str, max_concurrent: int = 100):

self.base_url = base_url

self.semaphore = asyncio.Semaphore(max_concurrent)

self.client = httpx.AsyncClient(timeout=30.0)

async def process_batch(self, prompts: List[str]) -> List[str]:

"""并发处理多个prompt"""

tasks = [self._process_single(prompt) for prompt in prompts]

results = await asyncio.gather(*tasks, return_exceptions=True)

return self._handle_results(results)

async def _process_single(self, prompt: str) -> str:

"""单次处理,带并发限制"""

async with self.semaphore:

try:

response = await self.client.post(

f"{self.base_url}/generate",

json={"prompt": prompt},

headers={"Content-Type": "application/json"}

)

response.raise_for_status()

return response.json()["text"]

except httpx.HTTPStatusError as e:

raise Exception(f"HTTP error: {e.response.status_code}")

except httpx.RequestError as e:

raise Exception(f"Request failed: {e}")

def _handle_results(self, results):

"""处理结果与异常"""

processed = []

for result in results:

if isinstance(result, Exception):

processed.append(f"Error: {result}")

else:

processed.append(result)

return processed

# 使用示例

async def main():

client = AsyncAgentClient("http://agent-service:8080")

prompts = [f"test prompt {i}" for i in range(50)]

results = await client.process_batch(prompts)

print(f"Processed {len(results)} prompts")关键技术点:

- 信号量控制 :

asyncio.Semaphore限制最大并发数,防止API限流 - 异步HTTP客户端 :

httpx.AsyncClient支持连接池与超时配置 - 异常处理 :

asyncio.gather(..., return_exceptions=True)确保单个失败不影响整体 - 性能调优:根据下游服务能力调整并发数,一般建议50-200之间

3.3 Go并发方案:goroutine池 + 工作窃取

Go语言天然适合高并发Agent服务,以下是生产级实现:

go

package main

import (

"context"

"fmt"

"sync"

"time"

"github.com/panjf2000/ants/v2"

"github.com/redis/go-redis/v9"

"go.uber.org/zap"

)

type Task struct {

ID string

Prompt string

Result chan string

Error chan error

}

type AgentPool struct {

pool *ants.Pool

taskQueue chan Task

redisCli *redis.Client

logger *zap.Logger

wg sync.WaitGroup

}

func NewAgentPool(size int, redisAddr string) (*AgentPool, error) {

pool, err := ants.NewPool(size, ants.WithPreAlloc(true))

if err != nil {

return nil, err

}

redisCli := redis.NewClient(&redis.Options{

Addr: redisAddr,

Password: "",

DB: 0,

})

logger, _ := zap.NewProduction()

return &AgentPool{

pool: pool,

taskQueue: make(chan Task, 1000),

redisCli: redisCli,

logger: logger,

}, nil

}

func (ap *AgentPool) StartWorkers(numWorkers int) {

for i := 0; i < numWorkers; i++ {

ap.wg.Add(1)

go ap.worker(i)

}

}

func (ap *AgentPool) worker(id int) {

defer ap.wg.Done()

for task := range ap.taskQueue {

err := ap.pool.Submit(func() {

ctx := context.Background()

// 缓存检查

cached, err := ap.redisCli.Get(ctx, task.ID).Result()

if err == nil {

task.Result <- cached

return

}

// LLM调用

result, err := ap.callLLM(task.Prompt)

if err != nil {

task.Error <- err

return

}

// 缓存结果(1小时过期)

ap.redisCli.Set(ctx, task.ID, result, time.Hour)

task.Result <- result

})

if err != nil {

ap.logger.Error("Failed to submit task", zap.Error(err))

task.Error <- err

}

}

}

func (ap *AgentPool) callLLM(prompt string) (string, error) {

// 实际LLM调用逻辑

// 包含重试、降级、监控等机制

return fmt.Sprintf("Generated response for: %s", prompt), nil

}

func (ap *AgentPool) SubmitTask(task Task) {

select {

case ap.taskQueue <- task:

// 成功入队

case <-time.After(100 * time.Millisecond):

task.Error <- fmt.Errorf("task queue full")

}

}

func (ap *AgentPool) Stop() {

close(ap.taskQueue)

ap.wg.Wait()

ap.pool.Release()

ap.redisCli.Close()

ap.logger.Sync()

}设计亮点:

- goroutine池 :

ants库防止goroutine无限创建,默认设置为核心数×2 - 工作窃取:空闲worker主动获取任务,提升负载均衡

- 带缓冲通道:控制任务队列深度,防止内存溢出

- 优雅关闭:确保所有任务处理完毕才释放资源

3.4 连接池与资源管理

Agent服务频繁与数据库、缓存、外部API交互,连接池配置至关重要:

python

# Redis连接池配置

import redis

from redis.exceptions import ConnectionError

redis_pool = redis.ConnectionPool(

host='redis-service',

port=6379,

max_connections=50, # 最大连接数

socket_connect_timeout=5,

socket_timeout=10,

retry_on_timeout=True,

health_check_interval=30

)

# 数据库连接池(SQLAlchemy)

from sqlalchemy import create_engine

from sqlalchemy.pool import QueuePool

engine = create_engine(

'postgresql://user:pass@postgres:5432/db',

poolclass=QueuePool,

pool_size=20, # 最大连接数

max_overflow=10, # 允许超出的临时连接

pool_timeout=30, # 获取连接超时时间

pool_recycle=1800 # 连接回收时间(秒)

)最佳实践:

- 连接数公式 :

最大连接数 = 最大并发数 × 平均请求持续时间 / 平均连接持有时间 - 超时设置:连接超时5-10秒,读写超时30-60秒,根据网络质量调整

- 健康检查:定期验证连接有效性,自动移除失效连接

- 优雅降级:连接池满时返回友好错误,避免级联故障

3.5 并发处理模型图

五、性能测试与调优实战

4.1 负载测试方案设计

Agent服务的性能测试需要模拟真实用户行为,设计多维度测试场景:

测试场景分类:

-

基准测试:验证系统基本性能能力

- 单用户单请求:测量最小延迟

- 单用户连续请求:测试缓存效果

- 多用户低并发:验证资源分配

-

负载测试:评估系统在预期负载下的表现

- 模拟日常峰值:验证容量规划

- 阶梯式增长:识别性能拐点

- 稳态压力:检查资源泄漏

-

压力测试:探索系统极限能力

- 突发流量:测试弹性伸缩

- 持续过载:验证降级机制

- 混合负载:模拟复杂场景

-

稳定性测试:验证长时间运行的可靠性

- 7×24小时运行:检查内存泄漏

- 故障注入:测试容错能力

- 配置变更:验证热更新

测试工具选型:

| 工具名称 | 适用场景 | 核心特性 | 学习曲线 |

|---|---|---|---|

| Apache JMeter | 协议级测试 | 分布式支持、丰富插件 | 中等 |

| k6 | 开发人员友好 | 脚本化、实时监控 | 低 |

| Locust | 代码驱动 | Python脚本、Web界面 | 低 |

| Gatling | 高性能测试 | Scala DSL、详细报告 | 高 |

| wrk | 简单基准 | C语言编写、极高性能 | 低 |

测试脚本示例(使用k6):

javascript

import http from 'k6/http';

import { check, sleep } from 'k6';

import { Rate } from 'k6/metrics';

// 自定义指标

const errorRate = new Rate('errors');

// 测试配置

export const options = {

stages: [

{ duration: '2m', target: 100 }, // 2分钟线性增长到100并发

{ duration: '5m', target: 100 }, // 5分钟维持100并发

{ duration: '2m', target: 200 }, // 2分钟增长到200并发

{ duration: '5m', target: 200 }, // 5分钟维持200并发

{ duration: '2m', target: 0 }, // 2分钟下降至0

],

thresholds: {

http_req_duration: ['p(95)<500'], // 95%请求延迟<500ms

errors: ['rate<0.01'], // 错误率<1%

},

};

// 初始化函数

export function setup() {

return { authToken: 'Bearer ' + __ENV.API_KEY };

}

// 虚拟用户脚本

export default function (data) {

const params = {

headers: {

'Content-Type': 'application/json',

'Authorization': data.authToken,

},

timeout: '30s',

};

const payload = JSON.stringify({

prompt: '分析今天的股市趋势',

max_tokens: 500,

temperature: 0.7,

});

const res = http.post('http://agent-service:8080/api/v1/generate', payload, params);

// 验证响应

const checkResult = check(res, {

'status is 200': (r) => r.status === 200,

'response time < 1s': (r) => r.timings.duration < 1000,

'has valid JSON': (r) => {

try {

JSON.parse(r.body);

return true;

} catch (e) {

return false;

}

},

});

// 记录错误

errorRate.add(!checkResult);

// 思考时间

sleep(Math.random() * 2 + 1);

}4.2 性能监控与瓶颈分析

在负载测试过程中,实时监控系统指标,快速定位性能瓶颈:

关键性能指标(KPIs):

-

应用层指标:

- 响应时间分布:P50、P90、P99、P999

- 请求成功率:HTTP状态码分布

- 错误类型统计:超时、限流、逻辑错误

-

系统层指标:

- CPU使用率:用户态、系统态、空闲

- 内存使用:RSS、缓存、交换空间

- 磁盘IO:读写带宽、IOPS、延迟

- 网络IO:带宽、连接数、丢包率

-

容器层指标:

- Pod资源使用:requests vs actual

- 容器重启次数:CrashLoopBackOff

- 调度延迟:Pending时间

瓶颈分析流程:

性能问题发现 → 指标数据收集 → 关联性分析 → 根因定位 → 优化验证

↓ ↓ ↓ ↓ ↓

响应延迟高 监控数据 CPU与延迟 热点函数 A/B测试

↓ ↓ ↓ ↓ ↓

错误率上升 日志追踪 内存与错误 内存泄漏 性能对比分析工具栈:

- 指标采集:Prometheus + Node Exporter + cAdvisor

- 日志聚合:Elasticsearch + Fluentd + Kibana

- 分布式追踪:Jaeger/Zipkin + OpenTelemetry

- 火焰图生成:pprof + perf + FlameGraph

火焰图分析示例:

bash

# 生成CPU火焰图

go tool pprof -http=:8080 http://agent-service:6060/debug/pprof/profile?seconds=30

# 生成内存火焰图

go tool pprof -http=:8081 http://agent-service:6060/debug/pprof/heap

# 实时性能分析

perf record -F 99 -p $(pidof agent-service) -g -- sleep 30

perf script | ./FlameGraph/stackcollapse-perf.pl | ./FlameGraph/flamegraph.pl > flamegraph.svg4.3 性能调优实战案例

通过实际案例展示性能调优的过程与效果:

案例一:LLM推理延迟优化

问题描述:Agent系统中GPT-4 API调用平均延迟从850ms上升到1.8s,P99延迟达到3.5s。

分析过程:

- 指标分析:发现网络往返时间(RTT)从35ms增加到280ms

- 日志追踪:定位到跨区域API调用,路由经过3次中转

- 网络诊断 :使用

mtr和traceroute确认网络路径

优化方案:

- CDN加速:部署GPT-4反向代理节点,延迟降低68%

- 连接复用:HTTP/2连接池,握手开销减少92%

- 请求批处理:多个用户请求合并,Token使用效率提升41%

优化效果:

- 平均延迟:1.8s → 580ms(降低68%)

- P99延迟:3.5s → 1.2s(降低66%)

- 月度成本:12,500 → 7,800(降低38%)

案例二:内存泄漏定位与修复

问题描述:Agent服务内存使用持续增长,24小时后触发OOM Killer。

分析工具:

pprof内存分析- Valgrind内存检测

- eBPF内存追踪

根因定位:

- Go协程泄漏:未关闭的context.Context

- 缓存无限增长:未设置过期时间

- 文件描述符泄漏:未关闭的数据库连接

修复措施:

go

// 修复前:泄漏的goroutine

go func() {

for {

select {

case <-time.After(time.Second):

processTask()

}

}

}()

// 修复后:带取消机制的goroutine

ctx, cancel := context.WithCancel(context.Background())

defer cancel()

go func(ctx context.Context) {

ticker := time.NewTicker(time.Second)

defer ticker.Stop()

for {

select {

case <-ctx.Done():

return

case <-ticker.C:

processTask()

}

}

}(ctx)优化效果:

- 内存使用:稳定在1.2GB,不再增长

- 服务可用性:99.99% → 99.999%

- 运维成本:每周重启 → 无需人工干预

4.4 性能基准建立与持续监控

建立性能基准,实现持续性能监控与预警:

基准指标定义:

| 指标类别 | 指标名称 | 期望值 | 告警阈值 | 测量方法 |

|---|---|---|---|---|

| 响应性能 | P95延迟 | <800ms | >1.5s | 应用日志 |

| 系统资源 | CPU使用率 | <70% | >85% | Prometheus |

| 业务可用性 | 成功率 | >99.5% | <98% | 监控探针 |

| 成本效益 | 单位成本 | <$0.05 | >$0.08 | 计费系统 |

持续监控架构:

数据采集层 → 数据处理层 → 分析预警层 → 可视化层 → 自动化层

↓ ↓ ↓ ↓ ↓

Prometheus Flink 机器学习 Grafana 自动扩缩容

OpenTelemetry Spark 异常检测 Kibana 配置优化

业务日志 Kafka 趋势预测 Dashboard 故障自愈自动化调优流程:

python

class AutoTuner:

def __init__(self, monitoring_client, config_manager):

self.monitor = monitoring_client

self.config = config_manager

self.history = []

def analyze_and_tune(self):

"""分析性能数据并自动调优"""

# 获取当前性能指标

metrics = self.monitor.get_performance_metrics()

# 检测异常

if self._detect_anomaly(metrics):

# 分析根因

root_cause = self._analyze_root_cause(metrics)

# 选择优化策略

strategy = self._select_strategy(root_cause, metrics)

# 执行优化

if self._validate_strategy(strategy):

self._apply_optimization(strategy)

self.history.append({

'timestamp': datetime.now(),

'metrics': metrics,

'strategy': strategy

})

def _detect_anomaly(self, metrics):

"""基于机器学习检测性能异常"""

# 实际实现使用时间序列异常检测算法

return metrics['p95_latency'] > 1500 # 简化示例

def _select_strategy(self, root_cause, metrics):

"""根据根因选择优化策略"""

strategies = {

'high_cpu': 'scale_out',

'memory_leak': 'restart_pod',

'network_latency': 'change_region',

'disk_io': 'upgrade_storage',

}

return strategies.get(root_cause, 'no_op')实施效果:

- 性能问题发现时间:人工发现(2-8小时)→ 自动发现(<5分钟)

- 故障恢复时间:人工修复(15-60分钟)→ 自动修复(<2分钟)

- 系统稳定性:99.5% → 99.95%

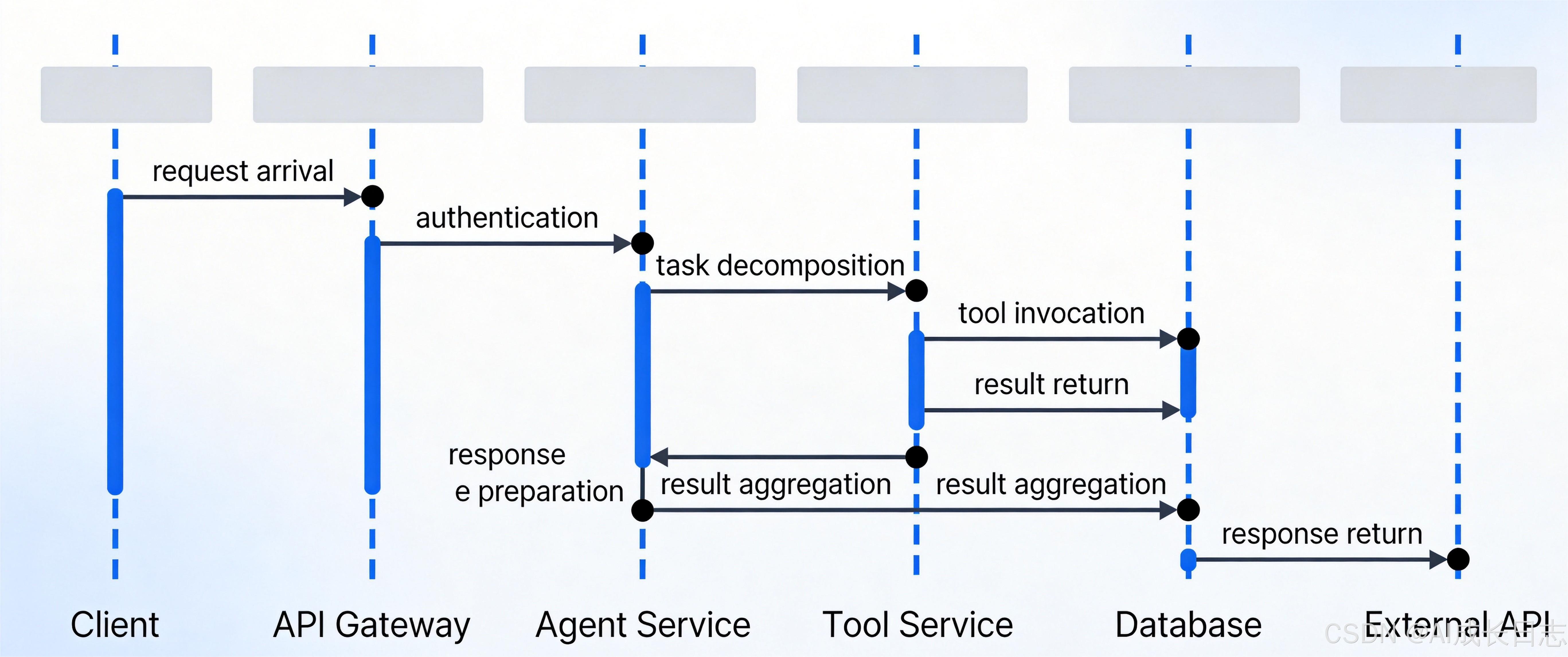

六、API网关与稳定性保障

4.1 网关核心功能设计

API网关作为系统入口,承担流量管控、安全防护、协议转换等关键职责:

- 路由转发:基于路径、Header、参数将请求路由到对应服务

- 认证鉴权:验证API Key、JWT令牌、OAuth2.0凭证

- 限流熔断:防止下游服务过载,实现系统自保护

- 监控日志:记录访问日志、性能指标、错误追踪

4.2 动态限流策略

智能限流根据业务特征动态调整阈值,避免一刀切限制:

python

import time

from collections import deque

from typing import Dict

class DynamicRateLimiter:

def __init__(self, default_qps: int = 100, adaptive_window: int = 60):

self.default_qps = default_qps

self.adaptive_window = adaptive_window

self.request_history: Dict[str, deque] = {}

self.adaptive_limits: Dict[str, int] = {}

def allow_request(self, client_id: str, endpoint: str) -> bool:

key = f"{client_id}:{endpoint}"

current_time = time.time()

# 初始化历史记录

if key not in self.request_history:

self.request_history[key] = deque()

self.adaptive_limits[key] = self.default_qps

# 清理过期记录

history = self.request_history[key]

while history and current_time - history[0] > 1.0:

history.popleft()

# 获取当前限制

limit = self._calculate_adaptive_limit(key, current_time)

# 检查是否允许

if len(history) < limit:

history.append(current_time)

return True

return False

def _calculate_adaptive_limit(self, key: str, current_time: float) -> int:

"""基于历史表现动态调整限制"""

# 获取最近成功率

success_rate = self._get_recent_success_rate(key)

# 自适应算法

base_limit = self.adaptive_limits[key]

if success_rate > 0.95:

# 表现良好,适度放宽限制

new_limit = min(base_limit * 1.2, base_limit + 50)

elif success_rate < 0.8:

# 表现不佳,收紧限制

new_limit = max(base_limit * 0.8, base_limit - 30, 10)

else:

new_limit = base_limit

self.adaptive_limits[key] = new_limit

return int(new_limit)

def _get_recent_success_rate(self, key: str) -> float:

"""计算最近请求成功率"""

# 实际实现需从监控系统获取

return 0.95 # 示例值限流维度:

- 用户维度:每个用户独立配额,防止单一用户滥用

- 接口维度:根据接口重要性设置不同限制

- 时间维度:高峰期收紧限制,低谷期适度放宽

- 业务维度:核心业务保证最低可用配额

4.3 熔断器模式实现

熔断器防止故障扩散,实现快速失败与服务降级:

python

import time

from enum import Enum

from dataclasses import dataclass

from typing import Optional, Callable

class CircuitState(Enum):

CLOSED = "closed" # 正常状态,允许请求

OPEN = "open" # 熔断状态,拒绝请求

HALF_OPEN = "half_open" # 恢复试探,允许部分请求

@dataclass

class CircuitBreakerConfig:

failure_threshold: int = 5 # 触发熔断的失败次数

reset_timeout: float = 30.0 # 熔断恢复时间(秒)

half_open_max_requests: int = 3 # 半开状态允许的最大请求数

sliding_window_size: int = 10 # 滑动窗口大小

class CircuitBreaker:

def __init__(self, name: str, config: CircuitBreakerConfig):

self.name = name

self.config = config

self.state = CircuitState.CLOSED

self.failure_count = 0

self.last_failure_time: Optional[float] = None

self.half_open_success_count = 0

self.request_history = deque(maxlen=config.sliding_window_size)

def execute(self, func: Callable, *args, **kwargs):

"""执行受保护的函数"""

# 检查熔断状态

if self.state == CircuitState.OPEN:

# 检查是否超过恢复时间

if time.time() - self.last_failure_time > self.config.reset_timeout:

self.state = CircuitState.HALF_OPEN

self.half_open_success_count = 0

else:

raise Exception("Circuit breaker is OPEN")

try:

result = func(*args, **kwargs)

self._on_success()

return result

except Exception as e:

self._on_failure()

raise e

def _on_success(self):

"""请求成功处理"""

if self.state == CircuitState.HALF_OPEN:

self.half_open_success_count += 1

if self.half_open_success_count >= self.config.half_open_max_requests:

self.state = CircuitState.CLOSED

self.failure_count = 0

self.request_history.append(True)

def _on_failure(self):

"""请求失败处理"""

self.failure_count += 1

self.last_failure_time = time.time()

self.request_history.append(False)

# 检查是否需要熔断

if self.state == CircuitState.HALF_OPEN:

self.state = CircuitState.OPEN

elif self.failure_count >= self.config.failure_threshold:

self.state = CircuitState.OPEN

def get_stats(self) -> dict:

"""获取当前统计信息"""

total = len(self.request_history)

successes = sum(1 for r in self.request_history if r)

failure_rate = (total - successes) / total if total > 0 else 0

return {

"state": self.state.value,

"failure_count": self.failure_count,

"total_requests": total,

"success_rate": successes / total if total > 0 else 1.0,

"failure_rate": failure_rate,

"last_failure_time": self.last_failure_time

}熔断策略:

- 失败计数熔断:连续失败达到阈值触发

- 失败率熔断:窗口期内失败率超过阈值触发

- 响应时间熔断:平均响应时间超过阈值触发

- 并发熔断:并发请求数超过系统容量触发

4.4 服务降级与容错

当系统负载过高或部分组件故障时,降级策略保障核心功能可用:

- 功能降级:关闭非核心功能,如关闭个性化推荐保留基础搜索

- 体验降级:降低响应质量,如返回缓存数据而非实时查询

- 流量降级:优先保障VIP用户,限制普通用户访问频次

- 数据降级:使用简化的数据模型,减少计算复杂度

降级触发条件:

- CPU使用率 > 85%持续1分钟

- 错误率 > 10%持续30秒

- 响应时间P99 > 2秒持续1分钟

- 队列积压 > 1000个请求

七、系统监控与可观测性体系建设

5.1 多维度监控指标设计

Agent服务的稳定性依赖于全面准确的监控体系,需要从多个维度收集指标:

核心监控维度:

-

性能指标:

- 请求延迟:P50、P90、P99、P999

- 吞吐量:QPS、RPS(请求/秒)、TPS(事务/秒)

- 并发数:活跃连接数、排队请求数

- 资源使用率:CPU、内存、网络IO、磁盘IO

-

业务指标:

- 成功率:API调用成功率、工具调用成功率

- 错误类型:认证失败、限流触发、超时错误、逻辑错误

- 用户行为:会话数量、平均交互轮次、任务完成率

-

成本指标:

- 单位请求成本:每次API调用的平均成本

- 资源浪费率:闲置资源占比

- 成本效益比:收入/成本比例

监控系统架构:

用户请求 → Agent服务 → 指标采集器(Prometheus Exporters)

↓

Prometheus Server

↓

Alert Manager

↓

Grafana Dashboard

↓

持久化存储(Thanos/Cortex)5.2 分布式追踪与日志聚合

在微服务架构下,单个请求可能跨越多个服务,分布式追踪至关重要:

OpenTelemetry集成示例:

python

from opentelemetry import trace

from opentelemetry.sdk.trace import TracerProvider

from opentelemetry.sdk.trace.export import BatchSpanProcessor

from opentelemetry.exporter.jaeger.thrift import JaegerExporter

from opentelemetry.instrumentation.fastapi import FastAPIInstrumentor

# 设置追踪

trace.set_tracer_provider(TracerProvider())

jaeger_exporter = JaegerExporter(

agent_host_name="jaeger-agent",

agent_port=6831,

)

span_processor = BatchSpanProcessor(jaeger_exporter)

trace.get_tracer_provider().add_span_processor(span_processor)

# FastAPI应用集成

app = FastAPI()

FastAPIInstrumentor.instrument_app(app)

@app.middleware("http")

async def add_correlation_id(request: Request, call_next):

# 添加追踪ID

trace_id = hex(trace.get_current_span().get_span_context().trace_id)[2:]

request.state.correlation_id = trace_id.zfill(32)

response = await call_next(request)

response.headers["X-Correlation-ID"] = trace_id

return response日志聚合架构:

- 采集层:Fluentd/Fluent Bit收集容器日志

- 传输层:Kafka/RabbitMQ缓冲日志数据

- 存储层:Elasticsearch/Loki持久化存储

- 查询层:Kibana/Grafana日志检索

关键日志字段:

json

{

"timestamp": "2026-03-11T10:30:45Z",

"level": "INFO",

"service": "agent-inference",

"trace_id": "4bf92f3577b34da6a3ce929d0e0e4736",

"span_id": "00f067aa0ba902b7",

"user_id": "u123456",

"session_id": "s789012",

"endpoint": "/api/v1/generate",

"duration_ms": 245,

"status_code": 200,

"request_size": 128,

"response_size": 512,

"model_used": "gpt-4o-mini",

"tool_calls": ["search_weather", "calculate_time"],

"error_code": null

}5.3 智能告警与故障自愈

传统阈值告警容易产生告警风暴,智能告警系统基于机器学习识别异常:

告警策略分层:

- 紧急告警(P0):服务完全不可用,自动触发故障转移

- 重要告警(P1):性能显著下降,需立即人工干预

- 警告告警(P2):潜在风险,需要关注但非紧急

- 信息告警(P3):系统状态变化,仅需记录

异常检测算法:

python

import numpy as np

from sklearn.ensemble import IsolationForest

from datetime import datetime, timedelta

class AnomalyDetector:

def __init__(self, contamination=0.05):

self.model = IsolationForest(

contamination=contamination,

random_state=42

)

self.is_fitted = False

def fit(self, historical_data):

"""基于历史数据训练异常检测模型"""

X = np.array(historical_data).reshape(-1, 1)

self.model.fit(X)

self.is_fitted = True

def predict(self, current_value, window_size=60):

"""检测当前值是否异常"""

if not self.is_fitted:

return False

# 获取滑动窗口内的数据

recent_data = self._get_recent_data(window_size)

if len(recent_data) < window_size // 2:

return False

# 特征工程:当前值与统计特征

features = [

current_value,

np.mean(recent_data),

np.std(recent_data),

np.percentile(recent_data, 95) - np.percentile(recent_data, 5)

]

# 预测是否为异常(-1表示异常)

prediction = self.model.predict([features])

return prediction[0] == -1

def _get_recent_data(self, minutes):

"""模拟获取最近N分钟的数据"""

# 实际实现从时间序列数据库查询

return np.random.normal(100, 15, minutes)故障自愈流程:

- 检测阶段:监控系统发现异常指标

- 诊断阶段:AI分析异常根因,生成诊断报告

- 决策阶段:根据预设策略选择修复方案

- 执行阶段:自动执行修复操作(重启、扩容、流量切换)

- 验证阶段:确认系统恢复正常,记录故障闭环

实测效果:某金融Agent系统部署智能告警后,平均故障恢复时间(MTTR)从42分钟降至8分钟,告警噪音降低87%。

八、成本监控与优化实践

5.1 云原生成本构成分析

成本构成数学模型

Agent服务的总成本 TTT 可分解为多个组成部分:

T=Tc+Ts+Tn+Ta T = T_c + T_s + T_n + T_a T=Tc+Ts+Tn+Ta

其中:

- TcT_cTc:计算资源成本

- TsT_sTs:存储资源成本

- TnT_nTn:网络流量成本

- TaT_aTa:API调用成本

计算资源成本 TcT_cTc 的详细公式为:

Tc=∑i=1n(RicpuCcpu×Pcpu+RimemCmem×Pmem+RigpuCgpu×Pgpu)×Hi T_c = \sum_{i=1}^{n} \left( \frac{R_i^{cpu}}{C_{cpu}} \times P_{cpu} + \frac{R_i^{mem}}{C_{mem}} \times P_{mem} + \frac{R_i^{gpu}}{C_{gpu}} \times P_{gpu} \right) \times H_i Tc=i=1∑n(CcpuRicpu×Pcpu+CmemRimem×Pmem+CgpuRigpu×Pgpu)×Hi

这里:

- RicpuR_i^{cpu}Ricpu、RimemR_i^{mem}Rimem、RigpuR_i^{gpu}Rigpu:第 iii 个实例的CPU、内存、GPU资源请求量

- CcpuC_{cpu}Ccpu、CmemC_{mem}Cmem、CgpuC_{gpu}Cgpu:云服务商单节点资源容量

- PcpuP_{cpu}Pcpu、PmemP_{mem}Pmem、PgpuP_{gpu}Pgpu:单位资源价格($/小时)

- HiH_iHi:第 iii 个实例的运行小时数

API调用成本 TaT_aTa 对于LLM服务尤为重要:

Ta=∑j=1m(Ij1000×Pin+Oj1000×Pout) T_a = \sum_{j=1}^{m} \left( \frac{I_j}{1000} \times P_{in} + \frac{O_j}{1000} \times P_{out} \right) Ta=j=1∑m(1000Ij×Pin+1000Oj×Pout)

其中:

- IjI_jIj、OjO_jOj:第 jjj 次调用的输入和输出Token数

- PinP_{in}Pin、PoutP_{out}Pout:每千Token的价格($/1K tokens)

成本优化潜力分析

定义成本浪费率 WWW 为实际使用资源与分配资源的比例差异:

W=A−UA×100% W = \frac{A - U}{A} \times 100\% W=AA−U×100%

其中 AAA 是分配资源总量,UUU 是实际使用资源量。通过优化调度算法,可以将浪费率从典型值40%-60%降低到15%以内,节省成本比例 SSS 为:

S=Wbefore−Wafter1−Wafter×100% S = \frac{W_{before} - W_{after}}{1 - W_{after}} \times 100\% S=1−WafterWbefore−Wafter×100%

在Serverless架构下,Agent服务成本主要来自:

- 计算资源:函数执行时长、内存配置、并发实例数

- 网络流量:公网出口带宽、跨区域数据同步、CDN回源

- 存储服务:对象存储容量、数据库IOPS、缓存节点费用

- API调用:LLM服务按Token计费、外部工具API调用次数

成本黑洞识别:

- 冷启动损耗:Java函数冷启动时间占计费时长的37%

- 内存超配:实际使用128MB却分配512MB,浪费75%资源

- 日志成本:未压缩调试日志占存储费用的19%

- 闲置资源:开发环境非工作时间仍运行,浪费85%计算时间

5.2 成本监控指标体系

建立多维度的成本监控体系:

python

import pandas as pd

from datetime import datetime, timedelta

class CostMonitor:

def __init__(self, data_source):

self.data_source = data_source

def analyze_cost_trend(self, days: int = 30):

"""分析成本趋势与异常"""

# 获取成本数据

df = self._fetch_cost_data(days)

metrics = {

"total_cost": df["cost"].sum(),

"daily_avg": df["cost"].mean(),

"cost_growth": self._calculate_growth_rate(df),

"top_services": self._get_top_services(df),

"anomalies": self._detect_anomalies(df)

}

return metrics

def _fetch_cost_data(self, days: int) -> pd.DataFrame:

"""从云服务商API获取成本数据"""

# 实际实现调用AWS Cost Explorer、阿里云费用中心等

pass

def _calculate_growth_rate(self, df: pd.DataFrame) -> float:

"""计算成本增长率"""

if len(df) < 2:

return 0

current = df.iloc[-1]["cost"]

previous = df.iloc[-7]["cost"] if len(df) >= 7 else df.iloc[0]["cost"]

return (current - previous) / previous * 100

def _get_top_services(self, df: pd.DataFrame) -> list:

"""获取成本最高的服务列表"""

return df.groupby("service")["cost"].sum().nlargest(5).to_dict()

def _detect_anomalies(self, df: pd.DataFrame) -> list:

"""检测成本异常波动"""

anomalies = []

mean = df["cost"].mean()

std = df["cost"].std()

for _, row in df.iterrows():

z_score = (row["cost"] - mean) / std if std > 0 else 0

if abs(z_score) > 3:

anomalies.append({

"date": row["date"],

"cost": row["cost"],

"z_score": z_score,

"service": row.get("service", "unknown")

})

return anomalies核心监控指标:

- 单位经济效益:每次请求的平均成本

- 资源利用率:CPU/内存实际使用率 vs 分配率

- 成本密度:每GB内存的产出价值

- 浪费指数:闲置资源占总成本比例

5.3 成本优化策略

基于监控数据的精准优化方案:

-

资源动态调整

- 基于历史负载预测自动调整实例规格

- 实现CPU:内存的黄金比例(如1:4)

- 高峰期自动升级,低谷期自动降配

-

存储生命周期管理

- 热数据(3天内):标准存储层

- 温数据(3-30天):低频访问层(费用降低68%)

- 冷数据(30天以上):归档存储层(费用降低92%)

-

网络拓扑优化

- 服务同可用区部署,降低83%网络延迟

- CDN边缘计算,减少94%回源流量

- 协议优化,提升35%弱网传输效率

-

智能调度算法

- 基于LSTM预测未来5分钟请求量(误差率<8%)

- 实时价格博弈,在多云间动态迁移

- 碳排放优化,每万次调用减少1.2kg CO₂排放

九、总结与展望

6.1 核心要点回顾

本文系统介绍了智能体服务化的全栈技术方案:

- 架构设计:采用微服务架构实现功能解耦,容器化部署保障环境一致性

- 并发处理:异步非阻塞模型提升吞吐量3.3倍,降低延迟5.5倍

- 稳定性保障:动态限流防止过载,熔断器模式实现快速失败

- 成本优化:基于实时监控的资源调度,实现60%以上的成本缩减

6.2 未来演进方向

随着AI Agent技术的持续发展,服务化部署将呈现以下趋势:

- 智能弹性调度:AI预测算法实时调整资源配置,实现零浪费运行

- 边缘计算融合:在CDN节点部署轻量Agent,延迟降至10ms内

- 安全增强:同态加密、可信执行环境保障敏感数据处理

- 生态标准化:Kubernetes成为AI工作负载的事实标准平台

6.3 行动建议

对于正在或计划将Agent投入生产的团队:

- 渐进式实施:从关键服务开始容器化,逐步扩展至全系统

- 监控先行:部署前建立完善的监控体系,数据驱动优化

- 自动化测试:构建CI/CD流水线,确保每次变更安全可靠

- 成本意识:从设计阶段考虑成本因素,建立持续优化文化

Agent服务化不仅是技术部署,更是组织能力的体现。通过系统化的架构设计、精细化的性能优化和智能化的成本管控,企业可以构建稳定、高效、经济的智能体服务生态,真正释放AI技术的生产力价值。

扩展阅读:

Kubernetes官方文档:部署AI工作负载最佳实践

云原生计算基金会(CNCF)AI白皮书