OpenClaw 从本地到云端:阿里云百炼免费模型配置实战指南

前言

如果你已经在 Mac 开发机上成功配置了 OpenClaw 和本地 Ollama 模型(如 qwen2.5:7b),那么恭喜你已经完成了"养虾"的第一步。本地模型虽然免费、隐私、无限制,但受限于硬件性能(尤其是 Mac 上 7B 模型通常只能跑 4bit 量化版),在处理复杂任务、工具调用准确性上,与云端大模型确实存在差距。

这时候,阿里云百炼平台的云端模型就成为了完美的补充------推理速度更快,新用户还享有 90 天免费额度,让你零成本体验更强大的 AI 能力。本文将基于你已有的本地模型配置经验,详细介绍如何为 OpenClaw 增加百炼云端模型,实现"本地+云端"双模型自由切换。

一、为什么选择百炼云端模型?

核心优势对比

| 对比维度 | 本地模型(Ollama+qwen2.5:7b) | 百炼云端模型(如qwen3.5-plus) |

|---|---|---|

| 硬件依赖 | 依赖本地硬件(Mac内存≥16GB) | 无需高性能硬件,网络通畅即可 |

| 推理速度 | 中等(CPU运行约5-10字/秒) | 快速(约20-30字/秒) |

| 工具调用能力 | 7B模型工具调用能力有限 | 云端大模型工具调用更精准 |

| 成本 | 完全免费 | 新用户90天免费额度 |

| 适用场景 | 日常对话、隐私敏感场景 | 复杂任务、需要工具调用的场景 |

双模型互补的价值

根据实测,OpenClaw 的"双模型部署方案"能实现优势互补:本地模型保隐私、无限制,云端模型提效率、强推理。你可以根据不同场景随时切换,这正是 OpenClaw 的核心魅力所在。

二、配置前的准备工作

2.1 账号与环境检查

核心要求:

- 阿里云账号(需完成实名认证)

- Node.js 22.0 或更高版本(你已在 Mac 上完成)

- OpenClaw 已成功安装(你已完成)

2.2 开通阿里云百炼服务

- 访问百炼平台 :打开阿里云百炼大模型服务平台

- 开通服务:阅读并同意服务协议,系统将自动开通。若提示"您尚未进行实名认证",请先完成认证

- 领取免费额度 :首次开通后,可领取90天新人免费额度 ,用于模型推理测试。建议进入"费用管理" → "消费限额",设置每月最大消费额度为 0元,避免意外扣费

三、获取百炼 API 密钥

3.1 选择地域

百炼平台提供多个地域,免费额度适用于所有地域 ,但不同地域支持的模型略有差异。推荐使用新加坡地域,网络访问稳定且支持主流模型。

3.2 创建 API Key

- 进入百炼控制台左侧 "密钥管理" 页面

- 点击 "创建API-Key",完成短信/扫码验证

- 立即复制并保存 生成的 API Key(格式通常以

sk-开头)------密钥仅创建时可见,丢失需重新创建

重要提醒 :确保 Base URL、API Key 和后续配置的模型都归属于同一地域,否则会导致调用失败。

四、在 OpenClaw 中配置百炼模型

4.1 配置文件位置

OpenClaw 的配置文件位于 ~/.openclaw/openclaw.json。由于你已有本地 Ollama 模型配置经验,对编辑此文件应该不陌生。

4.2 添加百炼模型配置

使用文本编辑器打开配置文件(如 nano ~/.openclaw/openclaw.json 或 code ~/.openclaw/openclaw.json),在 models.providers 部分添加百炼配置:

json

{

"models": {

"mode": "merge",

"providers": {

// 保留你原有的 Ollama 配置

"ollama": {

// ... 原有配置

"baseUrl": "http://127.0.0.1:11434/v1",

"apiKey": "aabbcc",

"api": "openai-completions",

"models": [

{

"id": "qwen2.5:7b",

"name": "qwen2.5:7b (Custom Provider)",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 16000,

"maxTokens": 4096

},

{

"id": "qwen2.5:7b-instruct",

"name": "qwen2.5:7b-instruct",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 16000,

"maxTokens": 4096

}

]

},

// 新增百炼配置

"bailian": {

"baseUrl": "https://dashscope-intl.aliyuncs.com/compatible-mode/v1", // 新加坡地域

"apiKey": "你的百炼API密钥", // 替换为实际密钥

"api": "openai-completions",

"models": [

{

"id": "qwen3.5-plus",

"name": "qwen3.5-plus (Free)",

"reasoning": false, // 必须设为 false,否则回复为空

"input": ["text", "image"],

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "qwen3-coder-next",

"name": "qwen3-coder-next",

"reasoning": false,

"input": ["text"],

"contextWindow": 262144,

"maxTokens": 65536

}

]

}

}

},

"agents": {

"defaults": {

// 可设置默认模型为百炼,也可保持原有默认

"model": {

"primary": "bailian/qwen3.5-plus" // 或保持 ollama/qwen2.5:7b

},

"models": {

// 声明可用模型

"bailian/qwen3.5-plus": {},

"bailian/qwen3-coder-next": {},

"ollama/qwen2.5:7b": {} // 保留本地模型

}

}

}

}4.3 配置关键点说明

| 参数 | 值 | 说明 |

|---|---|---|

baseUrl |

按地域选择:dashscope.aliyuncs.com(北京)、dashscope-intl.aliyuncs.com(新加坡)、dashscope-us.aliyuncs.com(弗吉尼亚) |

必须与 API Key 地域一致 |

apiKey |

你的百炼 API 密钥 | 格式如 sk-xxxx |

reasoning |

false |

必须设为 false,否则模型无响应 |

contextWindow |

根据模型设置 | qwen3.5-plus 支持百万级上下文 |

models 数组 |

可添加多个模型 ID | 支持 qwen3.5-plus、qwen3-coder-next 等 |

4.4 保存并重启

-

保存配置文件

-

重启 OpenClaw 网关使配置生效:

bashopenclaw gateway restart

五、验证与使用

5.1 查看可用模型

在 OpenClaw 对话界面(TUI 或 Web 控制台)输入:

/models应该能看到新添加的百炼模型,如 bailian/qwen3.5-plus。

5.2 切换模型

-

临时切换当前会话 :

/model bailian/qwen3.5-plus -

永久更改默认模型 :修改配置文件中的

agents.defaults.model.primary字段

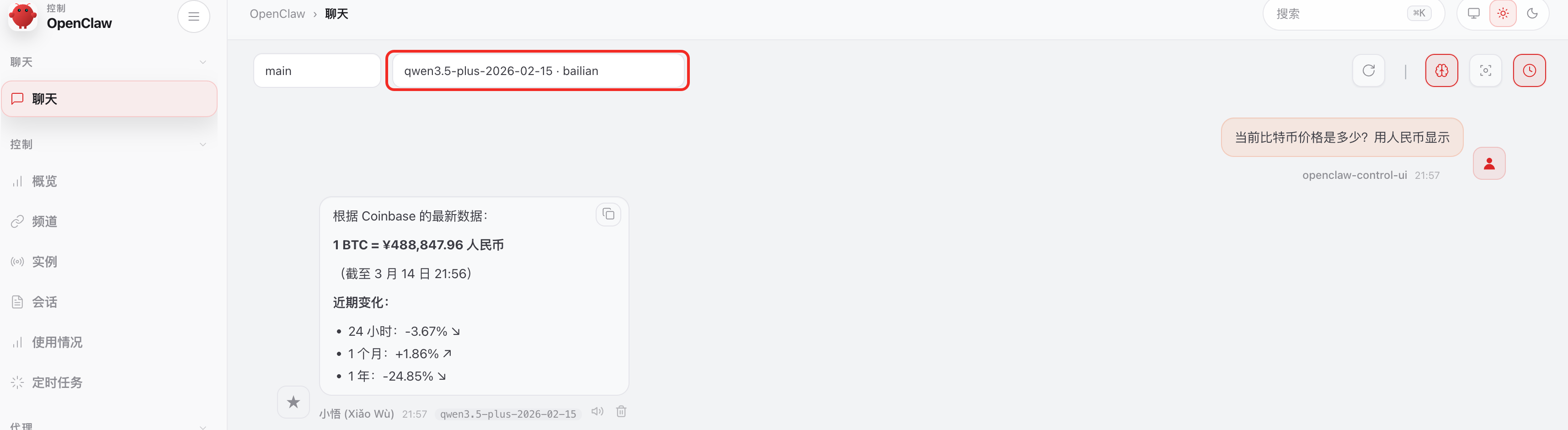

5.3 测试对话

尝试问一些需要实时信息或复杂推理的问题,例如:

- "今天北京的天气怎么样?"(测试工具调用)

- "帮我解释一下量子计算的基本原理"(测试推理能力)

如果配置正确,你应该能感受到云端模型相比本地 7B 模型的响应速度更快、理解更准确 。

六、常见问题与解决方案

Q1:配置后模型无响应或回复为空

原因 :reasoning 参数未设置为 false

解决 :检查配置文件中 "reasoning": false 是否正确设置

Q2:提示"model not allowed"或找不到模型

原因 :模型 ID 拼写错误,或 provider 名称不一致

解决 :使用 /models 命令查看正确的模型 ID 格式,确保引用时使用 bailian/模型ID

Q3:调用失败提示 401 或鉴权错误

原因 :API Key 无效,或 Base URL 与 API Key 地域不一致

解决:确认 API Key 正确,且 Base URL 与 API Key 所属地域匹配

Q4:超出免费额度怎么办?

预防 :在百炼控制台设置"消费限额"为 0 元,避免意外扣费

后续:免费额度用完后,可按需选择:

- 切换回本地 Ollama 模型(免费无限制)

- 订阅百炼 Coding Plan(固定月费,适合高频使用)

七、总结:从本地到云端,开启双模型之旅

至此,你已经成功为 OpenClaw 配置了阿里云百炼云端模型,实现了本地模型+云端模型双自由:

- 本地 Ollama 模型:保隐私、无限制,适合日常对话

- 百炼云端模型:强推理、快响应,适合复杂任务

根据实测,这种"双模型互补"的部署方案,让 OpenClaw 既能满足隐私需求,又能应对高复杂度任务,真正成为你的全能 AI 助手。

现在,你可以用 /model bailian/qwen3.5-plus 切换到云端,感受一下与本地模型的不同体验。如果遇到任何问题,欢迎随时交流探讨!

附:一份完整openclaw配置示例

json

{

"meta": {

"lastTouchedVersion": "2026.3.13",

"lastTouchedAt": "2026-03-14T13:54:51.337Z"

},

"wizard": {

"lastRunAt": "2026-03-14T07:01:31.959Z",

"lastRunVersion": "2026.3.12",

"lastRunCommand": "onboard",

"lastRunMode": "local"

},

"models": {

"mode": "merge",

"providers": {

"custom-127-0-0-1-11434": {

"baseUrl": "http://127.0.0.1:11434/v1",

"apiKey": "aabbcc",

"api": "openai-completions",

"models": [

{

"id": "qwen2.5:7b",

"name": "qwen2.5:7b (Custom Provider)",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 16000,

"maxTokens": 4096

},

{

"id": "qwen2.5:7b-instruct",

"name": "qwen2.5:7b-instruct",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 16000,

"maxTokens": 4096

}

]

},

"bailian": {

"baseUrl": "https://dashscope.aliyuncs.com/compatible-mode/v1",

"apiKey": "sk-xx",

"api": "openai-completions",

"models": [

{

"id": "qwen3.5-plus",

"name": "qwen3.5-plus",

"reasoning": false,

"input": [

"text",

"image"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 1000000,

"maxTokens": 65536,

"compat": {

"thinkingFormat": "qwen"

}

},

{

"id": "qwen3.5-plus-2026-02-15",

"name": "qwen3.5-plus-2026-02-15",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 262144,

"maxTokens": 65536,

"compat": {

"thinkingFormat": "qwen"

}

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "custom-127-0-0-1-11434/qwen2.5:7b"

},

"models": {

"custom-127-0-0-1-11434/qwen2.5:7b": {

"alias": "local"

},

"custom-127-0-0-1-11434/qwen2.5:7b-instruct": {},

"bailian/qwen3.5-plus": {},

"bailian/qwen3.5-plus-2026-02-15": {}

},

"workspace": "/Users/mac/.openclaw/workspace",

"contextPruning": {

"mode": "cache-ttl",

"ttl": "5m",

"keepLastAssistants": 3,

"softTrimRatio": 0.3,

"hardClearRatio": 0.5

}

},

"list": [

{

"id": "main",

"model": "bailian/qwen3.5-plus-2026-02-15",

"skills": [

"1password",

"apple-notes",

"apple-reminders",

"bear-notes",

"blogwatcher",

"blucli",

"bluebubbles",

"camsnap",

"clawhub",

"coding-agent",

"discord",

"eightctl",

"gemini",

"gh-issues",

"gifgrep",

"github",

"gog",

"goplaces",

"healthcheck",

"himalaya",

"imsg",

"mcporter",

"model-usage",

"nano-banana-pro",

"nano-pdf",

"node-connect",

"notion",

"obsidian",

"openai-image-gen",

"openai-whisper",

"openai-whisper-api",

"openhue",

"oracle",

"ordercli",

"peekaboo",

"sag",

"session-logs",

"sherpa-onnx-tts",

"skill-creator",

"slack",

"songsee",

"sonoscli",

"spotify-player",

"summarize",

"things-mac",

"tmux",

"trello",

"video-frames",

"voice-call",

"wacli",

"weather",

"xurl",

"tavily-search"

],

"tools": {

"profile": "full",

"deny": [

"memory_search",

"memory_get"

]

}

}

]

},

"tools": {

"profile": "coding"

},

"commands": {

"native": "auto",

"nativeSkills": "auto",

"restart": true,

"ownerDisplay": "raw"

},

"session": {

"dmScope": "per-channel-peer"

},

"gateway": {

"port": 18789,

"mode": "local",

"bind": "loopback",

"auth": {

"mode": "token",

"token": "43f983e15acc4e9f420ae6eb6d2fa6e48c20b25eb02defc0"

},

"tailscale": {

"mode": "off",

"resetOnExit": false

},

"nodes": {

"denyCommands": [

"camera.snap",

"camera.clip",

"screen.record",

"contacts.add",

"calendar.add",

"reminders.add",

"sms.send"

]

}

}

}