近两年,大模型在架构层面经历了一轮快速演进,并逐步走向收敛与稳定。基于这一阶段性变化,可以做一次相对系统的梳理。

本文主要参考 Sebastian Raschka 的总结工作:https://sebastianraschka.com/llm-architecture-gallery/

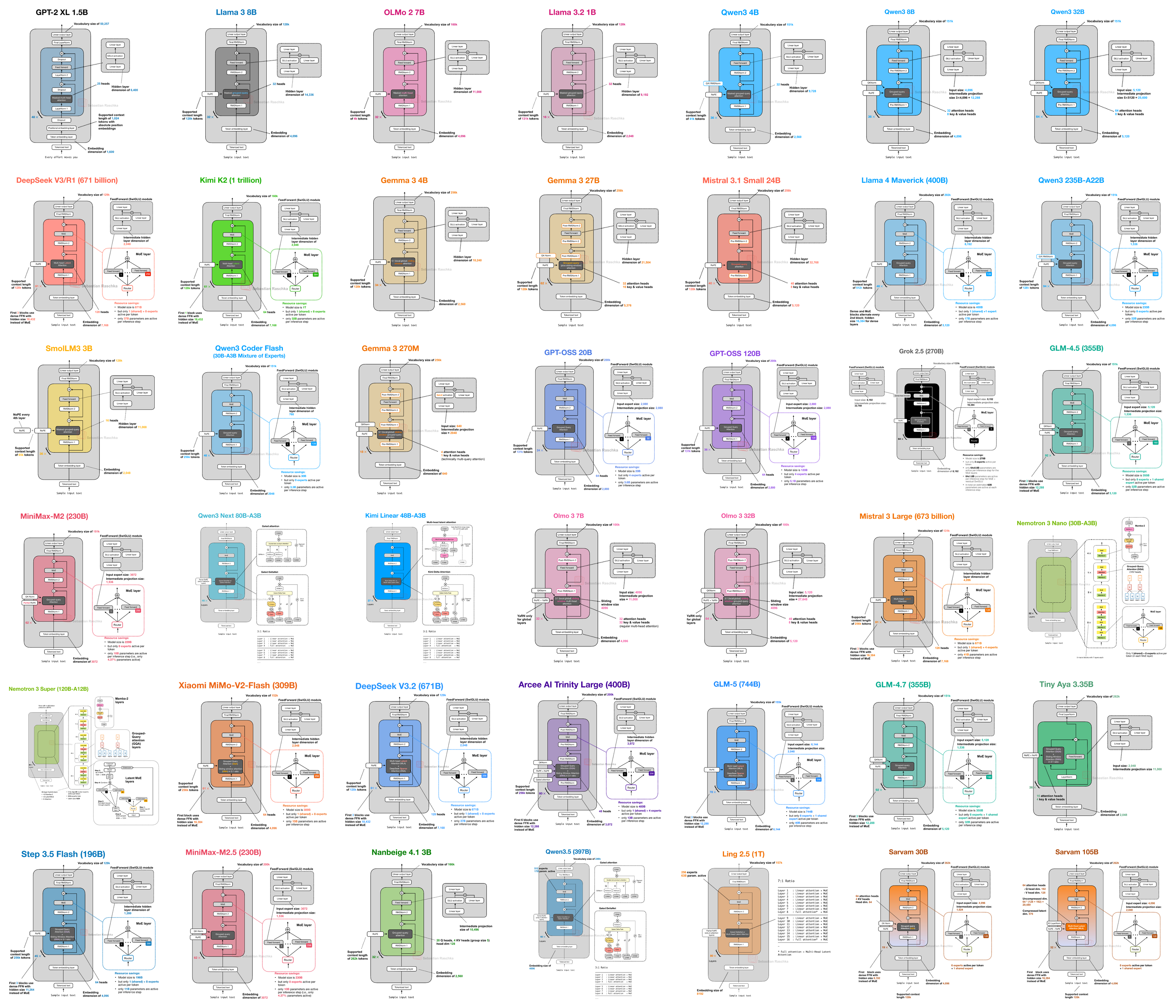

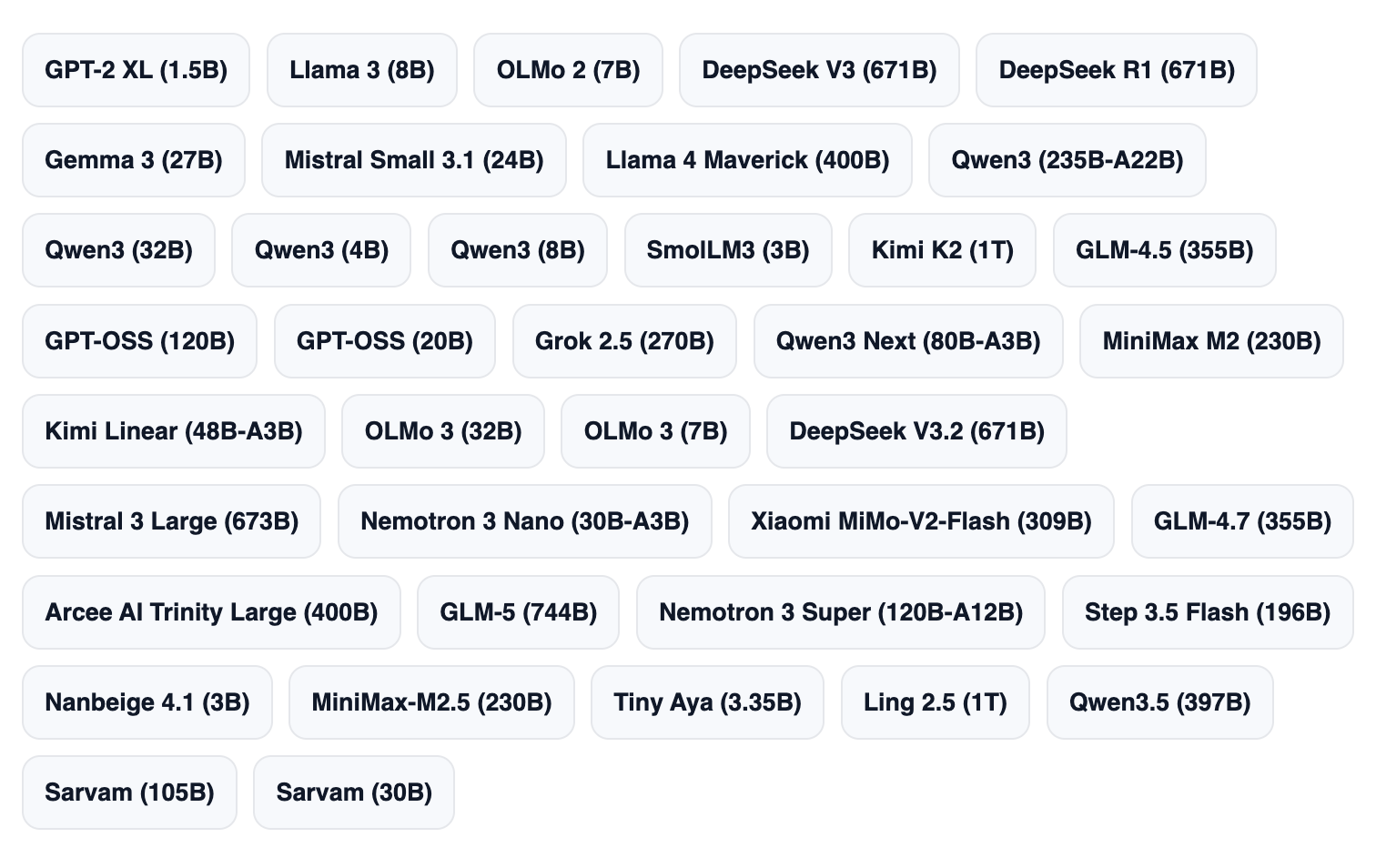

其整理了从 2024 年 4 月到 2026 年 3 月的约 40 个开源大模型,并绘制了详尽的架构图与参数对比表,信息密度很高。在回顾历史的同时,也有必要面向前沿------例如 2026 年初的一批新模型:GLM-5 744B、Ling 2.5 1T、Qwen3.5 397B、Sarvam 105B/30B 等,整体可以归纳为四个重点方向:MoE 效率优化、混合注意力机制、长上下文能力、小语种支持。

一、主流开源大模型架构全景(2024--2026)

核心参考资料为《LLM Architecture Gallery》,该工作整合了多篇对比研究与架构图谱,系统覆盖了四类主流架构:

- 稠密模型(Dense)

- 稀疏专家模型(MoE)

- MLA 模型(Multi-head Latent Attention)

- 混合架构模型(Hybrid)

模型规模从 3B 级轻量模型到 1T 级超大模型,覆盖 Meta、Google、DeepSeek、阿里、智谱、小米、MiniMax 等主流厂商。每个模型均配有结构化信息卡,包括架构设计、参数规模、注意力机制与关键创新点。

二、四大架构类型与代表特征

1. 稠密模型(Dense)

代表模型:Llama 3 8B、OLMo 2/3、Gemma 3 27B、Mistral 3.1 Small 24B、Qwen3 系列、Tiny Aya 等

这类模型参数规模通常在 3B--32B,强调轻量化与低延迟,适用于端侧或中小算力场景。

技术特点:

-

以 GQA(分组查询注意力)+ RoPE 为主流组合

-

引入 QK-Norm、滑动窗口注意力(SWA)等优化

-

部分模型在训练稳定性与结构上做差异化探索

- OLMo:坚持 Post-norm

- Tiny Aya:注意力与 MLP 并行计算

整体来看,Dense 模型仍是"可落地"的主力形态。

2. 稀疏专家模型(Sparse MoE)

代表模型:DeepSeek V3/R1、Llama 4 Maverick、Qwen3 235B-A22B、GLM-4.5、Mistral 3 Large、小米 MiMo-V2-Flash

核心特征是"总参量大、激活参量小"。例如 DeepSeek V3 总参 671B,但单次激活仅约 37B。

关键优势:

- 通过专家路由显著降低计算成本

- 支持超长上下文(128k+ 已成常态)

典型创新:

- DeepSeek:稠密前缀 + 共享专家(行业标杆)

- GLM-4.5:多层稠密前缀 + MoE

- Llama 4:稠密块与 MoE 块交替

- MiMo-V2-Flash:极小窗口(128 token)强化局部建模

MoE 已成为超大模型的"默认解法"。

3. MLA 模型(Multi-head Latent Attention)

代表模型:DeepSeek 系列、Kimi K2、GLM-5、Sarvam 等

MLA 通过潜在空间压缩注意力计算,逐步替代传统 MHA / GQA,并常与 MoE 结合使用。

特点:

- 在超大参数规模下维持计算效率

- 显著降低 KV Cache 压力

代表案例:

- Kimi K2:1T 参数(激活约 32B),当前最大 MLA+MoE 模型之一

- DeepSeek V3.2:引入自研稀疏注意力

- GLM-5:MLA + 稀疏注意力融合

MLA 正成为高性能模型的重要分支。

4. 混合架构(Hybrid)

代表模型:Qwen3 Next、Qwen3.5、Kimi Linear、Nemotron 3、Ling 2.5

该方向的核心在"融合",主要体现在三条路径:

(1)注意力混合

- GQA / MLA + 门控注意力 / DeltaNet

- 如 Qwen3.5:多种注意力按比例组合

(2)架构混合

- Transformer + 状态空间模型(如 Mamba-2)

- 如 Nemotron 3:以 SSM 为主,注意力为辅

(3)线性注意力

- 如 Ling 2.5:Lightning Attention + MLA

- 支持万亿参数与超长上下文

混合架构正在突破传统 Transformer 的计算瓶颈。

三、关键技术趋势

1. MoE 成为主流路径

自 2024 年 DeepSeek V3 起,MoE 快速普及。到 2025--2026 年,百亿级以上模型几乎全面采用。优化重点集中在:

- 专家路由效率

- 激活参数占比

- 避免专家"空转"

2. 注意力机制持续演化

- GQA 仍是基础配置

- MLA 快速崛起

- SWA、门控注意力、DeltaNet、Lightning Attention 等并行发展

- 长上下文(128k+)已成为标配,部分模型达到 512k

3. 训练与表示机制优化

- QK-Norm 基本成为标配

- RoPE 与 NoPE 组合逐渐普及

- 长上下文位置编码(如 YaRN)不断优化

- Post-norm 在部分模型中回归

4. 效率与专用化并行发展

一方面是轻量化:

- 3B--8B 模型面向端侧部署

- 结构进一步简化(如解绑 embedding)

另一方面是专业化:

- 代码模型(如 MiniMax M2.5)

- 小语种模型(如 Sarvam)

同时,新的设计范式不断出现:

- Transformer + SSM

- 稠密 + 稀疏

- 注意力 + MLP 并行

本质上都是在突破算力与效率的边界。

总结

如果用一句话概括当前大模型架构的演进方向,可以说:

从"单一 Transformer"走向"多机制融合",在效率、规模与能力之间寻找新的平衡点。

MoE 解决规模问题,MLA 优化效率,混合架构探索上限,而长上下文与专用能力则决定落地价值。整体趋势已经从"比谁更大",转向"如何更高效、更可用"。